当 AI 编程助手开始"失忆":两个项目上下文优化 减少98%token 消耗

当VibeCoding的时候经常遇到的一个问题,

AI 编程助手”失忆”

不妨来看看两个 9K+ Star 项目的解法:

-

context-mode:AI Agent 上下文优化 – 减少 98% token 消耗

-

claude-context:Claude Code 代码搜索 MCP – 让整个代码库成为上下文

有意思的是,这两个项目都在解决同一个问题,但思路完全相反。

01 我们都遇到过的问题

用 AI 写代码的时候,你肯定有过这种体验:

前 10 分钟,AI 记得你说的每个细节。你告诉它“用 TypeScript,别用 any 类型”,它照做了。

20 分钟后,它开始问一些前面已经回答过的问题。

半小时后,它开始变得笨笨的了,问你”这是 React 还是 Vue?”

毫无疑问上下文窗口被塞满了。

然后 AI 就开始“失忆”了。

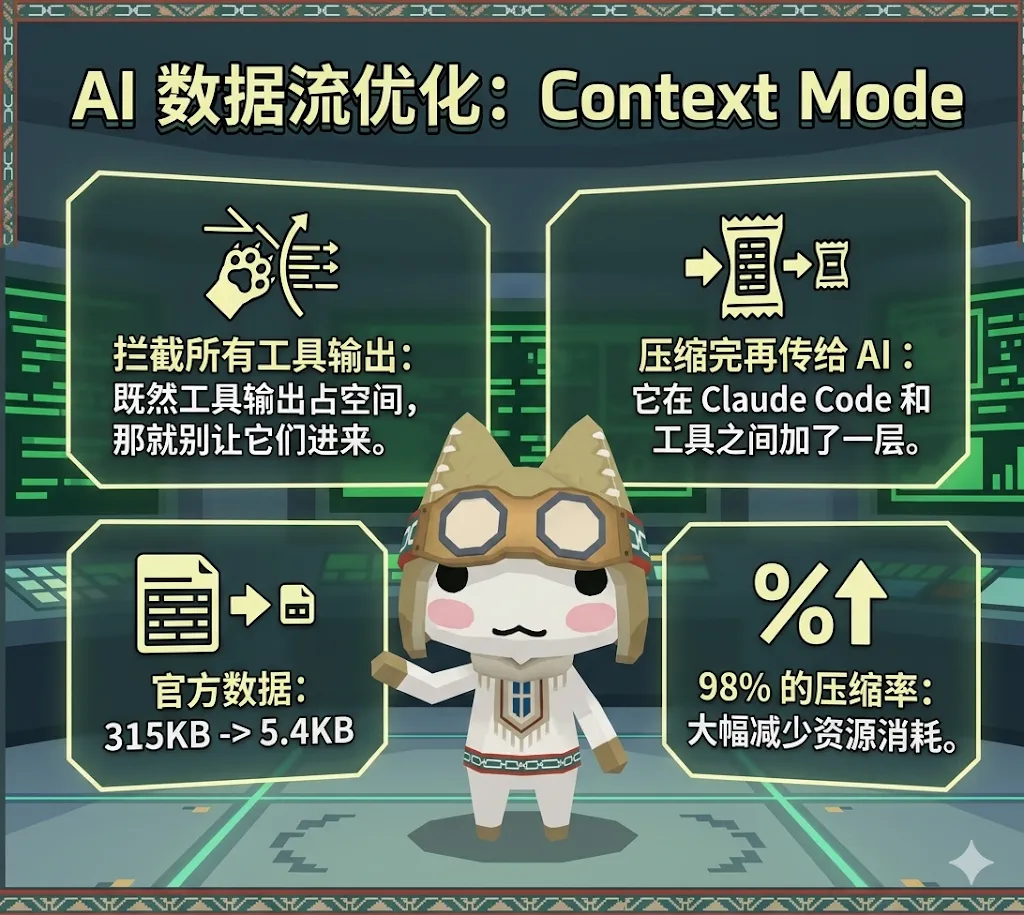

02Context Mode:暴力压缩

Context Mode 的思路很直接:

既然工具输出占空间,那就别让它们进来。

它在 Claude Code 和工具之间加了一层,拦截所有输出,压缩完再传给 AI。

官方数据是 315KB 压到 5.4KB,98% 的压缩率。

它是怎么做到的?

我看了它的实现,用了三阶段管道:

第一阶段:过滤明显的噪音

重复的日志调试信息进度条(那种"50%...51%...52%...")

第二阶段:提取关键信息

错误信息警告状态变化(比如"构建成功")

第三阶段:建立索引 压缩掉的内容不是丢了,而是存在本地数据库里。AI 可以通过语义搜索找回来,但不占上下文空间。

官方有个评估数据:在保证检索质量的前提下,token 使用减少 40%。

同样的对话,成本降低 40%或者对话时间延长 67%

安装是一行命令:

claude mcp add context-mode \-e OPENAI_API_KEY=your-key \-- npx context-mode@latest装完后对用户透明,不需要改变任何使用习惯。你还是正常跟 Claude 对话,它自动在后台压缩。

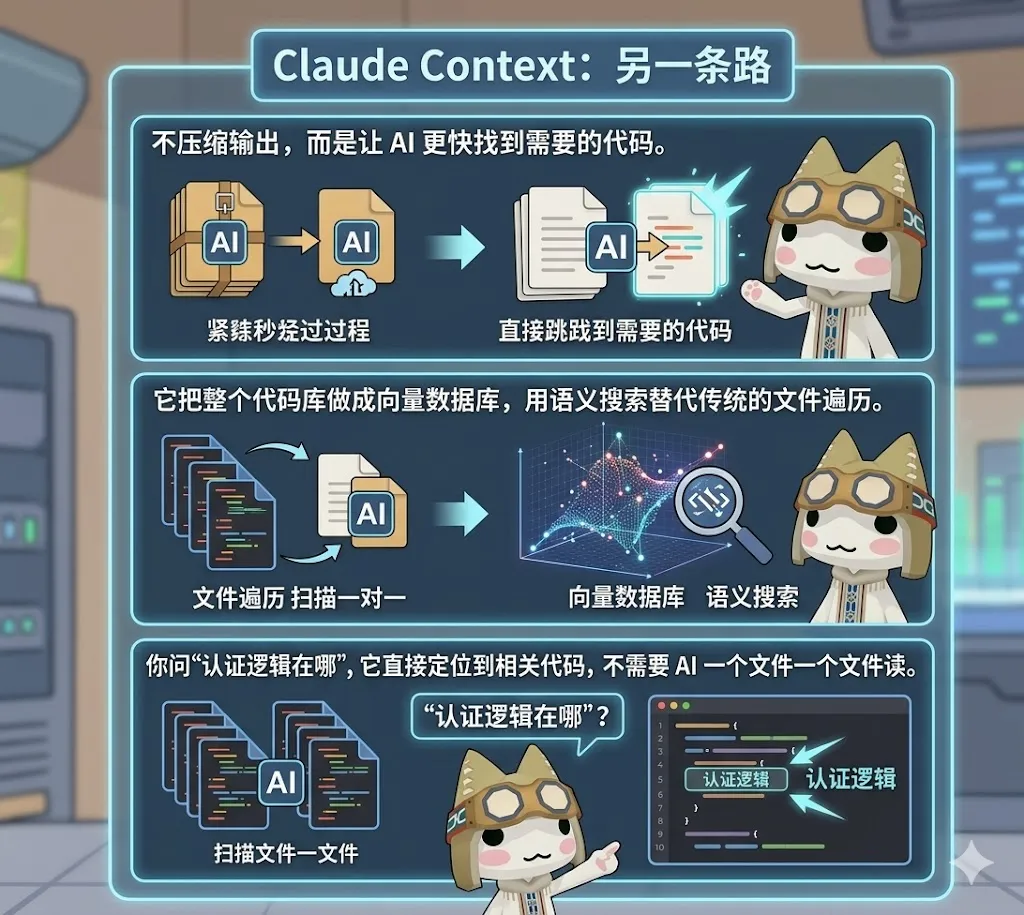

03Claude Context:精准检索

Claude Context 走的是另一条路:

不压缩输出,而是让 AI 更快找到需要的代码。

它把整个代码库做成向量数据库,用语义搜索替代传统的文件遍历。

你问”认证逻辑在哪”,它直接定位到相关代码,不需要 AI 一个文件一个文件读。

我看了一下它的架构:

向量数据库:Milvus(或 Zilliz Cloud)Embedding:支持 OpenAI、VoyageAI、Ollama、Gemini代码分割:基于 AST 的智能分块索引策略:Merkle 树增量更新

这个增量更新很重要。

大型项目几万个文件,全量索引要几分钟。但改了 10 个文件,只重新索引这 10 个,几秒钟搞定。

从架构看,它也是 MCP 服务器,但定位和 Context Mode 不同。

|

维度 |

Context Mode |

Claude Context |

|

解决的问题 |

工具输出太多 |

代码检索太慢 |

|

核心思路 |

减少进入上下文的信息 |

提高进入上下文的信息质量 |

|

适合场景 |

频繁执行命令 |

大型代码库 |

如果你的项目只有几千行代码,Claude Context 的优势不明显。

但如果是几万行,甚至几十万行,语义搜索的效率提升是质变。

安装

需要配置向量数据库,稍微复杂一点:

git clone https://github.com/zilliztech/claude-context.gitcd claude-context# 配置环境变量export MILVUS_URL=your-milvus-urlexport OPENAI_API_KEY=your-keynpm install如果觉得复杂可以直接复制让Agent帮忙配置。

04我的使用建议

Context Mode:

✅ 你经常执行命令(测试、部署、调试)✅ 对话经常超过 30 分钟✅ 工具输出经常刷屏(比如构建日志几百行)之前聊一小时 AI 就开始”失忆”,现在能撑到两小时以上。

唯一的成本是本地磁盘空间,索引数据库会占几百 MB。

Claude Context:

✅ 项目超过 1 万行代码✅ 需要做架构分析、重构这种全局理解的任务✅ 经常问"XX 功能在哪实现的"这种问题小项目(几千行)感知不强

但大项目(我试了一个 5 万行的)提升明显。

之前问”用户认证在哪”,AI 要读十几个文件。现在一次搜索就定位到了。

需要注意的是,它依赖外部向量数据库

要么用 Zilliz Cloud(有免费额度),要么自己部署 Milvus。

我的配置

我自己是两个都装了:

Context Mode 常驻(日常对话用)Claude Context 在大项目时启用

效率提升明显。

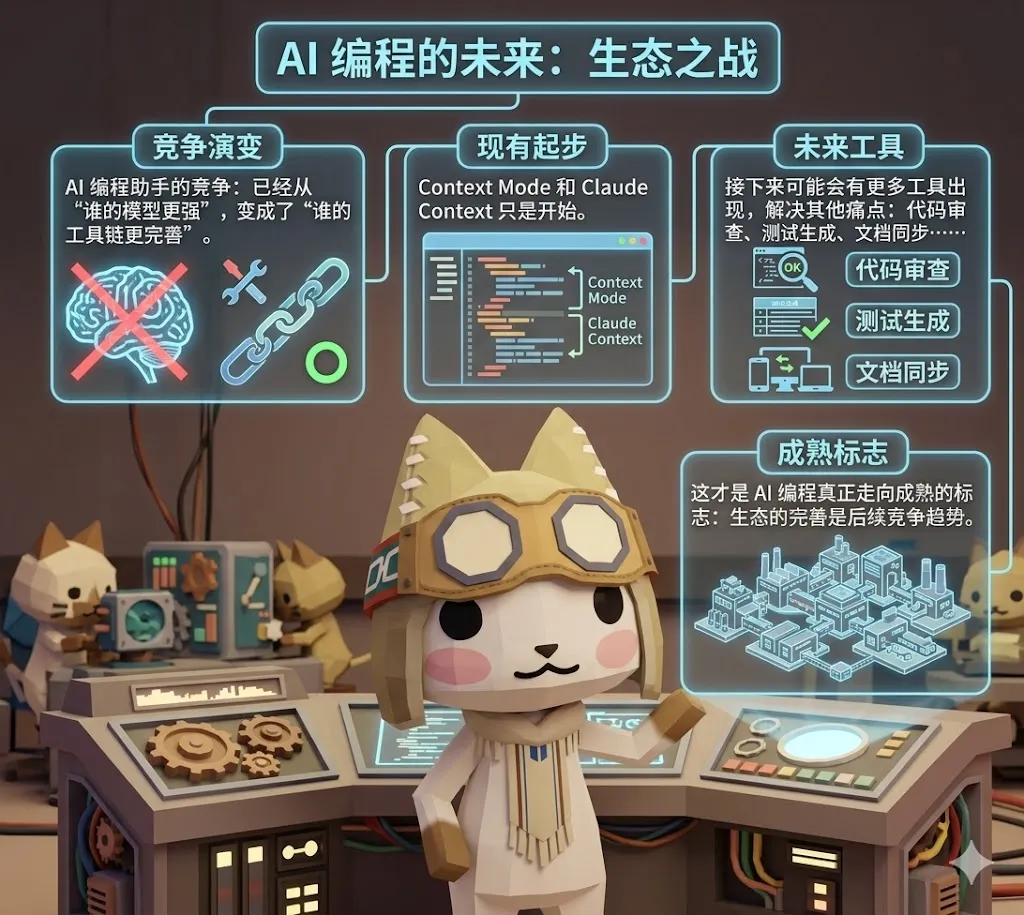

写在最后

AI 编程助手的竞争

已经从”谁的模型更强”,变成了“谁的工具链更完善”。

Context Mode 和 Claude Context 只是开始。

接下来可能会有更多工具出现,解决其他痛点:

代码审查

测试生成

文档同步……

这才是 AI 编程真正走向成熟的标志:

生态的完善是后续竞争趋势。

项目链接:

Context Mode: https://github.com/mksglu/context-modeClaude Context: https://github.com/zilliztech/claude-context

💬 交流群

扫码加群,加入 AI +测试编程实践交流群,和一群志同道合的朋友讨论。

📮获取:

• 最新技术推广文章• 核心技能速查表• 测试人转型 AI 训练师路线图

👍 觉得有用?

如果这篇文章对你有帮助:

点赞→ 让我知道你喜欢这类内容关注→ 你的关注就是我的最大动力在看→ 推荐给更多技术同行分享→ 分享到朋友圈或技术群

你的每一次互动,都是我持续输出干货的动力!

我是Jesse,专注 AI 工具实战与测试自动化,帮测试同行少走弯路。

我们下次见~

夜雨聆风

夜雨聆风