AI 算力全解析:CPU、GPU、NPU、TPU、LPU、DPU、VPU 全维度对比

人工智能技术飞速发展,算力硬件已从传统 CPU、GPU 主导,演进为通用 + 专用异构协同的多元格局。CPU、GPU、NPU、ASIC 类加速器(如 TPU)、LPU(特定架构)、DPU、VPU 等处理器各司其职,在灵活性、并行性、功耗与效率间做出不同权衡,共同支撑 AI 从云端到终端的全场景落地。本文全面拆解各类处理器核心特性、差异与应用场景,帮你快速看懂 AI 算力硬件全貌。

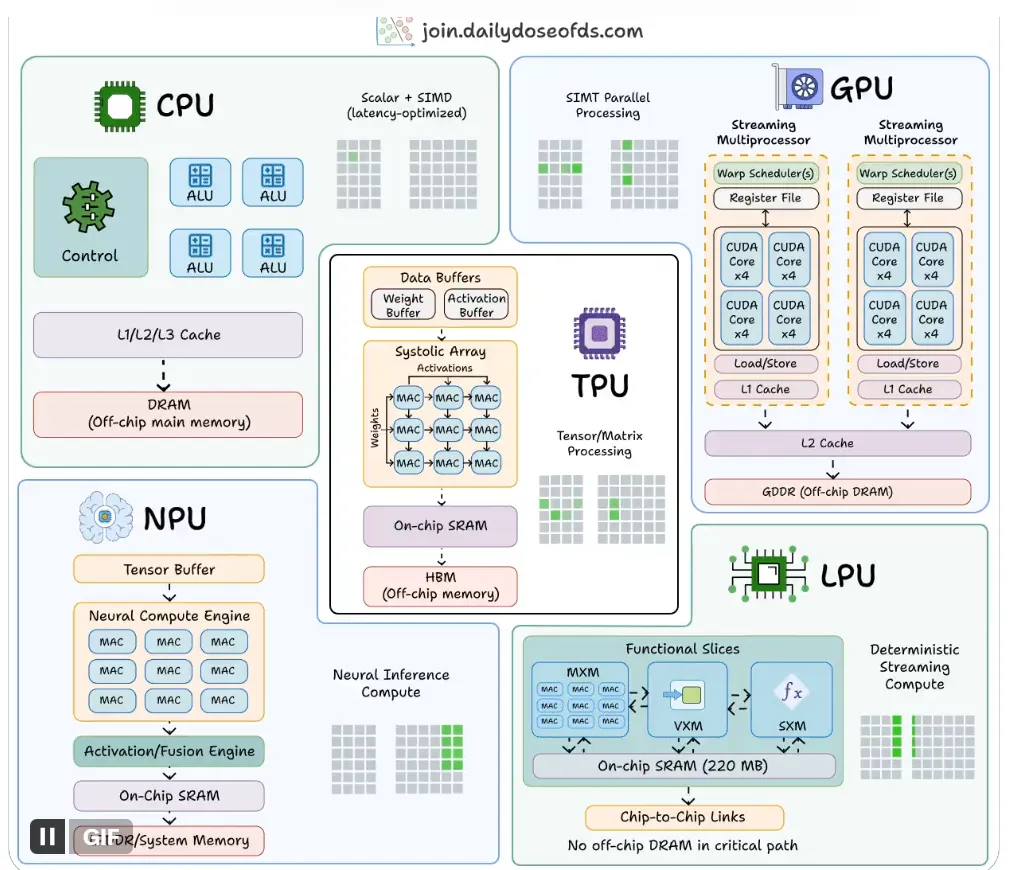

1. 通用算力核心:CPU——计算机的“万能大脑”

CPU(中央处理器)是所有电子设备的基础核心,定位为通用计算中枢,负责系统调度、逻辑控制与复杂运算。

核心特点

-

擅长串行任务、复杂逻辑判断、分支跳转,单线程性能强悍

-

配备 L1/L2/L3 三级缓存,兼顾通用性与低延迟

-

核心数:消费级 4–16 核(部分采用大小核架构),服务器级 64–128 核甚至更高,灵活性拉满,兼容全场景程序

硬件与局限缓存速度快,但片外 DRAM 内存带宽有限,不擅长大规模并行矩阵运算。在 AI 系统中适合担任调度员,承担数据预处理、任务分配、系统管控等辅助工作。

代表厂商英特尔、AMD、ARM、华为海思、高通

典型场景个人电脑、服务器、手机系统调度、日常办公、AI 任务总控

2. 并行计算王者:GPU——AI 训练的“主力工厂”

GPU(图形处理器)最初为图形渲染设计,凭借超强并行计算能力成为深度学习训练的核心硬件。

核心特点

-

众核架构,数千至上万个小型计算核心,极致并行处理

-

高带宽 HBM/GDDR 内存,支撑海量数据并发,算力远超 CPU

-

兼顾通用计算,可做科学计算、视频编解码、3D 渲染

-

支持 FP16、BF16、INT8 等混合精度训练

AI 适配性完美匹配深度学习矩阵运算、卷积运算,是当前 AI 大模型训练与推理的绝对主力平台(尤其是云端)。

代表厂商英伟达、AMD、沐曦集成、摩尔线程

典型场景游戏渲染、影视特效、深度学习训练、大规模云端 AI、科学计算

3. 端侧 AI 专用:NPU——低功耗推理“节能专家”

NPU(神经网络处理器)专为 AI 神经网络计算优化,主打低功耗、高推理效率,是终端与边缘 AI 的核心硬件。

核心特点

-

专用 MAC 阵列、向量引擎、激活函数硬件加速,专注矩阵/卷积运算

-

片上 SRAM + 智能缓存,减少片外访问

-

功耗:端侧典型 1–5W,部分边缘场景可达数十瓦

-

能效比极高,推理速度远超通用 CPU/GPU,适配端侧实时 AI

技术优势

-

支持张量加速、稀疏运算、混合精度,在神经网络推理上表现突出

-

端侧 NPU(手机、耳机)仅支持推理;云端/边缘 NPU(如昇腾、寒武纪)可支持训练与微调

代表厂商华为昇腾、寒武纪、苹果、高通、瑞芯微、晶晨

典型场景智能手机 AI、智能家居、自动驾驶感知、边缘摄像头、可穿戴设备

4. 谷歌定制张量引擎:TPU——云端 AI 专用加速器

TPU(张量处理器)由 Google 研发,针对张量运算深度定制,是云端 AI 训练/推理的专业化方案。

核心特点

-

脉动阵列 MAC 单元,波浪式数据处理,减少数据搬运开销

-

编译器精准控制,无硬件调度损耗,大规模集群能效极佳

-

高算力、低功耗,适配云端大规模神经网络任务

应用边界

-

主要用于 Google 云端 AI 服务、内部大模型训练,以云服务(Google Cloud)或整机形式(如 Cloud TPU v4)对外提供算力,不单独出售芯片

-

已支持 PyTorch(通过 PyTorch/XLA)及 TensorFlow

-

通用性弱于 GPU,但专用场景效率更高

典型场景谷歌搜索/翻译、云端大模型训练、TensorFlow/PyTorch 框架加速

5. 语言模型低延迟推理架构:LPU——云端低延迟推理单元

说明:LPU 非行业通用芯片标准,为特定企业(如 Groq)提出的推理架构。

LPU(语言处理单元)基于全片上 SRAM 存储权重设计,彻底移除片外 DRAM,核心目标是实现极低延迟推理,目前主要用于云端低延迟场景。

核心特点

-

全片上 SRAM 存储权重,无片外内存访问延迟

-

编译器统一调度,无缓存未命中与硬件调度开销,确定性低延迟

-

缺点:片上存储容量有限,单卡模型容量小,大型模型需集群部署,成本较高

典型场景云端低延迟 AI 对话、交互式 LLM 推理(不适用于端侧)

代表企业(非通用厂商)Groq 等

6. 数据中心基石:DPU——数据搬运与安全管家

DPU(数据处理单元)聚焦数据中心数据流转、存储、网络与安全,解放 CPU 专注业务计算。

核心特点

-

高效数据搬运、网络加速、存储虚拟化、硬件级安全加密

-

降低 CPU 负载,提升数据中心整体吞吐量与安全性

-

不直接参与 AI 模型矩阵运算,但可卸载推理中的网络和存储任务

代表厂商NVIDIA BlueField、Intel IPU、AMD(Pensando),以及主流云厂商自研方案(如阿里 CIPU、AWS Nitro)

典型场景云计算数据中心、5G/6G 通信、大规模存储系统、网络安全

7. 视觉处理专用:VPU——图像视频加速单元

VPU(视觉处理单元)专注图像/视频处理,兼顾编解码与轻量视觉辅助,是智能视觉场景的重要组成部分。

核心特点

-

硬解 8K/4K 视频(H.265/AV1 等),低功耗实时处理

-

可配合 NPU/GPU 完成目标检测、人脸识别等视觉 AI 任务,自身侧重图像前处理、缩放、去噪与编解码加速

-

多屏异显、多路摄像头数据并行处理

代表厂商英特尔(Movidius)、瑞芯微、晶晨(面向安防、边缘、嵌入式视觉)

典型场景安防监控、自动驾驶视觉、手机影像、视频会议、无人机

8. 处理器核心对比及选型指南

点击下方关注我们~

业务涵盖抵押、流贷、经营性物业、链金融、并购贷、项目贷、专利质押、投贷联动等。

详聊请扫码~

主营城市:上海

电话:021-31135679

欢迎大家进入线上群交流:请备注:加群

夜雨聆风

夜雨聆风