AI产品笔记④·《AI不会读心,让产品主动开口说话》

AI Native 产品设计·04|AI 不会读心,让产品主动开口说话

AI Native 产品设计 12 原则 · 第 03 篇 约3500 字 · 阅读时长 7分钟

一、等待cursor回答的那30秒

你一定经历过这个场景

你给cursor发了一个问题。屏幕上出现一个”Planning next moves”。

你等。

5 秒过去了。10 秒过去了。15 秒过去了。

它在干什么?在搜索?在推理?卡住了?还是网络断了?

你不知道。

那 30 秒,是 AI 产品体验最危险的30秒——不是因为它慢,是因为它沉默。

上一篇我们讲了”双用户”——AI 已经成为你产品的真实用户。这一篇我们换一个方向,讲人类用户在AI产品里的真实痛点

AI 不会读心。但更可怕的是,AI 也不会主动开口。

传统产品教会了产品经理一套设计本能——按钮要有反馈、操作要有确认、加载要有进度。这套本能在 AI 产品面前几乎全部失效。

因为AI产品从”用户输入”到”产品输出”之间,有一段过去不存在的黑盒。这一篇要讲的,就是怎么把这段黑盒打开。

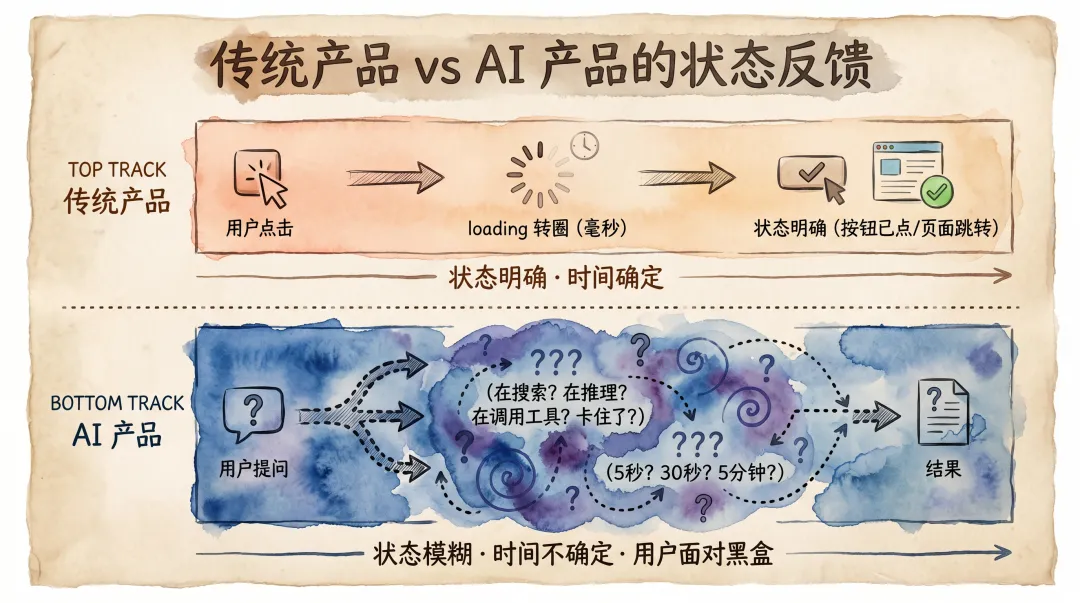

二、传统产品的”被动响应”逻辑为什么失效

讲清楚两类产品的根本差异

传统产品的状态反馈:

用户点按钮→立即响应(按钮变色、页面跳转、loading转圈)。

状态明确:已点 / 未点 / 加载中 / 已完成。

时间确定:响应时间是毫秒级,loading 状态简单。

AI 产品的状态反馈:

用户提问 → AI内部展开复杂过程:搜索、推理、调用工具、再推理、汇总。

状态模糊:可能在搜索、可能在推理、可能在调用 API、可能卡住了。

时间不确定:从 0.5秒到5分钟不等。

传统产品的”loading 转圈”作为状态反馈在 AI 时代彻底失效——用户面对一个长时间转圈的 AI,就是面对一个黑盒。

这不是细节问题。这是产品逻辑底层的范式差异。

传统产品的设计假设是——响应是即时的、状态是确定的。所以你只需要在”未响应”和”已响应”之间放一个 loading 动效就够了。

AI产品的设计假设变成——响应是延迟的、状态是多阶段的、过程是不确定的。loading 动效在这种新假设下完全不够用。

用户需要看见AI在干什么。

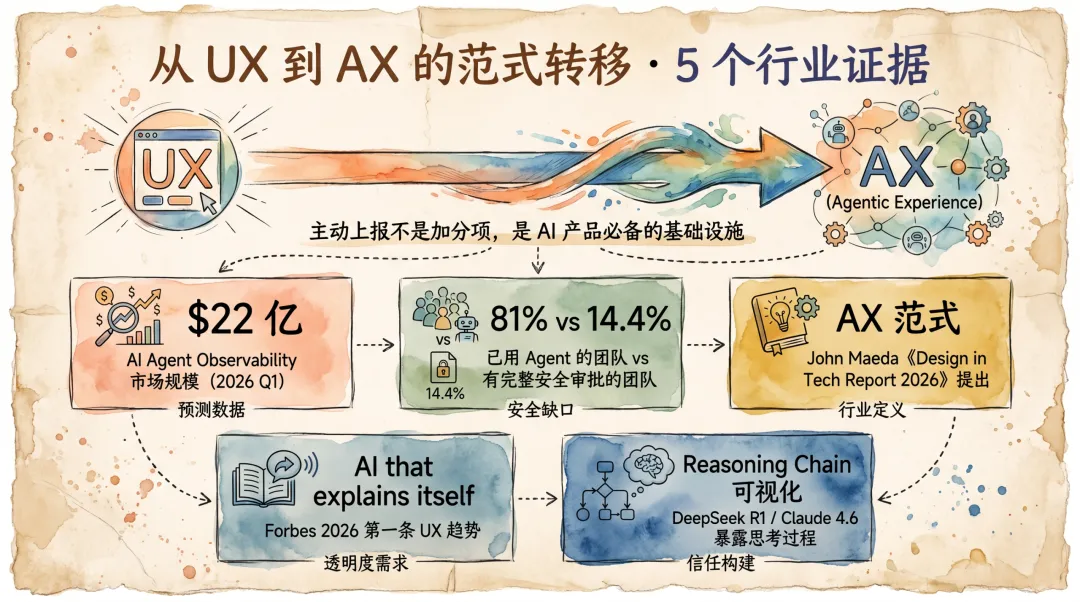

三、从 UX 到 AX——主动上报已经成为行业共识

这不是我一个人的判断。看 2026 年的几个标志性信号

信号一:AI Agent Observability已成为 22 亿美元市场。

Deepak Gupta 2026 Q1 报告分析了 90 多家相关公司——可见性、状态报告、监控已经形成独立行业。

信号二:John Maeda 在《Design in Tech Report 2026》中提出从 UX 到 AX(Agentic Experience)的范式转移。

设计的对象从”用户体验”扩展到”代理体验”——人怎么和正在干活的AI协作,是设计师必须解决的新问题。

信号三:Forbes 2026 UX Design Shifts,其中一条就是”AI that explains itself”

会自我解释的 AI。这已经不是趋势预测,是行业共识。

信号四:State of AI Agent Security 2026数据

81%的团队已经在用Agent,但只有14.4%有完整安全审批。这个差距的核心,就是状态不可见——团队不敢放手让Agent干活,因为他们看不见Agent在干什么。

信号五:DeepSeek R1把Reasoning Chain暴露给用户

引发了产品设计的连锁反应。用户不再只想要”答案”,他们想要”看AI怎么想出这个答案”。Claude4.6、OpenAI o系列纷纷跟进。

把这五个信号加在一起

主动上报不是加分项,是AI产品必备的基础设施。

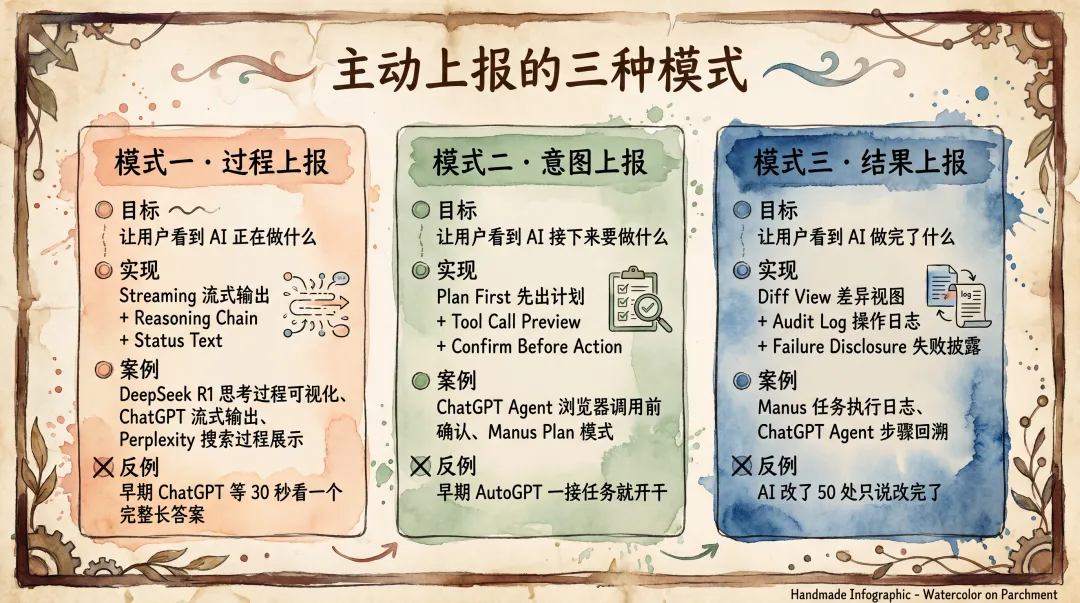

四、主动上报的三种模式

主动上报听起来抽象,但落到产品上是三种具体模式

模式一 · 过程上报:让用户看到”AI 正在做什么”

目标:消除”黑盒等待”焦虑。

实现方式:

Streaming 流式输出——让用户看到 AI 一字一字写出来,而不是等完整回答。这是最朴素也是最有效的过程上报。

Reasoning Chain 思考过程可视化——DeepSeek R1 把 AI 的思考过程作为产品体验的一部分暴露给用户。Claude 4.6 在复杂任务中也会展示推理链。这不是炫技,是真实的产品功能——用户通过看 AI 怎么想,判断要不要相信结果。

Status Text 状态文字——Perplexity 在搜索过程中持续显示”正在搜索 X 来源…”、”正在综合 5 篇文档…”。每一步都让用户知道 AI 在干什么。

反例:早期 ChatGPT 没有 Streaming,用户提问后等 30 秒看到一个完整长回答。表面”高效”,实际体验崩塌——因为那 30 秒是黑盒。Streaming 上线后,总耗时没变,但用户感知速度提升了 3-5 倍。

模式二 · 意图上报:让用户看到”AI 接下来要做什么”

目标:让用户能”叫停”或”修正”。

实现方式:

Plan First先出计划——Manus接到任务先输出Plan:第一步做X,第二步做Y,第三步做Z。用户确认后才执行。这把”用户失控感”挡在执行之前。

Tool Call Preview 工具调用预览——ChatGPT Agent 在调用浏览器前显示”我准备打开booking.com,确认吗?”——把可能的风险动作摆到桌面上。

Confirm Before Action 行动前确认——高风险操作(提交表单、付款、删除文件)前主动暂停等待用户确认。这是 AI Native 产品最容易被忽视、但最关键的一环。

反例:早期 AutoGPT一接任务就开干,用户全程不知道它在做什么——结果烧了几十块token,做了一堆没用的事。这就是”意图不可见”的真实代价——不是AI笨,是产品没让用户参与决策。

模式三 · 结果上报:让用户看到”AI做完了什么 / 没做什么”

目标:让用户能”审阅”和”追溯”。

实现方式:

Diff View差异视图——AI 改了什么、改在哪里,用diff形式呈现。用户能逐条 review而不是被动接受。

Audit Log 操作日志——Manus、ChatGPT Agent 把每一步操作记录下来,用户能完整回溯整个任务过程。这是 Agent 类产品建立信任的核心机制。

Failure Disclosure 失败披露——明确告诉用户”我尝试了 X,但失败了,原因是 Y”——而不是装作没事。这一点最反直觉——很多 PM 害怕暴露失败,但暴露失败比掩盖失败更增信任。

反例:用AI写文章,AI改了50处,但只告诉你”改完了”——用户根本不知道改了什么、要不要接受。这是结果上报缺失的典型,也是用户对 AI 文字工具最普遍的不满。

五、主动上报的三个反直觉

讲到这里必须讲清楚三件反直觉但很重要的事

反直觉一 · 越多上报,越显得”慢”,但用户感知更快

很多PM 担心”主动上报会让产品看起来很慢”。事实正好相反。

研究表明,有Streaming的AI产品,即使总耗时一样,用户感知速度比无 Streaming 快 3-5 倍。这是经典的”感知性能 vs 实际性能”

让等待变得可见,等待就不再难熬。

人类对”看不见的等待”是没有耐心的。但对”看得见的过程”,人类有惊人的容忍度。

反直觉二 · 暴露失败比掩盖失败更增信任

很多 PM 担心”AI 出错时坦白,会让用户觉得产品不可靠”。事实正好相反。

主动披露失败的 AI 产品,用户信任度反而更高。Claude Code 经常说”我尝试了 X 但没成功,建议你手动检查”——这种诚实让用户敢于把更复杂的任务交给它。

掩盖失败的产品,反而会让用户在某次踩坑后永远不再信任。

反直觉三 · Reasoning Chain 不只是炫技,是产品功能

DeepSeek R1 把 Reasoning Chain 暴露出来引发巨大讨论。很多人以为这是”炫耀技术”——其实它是个真实的产品功能。

用户通过看 AI 的思考过程,判断要不要相信结果

如果 AI 的推理链清晰、逻辑自洽——用户更信。

如果 AI 的推理链跳跃、有明显错误——用户能在结果出来前就识别风险。

这种”可验证的信任”是 AI Native 产品的核心体验。它把”信任”从一个被动接受的结果,变成了一个用户主动验证的过程。

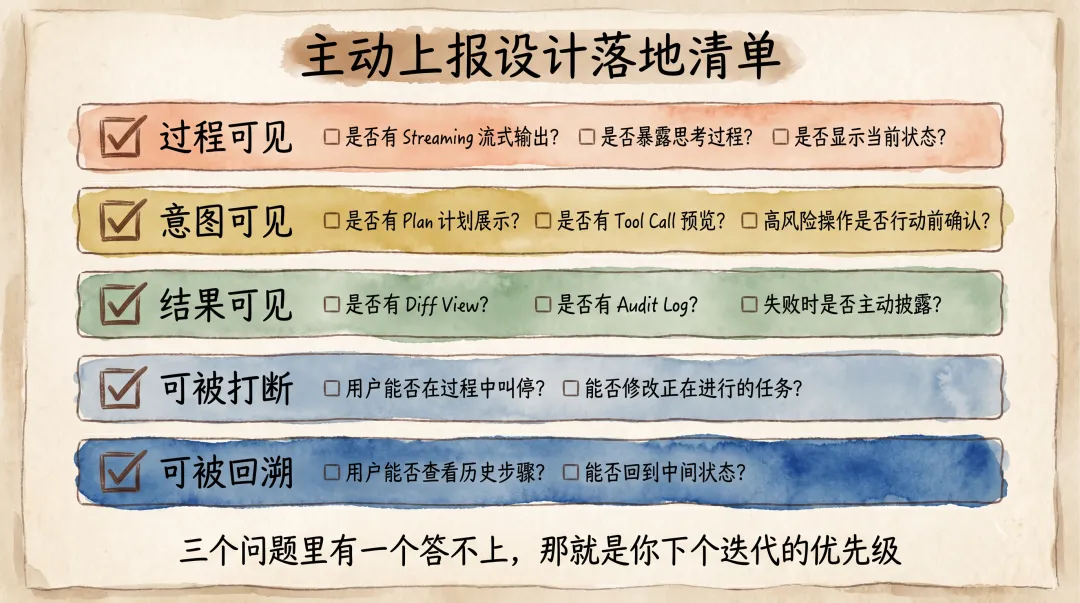

六、主动上报的设计落地清单

给你一份可对照执行的清单——拿你现在做的 AI 产品对一遍。

过程可见:是否有 Streaming 流式输出?是否暴露思考过程?是否显示当前状态?

意图可见:是否有 Plan 计划展示?是否有 Tool Call 预览?高风险操作是否行动前确认?

结果可见:是否有 Diff View?是否有 Audit Log?失败时是否主动披露?

可被打断:用户能否在过程中叫停?能否修改正在进行的任务?

可被回溯:用户能否查看历史步骤?能否回到中间状态?

三个问题里有一个答不上,那就是你下个迭代的优先级。

七、今天就能做的三件事

读完这一篇,先别合上。这三件事你今天就能动手

第一件 · 用 ChatGPT 和 Manus 各做一个相同的任务

挑一个稍微复杂的任务(比如”帮我研究一下 AI 产品的最新趋势并整理成一份报告”),分别用 ChatGPT 和 Manus 跑一遍。

观察两者的”主动上报”差异——你会发现Manus的PMF很大程度上来自更密集、更结构化的状态上报。Plan、Tool Call、Audit Log 一个不少。

这不是技术差距,是产品设计的差距,manus这样的agent系统过程动作会更多。

第二件 · 拿出你产品的关键AI流程,问三个问题

-

用户能看到”AI 正在做什么”吗? -

用户能看到”AI 接下来要做什么”吗? -

用户能看到”AI 做完了什么”吗?

三个问题里只要有一个答不上,那就是你产品下个迭代的优先级。

第三件 · 加一个”失败披露”动作

找你产品里最容易失败的 AI 场景,加上一句”主动失败披露”——不是优化失败率,是优化失败时的体验。

例如把”生成失败”改成”我尝试了用 X 模型生成,因为 Y 原因失败了。建议你 A/B/C 三种处理方式。”

这是性价比最高的信任增量。一行文案的改动,换来用户对你产品的根本性态度变化。

下一篇预告

下一篇(AI Native 产品设计·05)我们要回答一个更底层的问题

AI 产品的引擎不是逻辑,是概率。

为什么”测试通过”已经不再是AI产品的质量标准,以及概率本质如何重新定义产品的设计、交付、验收,概率不是 Bug,是AI的本质。

配套《AI Native 产品设计自查手册》正在整理:包含七层栈各层的完整自检清单 + 5 个判定标准的扩展版。关注公众号,评论 “自查手册”,发布后第一时间发给你。

夜雨聆风

夜雨聆风