当前时间: 2026-05-06 06:51:23

更新时间: 2026-05-06

分类:软件教程

评论(0)

AI批改作文,真的靠谱吗?

我带两个班,将近90个学生。每周一篇作文,每篇精批下来少则五六分钟,多则将近十分钟。这不是在抱怨,这是在问一个真实的问题:AI批改,到底能不能接手这件事?

每周至少一篇作文,这是雷打不动的。每次把题目写上黑板的时候,我心里其实是有期待的——这次题目出得不错,说不定能看到几篇有意思的。但等到坐下来改的时候,期待就慢慢变成了另一种东西。不是失望,是一种沉。

改一篇作文,我大概要花8分钟左右,遇到难改的,可能更久。

不是因为我快。是因为这件事本来就不慢。我要先通读一遍,判断这个孩子的立意有没有跑偏——题目是”记一件让你成长的事”,有的孩子写的是事,有的孩子其实在写情绪,有的孩子两样都没写清楚,只是在流水账地记录时间线。立意这件事,没有对错,只有”到没到”,这个判断本身就需要时间。

然后看段落结构。开头有没有把读者带进去,中间有没有散掉,结尾有没有收住。很多孩子的作文结尾是这样的:”通过这件事,我明白了一个道理,那就是……”后面跟着一句从来没在文章里出现过的感悟,像是临时想起来加上去的。这种结构问题,不是一个红圈能解决的,我需要在旁边写清楚:你的结尾和你的故事是脱节的,读者跟着你走了那么久,最后被你扔在了路边。

然后逐句看。不只是错别字和病句,还有那种”你想说什么,但没说清楚”的模糊表达。比如”那一刻我的心情很复杂”——复杂是什么意思?是难过还是委屈还是有点庆幸?这句话需要被追问,而不是被放过。

最后,我要在结尾写一段总评。这段话不能太套路,不能每篇都是”语言流畅,结构完整,希望继续努力”,要让这个孩子看完之后知道他哪里写得好、哪里下次可以改,最好还能让他觉得:老师是真的看了我这篇。

这一套走下来,快的时候五六分钟,慢的时候将近十分钟。遇到一篇思路特别乱的,我需要花更多时间理清楚他到底想说什么;遇到一篇写得特别好的,我也会多停一会儿,因为我想给出配得上这篇文章的评价。

90篇作文,就算每篇平均8分钟,也是整整12个小时。这还只是作文。

阅读理解的主观题同样如此。”结合文章内容,谈谈你对这句话的理解”——这类题没有标准答案,每个学生的表述都不一样。有的孩子意思说对了,但表达得很绕;有的孩子用词很准确,但漏掉了一个关键维度;有的孩子答案和参考答案一个字都不一样,但其实理解得相当透彻。这些都需要逐一判断,不能靠扫一眼完成。

有一次,我改到第67篇的时候,看到一个学生写了这样一句话:”秋天的风闻起来有点像外婆家的味道。”

我停下来,读了两遍。这句话写得很好,不是因为它用了什么修辞技巧,而是因为它非常真实,非常属于这个孩子。我想在旁边多写几个字——问她外婆家在哪里,问她是什么味道,告诉她这句话是整篇文章里我最喜欢的。

这件事让我记了很久。不是因为愧疚,而是因为我意识到:这种”想认真但没时间认真”的状态,已经变成了常态。每周都在发生,每周都在被我默默接受。

所以当AI批改这件事开始被越来越多人讨论,当身边的老师开始陆续用上各种批改软件,我的第一反应不是抵触,也不是盲目跟风,而是认真想了一个问题:

在回答”AI能不能做”之前,我觉得有必要先把”批改”这件事拆开来看。

很多人以为批改作文就是”找错误”,但实际上,一篇作文的批改至少分两个层次,这两个层次对能力的要求完全不同。

第一层是基础层:错别字、标点误用、病句、语法问题。这些是客观的,有对有错,不需要主观判断。”的地得”用混了,主谓搭配不当,句子成分缺失——这类问题,AI识别起来已经相当成熟。从行业公开的数据来看,主流产品在这一层的准确率普遍可以达到98%以上,识别速度是人工的几十倍。一篇500字的作文,AI几秒钟就能把基础层的问题全部标注出来,而人工至少需要通读一遍。

第二层是深度层:立意是否符合题目要求,段落之间的逻辑是否顺畅,表达有没有个性和感染力,阅读理解题的回答是否”意思到位”。这部分才是语文老师真正花时间的地方。它不是找”对不对”,而是在判断”好不好”、”到不到位”——这是一个需要语感、经验、以及对学生个体了解的过程。

这两层之间有一条清晰的分界线:基础层处理的是”规则”,深度层处理的是”理解”。前者可以被标准化,后者很难。

AI批改产品目前能做到哪一层,是评判它是否真正有用的核心问题。

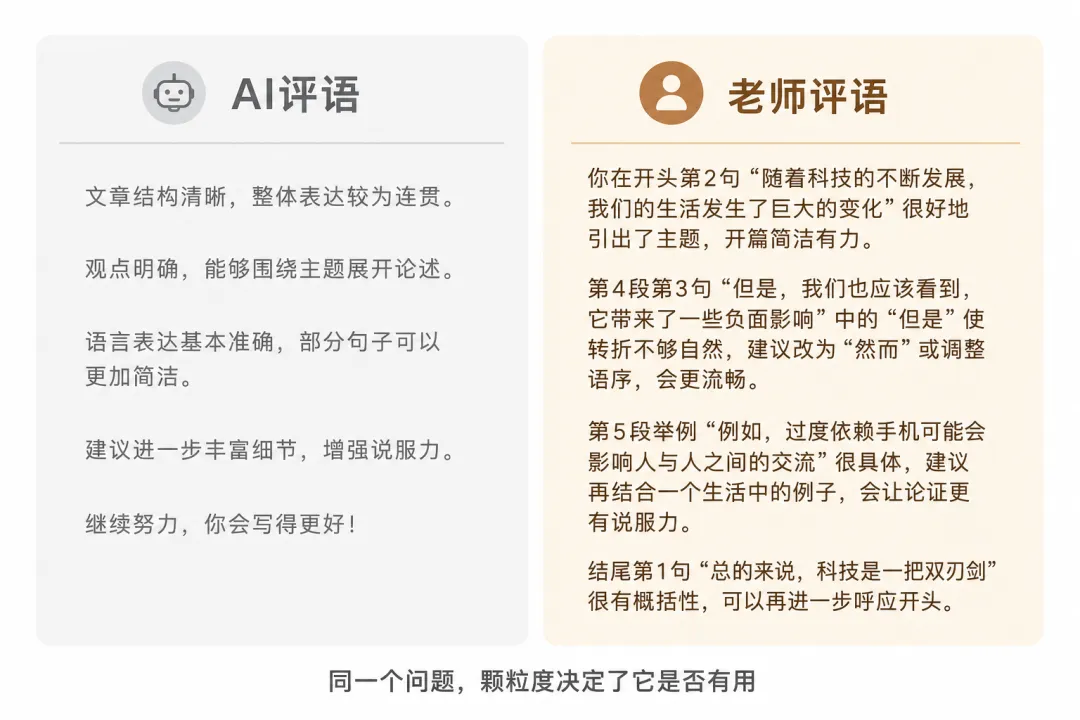

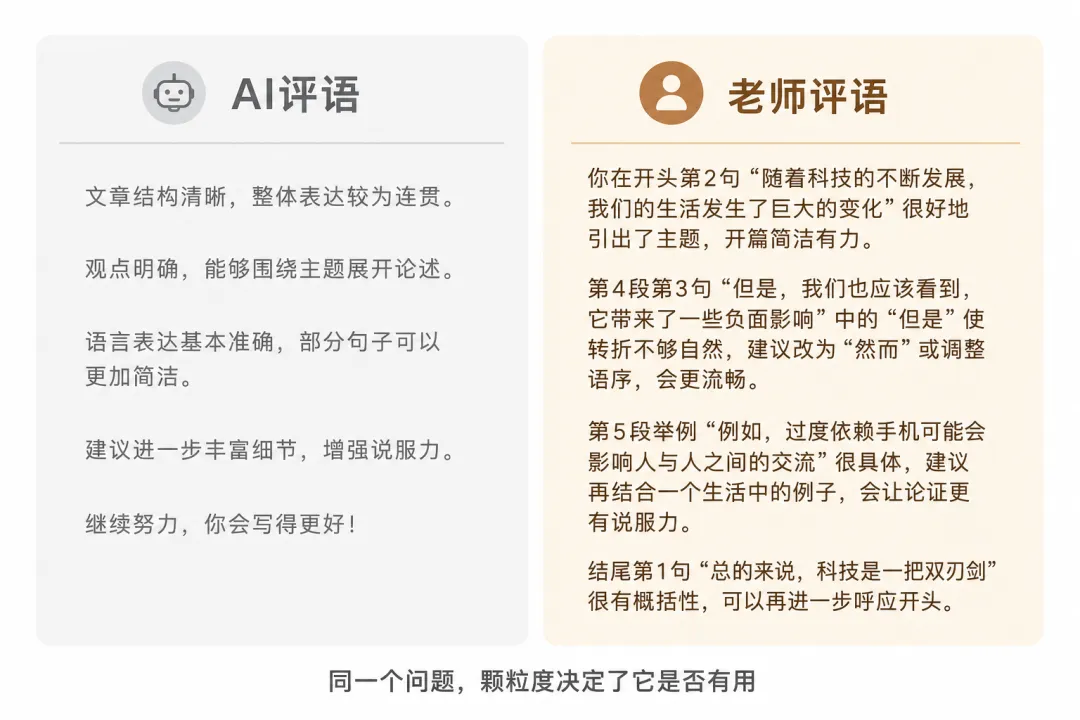

一条有价值的批改评语,应该能回答三个问题:哪里出了问题、为什么是问题、怎么改。三个都答到,才算一条合格的评语。只答了第一个,是在陈述事实;答了前两个,是在做分析;三个全答到,才是在真正帮助学生。

AI版本的评语可能是这样的:”开头部分较为平淡,建议使用更具吸引力的开头方式,如设问、引用名言等,以增强文章的感染力。”

老师版本的评语可能是这样的:”你用’自从那件事发生之后,我就再也没有忘记过’开头,读者不知道’那件事’是什么,好奇心没有被充分调动。如果把第三段里那个具体的场景提到开头,效果会好很多。”

两条评语都在说”开头有问题”,但后者指向了具体的句子、具体的问题所在,以及具体的修改方向。前者像是一个通用模板,放在任何一篇作文上都成立;后者是在跟这个学生说话,只属于这一篇。

这就是我说的评语颗粒度——它决定了AI批改对学生是否真正有帮助,也决定了老师拿到AI的批改结果之后,还需要花多少时间重新处理。

这两年,AI批改赛道已经相当热闹了。从硬件设备到手机小程序,从学校采购到个人订阅,产品形态各不相同,但背后都在试图解决同一个问题:把老师从重复性的批改劳动里解放出来。

科大讯飞的星火智能批阅机是这个方向的代表产品。它的逻辑是:老师把作文放进去扫描,机器16秒出一份批改报告,内容包括旁批、结构批阅、总评和润色建议,还会生成一份供课堂讲评用的PPT报告,包含班级成绩统计、好词好句、历史成绩走势等维度。

数据上的反馈是可观的。上海已有110余所学校在用类似的系统,一些老师反馈,原来一节课40分钟才能批完的默写卷,现在十几分钟就处理完了;有学校引入AI批改系统两个月后,学生作文均分提高了约1.5分。

这类产品的优势是效率极高,适合考试场景或大批量批改;局限在于硬件成本不低,而且批改深度依赖预设的评分细则。评分细则是由教研团队提前设定的,对”标准化”的作文类型处理得好,但遇到表达方式比较特别的学生,识别能力就会打折扣。

这类产品使用门槛更低,老师拍照上传即可,更贴近普通老师的真实场景,不需要学校统一采购。

笔神作文批改是其中技术口碑较好的一款,单篇500字作文批改时间在8秒以内,语义解析准确率声称达到90%以上。它的技术架构采用私有轻量化大模型结合微调技术,不只是做表面的语法检查,还能识别隐含逻辑和情感倾向。跨平台兼容微信小程序,支持批量上传,对个人老师来说使用成本比较低。

批改邦采用的是规则引擎加大语言模型的混合架构,速度很快,适合快速筛查大批量作文,但深度批改能力相对有限——它在处理基础层问题时表现稳定,但在深度层的主观判断上还有明显的提升空间。

蜜蜂AI是合合信息旗下扫描全能王推出的教育产品,背靠扫描全能王3亿用户积累的多模态文本智能技术,宣称作业批改准确率达99%,累计批改题次已超过12亿,覆盖K12全学科。它在技术上的一个亮点是对真实作业场景的适配——字迹潦草、答题偏移、多页作业,这些让很多产品”失灵”的情况,蜜蜂AI声称都能处理。这一点对一线老师来说其实非常实际,因为真实的作业本从来不是标准整洁的。

网易有道的有道智云提供中英文作文批改API,OCR准确率达99.8%,底层是自研的”子曰”教育大模型,在语言理解方面有一定的技术积累。它的产品形态更偏向B端接入,适合学校或机构整合到自己的系统里使用。

作业帮AI辅导覆盖语文、数学、英语等9大学科,支持拍照、语音、文字多种输入方式,某小学使用后,老师批改时间从每天2小时缩短至30分钟。

奇墨科技主打主观题批改,这是目前行业里相对稀缺的能力。它采用豆包视觉理解模型加OCR的方案,能对作文的立意深度、结构完整性、语言表达流畅度进行量化打分,声称主观题批改准确率达92%。某教育集团上线后,整页批改准确率从75%提升至95%,主观题批改时间从15分钟每份缩短至3分钟。

整体来看,这个赛道的产品在基础层(错别字、语法、结构)的覆盖已经相当完整,真正的差距在深度层,尤其是阅读理解主观题的语义判断,以及对”非标准但有价值”的表达的识别。这两件事,是目前大多数产品还在努力突破的天花板。

我没有条件把每款产品都拿来系统测试,但作为一个改了十几年作文的语文老师,我想说说:如果我来评判一款AI批改产品,我会看什么。

这不是功能参数,而是真正决定它对课堂有没有实际价值的东西。

一条好的批改评语,应该能让学生知道”是哪一段哪一句有问题”,而不是泛泛地说”逻辑不够清晰”或者”语言表达有待提升”。如果AI给出的评语放在任何一篇作文上都成立,那这条评语就是没有价值的——它只是在制造一种”被批改了”的感觉,而不是在真正帮助学生。

检验方法很简单:把AI的评语遮住,换一篇完全不同的作文,看这条评语还适不适用。如果适用,说明它是模板;如果不适用,说明它是真正针对这篇文章写的。

语文阅读题的答案往往不是唯一的,”意思对即可”是语文老师最常用的判断标准。一款好的AI批改产品,应该能识别”表述不同但意思相近”的答案,而不是死板地对照参考答案判对错。

这是目前很多产品的明显短板。它们在处理客观题时表现很好,因为客观题有明确的对错;但一遇到开放性主观题,要么过于宽松——什么都给分,因为没有能力判断”这个意思对不对”;要么过于严格——只认标准答案的表述,学生换了个说法就扣分。这两种极端,对老师来说都意味着要花时间重新复核。

真正有弹性的语义判断,需要AI对语文阅读的理解不只停留在词汇层面,而是能理解”这道题在考什么、学生的回答触没触到那个核心”。这个能力,目前只有少数产品在认真做。

这一点很难量化,但一线老师能感受到。给小学生的评语和给初中生的评语,语气和措辞应该是不一样的;给一个写作基础很弱的学生和给一个有潜力的学生,侧重点也应该不同。基础弱的学生需要的是”你这里写错了,这样改”;有潜力的学生需要的是”你这里写得很好,但你知道为什么好吗,下一步可以往这个方向走”。

如果AI的评语没有对象感,只是在输出通用模板,老师还需要花时间重新改写评语,那这个工具就只解决了一半的问题——它减少了老师找问题的时间,但没有减少老师写评语的时间。

学生作文里有时候会出现一些”不标准”但很有意思的表达。”秋天的风闻起来有点像外婆家的味道。””我觉得月亮今天有点不开心。””他走路的样子像是在和地板商量什么事情。”这类句子按照语法和逻辑来评判,可能是”表达不够准确”的,但它们恰恰是孩子写作中最有生命力的部分。

一款真正好的AI批改工具,应该能识别这种表达并给予正向反馈,而不是把它当作”表述不规范”来扣分,或者给出”建议修改为更准确的表达”这样的建议。因为如果孩子按照AI的建议把这句话改”准确”了,他可能就再也不会写出这样的句子了。

这件事的本质是:语文教育的目标不只是让孩子写出”正确”的文章,而是让他们写出”属于自己”的文章。AI批改如果只懂得纠错,而不懂得保护,那它帮的忙里面可能藏着一些不小的伤害。

这四条标准,本质上都在指向同一件事:AI批改的质量,最终取决于它对”语文”的理解有多深,而不只是对”文字”的处理有多快。速度是基础,理解才是天花板。

回到开篇那个问题:AI能接手这每篇8分钟、乘以90篇的重量吗?

我的答案是:能接走大部分,但接不走最重要的那一小段。

那8分钟里,有大概5~6分钟是在做可以被替代的事——识别错别字、标点、语法问题,判断段落结构是否完整,给出基础的改进建议,整理错题数据,生成班级学情报告。这些事,AI做得比人快,也不会因为改到第67篇而疲惫,不会因为今天备课备得太晚而粗心漏掉一个问题。如果AI能把这5~6分钟接走,我就多出了时间去做剩下那2分钟里的事。

那2分钟是什么?是读到”秋天的风闻起来有点像外婆家的味道”,停下来,想了一会儿,然后在旁边写:”这句话我很喜欢,你是在哪里闻到这个味道的?下次试试把这个细节写进去。”

这10秒钟的停顿,这一句追问,是一个真实的人对另一个真实的人的回应。它告诉这个孩子:你写的东西有人在认真看,你的感受是值得被记住的,你这个奇怪的比喻是有价值的。这件事,算法暂时复制不了。不是因为技术不够强,而是因为这种回应本身需要一个”人”在场——一个有自己的阅读经验、有自己的情感记忆、能被一句话打动的人。

用AI把基础层的问题处理掉,把错别字、病句、结构问题整理成清单,让我在拿到作文本的时候,不需要再花时间在那些重复的事情上。我用省出来的时间,专门去看那些”意思到位但表达有点奇怪”的句子,去回应那些”写得很好但没人告诉他”的孩子,去认真想一想这个班这周在写作上整体出现了什么问题,下节课应该怎么讲。

这是当下最务实的人机协同方式,也是教育部在2025年发布的《中小学生成式人工智能使用指南》里说的那句话的意思——”在技术初步批阅的基础上,重点聚焦学生思维水平、创意表达等高阶能力,开展深度点评与指导,实现人机协同反馈。”政策层面已经给出了方向,不是让AI替代老师,而是让AI和老师各司其职。

当然,这件事能不能真正落地,还取决于产品本身做得够不够好。基础层的事情AI已经做得不错了,但深度层——尤其是阅读理解主观题的语义判断、对个性化表达的识别和保护——仍然是这个赛道需要继续突破的地方。这不只是技术问题,也是产品团队对”语文教育到底在培养什么”这个问题的理解深度问题。

我期待这件事能继续往前走。不是因为我想偷懒,而是因为如果有一天,AI能把那12个小时里大部分的重复劳动真正接走,我就能把更多的时间用来做那件我一直想做却没时间做的事: