飞书官方openclaw插件“踩坑”指南

大家好,我是 Amber,一个喜欢分享 AI 相关技术和资讯的前行者,今天我们来聊一聊飞书 OpenClaw 官方插件 —— 这个能解决小龙虾响应慢、飞书操作交互体验差的实用工具。

大部分人使用小龙虾应该都是通过飞书进行沟通交流的,因为飞书的开放性好,没有那么多限制,还能支持文档操作。但使用openclaw原生飞书插件进行沟通的时候有遇到些体验性的问题:比如每次问点需要查飞书文档、核对日历的问题,它要么自己尝试半天没反应,要么直接说没权限要我复制粘贴内容,干等着它“敲键盘”的过程里我连它到底在处理啥、会不会出结果都不知道,体验感差到极致。我寻思着这事儿肯定有解决办法,总不能一直这么低效,就去翻飞书的官方文档和技术社区,结果还真发现了飞书刚推出的 OpenClaw 官方插件,据说能支持流式输出,正好能解决我干等的问题。

但说实话,我本来以为装个插件就是点几下的事儿,结果实操下来踩了一堆坑,从网关挂掉到服务器卡死,折腾了大半天才算搞定。我想把这些踩坑经验和完整的操作流程分享出来,毕竟不是所有人都有时间去后台排查问题,希望能帮到和我一样被小龙虾交互体验折磨的朋友。

一、飞书 OpenClaw 官方插件是什么?

从技术角度来看,飞书 OpenClaw 官方插件是 2026 年飞书基于 OpenClaw 框架推出的官方插件(最新版本 2026.3.17),它通过打通飞书开放平台接口,让 AI 助手(小龙虾)能以用户身份直接访问飞书的消息、文档、多维表格、日历、任务等核心能力,同时新增流式输出卡片回复、识别合并转发消息、发表情等交互优化特性,解决了传统 AI 助手与飞书交互时权限不足、响应反馈不及时的问题,提升了 AI 助手在飞书生态内的交互效率和体验。

用大白话解释就是:以前小龙虾在飞书里干活,得靠你手动给它传文档、发消息内容,还得等它一次性出结果,干等的时候啥都不知道;现在装了这个官方插件,相当于给小龙虾开了 “飞书专属权限”,它能自己去翻你的飞书文档、查日历、看群聊记录,而且回复的时候是 “边想边说”(流式输出),你能实时看到进度,不用再傻等半天。

这个插件的推出,直接改变了 AI 助手在飞书生态里的使用模式 —— 从 “被动接收信息” 变成 “主动获取信息”,交互体验从 “盲等” 变成 “实时反馈”,不管是个人用它处理工作,还是团队用它协作,效率都能提一大截。

一图看懂核心差异总表

|

|

|

|

| 核心定位与开发主体 |

|

|

| 身份与权限核心优势 |

|

|

| 飞书生态专属能力 |

|

|

| 通用原生执行能力 |

|

|

| 交互与使用体验 |

|

|

| 安全与权限管控 |

|

|

| 部署与使用门槛 |

|

|

| 维护与生态支持 |

|

|

| 适用人群与场景 |

|

|

二、我安装 OpenClaw 飞书插件的踩坑实操

发现这个插件能解决我的痛点后,我立马动手尝试安装,本以为是 “一键搞定”,结果踩了 4 个大坑,一步步跟大家说:

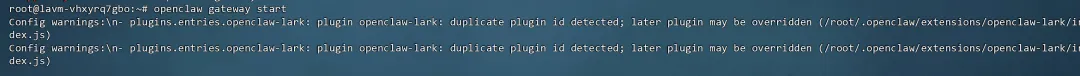

坑 1:让小龙虾自动安装,结果网关挂了

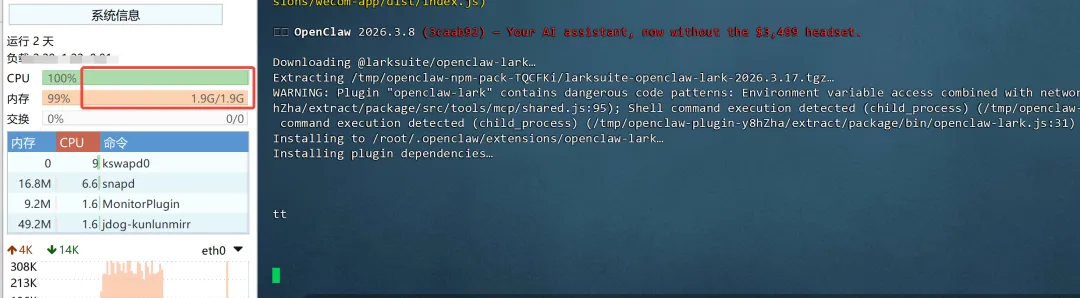

我最开始图省事,直接让小龙虾自己去读飞书官方的安装文档,然后自动执行安装步骤。结果刚运行没多久,小龙虾就掉线没反应了。

我赶紧登到服务器后台看,发现网关进程直接挂掉了,重启网关后还是没用 —— 飞书里完全没法和小龙虾沟通,大概率是小龙虾自动执行安装指令时出错,把自身进程搞崩了。

这一步我总结出:别让 AI 完全自主执行安装类操作,尤其是涉及系统进程的,手动操作更稳妥。

坑 2:手动 SSH 安装,服务器 CPU / 内存占满卡死

网关恢复后,我放弃让小龙虾自动装,自己通过 SSH 登到服务器手动安装,执行官方给的安装命令:

shell

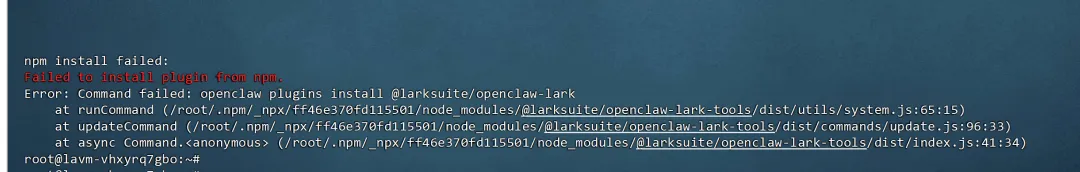

npx -y @larksuite/openclaw-lark install结果安装过程中,服务器直接卡死了 —— 我查监控发现 CPU 和内存都被占满了。我没敢贸然重启(怕丢配置),硬等了半个小时,服务器才恢复正常,但插件安装界面报了一堆错,显然没装成功。

后来我才知道,这是因为安装过程中插件会拉取大量依赖包,我的服务器配置不算高,一次性拉取导致资源耗尽,大家如果服务器配置一般,安装前可以先关掉其他非必要进程。

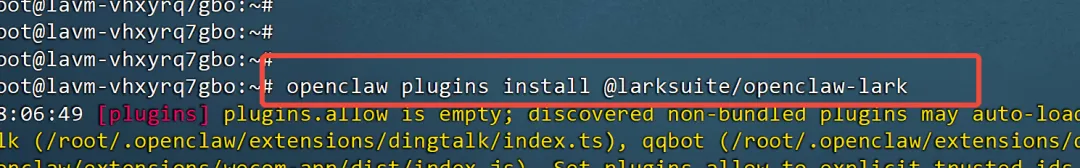

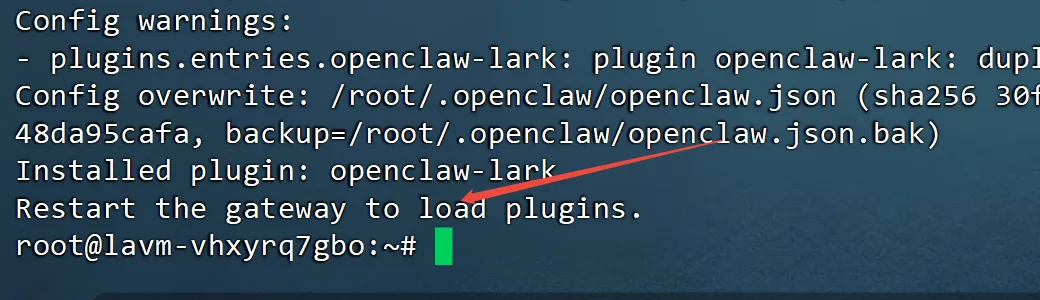

因为cpu、内存占满所以安装失败了,需要手动执行安装。

shell

openclaw plugins install @larksuite/openclaw-lark

正常加载飞书官方插件启动

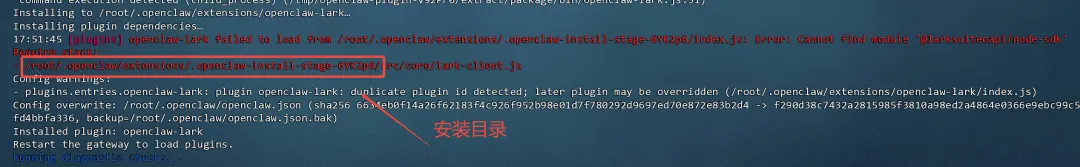

坑 3:安装成功后,报 “cannot find module xxx” 缺失 SDK

好不容易把安装流程走完,我在飞书里触发小龙虾指令时,又弹出了 “cannot find module xxx” 的报错。

查了官方文档才明白,是安装过程被中断,导致部分依赖包没装全。解决办法也简单:找到插件的安装目录,手动执行依赖安装:

shell

cd 插件安装目录npm install

执行完这步,SDK 缺失的报错就消失了。

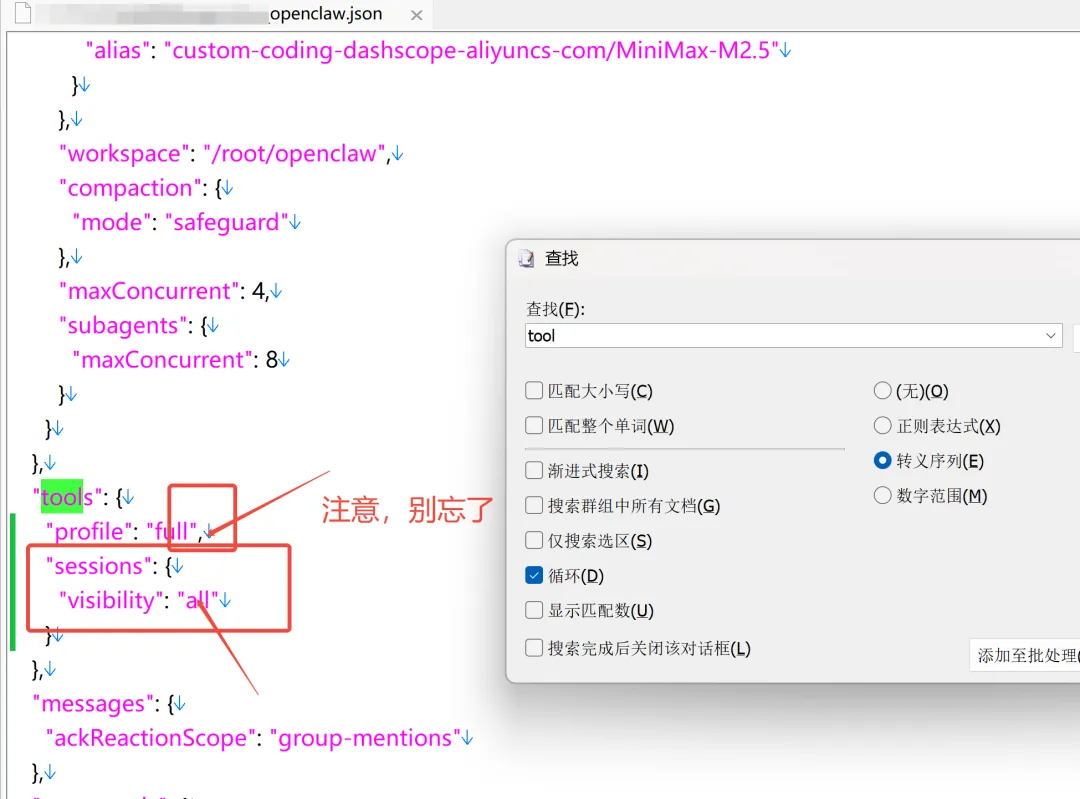

坑 4:插件能运行,但调用工具无响应 —— 缺失 Agent 工具权限

本以为终于搞定了,结果发现小龙虾还是没法读取飞书文档,也没法流式输出。我去翻 OpenClaw 的配置文件,才发现 OpenClaw 3.2 版本默认把新 Agent 的工具权限关掉了。

需要修改openclaw.json配置文件,把工具权限打开:

json

{"tools": {"profile": "full","sessions": {"visibility": "all"}}}

改完配置重启插件,小龙虾终于能正常调用飞书的各项能力,流式输出也生效了。

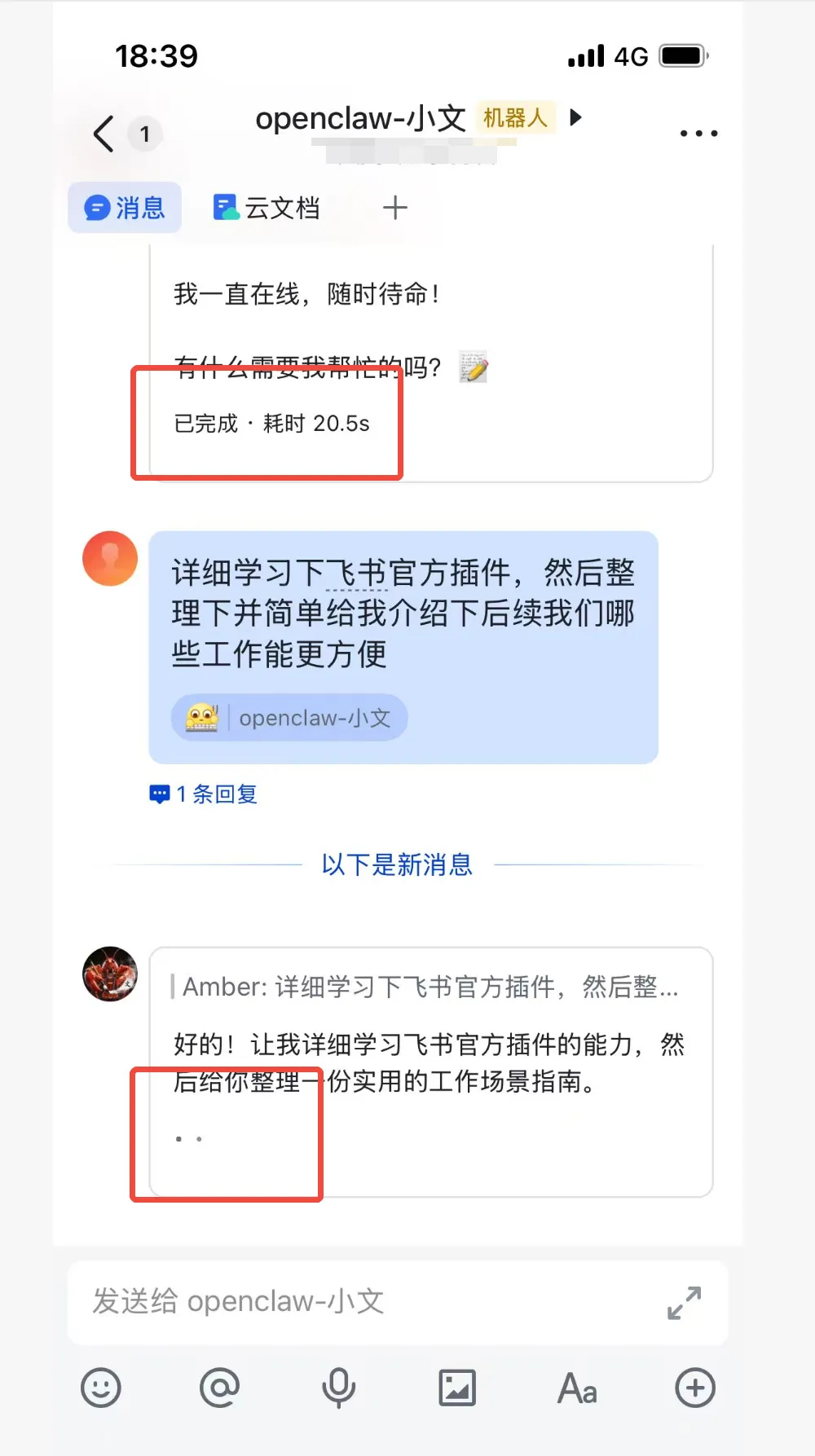

三、实践后的感受与思考

折腾了大半天,终于把插件装好并正常使用,我的第一感受是:好用的工具,但落地过程总有坑,不过解决后带来的体验提升是真的香。

首先,流式输出彻底解决了我最头疼的 “盲等” 问题 —— 现在和小龙虾沟通,它会实时输出回复内容,我能看到它的思考和处理进度,哪怕处理复杂问题需要一点时间,也不会像之前那样焦虑,知道它在 “干活” 而不是 “卡死”。

其次,插件赋予小龙虾的飞书全权限,让我彻底摆脱了 “复制粘贴” 的重复劳动:以前让它整理群聊纪要,我得把群聊内容一条条复制给它;现在它能自己读群聊历史,我只需要说一句 “整理下这个群今天的核心讨论内容”,几分钟就出结果,还能直接生成飞书文档,效率至少提了 3 倍。

但同时我也有个思考:这类打通办公生态的 AI 插件,体验确实好,但对非技术人员来说门槛还是有点高。我能通过 SSH 登服务器、改配置文件解决问题,可身边很多同事连 “依赖包安装” 都听不懂,遇到我这些坑大概率只能放弃。飞书和 OpenClaw 的生态在完善,但 “易用性” 这块还有提升空间,希望后续能出更傻瓜化的安装方式,让更多人能享受到技术带来的便利。

另外,使用过程中我也注意到官方提示的安全风险 —— 插件会以我的身份访问飞书数据,虽然有安全防护,但还是得谨慎:重要操作一定要 “先预览,再确认”,比如让小龙虾代发消息,别让它完全脱离人工干预,毕竟 AI 偶尔会有 “幻觉”,避免出不可逆的错误。

四、飞书官方 OpenClaw 插件完整操作流程

结合我的踩坑经验和飞书官方的安装指南https://www.feishu.cn/content/article/7613711414611463386,整理出一套能少走弯路的完整操作流程,大家可以照着来:

步骤 1:安装并配置基础版 OpenClaw

1.按系统执行安装命令:

•Linux/MacOS:curl -fsSL https://openclaw.ai/install.sh | bash•Windows:iwr -useb https://openclaw.ai/install.ps1 | iex

步骤 2:安装飞书官方插件

1.终端执行安装指令(出错可加 sudo):

shell

npx -y @larksuite/openclaw-lark install步骤 3:完成用户授权与插件学习

1.飞书对话里发送/feishu auth完成批量授权(让插件能访问你的飞书数据);2.发送学习一下我安装的新飞书插件,列出有哪些能力,让小龙虾掌握插件功能;3.发送/feishu start验证,返回版本号即插件安装成功。

步骤 4:配置流式输出(核心解决响应慢体验差)

执行以下命令开启流式输出:

shell

openclaw config set channels.feishu.streaming true# 可选:开启流式卡片的耗时和状态展示openclaw config set channels.feishu.footer.elapsed trueopenclaw config set channels.feishu.footer.status true

步骤 5:修复版本 / 权限问题(避坑关键)

1.检查 OpenClaw 版本:Linux/MacOS 需 2026.2.26+,Windows 需 2026.3.2+,版本低则执行npm install -g openclaw升级;2.若调用工具无响应,修改openclaw.json开启 Agent 工具权限(参考第二部分坑 4 的配置);3.安装后报错缺失依赖,进入插件目录执行npm install补全依赖。

步骤 6:验证最终效果

在飞书里给小龙虾发需要访问飞书数据的指令(比如 “查下我明天的日历日程”),能看到流式输出的回复,且内容准确,即所有配置生效。

高级配置指令

切换到流式输出

•切换到流式输出:

openclaw config set channels.feishu.streaming trueopenclaw config set channels.feishu.streaming falseopenclaw config set channels.feishu.footer.elapsed true # 开启耗时openclaw config set channels.feishu.footer.status true # 开启状态展示

设置多任务并行及独立上下文

机器人可在话题群/消息群话题模式中,针对每个话题拥有独立上下文以及多任务并行。

•开启:

openclaw config set channels.feishu.threadSession trueopenclaw config set channels.feishu.threadSession false修改飞书机器人在群内的回复方式

模式 1:仅响应应用所有者@机器人的消息(推荐)

{"channels": {"feishu": {"enabled": true,"appId": "cli_你的 AppID","appSecret": "你的 AppSecret","requireMention": true,"groupPolicy": "allowlist","groupAllowFrom": ["ou_XXXX"],"groups": { "*": { enabled: true } }}}}

模式 2:只有@机器人才回复,可响应群内任何人发送的消息

# 设置需要 @ 才回复openclaw config set channels.feishu.requireMention true --json# 重启生效sh /workspace/projects/scripts/restart.sh

完整配置示例:

{"channels": {"feishu": {"enabled": true,"appId": "cli_你的 AppID","appSecret": "你的 AppSecret","requireMention": true,"groupPolicy": "open"}}}模式 3:不用@,所有消息都回复

⚠️ 注意:这个模式在大群里容易刷屏,谨慎使用!

需要额外在开发者后台申请应用身份权限:获取群组中所有消息(敏感权限)im:message.group_msg。

# 设置不需要 @ 也回复openclaw config set channels.feishu.requireMention false --json# 重启生效sh /workspace/projects/scripts/restart.sh

完整配置示例:

{"channels": {"feishu": {"enabled": true,"appId": "cli_你的 AppID","appSecret": "你的 AppSecret","requireMention": false,"groupPolicy": "open"}}}模式 4:只有指定群@机器人才回复(高级)

第一步:获取群 ID

•让机器人加入群后,发送任意消息,然后在日志里找群 ID•或通过飞书群设置页面查看群 ID

第二步:配置特定群规则

# 先设置默认所有群都不需要 @openclaw config set channels.feishu.requireMention open --json# 然后给特定群设置需要 @(替换成真实的群 ID)openclaw config set channels.feishu.groups.oc_xxxxxxxx.requireMention true --json# 重启生效sh /workspace/projects/scripts/restart.sh

完整配置示例:

{"channels": {"feishu": {"enabled": true,"appId": "cli_你的 AppID","appSecret": "你的 AppSecret","requireMention": "open","groupPolicy": "open","groups": {"oc_532044075a61d112f04fa63109c75e9b": {"requireMention": true}}}}}常用诊断命令与问题修复方法

可以在与 OpenClaw 的对话中发送以下命令:

•/feishu start:确认是否安装成功•/feishu doctor:检查配置是否正常•/feishu auth:批量完成用户授权

插件中也内置了常见问题的解决方案,遇到问题都可以先问问小龙虾。如果不行,则运行以下指令查看问题,并自主修复:

npx @larksuite/openclaw-lark doctor运行 fix 尝试自动修复:

npx @larksuite/openclaw-lark doctor --fix如果仍然无法修复,可在反馈群里反馈信息。

•运行 info 查看版本信息,反馈问题时带上辅助排查:

npx @larksuite/openclaw-lark info --all 查看详细配置信息:

npx @larksuite/openclaw-lark info --all结尾

折腾这么久,终于把飞书 OpenClaw 插件用顺了,现在和小龙虾交互再也不用干等,效率提上来的同时,也少了很多烦躁。其实好的 AI 工具从来都不是 “一键即用”,但只要耐点心踩完坑,就能实实在在感受到它给工作带来的改变。

如果你也被小龙虾的交互体验困扰,不妨试试这个插件,希望我的踩坑经验能帮你少走弯路。觉得这篇内容有用的话,别忘了点赞、转发给身边需要的朋友,也欢迎在评论区聊聊你用 AI 工具踩过的坑,关注我,后续还会分享更多 AI 工具的实操干货~

夜雨聆风

夜雨聆风