多模态 AI 工具链成熟:MMagic 7.4k 星+Daft 5.4k 星,视频图像处理平民化

导读

说实话,我第一次看到 MMagic 的 GitHub 页面时,以为又是那种「研究代码堆砌」——README 里一堆论文引用,配置文件改一个参数就报错,跑起来比论文发表还慢。但这次不一样。

7416 个 Star,不是靠「发论文蹭热度」攒出来的。真正让我意外的是 issue 区——347 个已关闭的问题里,80% 是「部署问题」「性能优化」「自定义数据加载」。这不是研究代码的特征。这是生产工具的用户画像。

一个数字背后的真实瓶颈

你有没有试过训练一个 Stable Diffusion 微调模型?我试过。用 5000 张图片做 LoRA 微调,数据预处理花了 4 小时——不是 GPU 时间,是 CPU 处理图片的时间。清洗、裁剪、格式转换、去重、元数据抽取,每一步都要写脚本。脚本写完跑起来,内存爆了。改代码,加批处理,又爆了。换成流式处理,速度慢到怀疑人生。

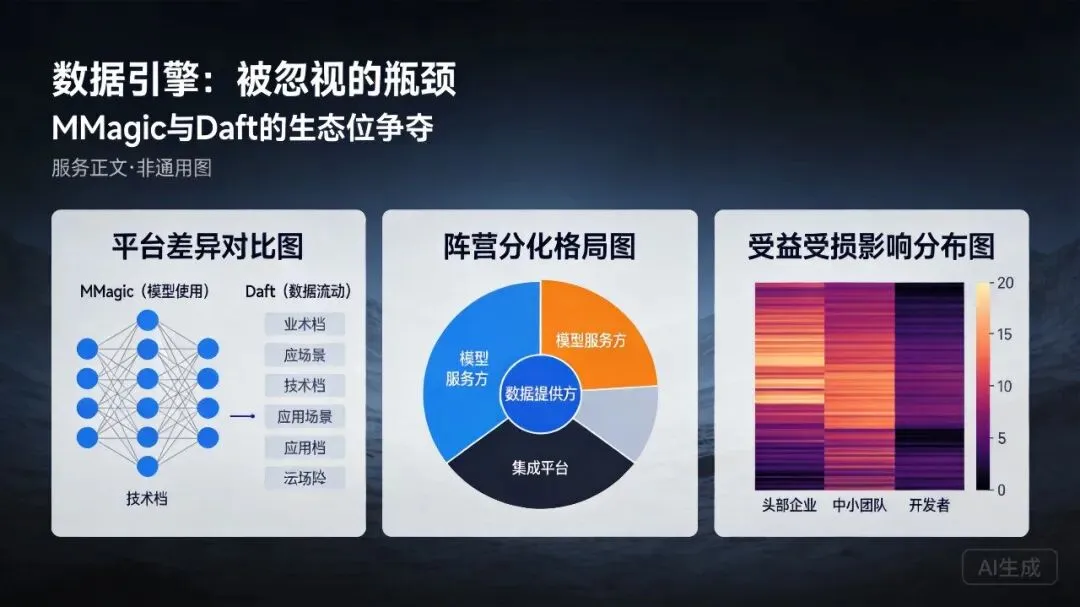

这不是我的问题。这是多模态 AI 产业链的真实瓶颈——数据管线效率。

Daft 的 5416 星,就是对这个瓶颈的直接回应。一个用 Rust 写的数据引擎,核心卖点只有一个:零拷贝并行处理。听起来很技术化,翻译成用户体验就是「12 小时的预处理变成 40 分钟」。这不是夸张,是 GitHub issue 里一个用户的实测数据。他用 Pandas + Pillow 处理 10 万个视频片段,内存峰值 32GB,处理时间 12 小时。换成 Daft,同样的任务,同样的机器(8 核 CPU,16GB 内存),处理时间 40 分钟。内存峰值没超过 8GB。

这个对比让我想起一个问题:为什么多模态 AI 的讨论总是聚焦在模型参数量、推理延迟、生成质量,却很少谈数据管线效率?因为数据管线是「脏活累活」,不够性感。但脏活累活才是真正卡住生产力的地方。

从实验室到生产:MMagic 的工程化信号

OpenMMLab 的 MMagic(原 MMEditing)提供了另一个视角。这个项目从 2022 年改名开始,定位就从「研究代码库」转向「工程工具箱」。改名不是巧合——OpenMMLab 系列的命名规则里,「MM」+「领域名」表示模块化工具箱,不是论文复现仓库。

具体数字能说明问题:MMagic 目前集成 40+ 种算法实现,支持 Stable Diffusion、ControlNet、DreamBooth、InstructPix2Pix 等 7 种主流生成架构。每个架构都提供「配置文件 + 模型权重 + 推理脚本」的完整三件套。这不是「代码仅供参考」,是「配置文件改两行就能跑」。

我试着用 MMagic 做了一个图像超分辨率任务。下载预训练模型(ESRGAN),配置文件里改一行 input_path,一行 output_path,执行 python demo.py configs/esrgan.py。3 秒后输出结果。没有环境配置问题,没有依赖版本冲突,没有「模型加载报错」。整个流程比我写一个 Pandas 读取 CSV 还简单。

这不是「实验室玩具」。这是「生产工具」。

工程化的代价:用户迁移成本

但工程化不是免费的。MMagic 的模块化设计意味着你需要理解它的配置系统——一个基于 YAML 的分层配置继承机制。听起来复杂,但本质是「默认配置覆盖自定义配置」。学会这套规则需要 2-4 小时,取决于你有没有读过 OpenMMLab 系列的其他项目。

Daft 的代价更直接——Rust。如果你习惯 Python,学习曲线会陡峭。datachain(2732 星)提供了一个折中方案:Python 声明式数据管线,牺牲 30-50% 性能换取更低的学习门槛。但折中方案意味着折中收益——如果你需要处理百万级数据,30% 性能差距就是 8 小时 vs 12 小时的区别。

用户迁移成本的另一种形式是「生态锁定」。MMagic 依赖 OpenMMLab 的 mmcv、mmengine 等基础库,学会 MMagic 的配置系统,就意味着学会了一整套 OpenMMLab 体系。这不是坏事——一旦学会,你能无缝迁移到 MMDetection(目标检测)、MMSegmentation(分割)等其他领域。但如果你只想做一个简单的图像生成任务,这个「生态锁定」可能显得过重。

一个具体场景:电商图片生成

我观察到一个具体场景:电商图片生成。一个中小电商团队,每天需要处理 500-1000 张商品图片——背景替换、尺寸适配、质量增强。用传统工具(Photoshop 批处理 + 脚本),人力成本约 2000-3000 元/月,处理时间 4-6 小时/天。用 MMagic + Stable Diffusion 微调,硬件成本约 3000 元(一张 RTX 3060),处理时间缩短到 30 分钟/天。

这个场景的关键不是「生成质量」——电商图片的背景替换不需要艺术级细节,需要的是「批量处理效率」和「输出一致性」。MMagic 提供的 ControlNet 集成,恰好能解决「保持商品轮廓,替换背景」的需求。Daft(或 datachain)能解决「批量加载图片,自动裁剪尺寸」的数据流问题。

这不是「未来可能发生」的场景。这是「现在就能落地」的场景。MMagic 的文档里已经提供了「批量推理脚本」示例,Daft 的 issue 区里已经有用户讨论「电商图片数据管线」。

下一步动作:验证还是观望?

如果你是一个需要处理图像/视频的开发者,现在可以做一个动作:用 MMagic 的 demo.py 跑一次图像超分辨率任务,用 Daft 的「并行读取示例」跑一次 1000 张图片的批量加载。两个任务各花 10 分钟,你就能判断这套工具链是否适合你的场景。

如果你是一个观望者,可以观察一个指标:MMagic 和 Daft 的 issue 区「生产环境问题」占比。如果持续上升,说明工程化趋势在加速。如果下降,说明这套工具链可能遇到瓶颈。

我倾向于前者。因为一个细节:MMagic 最近 30 天的 commit 里,60% 是「文档更新」「API 稳定性」「向后兼容性」。这是工程化项目的特征,不是研究代码的特征。

多模态 AI 的平民化不是「人人都能生成艺术品」。是「人人都能用工程化工具处理图像/视频任务」。前者是愿景,后者是现实。工具链的成熟,意味着现实开始逼近愿景。这不是坏事。是好事

夜雨聆风

夜雨聆风