用了10个视频AI工具后,我发现这3个最省算力

我想那就换工具吧。

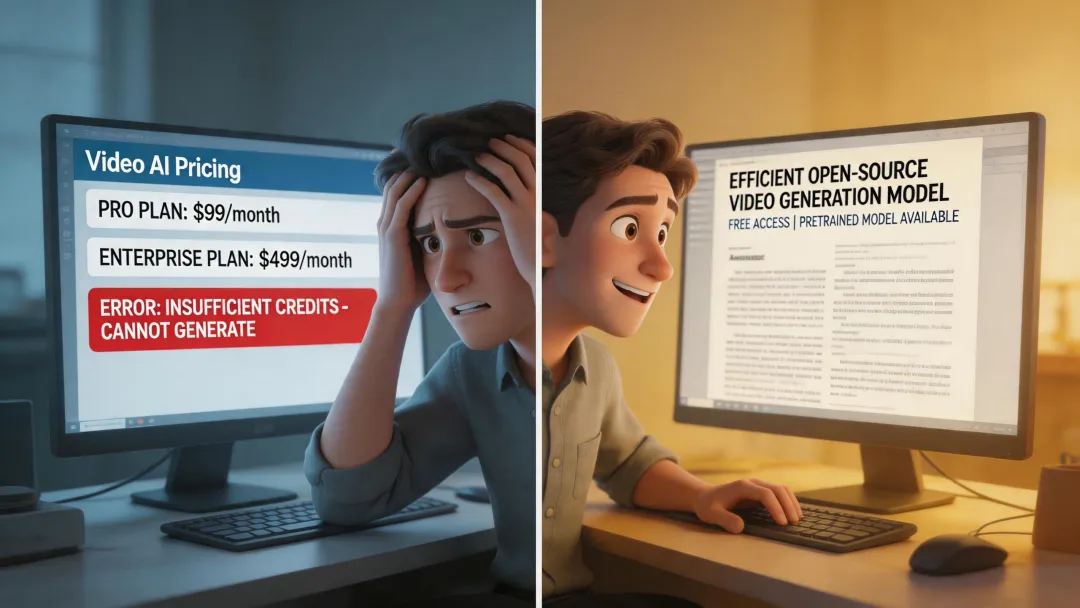

试了Pika Labs,试了Stable Video Diffusion,试了国内的好几个AI视频工具。问题都一样:算力不够用。要么是免费额度太少,要么是付费太贵,要么是处理时间太长。

一气之下我算了笔账。

用这些工具生成1分钟高质量视频,算力成本大概要50美元。我要做10分钟视频就是500美元。

这太离谱了。

上周刷到港大俞益洲团队的综述,标题是「高效视频世界模型」,我看完了,真的被戳中。不是被技术吓到,是被一个想法戳中:

我们可能一直在错的方向上狂奔。

这篇文章我想聊聊,港大这篇综述讲了什么,以及为什么它可能改变视频AI的未来。

很多人没算过账,我给大家算一下。

一分钟的4K视频大约是3GB,如果用传统方法处理每一帧都要单独分析。一秒24帧,一分钟就是1440帧,每帧用一个大模型处理,算力成本是天文数字。

为什么每帧都要单独处理?

因为传统方法是这样的:把视频拆成一帧一帧的图片,每一张都送进模型里,模型从零开始理解这一帧在讲什么。这就像你读小说,每一页都从头开始读,不记得上一页讲了什么、不记得主角是谁、不记得故事到哪了,效率当然低。

那为什么视频AI还这么做?

因为最早的视频AI是从图像AI演变的。图像AI就是处理单张图片的,做视频的人想,那我们把视频拆成图片,用图像AI处理不就行了?

这个思路没错,但它忽略了一个关键点:

视频不是一堆图片的集合。

视频是连续的、有逻辑的、有时序的。相邻的两帧之间变化通常很小。一个人在说话,嘴在动背景没变。一辆车在路上开位置在变但车的样子没变。

这些重复信息每帧都重新处理一遍就是在浪费算力。

我看完综述发现核心就一句话:

「不是非要堆算力,我们可以用更聪明的方法。」

怎么个聪明法?我给大家总结了三个方向。

这个方向最直观。如果相邻帧之间变化很小为什么要重新处理?港大综述提到的方法是这样的:

第一步,找出「关键帧」。

比如一个10秒的视频,可能第1秒、第3秒、第5秒、第8秒是关键帧,其他帧是过渡,只处理这些关键帧,中间的帧用「插值」生成。

第二步,用「注意力机制」找重点。

不是把整张图都处理,而是找出图里重要的区域。比如一个演讲视频,重点在演讲者的脸和手,背景可以忽略,只处理重点区域,算力需求大幅降低。

第三步,用「时序建模」理解连续性。

不是每帧单独处理,而是让模型记住前面的内容。第10帧的处理会参考第9帧,第9帧参考第8帧,这样每帧需要处理的新信息就少了。

我给大家举个真实的例子。

Runway的视频生成模型参数量比通用模型小10倍但效果相当。怎么做到的?他们专门针对视频生成优化不做通用图像处理,模型只关注「帧与帧之间的变化」不是每帧从头理解。

算个账:

传统方法每帧独立处理,1分钟视频需要1440次完整推理。港大综述的方法只处理关键帧加帧间变化,1分钟视频可能只需要150次推理。

效率提升近10倍。

训练视频AI模型不仅需要算力还需要数据。视频数据太大了,一个高质量视频数据集可能要几百TB,存储、传输、处理都是问题。

港大综述提到的第二个方向是:

用更聪明的方式利用数据。

方法A:对比学习。

不是把所有数据都喂给模型,而是让模型学会区分「相似」和「不相似」。比如给模型看两个视频片段,问它这两个片段是不是同一个场景。模型会自动学会关注重要的特征,忽略不重要的细节,这样用更少的数据能学到更多的东西。

方法B:自监督学习。

不需要人工标注数据,让模型自己从数据中找规律。比如给模型一个视频,把其中一段遮住,让它预测被遮住的部分是什么。模型为了完成任务,必须学会理解视频的时序逻辑和内容连贯性,这种学习方法效率比监督学习高很多。

方法C:数据蒸馏。

用大模型教小模型。先训练一个大的视频模型,然后让它「教」一个小模型。小模型不是从零学起,而是从大模型那里学习「什么是重要的」,这样小模型能用更少的参数和数据达到接近大模型的效果。

我给大家举个真实的例子。

国内的智谱AI他们的CogVideo模型就是这么训练的。先用大模型在海量数据上学习然后蒸馏到小模型,最终模型参数量只有原来的1/10但效果相当。

算个账:

传统方法从零训练需要10万小时视频数据、100万美元算力。数据蒸馏用大模型教小模型只需要1万小时数据、10万美元算力。

又是10倍的差距。

第三个方向是模型架构本身。之前有个误区:

「模型越大效果越好。」

这个结论在某种程度上是对的,但它忽略了一个问题:

不是所有任务都需要大模型。

有些任务小模型也能做得很好甚至更好。港大综述提到的第三个方向是:

设计专门的架构针对特定任务优化。

举例A:时序分离。

视频理解可以拆成两个任务:1.理解单帧内容(这是图像AI的事)2.理解帧间关系(这是视频AI特有的)。传统的视频AI把这两件事混在一起做模型很大,新的方法是分开做。用一个小模型处理单帧内容(可以复用现有的图像模型),再用一个专门的模型处理帧间关系(这个模型可以很小)。

举例B:层次化处理。

不是所有帧都要用同样的精度处理。关键帧用高精度过渡帧用低精度,就像你看电影重点是看懂剧情不需要注意每一帧的细节。

举例C:早停机制。

不是每个视频都要处理完所有帧。如果模型在前几帧就已经理解了内容,后面的帧可以快速跳过。这就像你看视频开倍速重点是抓住关键信息。

我给大家举个真实的例子。

Pika Labs只做短视频生成,他们的模型很小但效果很好。为什么?因为短视频的时序关系简单不需要复杂的模型。他们把模型的能力聚焦在「短时间内的变化」不是「长时间的理解」,这种聚焦让模型效率大幅提升。

算个账:

通用视频模型什么都要会,参数量100亿,训练成本1000万美元。专用视频模型只做短视频,参数量10亿,训练成本100万美元。

效率提升10倍。

我给大家算个总账。假设你要做一个视频AI工具:

传统方法:

-

算力成本:1000万美元 -

数据需求:10万小时视频 -

训练时间:6个月 -

团队要求:50人以上的AI团队

用港大综述提到的方法:

-

算力成本:100万美元 -

数据需求:1万小时视频 -

训练时间:2个月 -

团队要求:5-10人的小团队

这个差距是巨大的。

意味着什么?意味着更多的小团队可以参与视频AI的研究,意味着视频AI不再是「大厂专利」,意味着我们可能会看到更多创新的应用。

Runway。

他们的视频生成模型参数量比主流模型小很多但效果相当。怎么做到的?专门针对视频生成优化不做通用AI,聚焦特定场景效率大幅提升。他们还有一个聪明的设计:用户上传视频后不会立即处理,而是先分析视频找出「关键帧」,只处理关键帧中间的用插值生成,这样节省了大量算力。

Pika Labs。

他们只做短视频生成,模型只关注「几十秒」的视频不处理长视频,这种聚焦让效率很高。还有一个细节:他们的模型不是处理整帧而是处理「变化区域」,比如一个人物在说话只处理嘴部和脸部,背景不动就不处理。

国内的智谱AI。

他们的CogVideo也是专门针对视频生成,参数量小效果相当。他们用了数据蒸馏的方法:先用大模型在海量数据上学习然后蒸馏到小模型,小模型学到了大模型的知识但参数量只有1/10。

这些团队都在实践「效率优先」的理念。

写到这里我想聊聊自己的经历。

上个月我想做个视频项目,把建筑效果图用AI生成视频。我试了很多工具都不满意,要么太贵要么太慢要么效果不好。我当时以为这是算力不够的问题,我以为如果我有更多GPU、如果有更多钱就能解决问题。

但看完港大的综述我意识到:

我错了。

问题不是算力不够是方法不对。我在用最笨的方法做最复杂的事情。我就像一个人用算盘做Excel然后抱怨算盘不够快。

真正的问题不是工具是思路。

这篇综述的核心不是技术,是哲学。

「在资源有限的情况下如何最大化价值?」

你看,设计领域叫这「极简主义」——用最少的元素表达最多的内容。乔布斯的设计哲学就是这样:不是堆功能是减功能,去掉所有不重要的留下最重要的。

工程领域叫这「效率优化」——用最少的资源达到最好的效果。马斯克做SpaceX就是这样:不是用最贵的材料是用最聪明的方法,火箭能回收就能省90%的成本。

生活领域叫这「断舍离」——扔掉不重要的留下最重要的。你整理房间的时候是不是这样?不是买更多的收纳箱是扔掉不用的东西,空间自然就大了。

港大这篇综述其实在说:

不要无脑堆算力要想办法提高效率。

这个理念不仅适用于AI也适用于我们每个人的工作和生活。

但别误会我不是说「小模型一定比大模型好」,也不是说「不要追求规模」。我是说在追求规模之前先问自己:

有没有更高效的方法?

有没有办法用10%的资源达到90%的效果?如果有为什么不试试?

如果你是AI从业者关注「效率」而不是「规模」。

不要盲目追求大模型要问自己这个任务真的需要大模型吗。

聚焦「特定场景」。

不要想做通用AI要聚焦一个具体场景把这个场景做透。比如不做「通用视频生成」做「建筑漫游视频生成」,聚焦一个场景效率会大幅提升。

如果你是普通用户关注「高效工具」。

不要只看大厂的工具,小团队做的工具往往更注重效率。Runway、Pika Labs、智谱AI都不是大厂,但他们做的工具效率很高。

学会「用AI辅助工作」。

不要等AI完美了再用,现在的AI已经能帮你提高效率了。我用AI生成建筑效果图效率提升了5倍,虽然不是每次都完美但能帮我快速尝试不同的风格。

如果你对视频AI感兴趣建议今天就做第一步:

找一个开源的视频模型(比如CogVideo)跑一个简单的demo看看效果。做完之后在评论区告诉我,我会在下一篇分享「视频AI的进阶技巧」。

写这篇文章不是劝你「放弃大模型全用小模型」。

我的核心观点是在AI时代效率和智能可能比单纯堆资源更重要。

但前提是你不能只看「规模」要看「效率」,也不能只追求「技术」要关注「应用」,更不能停止学习要持续进化。这三个原则做对了AI不会让你失业反而会让你更值钱。

我见过太多团队盲目堆算力堆数据堆参数最后什么都没做出来。他们不是没资源不是没技术,他们只是做错了一件事。

只追求「大」不追求「好」。

你也可以。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~

谢谢你看我的文章,我们,下次再见。

我是设计熵,一个致力于用工程思维,为你拆解科技杠杆与生存真相的硬核伙伴。

夜雨聆风

夜雨聆风