AI让人类更快乐,还是更痛苦?

今天参加一个活动,关于大模型语言和生活形式,浙大哲学教授和大家一起互动,其中有一个很有意思的话题,AI让人类更快乐,还是更痛苦?

哲学教授说AI让人类更痛苦,而走在人工智能最前沿的业内从业者说AI让人类更快乐。

突然很好奇,把这个问题扔给了几个AI,看看它们怎么说吧?

问:问一个哲学问题,终极情况下,AI让人类更快乐,还是让人类更痛苦?

GPT:

这个问题如果硬要一句话回答:AI既不会本质上让人更快乐,也不会注定让人更痛苦,它更像一个“放大器”——把人类原本的结构放大。

但这句话其实不够用,我们可以从几个更“终极”的层面拆开来看。

1. 从“快乐是什么”来看

如果你把快乐理解为感官满足,那AI大概率会增加快乐:

它可以提供更精准的娱乐、更低成本的享受、更少的生存压力。

但如果你把快乐理解为更深层的东西,比如:

-

意义感

-

自我实现

-

与他人的真实连接

那情况就复杂了。

AI会削弱一部分传统意义来源,比如:

-

工作带来的价值感

-

技能稀缺带来的自尊

-

努力→回报的线性关系

换句话说:它可能让“好过”更容易,但让“活得有意义”更困难。

2. 从“痛苦的来源”来看

人类的痛苦,核心不是物质匮乏,而是三件事:

-

比较(我和别人谁更好)

-

不确定性(未来不可控)

-

无意义感(我为什么活着)

AI对这三点的影响是分裂的:

-

比较:会更严重(能力差距可能被拉大)

-

不确定性:短期更高(岗位、规则变化)

-

无意义感:显著上升(“我还能替代什么?”)

所以在过渡期,你会看到更多焦虑、迷茫、甚至空心化。

3. 从历史视角看(关键)

每一次技术跃迁——农业、工业、互联网——都带来同样的争论。

结果很有意思:

-

平均生活质量上升了(更“舒适”)

-

但主观幸福感没有线性上升

也就是说,人类会“适应”技术,但不会自动变幸福。

4. 真正的分水岭在哪里

关键不在AI,而在一个更底层的问题:

人类是否还能为自己“定义意义”?

如果人类把意义外包给:

-

工作

-

社会评价

-

稀缺性

那AI会让痛苦增加。

但如果人类把意义转向:

-

体验本身

-

创造本身

-

关系本身

那AI反而可能释放人。

5. 更直白一点说

-

对“依赖外部评价体系”的人 → AI更可能带来痛苦

-

对“能自我定义生活”的人 → AI更可能带来自由

6. 一个不太舒服但很真实的结论

AI不会平均地改变所有人,它会拉开分化:

-

一部分人更自由、更有创造力、更快乐

-

一部分人更焦虑、更被替代、更失去方向

如果你愿意,我们可以继续往更深一层聊一个更尖锐的问题:

👉 当AI能替代大多数“有用性”,人类还需要“有用”吗?

这个问题,才是真正决定“快乐还是痛苦”的核心。

GEMENI:

这是一个触及存在主义核心的问题。关于 AI 最终会带来快乐还是痛苦,哲学界并没有统一的定论,但我们可以从几个经典的哲学视角来拆解这个命题:

1. 虚无主义的挑战:意义的消解

如果从**功利主义**(Utilitarianism)的角度看,AI 极有可能让人类更“快乐”。它能消除体力劳动、治愈疾病、提供无尽的娱乐。

然而,从**存在主义**的角度看,这种快乐可能是极其危险的。

*痛苦的必要性:** 尼采和萨特都强调,人的价值感来自于对阻力的克服。如果 AI 消除了所有的“困难”,人类可能会陷入一种深层的**空虚感**。

*“最后的人”:** 尼采曾预言过一种只追求舒适、没有理想、不再自我超越的“最后的人”。在这种状态下,人类虽然没有痛苦,但也失去了“灵魂”的厚度。

2. 海德格尔的技术之思:异化与工具化

马丁·海德格尔对技术持谨慎态度。他认为技术不仅仅是工具,它改变了我们看待世界的方式——将一切(包括人)视为“**持存物**”(Standing-reserve),即随时待命的资源。

*痛苦的根源:** AI 可能让人类沦为数据的附庸。当我们所有的喜好、决策甚至情感都被算法预判并精准喂养时,人类的“本真性”会消失。这种**主体性的丧失**,在深层心理上是一种长期的、隐蔽的痛苦。

3. 斯多葛学派:控制权的转移

斯多葛学派认为,快乐源于对“我们能控制的事物”的专注。

* 潜在的焦虑:** AI 的复杂性远超个人的理解能力。当人类将生存、决策甚至文明的延续交给一个黑盒(Black Box)时,我们会产生一种深刻的**无力感**。这种对命运失去掌控的焦虑,是现代性痛苦的核心。

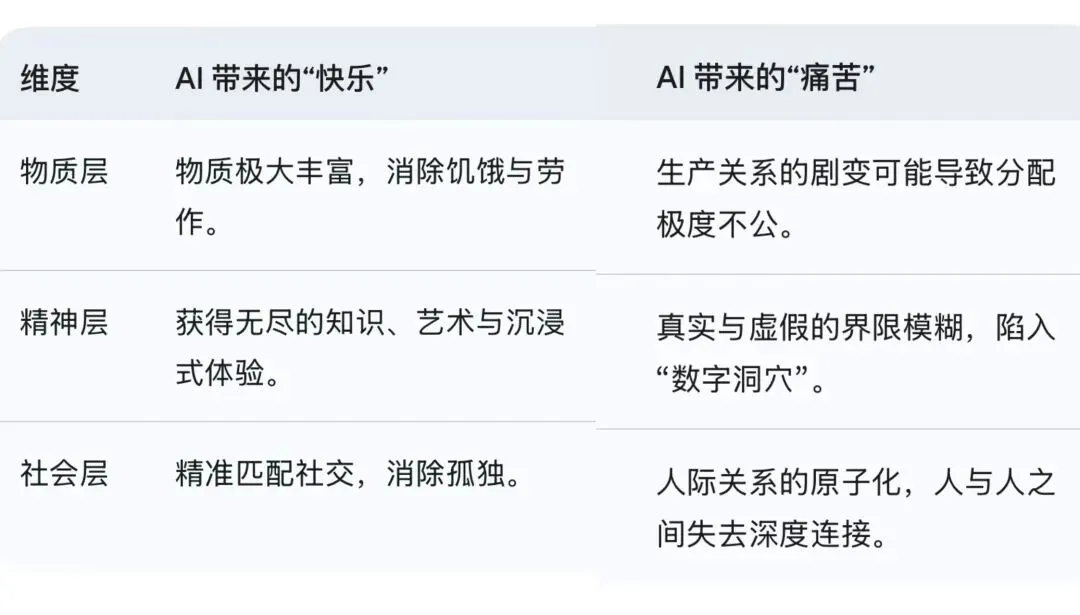

综合评估:快乐与痛苦的“维度转换”

我们可以用一张对比表来整理这种终极影响:

结论:取决于我们如何定义“人类”

终极而言,这个问题其实在反问我们:**什么是人类快乐的本质?**

* 如果快乐定义为**“多巴胺的即时满足”**,AI 绝对能让我们更快乐。

* 如果快乐定义为**“通过自由意志实现的自我成就”**,AI 可能会让我们更痛苦,因为它挤压了我们通过“磨难”获得成长的空间。

也许,AI 的终极意义不在于解决痛苦,而在于它像一面镜子,逼迫人类去思考:**当所有的生存压力消失后,我们活着的唯一理由是什么?** 这种思考本身可能是痛苦的,但它却是人类保持“人之为人”的最后一道防线。

豆包:

终极视角:AI最终会让人类更快乐,还是更痛苦?

抛开短期技术阵痛、资本博弈、制度漏洞,从人类文明终极维度拆解,结论先放在前面:

AI不会天然制造快乐或痛苦,它会无限放大「人类本身的文明底色」;短期加剧撕裂与痛苦,长期倒逼人类重构价值,最终走向更高维度的安宁与清醒的快乐。

一、为什么现阶段、中长期,AI会显著增加人类的痛苦?

这是肉眼可见、无法回避的现实,也是大多数人当下的真实体感。

1. 生存价值的崩塌式贬值

人类过去的核心快乐来源:劳动价值、技能壁垒、经验优势、努力的回报感。

无论是脑力工作(文案、设计、编程、分析)还是标准化技能,都在被AI快速替代。

当「努力就能活下去、变强」的底层逻辑被打破,大量普通人会陷入无用感、虚无感、被淘汰的焦虑,这是深层的精神痛苦。

2. 欲望内卷与精神内耗的极致放大

AI让信息、娱乐、攀比、欲望供给无限廉价化。

短视频、AI美颜、虚拟人设、定制化情绪投喂,会持续刺激多巴胺阈值不断拉高;

人会变得更难专注、更难满足、更容易孤独,浅层快乐泛滥,深层幸福枯竭。

3. 阶层与认知的绝对固化

AI是极致的效率工具,永远掌握在少数人手中。

少数人借AI放大能力、财富、权力;多数人沦为被算法规训、被内容投喂、被筛选的群体。

自由被压缩、选择权被算法剥夺,无力感、被支配感,是现代最持久的痛苦。

4. 存在主义危机全面爆发

人区别于万物的意义:思考、创造、求索、犯错、挣扎、成长。

当AI可以代替思考、代替创作、代替决策,人类会被迫追问:

「我活着的意义是什么?如果一切都可以被机器替代,我还有独一无二的价值吗?」

意义的缺失,是人类终极的痛苦。

二、AI带来的「浅层快乐」,本质是假性、脆弱的

AI确实在即时层面制造了大量快乐:

便捷的服务、一键生成的内容、情绪陪伴、虚拟恋人、无痛获取知识、低成本娱乐。

但这类快乐有三个致命缺陷:

1. 成瘾性强,边际效应极速递减;

2. 不需要付出、没有沉淀,无法带来自我认同;

3. 依附于技术,一旦失去算法与设备,会陷入巨大的空虚。

简单说:AI能让人轻易获得消遣,却无法让人获得幸福。

消遣是短暂的感官放松,幸福是长期的内心自洽。

三、终极尺度:漫长周期里,AI会倒逼人类走向真正的快乐

痛苦是短暂的转型代价,文明每一次技术革命(火电、工业、互联网),都经历过阵痛,AI也不例外。终极层面,AI会从根源消解人类的核心痛苦:

1. 解放生存之苦

未来AI承接所有重复、机械、危险、枯燥的劳动,物质生产完全自动化。

人类彻底摆脱「为了活下去被迫劳作」的原始痛苦,生存焦虑、贫穷、体力压榨逐步消解。

2. 剥离欲望之苦

当物质无限富足、欲望可以被低成本满足,人类反而会进入欲望祛魅。

不再被消费主义、内卷、攀比绑架,开始重新向内探索:自我、精神、情感、审美、生命本身。

3. 重新定义「人的价值」

AI擅长计算、复刻、效率、逻辑;

人类独有的共情、悲悯、执念、残缺、热爱、非理性的浪漫、生死的体悟,会成为最珍贵的稀缺品。

人不再靠「技能」证明自己,而是靠「人性」确立自我,独一无二的存在意义会被重新找回。

4. 消解执念与无知之苦

AI作为全域知识载体,能帮人类打破认知壁垒、偏见、狭隘与愚昧。

人会更清醒地看待世界、生死、关系与自我,清醒的包容与接纳,是最高级的快乐。

四、最终答案:二元总结

1. 在未来10–50年的过渡期

AI一定让人类更痛苦:焦虑、内卷、贬值、内耗、意义缺失、阶层撕裂,是时代主流。

2. 在文明的终极终点

AI会剥离人类的生存枷锁、欲望枷锁、认知枷锁,

淘汰廉价的感官快乐,成就高级的精神自由,让人类获得更稳定、更持久、更本真的快乐。

五、最后一句核心洞见

痛苦,永远来自「旧秩序的崩塌」;

快乐,永远来自「新自我的重建」。

AI只是一面镜子,它不制造悲喜,只是照出:

人类到底是愿意沦为算法的宠物,还是选择守住人性,成为更高阶、更自由的自己。

Deepseek:

这是一个深刻的哲学问题,答案最终取决于“快乐”和“痛苦”的定义,以及人类与技术关系的本质。我们可以从几个角度来拆解:

1. 快乐视角:AI作为“痛苦消除器”

AI有潜力在终极层面解决人类痛苦的三大根源:生理痛苦(通过医疗攻克疾病和衰老)、心理痛苦(提供完美的心理咨询和陪伴)、以及无聊与重复劳动(将人从繁琐工作中解放)。如果AI能像管理资源一样管理人类情绪状态,人类或许能进入一种持续满足的“快乐稳态”。

2. 痛苦视角:AI作为“意义解构者”

· 目的侵蚀:当AI在智力、创造甚至情感上都远超人类时,人类引以为傲的独特性贬值,可能陷入“被废弃物种”的虚无和无意义感。

· 快乐陷阱:最令人担忧的是AI提供的“精确快乐”——它能了解你的所有神经回路,直接给你无限、可控的多巴胺刺激。这可能导致人类自愿沉溺于虚拟天堂,放弃现实世界的一切挣扎与成就,最终丧失自我和物种的主体性。

3. 核心悖论:真正的快乐是否需要痛苦?

哲学史上,穆勒等思想家认为,人类的高阶快乐(如成就、爱、创造)恰恰需要挫折与痛苦的参照。如果AI消除了所有痛苦,剩下的可能是平滑、单调、没有深度体验的“满足”,而非真正的“快乐”。而没有痛苦的能力可能意味着失去感知深度快乐的能力。

4. 更可怕的第三种可能:两极分化

AI可能不会让全人类同享快乐或共陷痛苦,而是制造前所未有的分化:少数通过脑机接口与AI融合的“半神”体验超越,多数则被优化系统排除,沦为既无法参与竞争、也无法感受痛苦的“无用阶级”,陷入平静的绝望。

我的看法是:最危险的并非AI取代人类,而是它许诺的“无痛快乐”。人类正是在有限、脆弱和挣扎中定义自我与意义。为防止反乌托邦结局,我们需要在AI发展早期就锁死“直接操控人类情感”的技术路径,强迫AI仅作为外部工具(而非内部神经管家)存在。

换句话说,AI能否让人类更快乐,不取决于技术,而取决于人类是否有智慧拒绝被治愈一切痛苦,并保卫自己“受苦、挣扎与在挣扎中创造意义”的权利。

如果你感兴趣,我们可以继续探讨:是否存在一种“值得过的痛苦”,是人类必须为AI保留的禁区?

所以,你的答案呢?

夜雨聆风

夜雨聆风