3步用OpenAI实现自动化助手(附代码)

TODAY FOCUS

很多团队都想上 AI,但真到落地时,问题往往不是“模型够不够强”,而是“数据敢不敢出门”。你可能已经在 AWS 上跑了业务、存了数据、配好了权限体系,可一提到接入大模型,安全、合规、网络边界、运维复杂度就一起冒出来。最后,最先进的模型看起来很近,真正能上线的方案却很远。

这次有意思的变化是,OpenAI models、Codex 和 Managed Agents 来到了 AWS。听起来像一句产品更新,实际上它背后解决的是很多企业最现实的一道坎:我能不能在熟悉的 AWS 环境里,用更可控的方式,把真正可用的 AI 接到业务里?如果你也在关注企业级 AI 落地,这件事值得认真看一遍。

HOT TOPIC 01

不只是“能用”,而是“敢用”

先把这件事说白一点。所谓“OpenAI models, Codex, and Managed Agents come to AWS”,不是单纯把几个模型名字放到云平台的货架上,而是让企业可以在 AWS 的基础设施和安全体系中,更自然地使用 OpenAI 的能力。对很多公司来说,这比“模型排行榜第一”更重要。

为什么?因为企业做 AI,从来不只是调一个 API 那么简单。你真正要考虑的是数据放哪儿、访问怎么控、审计怎么做、延迟能不能接受、和现有系统怎么打通。过去很多团队在 PoC 阶段跑得很快,一到生产环境就卡住。原因不是不会写 Prompt,而是架构不顺。OpenAI 能力进入 AWS,本质上是在补齐“从试验到上线”中间那段最难走的路。

你可以把它理解成:以前你买了一台很强的发动机,但要自己改车架、接线路、装仪表;现在则更像是把这台发动机装进了你已经熟悉、也已经合规验收过的整车体系里。对技术团队来说,接入门槛更低。对管理层来说,风险更可控。对业务部门来说,落地速度更快。

这里面还有三个关键词值得注意。第一是 OpenAI models,也就是企业最常用的大模型能力,适合做问答、总结、抽取、生成和推理。第二是 Codex,它更偏向代码相关任务,比如生成代码、理解仓库、辅助修复问题。第三是 Managed Agents,这一步更像是从“模型回答问题”走向“模型代表你完成任务”。它不只是说,还会调工具、跑流程、分步骤执行。

如果说前几年企业做 AI 主要是在找“聪明的大脑”,那现在更现实的问题是:这个大脑能不能接到你的手脚,帮你真正把活干掉。Managed Agents 的意义,就在这里。

HOT TOPIC 02

真正的变化,在架构层

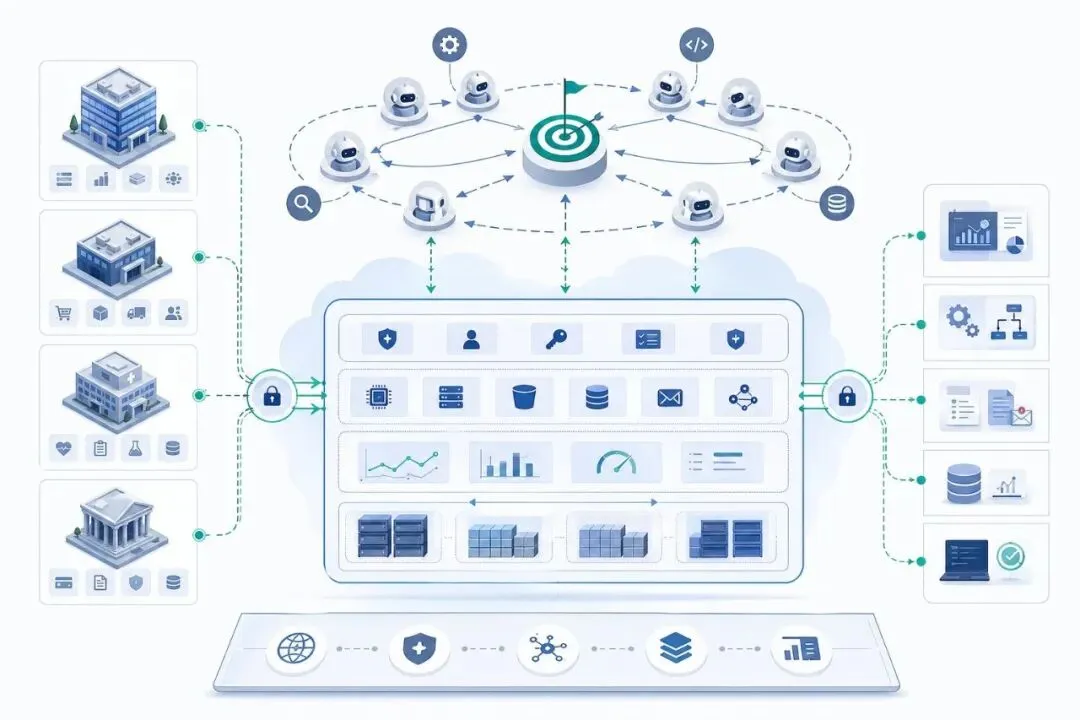

很多人第一次听到“托管 Agent”会有点误解,以为只是把聊天机器人升级一下。其实不是。Agent 的核心不是“更会聊天”,而是“能围绕目标自主调用能力”。比如你给它一个任务:整理最近 7 天客服工单,归纳高频问题,生成处理建议,并同步到内部系统。传统调用方式里,你要自己写很多流程编排。Agent 方式则更像给了一个会使用工具的数字同事。

这背后的原理并不神秘。大模型负责理解意图、拆分任务、决定下一步;工具层负责真正执行动作,比如查数据库、调用企业 API、读写文件、发送消息;运行环境负责权限控制、日志记录、失败重试和结果回传。Managed Agents 的价值,就是把这些麻烦但必要的“基础设施工作”尽量托管掉,让团队少造轮子。

Codex 也一样。很多开发者会把代码模型理解成“自动补全加强版”,其实它更适合做一类更完整的工作流:读懂项目上下文、根据需求写出函数、补测试、解释报错、甚至辅助改造旧系统。对企业来说,这不是炫技,而是提效。尤其在维护大量内部系统时,真正耗时间的往往不是写新功能,而是理解老代码、排查边界条件、补齐文档和测试。

从 AWS 视角看,这种整合还有一个很实际的意义:企业已经在 AWS 上建立了大量现成能力,比如 IAM 权限控制、VPC 网络隔离、CloudWatch 监控、S3 存储、Lambda 或容器服务的计算资源。现在把 OpenAI 能力接进来,很多原本分散的事情可以放回一个熟悉的治理框架里。技术团队不需要为了 AI 重新发明一套运维体系。

这也是为什么我会说,它的重点不在“多了一个入口”,而在“少了很多阻力”。企业不是不能用最强模型,企业是很怕上线之后没人兜底。架构顺了,AI 才会从演示稿变成生产力。

HOT TOPIC 03

动手搭一个最小可用方案

如果你想快速理解它怎么落地,最好的方式不是看概念图,而是先搭一个最小可用方案。我们用一个最常见的场景来举例:在 AWS 环境里做一个“企业知识问答助手”,让它能回答内部制度、产品手册和运维手册里的问题。

最基础的思路很简单。文档先存到 S3,做一个预处理,把内容切分成小段并建立索引;用户提问后,系统先检索最相关的文档片段,再把这些片段连同问题一起发给 OpenAI model,让模型基于企业知识作答。这就是大家常说的 RAG。为什么它常见?因为它足够实用,成本相对可控,而且比“让模型裸答”更可信。

你可以把流程理解成两个阶段。第一个阶段是“备料”,把企业文档整理好。第二个阶段是“做菜”,收到问题后找到相关材料,再让模型生成最终答案。模型擅长表达和推理,但它不是你的企业资料库;检索系统擅长找资料,但不会组织答案。两者配合,效果会比单打一稳定得多。

下面给一个可运行思路的 Python 示例。它不追求生产级完整性,但能帮你快速建立感觉。假设你的应用运行在 AWS 的计算环境中,比如 EC2、ECS 或 Lambda,相关密钥通过安全方式注入环境变量。

importosfromopenaiimportOpenAIclient=OpenAI(api_key=os.environ.get("OPENAI_API_KEY"))defbuild_prompt(question,context):returnf"""你是一名企业知识助手。请严格根据已知资料回答。如果资料不足,请明确说“根据当前资料无法确认”。已知资料:{context}用户问题:{question}"""defask_knowledge_base(question,retrieved_docs):context="\n\n".join(retrieved_docs)prompt=build_prompt(question,context)response=client.responses.create(model="gpt-4.1",input=prompt)returnresponse.output_textif__name__=="__main__":docs=["请假制度:员工年假需提前3个工作日申请。","运维规范:生产环境发布必须经过双人复核。","报销流程:单笔超过5000元需部门负责人审批。"]q="生产环境上线前有什么要求?"answer=ask_knowledge_base(q,docs)print(answer)这段代码的重点不复杂。你先把检索到的文档片段拼成上下文,再交给模型回答。在真实项目里,retrieved_docs往往来自向量检索服务,文档也会经过清洗、切片、去重和权限过滤。别小看“权限过滤”这一步。企业知识库最容易踩的坑,不是答不出来,而是答了不该答的内容。

如果你想再往前走一步,可以把这个问答助手变成一个 Agent。比如它不仅回答“怎么报销”,还能进一步帮你生成报销说明、整理附件清单,甚至调用内部审批接口发起流程。这样它就从“会说”变成“会做”。思路上也不难:给 Agent 配置可调用的工具函数,让模型在合适的时候调用它们。

下面是一个简化版的工具调用示意:

importjsonfromopenaiimportOpenAIclient=OpenAI()defcreate_expense_request(amount,reason):return{"status":"success","request_id":"EXP-2025-001","amount":amount,"reason":reason}tools=[{"type":"function","name":"create_expense_request","description":"创建报销申请","parameters":{"type":"object","properties":{"amount":{"type":"number","description":"报销金额"},"reason":{"type":"string","description":"报销事由"}},"required":["amount","reason"]}}]response=client.responses.create(model="gpt-4.1",input="帮我创建一笔1200元的差旅报销,事由是客户拜访。",tools=tools)foriteminresponse.output:ifitem.type=="function_call"anditem.name=="create_expense_request":args=json.loads(item.arguments)result=create_expense_request(**args)print(result)真实生产里,你会把这个函数换成内部 API,并且加上身份校验、审批逻辑、审计日志和异常处理。Managed Agents 的意义就在于,它让这种“模型 + 工具 + 流程”的组合更自然,也更适合企业场景。

HOT TOPIC 04

从开发到上线,哪些地方最容易踩坑

看到这里,你可能会觉得:好像已经能做了。是的,能做,但距离“好用且可控”还有几步。很多项目不是死在模型能力,而是死在工程细节。尤其当你把 OpenAI 能力接入 AWS 环境后,真正该重视的是三件事:权限、观测和边界。

先说权限。企业最忌讳“一个万能机器人看到所有数据”。正确做法是,让 AI 继承用户身份或者至少继承用户角色。销售只能看到销售资料,财务只能访问财务数据,运维只能操作授权范围内的资源。不要把“先跑通再说”当借口,因为一旦做成默认全开,后面几乎一定要返工。

再说观测。很多团队调试 AI 时只盯着最终答案对不对,但上线后真正需要的是全链路可追踪。一次回答用了哪些资料?调用了哪些工具?失败在哪一步?成本花在哪个模型上?在 AWS 环境里,你可以把日志、指标和告警纳入现有监控体系。这样 AI 不再是黑盒,而是可排查、可优化、可审计的服务。

最后是边界。不是所有任务都该交给 Agent。涉及高风险动作,比如删库、转账、修改关键生产配置,最好保留人工确认。Agent 很强,但“强”不等于“适合无限授权”。更稳妥的设计是分级:信息查询可自动完成,流程发起可半自动,关键执行必须人工审批。企业 AI 做得久的人,最后都更相信“可控的聪明”,而不是“失控的全能”。

如果你准备让开发团队先试点,我建议从两个方向切入。一个是内部知识助手,回报快、风险低、效果直观;另一个是开发提效场景,比如 Codex 辅助写单元测试、解释遗留代码、生成接口示例。这两个方向最容易在几周内做出结果,也最容易说服业务和管理层继续投入。

HOT TOPIC 05

什么时候该上,什么时候别急

不是每家公司都要第一时间做最复杂的 Agent 系统,但几乎每家在 AWS 上跑核心业务的企业,都值得重新评估一下自己的 AI 策略。因为条件已经变了。以前是模型能力很强,但接入和治理成本高;现在则更像是基础设施和模型能力开始同频了。

如果你的团队有这些特征,价值会尤其明显。第一,已经大量使用 AWS,现有安全和运维体系比较成熟。第二,内部有大量文档、代码仓库或流程系统,员工每天都在重复查找、总结、填表、流转。第三,业务对数据边界和审计要求高,不能接受随便把信息丢到外部系统里。这几类公司,很适合优先尝试。

反过来,如果你的数据还很混乱,文档长期不更新,内部 API 也没梳理清楚,那就别急着上最花哨的 Agent。因为 Agent 的上限很高,但下限也受基础数据质量影响。它像一个很能干的新同事,可如果你给他的资料过时、流程混乱、权限不清,他再聪明也只能在混乱里打转。很多时候,先把知识库整理好,比先追最新术语更有用。

说到底,OpenAI models、Codex 和 Managed Agents 来到 AWS,最大的意义不是“又多了一个技术新闻”,而是企业终于有机会在自己熟悉、可治理的环境里,把 AI 真正做进业务流程。它让模型不再只是演示中的亮点,而更像一个能接流程、能控权限、能被审计的生产工具。

如果你正准备动手,我的建议很简单:别一开始就想着做全公司最聪明的 AI 平台。先挑一个高频、刚需、边界清楚的小场景,在 AWS 环境里接入 OpenAI 能力,跑通检索、回答、工具调用和权限控制。只要第一个场景站稳,后面很多事就会顺起来。企业做 AI,从来不是拼谁喊得响,而是拼谁先把一件小事,做成真的生产力。

参考来源:

OpenAI Blog

https://openai.com/index/openai-on-aws

夜雨聆风

夜雨聆风