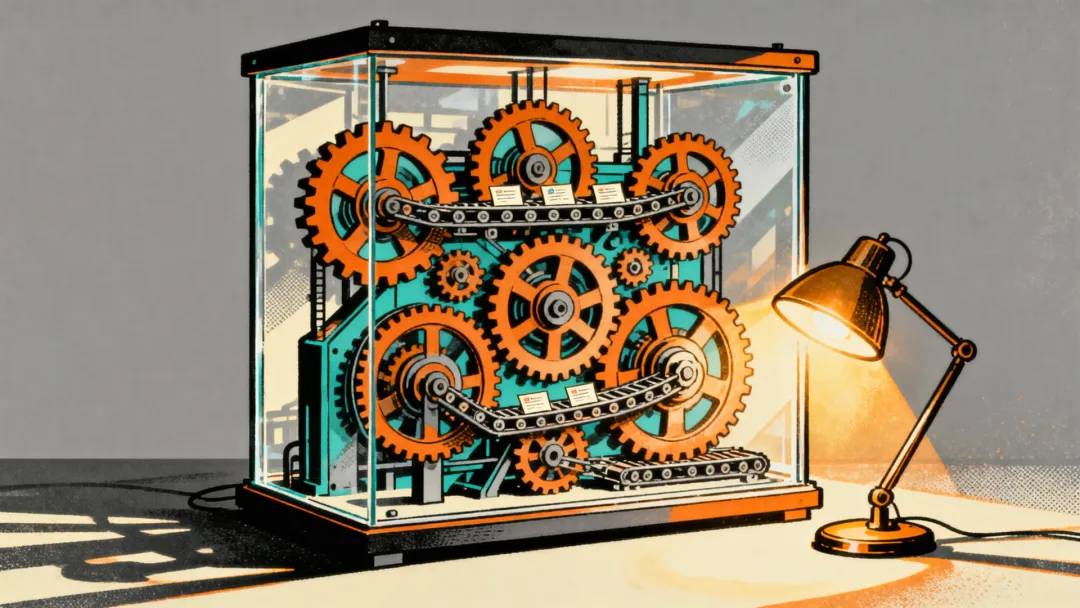

给你的AI生产力系统安装上复利飞轮

从一个终端 Tab 说起

今天我让 AI 帮我创建一个 Windows Terminal 的自定义 profile——一个 SSH 到远程 lab 机器的快捷 tab。

我说的是:”加个 SSH profile 到 lab-40。”

AI 没有问我 IP 是什么、用什么用户名、SSH key 在哪。它直接去 labs/_index.md 查到了 lab-40 的文档,从里面提取了连接信息,然后一条命令写入了 Windows Terminal 的 settings.json。

10 秒完成。

这件事本身不值得写一篇文章。引起我注意的是:”是什么让我感觉到当前的工作系统越来越好用了?”

答案是:因为我的工作系统里已经有了这些数据,而且数据之间有关联。lab 机器的 SSH 信息在 lab doc 里,lab doc 在 labs/ 目录下,labs/_index.md 是索引。AI 创建新 skill 的时候扫了一圈现有的数据源,发现了这个关联,就自动写进了集成逻辑。

这就是”越用越好”的一个微小切面。所谓好用,就是指用更少的认知负担和操作成本,更可靠地达成目标,在有效性(effectiveness)、效率(efficiency)、满意度(satisfaction)这三方面都做到上乘。

于是我就将思考稍稍延展一下:就以我的工作系统为例,到底是哪些机制保障了系统底线,从而可以越用越好呢?

机制一:结构化的数据约定

关联能发生的前提是:数据有固定的位置和格式。

我的系统里,每类信息都有明确的存放位置:

labs/_index.md → 所有 lab 机器的索引

customers/_index.md → 所有客户的 pipeline

partners/_index.md → 所有伙伴的赋能状态

people/_index.md → 所有联系人

dashboard.md → 所有待办事项每个 lab doc 的 Access Information 表格格式是固定的:OAM IP、SSH User、SSH Key、Sudo Password。每个客户 profile 的结构是固定的:基本信息、技术环境、关键联系人。

这意味着 AI 不需要”理解”你的文件内容,它只需要知道去哪里找、找什么格式。

回到开头的例子:AI 创建 console-profile skill 时,它扫到 labs/ 目录下有一批 lab doc,每个 doc 里有 SSH 连接信息,格式统一。新 skill 的 SSH 模式恰好需要同样的信息。模式匹配成功,关联建立。

如果 lab 信息散落在随机的笔记、聊天记录、脑子里呢?AI 扫不到,关联不会发生。

结构化不是为了好看,是为了让关联成为可能。

这也是很多人用 AI 工具时的第一个瓶颈:信息散落在 Notion、微信、邮件、脑子里,AI 能接触到的只是碎片。你让它”帮我整理一下”,它只能整理它看得到的那部分。

机制二:强制检查点

有了结构化数据,下一个问题是:谁来触发关联?

如果靠 AI “自觉”去扫描关联,那就是靠运气。有时候它会想到,有时候不会。

我的做法是把关联动作编码成强制检查点。举几个例子:

处理任何材料时:必须执行 People Discovery Gate——从材料中识别人物,检查是否已在 people/_index.md 中,没有就新建。每次处理完必须汇报:”📇 People index: added X, updated Y”。

任何任务状态变更时:必须用关键词 grep 扫描全 dashboard,同步更新所有提到这个任务的地方。不是”建议更新”,是”必须更新”。

创建新 skill 时:必须扫描现有 skill 和数据源,检查是否有数据重叠。

这些检查点不是建议,是规则。AI 每次执行都会走这些路径,不依赖”这次状态好不好”或”有没有想起来”。

强制检查点把”应该做”变成了”每次都做”。

这和软件工程里的 CI/CD 是同一个思路:你不靠开发者记得跑测试,你把测试写进 pipeline,每次提交自动跑。质量不靠自觉,靠流程。

机制三:Skill 把流程固化成可执行的指令

检查点解决了”什么时候做”,skill 解决了”怎么做”。

以会议记录为例。我的 meeting-record skill 不是一个模糊的指导——”记得提取 action items 哦”——而是一个精确的执行序列:

Step 1: 确认会议类型和参会方

Step 2: 捕获会议内容

Step 3: 生成结构化纪要,保存到对应目录

Step 4: 提取 Action Items → 写入 dashboard → 更新 opportunity → 更新 partner status

Step 5: 更新相关文档(客户 profile、伙伴状态)

Step 6: 确认Step 4 是关键——一次会议产生的信息,同时更新 3-5 个文档。不是因为 AI 特别聪明想到了要更新这些地方,而是 skill 里写死了这些步骤。

Skill 的价值不是”AI 能做这件事”,而是”AI 每次都以同样的质量做这件事”。

踩过的坑也会编码进 skill。比如我的 pptx skill 里有一条:PptxGenJS 的 shadow 对象会被 mutate,多个元素不能共享同一个 shadow 实例。这个坑我踩过一次,写进 skill 之后就再也不会踩第二次。

这就是”越用越好”的一个具体含义:系统的下限在持续抬高。 不是每次都靠运气产出好结果,而是最差的结果也不会太差。

机制四:数据密度的正反馈循环

前三个机制是基础设施。第四个机制才是”越用越好”的真正引擎。

让我用时间线来说明:

第 1 天:系统里只有模板和空目录。AI 能做的关联 = 0。每次操作都需要手动输入所有信息。

第 30 天:labs/ 里有 5 个 lab doc,customers/ 里有 7 个客户,people/ 里有 30 个联系人,solutions/ 里有十几个技术方案。

这时候发生了什么?

-

我说”加个 SSH profile 到 lab-40″→ AI 自动从 lab doc 读取连接信息,不用问我

-

我说”准备下午和客户 A 的会议”→ AI 自动汇总客户 profile、上次会议纪要、相关商机状态、未完成的 action items

-

我收到一封邮件提到某个人名 → AI 自动在

people/_index.md里找到这个人的历史记录和关联项目

每新增一个数据节点,它和所有已有节点之间都可能产生关联。 5 个节点最多 10 条边,30 个节点最多 435 条边,100 个节点最多 4950 条边。关联的价值是超线性增长的。

这就是为什么系统在前两周感觉”也就那样”,但用了一两个月之后会有一个明显的拐点——不是系统变聪明了,是数据密度到了一个阈值,关联开始大量自动发生。

你每天往系统里喂的数据,不是在”记笔记”,是在给未来的自己减少手动输入。

这就是 Compounding Artifact(复利产物) 的含义:知识不是每次重新推导的,而是持续积累、持续关联、持续增值的。每一次信息进入系统,都让整个知识网络变得更密、更准、更有用。文档之间的连接和文档本身一样有价值——甚至更有价值,因为连接把孤立的信息点变成了可以推理的知识网络。

四个机制的关系

结构化约定(数据有固定位置和格式)

↓ 使得

强制检查点(每次都扫描关联)

↓ 能够

Skill 固化流程(精确执行,不靠记忆)

↓ 持续

喂入数据 → 数据密度增长 → 关联机会指数增长

↓ 反馈到

结构化约定(新数据按约定存放,进一步丰富网络)这是一个飞轮。四个机制缺一不可:

-

没有结构化约定 → 数据散落,AI 扫不到,关联无从发生

-

没有强制检查点 → 关联靠运气,时有时无

-

没有 Skill 固化 → 每次执行质量不稳定,踩过的坑会重复踩

-

没有持续喂数据 → 网络稀疏,关联价值有限

一个反直觉的推论

很多人觉得 AI 工具的价值在于”AI 有多聪明”。模型越大、参数越多、推理越强,工具就越好用。

我的体会恰好相反:系统的价值主要不在 AI 的能力,而在你喂给它的数据和围绕数据建立的流程。

同样的 AI 模型,给它一个空的工作目录,它只能做通用的问答。给它一个运行了两个月、积累了几百个结构化文档的工作系统,它能做的事情完全不同——不是因为它变聪明了,而是因为它有了上下文。

这也意味着:你的工作系统是有护城河的。 不是技术护城河(别人也能搭同样的工具链),而是数据护城河。你积累的客户关系网络、技术方案库、踩坑记录、团队知识——这些是别人复制不了的。

换个 AI 模型?没关系,数据和流程还在。换个人来用这个系统?他能立刻获得你积累的所有上下文。这才是”越用越好”的终极含义:价值沉淀在系统里,不在任何单次对话里。

回到那个终端 Tab

开头那个 10 秒完成的操作,背后是:

-

lab-40 的 SSH 信息在两个月前就录入了系统(结构化约定)

-

AI 创建新 skill 时被要求扫描现有数据源(强制检查点)

-

console-profile skill 把”查 lab doc → 提取 SSH 信息 → 写入 settings.json”固化成了可重复的流程(Skill 固化)

-

两个月的数据积累让 AI 有足够的上下文做自动关联(数据密度)

10 秒的背后是两个月的积累。但这两个月的积累不是刻意为之——它就是日常工作的副产品。每天用 AI 处理邮件、记录会议、管理任务,数据自然就积累了。

四个机制形成的飞轮一旦转起来,每一次日常操作都在给系统加速。你不需要专门留时间”维护系统”——工作本身就在喂养飞轮,飞轮反过来让工作越来越快。

夜雨聆风

夜雨聆风