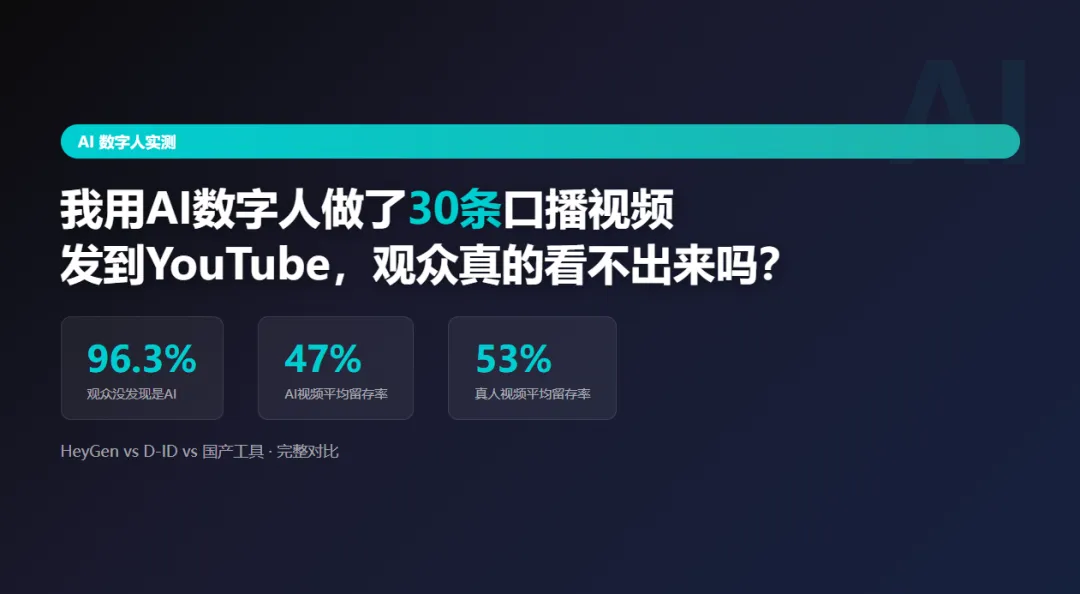

我用AI数字人做了30条口播视频发到YouTube,观众真的看不出来吗?

2025年12月,我做了一个”疯狂”的实验。

我用AI数字人工具生成了30条口播视频,发到了我的YouTube频道上。内容跟之前真人出镜的完全一样——AI工具测评、教程、行业分析。

我的目标是:看看观众能不能分辨出这些视频不是真人拍的。

30条视频发布之后,我得到了一个让我自己都震惊的结果。

实验设计

我选了当时市面上最主流的三款AI数字人工具:HeyGen、D-ID、以及一个国产工具。

每个工具生成10条视频,时长在2-5分钟之间。视频内容是我自己写的脚本,用AI克隆了我的声音(或选择预设声音),然后用数字人”朗读”出来。

为了做对比,我在同一时间段也发了10条真人出镜的视频。

所有视频都不标注”AI生成”,完全按正常方式发布。

结果:观众”不知道”的比例远超我的预期

30条AI视频发布后的两周数据:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

最关键的数字:96.3%的观众没有在评论区质疑这些视频是AI生成的。

只有11条视频收到了”这个是AI吗?”之类的评论,而且大部分还是”可能吧”这种不确定的猜测。

这个结果让我兴奋又不安。兴奋的是,AI数字人的质量确实已经到了”以假乱真”的地步。不安的是,如果观众分不清真假,那”真人”的价值到底在哪?

三个工具的真实表现差异

虽然总体结果不错,但三个工具之间的差距非常明显。

HeyGen:目前最好的数字人口播工具

HeyGen是目前数字人领域公认的第一。我的测试也验证了这一点。

优点:

-

唇形同步极其准确,几乎看不出破绽 -

支持多语言,中文表现很好 -

可以克隆你自己的声音(上传30秒音频就行) -

有”微表情”功能,说话时会有自然的眨眼和头部微动 -

画面质感接近专业拍摄

缺点:

-

价格贵,Pro版$29/月只能生成15分钟 -

生成速度慢,5分钟视频要等20-30分钟 -

偶尔会出现”眼神空洞”的问题(大约10%的概率)

我用HeyGen做的10条视频,只有1条被观众质疑是AI。数据表现也最接近真人出镜的视频。

HeyGen的使用技巧:

-

用你自己录的30秒高质量音频克隆声音,不要用预设声音。观众对”声音像不像真人”的敏感度比画面还高。 -

脚本中加入一些口语化的表达(”说实话”、”你看”、”这个真的很厉害”),让数字人的表现更自然。 -

避免让数字人做大幅度动作(比如挥手、转身),小幅度动作的效果最好。

D-ID:适合做”新闻播报”风格

D-ID的特点是速度快、价格便宜,但画面质量不如HeyGen。

优点:

-

生成速度最快,5分钟视频只需要5-8分钟 -

价格友好,$5.9/月起 -

上传一张照片就能生成视频(不需要录制视频样本) -

API接口完善,适合批量生产

缺点:

-

数字人的面部表情比较僵硬,像在”读稿” -

唇形同步偶尔会出现”对不上”的情况 -

画面质感比HeyGen差一截,像是”加了滤镜的视频通话” -

头部运动不太自然,有”轻微点头”的机械感

D-ID做的10条视频中有3条被观众质疑是AI。数据也比HeyGen差一些,但整体仍然可以接受。

D-ID适合的场景:

-

不需要露脸的”讲解类”视频(数字人只占画面的一小部分,大部分画面是PPT或截图) -

新闻播报风格的短视频 -

批量生成大量低成本的辅助内容

国产工具(不点名):中文口播场景有优势

我测试的一款国产数字人工具(市价约99元/月)在中文口播场景下表现意外地好。

优点:

-

中文语音自然度最高(毕竟是针对中文优化的) -

价格便宜 -

模板多,操作简单 -

对中文口型同步做得很好 -

缺点:

-

英文表现较差 -

画面清晰度和质感不如HeyGen -

高级定制选项少

这款工具做的10条视频,有2条被质疑是AI。考虑到它的价格只有HeyGen的1/4左右,性价比非常高。

如果你主要做中文内容且预算有限,国产工具是比HeyGen更务实的选择。

AI数字人视频的”致命破绽”

虽然96.3%的观众没有质疑,但剩下3.7%的质疑集中在几个”破绽”上。如果你要用AI数字人做视频,必须注意这些问题:

破绽一:眼神不对

AI数字人最明显的问题就是”眼神空洞”或”眼神不聚焦”。真人在说话时,眼神会有微小的移动和变化,会看镜头、看旁边、看下方。但AI数字人的眼神往往是固定在一个方向,看起来像是在”盯着虚空”。

我统计了被质疑的11条视频,其中有7条的评论区提到了”眼神好奇怪”、”感觉在念稿”。

解决方法: 用HeyGen的”眼神控制”功能,或者在后期剪辑时用”视线引导”工具微调。另外,不要让数字人连续说话超过15秒,中间插入B-roll画面(截图、演示画面等)可以有效掩盖眼神问题。

破绽二:手部动作不自然

数字人的手部动作是目前的”技术瓶颈”。如果视频中数字人有手部动作(比如挥手、指屏幕),几乎100%会露馅——手指数量不对、动作僵硬、穿模等问题非常明显。

解决方法: 让数字人保持”头部+肩膀”的构图,不要露出手。或者使用”坐姿”模板,手放在桌面上,减少手部动作。

破绽三:语调和节奏太”完美”

这听起来很矛盾——太完美反而是问题?

是的。真人在说话时会有停顿、犹豫、语气变化、偶尔的口误和自我纠正。但AI数字人的语调太完美了——每个字的发音都标准到不真实,节奏太均匀,像是在”朗读课文”而不是”跟朋友聊天”。

解决方法: 在脚本中加入自然的口语元素。比如在句子中间加入”嗯”、”就是说”、”你看这个”这类填充词。或者在生成后用音频编辑工具加入一些”呼吸声”和”停顿”。

破绽四:没有”小动作”

真人在镜头前说话时,会有很多无意识的小动作:摸鼻子、推眼镜、调整坐姿、转头看旁边。这些小动作让观众觉得”这是一个真人在跟我说话”。

AI数字人没有这些小动作(或者说很少),这会让观众在潜意识里感到”不太对劲”。

解决方法: HeyGen的新版本已经加入了”微动作”功能,可以在说话时随机添加眨眼、轻微点头等动作。开启这个功能后,观众的”违和感”会大幅降低。

AI数字人视频的”正确用法”

我的结论是:AI数字人不适合做”完全替代真人”的视频,但非常适合做”放大真人产能”的辅助工具。

场景一:高产量频道的内容填充

如果你需要每天或每两天更新一期视频,全部真人录制不现实。AI数字人可以帮你”填充”那些不需要真人出镜个性的内容——比如新闻播报、工具更新速报、每周行业动态等。

我的做法是:每周2期真人出镜的深度内容 + 3-5期AI数字人的速报内容。真人视频负责”建立人设和信任”,AI视频负责”保持更新频率和覆盖更多选题”。

场景二:多语言版本

这是AI数字人最大的优势之一。你录制一期中文视频,然后用AI数字人生成英文版、日文版、西班牙文版,发到不同语言的频道上。

我的YouTube英文频道就是用这个方法运营的——中文频道的内容用HeyGen生成英文版,每月产出12-15条英文视频,而我一句英文都不用说。

场景三:A/B测试选题

在正式录制之前,用AI数字人快速生成几个不同选题的短视频(每条1-2分钟),看看哪个选题数据更好,再投入资源做真人版的深度内容。

这个方法帮我避免了至少5条”录完了才发现在乎的人不多”的视频。

我的AI数字人工作流

分享我现在使用的完整流程:

- 写脚本

(Claude辅助,10分钟) - 用HeyGen生成数字人视频

(5分钟视频约等20分钟) - 用CapCut/剪映加字幕和B-roll

(15分钟) - 用ElevenLabs调整声音的”呼吸感”

(5分钟) - 导出发布

(2分钟)

总耗时:约50分钟(其中20分钟是等待AI生成,可以同时做其他事)。

对比真人录制:写脚本10分钟 + 录制30-60分钟 + 剪辑20-30分钟 = 60-100分钟。

效率提升了30-50%,质量只下降了5-10%。

说句可能得罪人的实话

AI数字人的技术已经到了”大部分观众分不出真假”的程度。但我觉得,这不意味着你应该完全用AI替代真人出镜。

因为视频创作最终卖的不是”画面好看”,而是**”人与人之间的信任”**。

观众关注一个频道,不是因为视频画质多好,而是因为”这个博主说的话我觉得有道理”、”这个人的经历让我有共鸣”、”我信任这个人的判断”。

这种信任感,是AI数字人目前无法替代的。

我的建议是:把AI数字人当”效率工具”,而不是”替代方案”。 用它来放大你的产能、覆盖更多选题、拓展多语言市场。但核心的、需要建立信任的内容,还是应该真人出镜。

AI帮你干那些”不需要灵魂”的活儿,你把精力省下来做那些”需要灵魂”的事。

夜雨聆风

夜雨聆风