首届AI临床试验Show,讲了哪些内容?

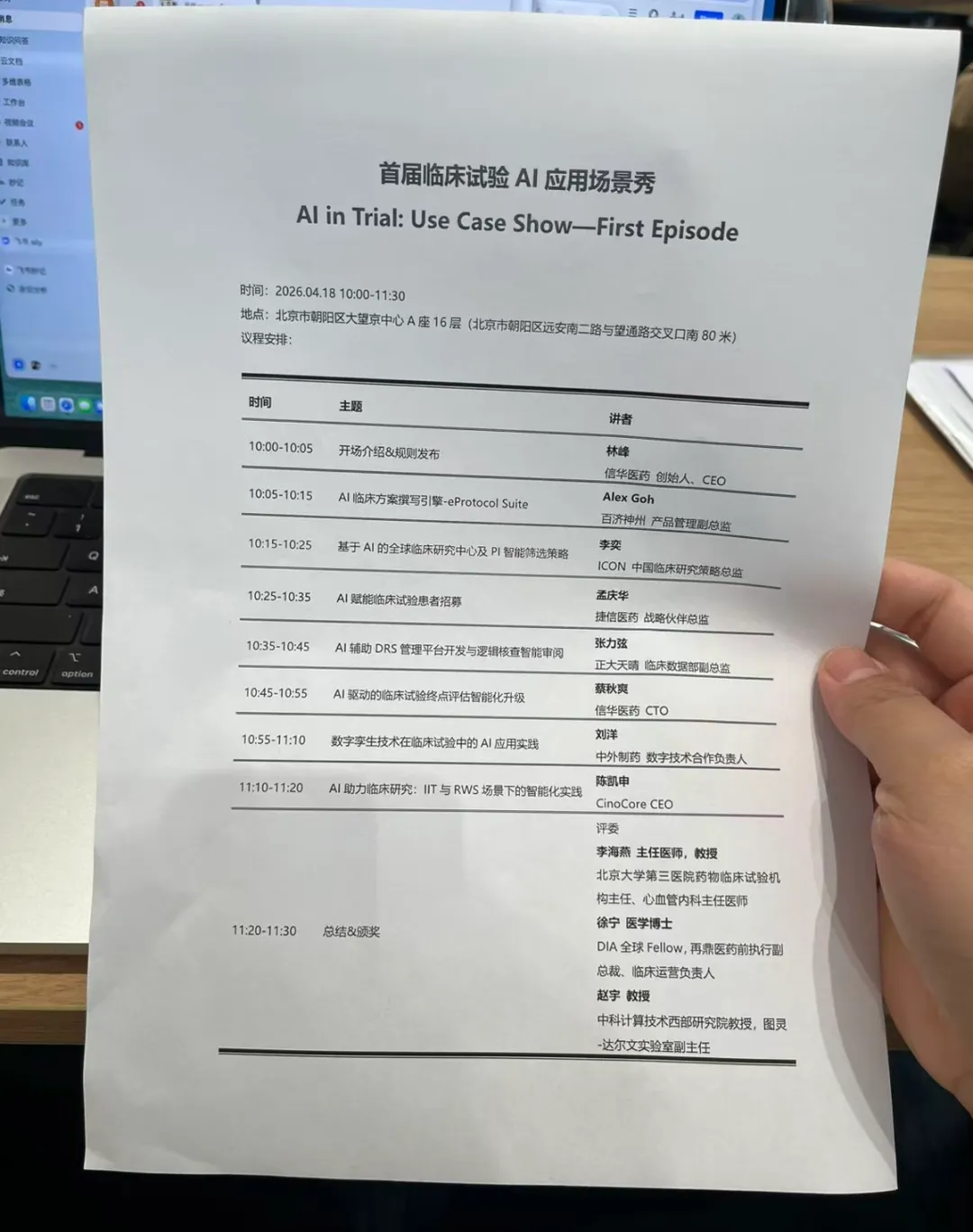

上个月,信华医药的林峰总在北京组织了首届”AI in Trial Use Case Show”。

7个案例,历时不到一个半小时,干货密度极高。这场活动,让真正在做AI的人站出来,讲一个具体的场景、一个落地的案例、一个有数据支撑的实践。

它们恰好覆盖了一个新药从立项到上市后研究的完整临床链条:写方案→选中心→招募患者→管理数据→评估终点→虚拟仿真→真实世界研究。

每一个环节都有人在做AI,每一个环节都有具体的痛点被触碰。

以下是全程纪实,希望对关注临床研究AI化的朋友有所参考。

开场:为什么要办这场活动?

主持人兼发起人、信华医药创始人林峰在开场时说了一段话:

“AI在临床研究里面已经深度使用,各个场景都在用。临床研究是一个耗时耗力、场景复杂的过程,我们有非常多的小场景。

今天的目标是抛砖引玉,绝对不是说这是中国最好的案例。肯定有更好的案例在外面。

但我们希望通过这七个,让大家看到AI在临床研究里到底能做什么。”

案例一:AI临床方案撰写引擎 eProtocol Suite

主讲:Alex Goh,百济神州产品管理副总监

临床研究的一切从Protocol(临床试验方案)开始。这份文件往往厚达两三百页,是下游一切的源头:ICF、CRF、EDC、统计分析计划、IRT、Safety Database、Study Reference Manual……每一个都要用到它,出了问题,下游全堵。

这个关系,Alex用一张”Clinical Data Flow”图说清楚了:Clinical Protocol像一根主干,向右分叉出密密麻麻的下游文件。写Protocol不只是写一份文件,它是整个数据流的起点。

问题是,这份文件写起来极慢,而且行业里大家都想靠AI加速,但路子各有不同。百济的判断是:不能让AI直接写,而是在AI和内容之间找到一个平衡,先建foundation,再用AI填充,最后用Copilot辅助撰写。

具体分四层:

第一层:One Template(标准化模板)。基于SCDM等行业标准,把Protocol的模块结构固定下来。好处是分析更高效、数字化更容易、符合合规要求。Alex提到,这套模板能把一本200多页的Protocol”框架瘦身”——先搭好结构,再填内容。对于血液瘤、肿瘤等不同适应症,模板还可以进一步收窄。

第二层:Content Library(内容库)。把那些不需要每次重写的内容数字化入库,Safety Content、统计学语言(PFS、OS的标准表述)等等。AI可以快速把这些内容populate到模板对应位置,既保证合规,又大幅提速。

第三层:Schedule of Events数字化。这张表是Protocol里最核心的部分,因为它直接决定ICF怎么写、CRF怎么生成。AI可以对这张表做优化并数字化处理。

第四层:Copilot辅助撰写。AI基于Synopsis自动生成Protocol草稿,并在每一个句子旁边标注Rationale,”为什么要写这句话?引用了哪里的数据?”这个功能解决了一个行业痛点:过去专家写出结论,但推理路径不透明;现在每句话都有出处,审阅者可以追溯。

整个工具以Word插件形式呈现,用户无需切换工具。Alex最后强调,这个产品背后是Clinical Dev、Biomarker、Data Management等多个团队长期协作的成果,致谢页上列了十几个人的名字。

他说:”临床试验方案是非常复杂的协作努力,不是一个人开发、一个人用就能做到的。”

案例二:基于AI的全球临床研究中心及PI智能筛选策略

主讲:李奕,ICON中国临床研究策略总监

李奕开场说,ICON现在在方案、ICF、合同、eTMF等各个部分都做了AI化处理,目标是节省80%的非决策性重复工作。其中做得最成熟的,是全球研究中心选择这个方向。

背景是:全球有20~30万家医院,研究者数量百万级。对于一个覆盖15~20个国家、60多个中心的国际大型三期,靠经验和名气选中心,代价极高。李奕说,过去常规流程,仅仅是确认医院清单这件事,CRO和申办方之间就要来回讨论三个月。

他分享了一个真实的失败案例。某大型药企在复发性尿路感染领域开展全球研究,在亚太、北美、欧洲15个国家自主激活了125家中心,预期每个中心每月能随机4名患者(4 p/s/m)。研究启动半年之后,发现实际只达到1 p/s/m,70%的中心根本没有入组任何患者,严重威胁了整个研究的时间线和数据完整性。

ICON随后接手,用自主开发的AI平台One Search重新操盘。这个平台背后的数据规模相当可观:超过28,000个申办方、438,000个研究、198,000个机构、3.15亿患者数据。

One Search的核心逻辑是李奕说的四个字,”强者恒强”。高绩效研究者并不神秘,他们的共同特征是:在不同的研究之间有更多交叉,与更多患者有实际接触,在研究者网络中连接度更高。这些特征都可以从数据中识别出来。

工具运作分三步:

首先ICON的可行性经理对AI进行训练,确定哪些维度的经验最有价值;

第二步机器学习对机构和研究者进行四级分类,Tier 1是”极可能入组患者”,Tier 4是”不可能入组患者”;

第三步ICON本地团队人工复核,补充本地洞察,防止AI给出”脱离一线经验的结论”。

输出是一张可视化的国家/中心评估图。以UTI研究为例,中国被标注了四个绿点(强烈推荐),同时有一个红点标注竞争性研究风险。

结果:ICON额外识别并激活的125家新中心,入组率达到并持续维持在2.5 p/s/m超过一年,无入组中心从70%骤降至10%,同时扩展了12个新国家。申办方对结果非常满意,还主动要求在新国家追加更多中心。

另一个之前没有预料到的收益是,李奕在现场讲述时提到:选中心的时间比历史数据缩短了53%,而且第一例患者的随机时间也明显提前了。

案例三:AI赋能临床试验患者招募

主讲:孟庆华,捷信医药战略伙伴总监

孟庆华上来先说了一组数据:临床试验延期比例高达85-95%,其中48%的项目因招募延迟,Site按计划入组的不足5%,实际参与患者比例只有57%。新药发现端同样严峻:平均研发成本$10-26亿,周期10-15年,成功率不足1%,行业称之为”双十定律”魔咒。

捷信的定位是”中国首家数字化患者解决方案公司”,每年承接几百个临床研究项目,助力了100多个新药上市。

但这次分享的角度跟一般招募公司不太一样。孟庆华说:

“我们总在想怎么让患者快点来入组,却很少反问:患者为什么要来?他真正需要什么?只有站在患者的角度思考,不能只是盯着招募这一个点看问题。”

基于这个逻辑,捷信打造了三个产品,各有明确分工:

信募AI(智能患者招募平台):核心功能是AI病历解析与智能匹配、自动化患者筛选与随访、多中心协同管理。底层是本地化部署的大模型,对病历进行全自动AI脱敏,在严格保护隐私的前提下做入选标准的智能匹配。过去人工筛选一例病历需要数十分钟,现在1~3分钟完成。目前已服务100+国际药企,实现3-6个月加速入组。

新药之光AI(患者找临床研究平台):主要打通院外患者与研究中心之间的连接。核心功能包括AI智能推荐适合的临床试验、新药治疗方案个性化匹配、全球临床研究查询。目前已帮助50,000+患者,参与了90+新药上市。患者可以在线报名提交资料,AI初筛后智能匹配适合的项目并推送至研究中心,形成标准化、智能化的招募闭环。

找药神器AI(患者找新药平台,大众版):这是三个产品里设计最有创意的一个,核心入口不是”找临床试验”,而是”找药”。内置完整药品数据库,患者可以查药品信息、医保报销情况、用法用量、不良反应、药物配伍禁忌,还能查周边哪家医院或药店有售。当患者找不到合适的药时,系统自然引导他查看相关临床试验并报名。发展目标是月活100万+,覆盖50%下沉市场。

三个产品形成一个从底层到顶层的协同体系:数据层统一数据标准、AI层共享算法模型、服务层多方协同、价值层生态共赢。

孟庆华用”两条线”来说明整个设计逻辑:药品生命线是从临床试验→新药上市→医保/商保;患者需求线则是从对症找药→购药用药→找临床试验。这两条线方向相反,而且是断裂的。捷信要做的,就是用新药之光和找药神器把这两条线捏合在一起。

现场演示了找药神器的Demo:一个患者说”我想减肥,有什么减肥药推荐”,AI给出了司美格鲁肽和替尔泊肽的比较、副作用、医保情况等详细回答,最后引导用户查看相关GLP-1临床试验并报名。

孟庆华说,这个AI是经过专门训练的,在找药用药这个垂直场景里比豆包这类通用大模型强很多。

案例四:AI辅助DRS管理平台开发与逻辑核查智能审阅

主讲:张力弦,正大天晴临床数据部副总监

DRS(Data Review Specification,数据审核说明)规定了人工审核、程序核查、逻辑一致性检查的全套规则,是数据管理中关键但极其繁琐的文件。

正大天晴过去用Excel管理DRS,张力弦列出了四个痛点:列数极多难以管理;文件在分发传递中极易出错;版本控制靠人工、容易混乱;一个项目可能有几十上百个域,标准库和项目库叠加,导致工作表爆炸式增长。

他们随后和IT团队合作,开发了基于Web框架的DRS管理平台,但开发过程遇到了新的挑战:流程冗长响应慢,业务需求和产品之间存在偏差,而且DRS平台并非法规强制要求,不会获得最大人力支持。团队基本上是”一边学一边做”。

转折点是今年Claude Code等AI编程工具能力的大幅提升。张力弦做了一个现场演示:

首先让Claude Code读取整个项目代码库,充分理解现有架构;然后把具体需求提给它,比如做一个”操作历史卡片折叠”的前端功能,包括交互方式、语义化色彩展示、默认折叠显示等四个具体要求。Claude Code先生成一个Plan,双方交互确认之后,才开始生成代码。

“它这个书写速度非常快,当然我这里也加速了,在现实中也不会这么顺利。”张力弦坦诚说。

产品目前有四个主要模块:DRS草案管理、已核准并生效、新增草稿、审核流程。

现场展示的是一个真实运行中的系统,操作历史用语义化色彩标注,AI审核结果单独展示,分低风险(灰色)、中风险、高风险(红色标注),并给出具体的风险原因说明。

AI审核的逻辑是:每次DRS提交之后,系统调用后台大模型API,按照DRS规则文件对提交内容进行审核,输出风险判定。这不是”用AI写DRS”,而是”用AI帮人审核DRS”,本质上是把大语言模型的能力嵌入到业务系统中。

还有一个工程细节值得记录:为了节省token消耗,他们把规范文件单独整理,让模型直接读取,而不是每次都在对话中重复输入。

DM团队在测试过程中明确表达了认可,说比之前用Excel填写”提效非常多”。成本方面几乎是零,因为整个开发过程不依赖公司IT资源,是独立团队完成的。

他最后说了一段话:”当AI能力不断跃进之后,我们以后的价值可能更多体现在有没有能够产生有价值的idea。我也相信在未来,人人都是一个优秀的软件工程师。”

案例五:AI驱动的临床试验终点评估智能化升级

主讲:蔡秋爽,信华医药CTO

先说一个很少被公开讨论的数字:临床试验中,85%的量表评分依赖人的主观观察和陈述。大约30%的临床试验失败,与终点评估的噪音和误判直接相关。即使经过严格培训的专家,评分偏差也可能高达20%~30%。

这不是某个量表的问题,而是整个临床终点评估体系的系统性缺陷,只要有人脑参与,主观偏差就必然存在。

蔡秋爽说,神经科学领域是最典型的:阿尔茨海默症、抑郁症等CNS疾病,100%的判定都依赖人的主观判断。皮肤科、免疫科的目测评分,纤维化分级的病理切片判读,同样如此。这就带来了几个实际问题:专家之间评分一致性难以保证,推理路径不透明(只记录结果,不记录过程),人工审核时间漫长。结果是,申办方不得不花高额溢价请大量专家来做终点判定,但在大样本量下仍然难以控制偏差。

信华的切入点很特殊:他们手里有超过900个量表的版权授权和配套培训方案。这是做AI终点评估的基础,没有这些,计算机背景的人根本无从下手。

信华的解法是把各种临床数据(视频、音频、语义等)与评分标准做智能映射,输出可解释的评分结果,他们称之为”AI增强下的数字化终点评估”。

现场演示以帕金森病的MDS-UPDRS量表第三部分(运动功能评估)为例,展示了完整流程:

第一步:视频采集。用普通手机录制患者做标准动作的视频,完全不需要特殊设备。演示了UPDRS 3.4(手指敲击)和3.7(脚尖踩踏)两个条目。

第二步:关键节点提取。视觉模型从视频中提取骨骼关键点。以手指敲击为例,需要四个点:食指尖、拇指尖、手指与手掌的结合部、手腕。蔡秋爽特别解释了为什么需要手掌基部这个点:”我们需要手掌的长度作为归一化参数,因为视频里每个人的手大小不一样,你判断这个距离的大小,要根据手掌长度来归一化。”

第三步:波形图生成。对运动轨迹逐帧分析,提取幅度、速度、停顿等特征值,生成波形图。这一步是整个系统”可解释性”的核心:健康手指的波形规则稳定;帕金森患者的波形呈现”highly unstable amplitude”,幅度骤变且不规则,这直接对应了UPDRS的评分维度。

第四步:AI评分输出。基于大量临床专家打分的视频数据校准后,输出AI评分,并附上文字解释。评分不是黑盒,你能看到它为什么给出这个分数。

实测数据:速度提升10倍以上,成本降低约60%,准确率99%以上。

这套方案的底层逻辑是通用的:阿尔茨海默症的认知量表可以通过语音分析来做,皮肤科的目测评分可以通过图像分析来做,都是同一套框架。

案例六:数字孪生技术在临床试验中的AI应用实践

主讲:刘洋(Yang Liu),中外制药数字技术合作负责人(线上)

刘洋就职于中外制药株式会社(Chugai,隶属罗氏集团)东京总部,职务是Digital Technology Partnership Lead,聚焦Digital Biomarker、Digital Twin、医学影像AI分析、量子计算、XR/VR等方向。

刘洋用了一个分类框架来梳理数字孪生在医药开发中的现状。

数字孪生发展分三个阶段:静态的”数字模型”(无实时数据输入)、单向数据输入的”数字影子”(物理→虚拟,但无反馈控制)、以及物理与数字世界双向实时交互的真正”数字孪生”。目前医药领域大多处于前两个阶段。

在医药开发中,数字孪生有五大应用方向:虚拟临床试验、精准医疗、分子模拟、生产过程优化、化学合成优化。其中三分之一的应用集中在生产和过程优化,但这场论坛的重点是临床端。

刘洋重点梳理了两个方向:

方向一:临床试验与精准化医疗。有三个具体应用:虚拟参照组(用虚拟患者替代真实患者)、精准化剂量仿真(实时预测每个剂量的效果并动态调整)、以及治疗响应预测(持续监控疾病发展状况)。目前大约一半的相关临床试验处于”描述阶段”(用数字孪生描述虚拟患者或疾病发展),45%处于”预测阶段”(预测副作用或疾病进展),只有少数已获监管认可。

方向二:患者监测与公共健康。包括人口级别的健康预测与管理、个体化健康预警与风险分层、以及持续远程监测。结合可穿戴设备,这个方向已有真实落地案例,苹果手表的心房颤动预测功能已获FDA的SaMD(软件医疗器械)许可。

经同行评审的文献综合显示,数字孪生目前的”天平状态”:

已验证的收益:患者监测场景成本降低20-35%,试验周期缩短15-30%,合成对照组场景招募效率提升10-25%。

残余风险:60-70%的研究报告了训练数据代表性不足的问题;缺乏标准化质量指标,可复现性受限。

刘洋的结论是整场活动中最克制的一句话:”Digital Twins are ‘Adjunct-ready’(supporting decisions), but not yet ‘standalone’(replacing decisions).” 数字孪生已经准备好作为辅助决策工具,但还没准备好独立替代决策。

关于监管信号,他提到:FDA今年3月发布了关于替代动物实验的新指南,对数字技术展示出更宽容的态度;EMA在监管层面也在积极探讨AI与数字孪生的定位。

案例七:AI助力临床研究–IIT与RWS场景下的智能化实践

主讲:陈凯申,CinoCore CEO

最后一个案例跳出了注册研究的框架,聚焦于上市后研究(RWS)和研究者发起研究(IIT)。这是整个行业体量最大、增速最快、但数字化程度最低的领域。

过去五年,IIT和RWS研究数量已翻倍,2026年第一季度研究总量已达6600项,全年预计增速超过21%。他用三个词概括了这类研究与RCT的本质差别:目的性不同(不是为了上市,而是围绕临床问题和上市后观察);样本量更大(单个RWS研究的患者量往往比RCT还大);但资金量级不比RCT高,”不是往下的量级”。

数字化程度为什么低?RCT有GCP强制约束,数据质量有标准;但真实世界病历书写质量参差不齐,院内系统各不相通,院内院外数据割裂,新型检测数据(基因组学、影像等)散落在各处。CRC每天大量时间花在重复性数据采集上,”你也没有办法用纯人工去解决这样一个问题”。

CinoCore打造的平台叫EACY,全称是”Evidence generated through Agentic AI that delivers Compounding Yield”,定位是让每一个研究在AI帮助下”更加简单”,同时把每个完成的研究的数据资产沉淀下来,变成”可复利”的证据。

EACY的逻辑与REDCap形成对比:REDCap是”Human-led + One-off project database”,每个研究产生一次性数据库;EACY是”Agent-led execution + Compounding evidence asset”,高度自动化,且每个研究完成后数据反哺到疾病数据池,供下一个研究使用。

EACY的工作流分四个Agent层:

Multi-source Data Ingestion:连接医院系统里的结构化和非结构化数据(HIS、LIS、PACS、电子病历文本、PDF、图片等)。

Local De-identification & Governance:本地化部署轻量模型,在数据离开医院之前完成脱敏,保护患者隐私。脱敏后的数据才调用云端大模型或本地部署的大参数模型做后续处理。

Disease Data Pool & Schema Generation:基于研究者的自然语言需求,自动生成疾病特异性的数据Schema——研究者只需要告诉系统”我想研究什么、需要哪些数据维度”,系统自动生成数据结构。

CRF Mapping & Validation:自动将已有数据队列中的字段映射到CRF,优先复用,只有无法匹配的字段才落到人工采集。”很少很少的一部分,最后会落到人工去做数据采集。”

另一个关键设计是”多次跑取收敛”:大模型每次输出不完全一致,EACY通过多次运行、结果收敛的方式提升准确率。这是模型使用成本下降之后才变得可行的工程思路。

目前EACY已完成5个开放性临床研究,处理了超过10万个数据点位,数据填充准确率达95%。落地机构包括四川省肿瘤医院,入选了工信部与卫健委联合推动的AI医疗器械化项目。

陈凯申还展示了一个独特成果,CinoCore联合上海创智学院发布了AlphaEval评测框架,对多个主流AI agent在真实生产环境中的表现做了系统性评测,涵盖Claude Code、Codex、GitHub Copilot、Cursor等产品,维度包括H&LS在内的六个O*NET职业域。

他的结论很直接:”即使是最新的模型,在临床研究这个场景里,单独使用完成度也达不到预期。还是需要很强的工程化思考在里面,才能使模型的表现真正达到大家的预期。”

这也是为什么EACY不是简单调用API,而是构建了一套完整的多Agent工程体系。

从七个案例来看,这个积累已经在各个角落同时发生:

有人在啃方案撰写的标准化,有人在用数据识别真正有能力的研究中心,有人在试图让患者先找到药再找到研究,有人在让数据管理变成业务人自己能做的事,有人在让量表评分变得客观可复现,有人在把每一次真实世界研究的数据积累成可以复用的资产。

每一个环节,都有人在认真啃一块硬骨头。

向所有在AI临床试验链条上默默耕耘的人致敬。新药研发的终点,从来不是一张上市批文,而是那个等待了太久、终于等到这颗药的患者。

愿我们手中的每一个工具、每一行代码、每一次数据清洗,都能让这一天早一点到来。

本文根据现场录音及演讲材料整理,如有疏漏,欢迎指正。

👇

加入AI临床试验交流群

夜雨聆风

夜雨聆风