爆肝2天!搓了个Agent�� App,语音唤醒,还能视频通话,已免费开源~

大家好,我是袋鼠帝。

目前市面上大部分的龙虾都是通过打字去交互,即便能语音,那也需要用手按住说话。如果你想彻底解放双手,像唤起Siri一样随时呼叫龙虾干活,还能给龙虾打视频,那么这篇文章一定不要错过~

把龙虾(OpenClaw)做成钢铁侠里的贾维斯,会是一种什么体验?

比如这种随时待命的语音唤醒(只有叫龙虾,才会回复我)

还能跟它打视频

PS:我Mac上的龙虾刚装上,还没有装skill,就先不给大家展示太复杂的任务啦,但是如果你觉得这玩意儿跟豆包没区别就大错特错了

最近我一直在琢磨一个事儿:

虽然我在我的MacMini上部署了龙虾,但我在日常生活里使唤它的频率还是不够高。原因很简单,虽然已经接入了各种IM,但是入口还是麻烦。

我特别需要随时随都能跟它交流、给它派活,最好是类似小爱同学的语音唤起,口喷需求,彻底解放双手(让我在打游戏的时候都能给它派活),这样我的龙虾才能更快速进化。

不过,我找了一圈,实在没找到一套好用、成熟、又方便的多模态交互方案。

既然没有,那我就自己做一个!

于是,我决定搓一个手机 App,名字就叫 MobileClaw。

它有点像豆包,但跟豆包有两个本质的差异:

第一,MobileClaw 接入的是我本地的龙虾,功能可以高度定制化,还可以切换任意模型使用(以后还可以切换成 Claude Code、Codex 等等)。

第二,它不仅能看到摄像头的内容,还支持语音实时唤醒。我可以像叫 Siri 一样随时随地使唤它。

别再说跟豆包没区别了,区别大了,不过缺点是没有豆包响应快

没想到,折腾了2天,还真给我做成了!

最终的效果,是相当的 nice(见开头录屏)。

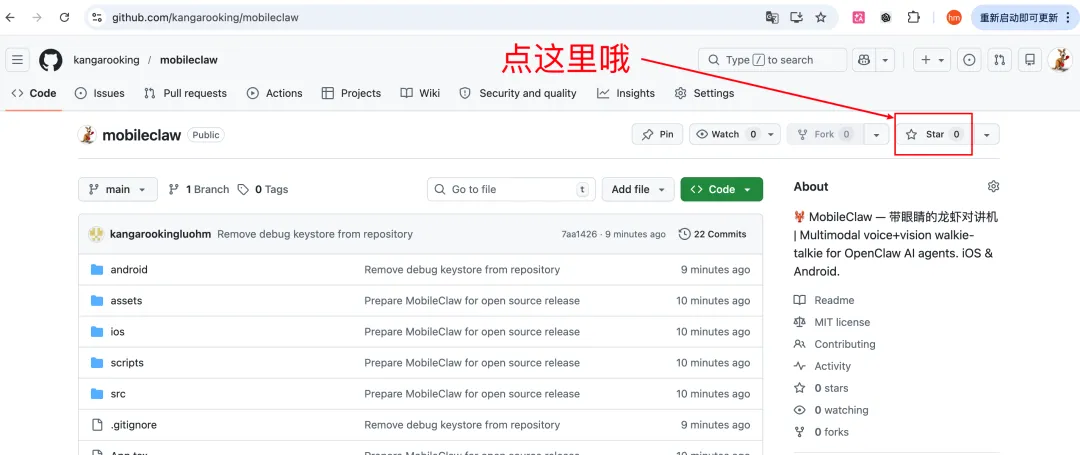

目前这个MobileClaw App我已经开源了,感兴趣,想玩的朋友可以自取~

https://github.com/kangarooking/mobileclaw

如果觉得有用,可以帮忙点个Star

一、 为什么是手机和语音视觉唤醒?

因为手机是我们每天触达率最高的硬件。

语音唤醒发任务,不仅能避免误触,还能彻底解放双手:

不管我是在敲键盘写文章、打 LOL、还是在厨房洗碗,只要我突然冒出一个需求,随时随地吼一嗓子:龙虾,帮我查一下今天的AI热点资讯,它就能直接在后台开干。

而且光有耳朵和嘴巴还不够,必须得给龙虾加上眼睛。

当我的龙虾具备识别当前物理世界环境的能力后,我跟它的沟通会更加方便,它也会更加了解我的所处环境,进而更懂我。

说白了,这个工具的第一阶段目标很简单:打造一个带眼睛的龙虾对讲机。

二、模型选择

龙虾模型选哪个呢?

目前要兼顾顶级的代码能力、Agent 执行能力,同时还必须支持强大的多模态视觉识别,国内原本能打的是前不久刚出的豆包2.0和 Kimi-K2.5

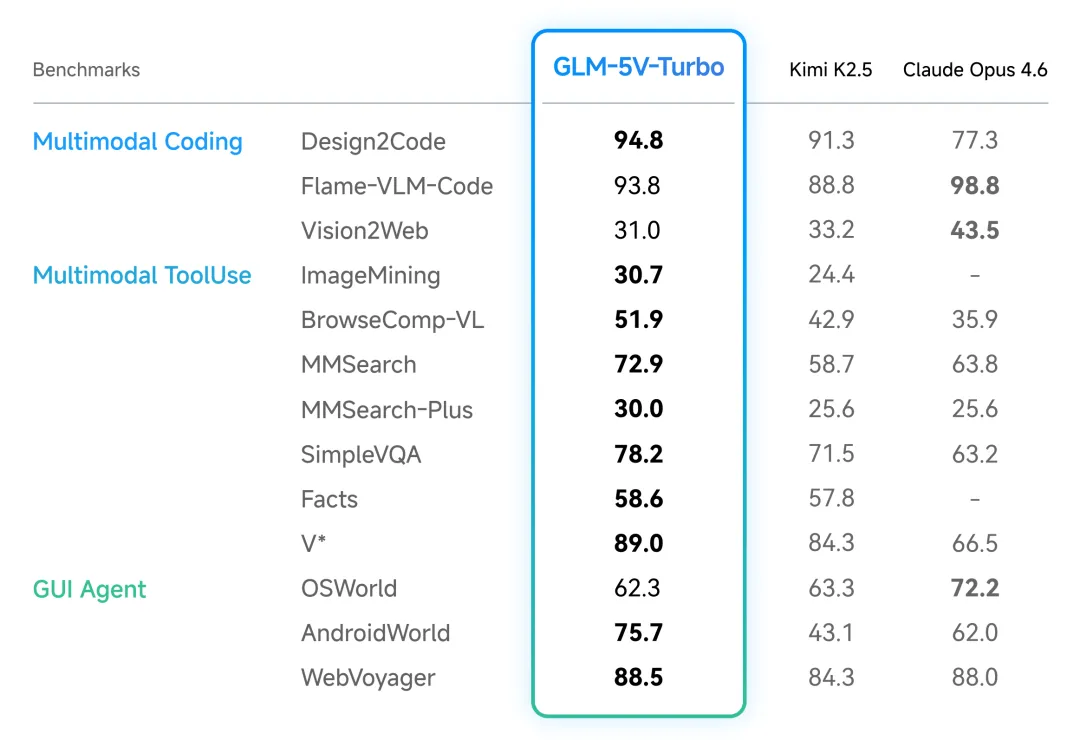

但我发现,智谱最近更新了一个模型,而且是专门针对龙虾和多模态编程环境深度训练过的专用基座模型:GLM-5V-Turbo

由于是Coding Plan的Max会员,又是个小破博主,所以我幸运的提前拿到了内测资格

终于,智谱的旗舰模型带视觉能力啦!!

我看了一下它的参数和性能跑分,这玩意儿有点猛啊

不仅在逻辑推理和工具调用上稳如老狗,而且从预训练阶段就深度融合了视觉能力,真正做到了看得懂画面、写得好代码、控得了龙虾。

文章开头大家看到的那个丝滑的多模态交互效果,背后就是靠接入 GLM-5V-Turbo 的龙虾完成的。不得不说,确实有东西。

甚至 MobileClaw 这个 App 项目本身,都是我用 Claude Code 配合 GLM-5V-Turbo 开发的。

三、过程实录:一图胜千言

虽然 GLM-5V-Turbo 的代码能力很强,但由于我完全没搞过 iOS 和安卓的原生开发,整个折腾的过程还是踩了不少坑,花费了挺多时间的。

接下来,我想给大家分享一下这次曲折的开发过程,希望对大家有所帮助。

整个开发流程我使用的是,接入 GLM-5V-Turbo 的 Claude Code (下文简称 cc)。

这里我用到的是cc-switch来帮我一键切换模型

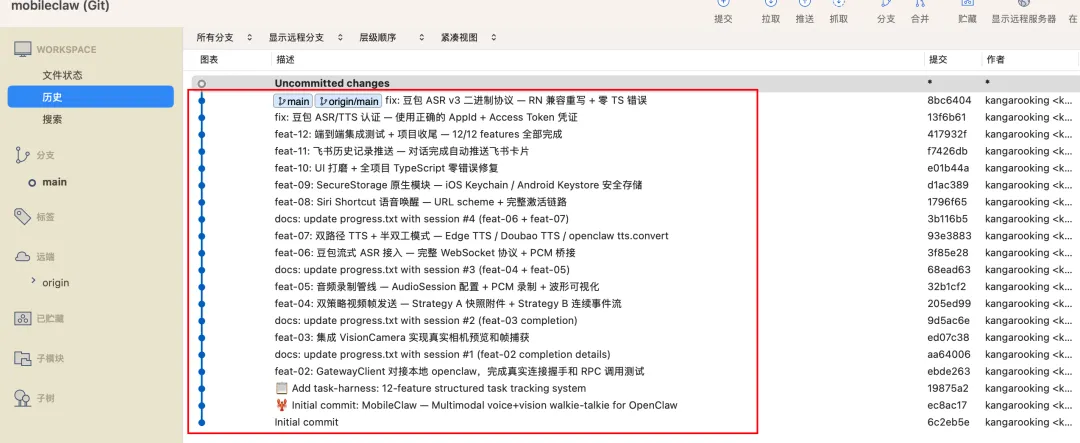

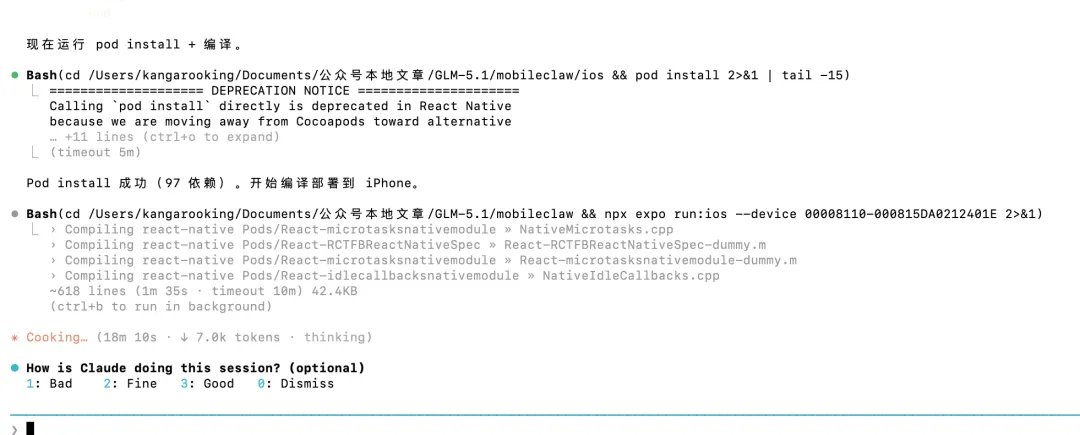

首先,还是老方法,我大致整理了一下我的核心需求,然后给 cc 开启了 Plan 模式,把需求一股脑甩了过去。

cc 上网查阅了大量的移动端开发文档后,给我列出了一个非常详细的跨平台开发方案和架构计划。

当然,这个过程中它会像个真实的产品经理一样,抛出几个问题让我确认。

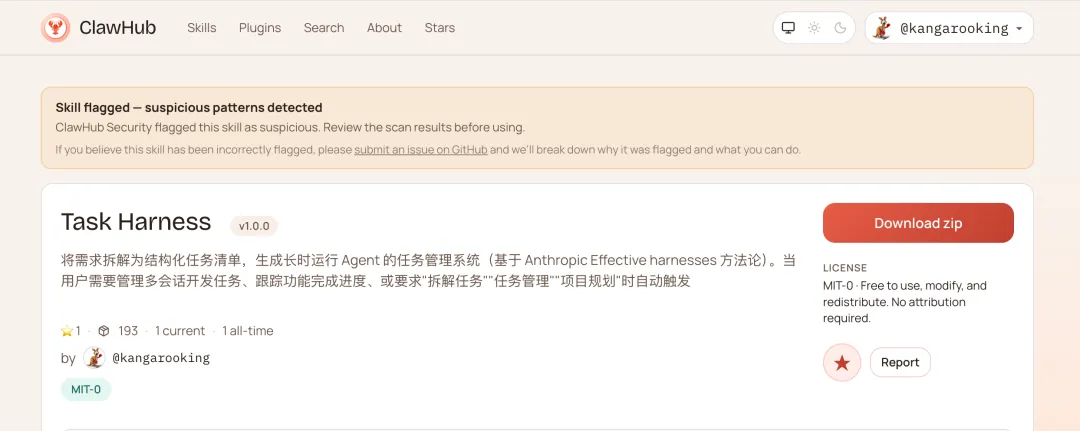

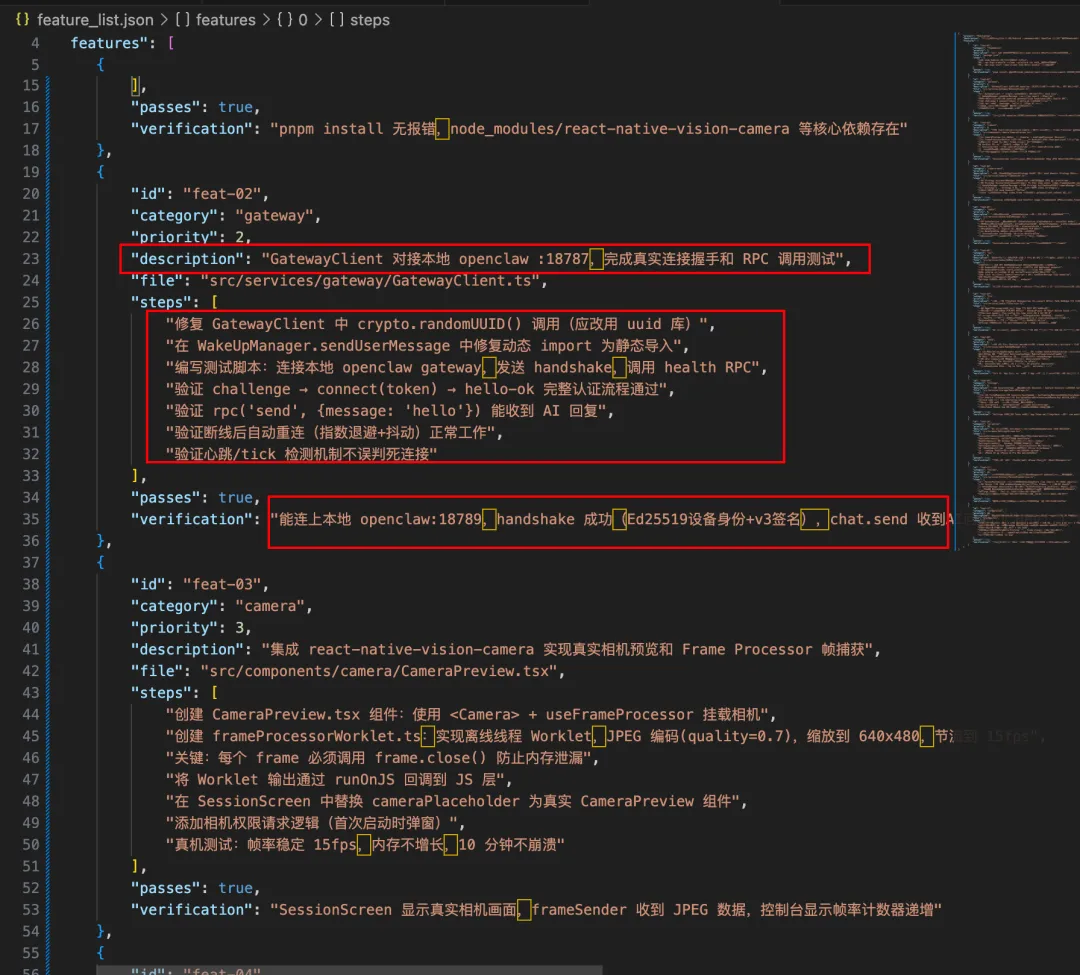

然后,前期开发流程的主角登场了,也就是我之前开源的skill:Task-Harness。

https://clawhub.ai/kangarooking/task-harness

在 Harness Engineering这个概念还没真正火起来的时候,我就已经把它开源了。专门用来解决 AI 执行长任务时容易跑偏或者遗忘上下文的问题。

是我在之前的一篇文章里开源的,当时我是把它交给龙虾使用,让龙虾做监工,去监督 Claude Code 自动完成复杂的长任务(感兴趣的朋友可以看看下面这篇)。

让龙虾当监工,监督cc干活儿

袋鼠帝,公众号:袋鼠帝AI客栈全球首款龙虾模型上线!Agent这波直接起飞了~(夹带干货)

Task-Harness Skill有两个优点:

一个是可以在获得授权后,自动帮我在 GitHub 创建仓库并初始化环境;

另一个是能把庞大的长任务拆分成无数个极小的独立任务,并使用 JSON 文件来精准管理任务进度。

每完成一个小任务,它会自己跑测试验证,验证成功后自动提交 Git。

整个开发流程一清二楚:

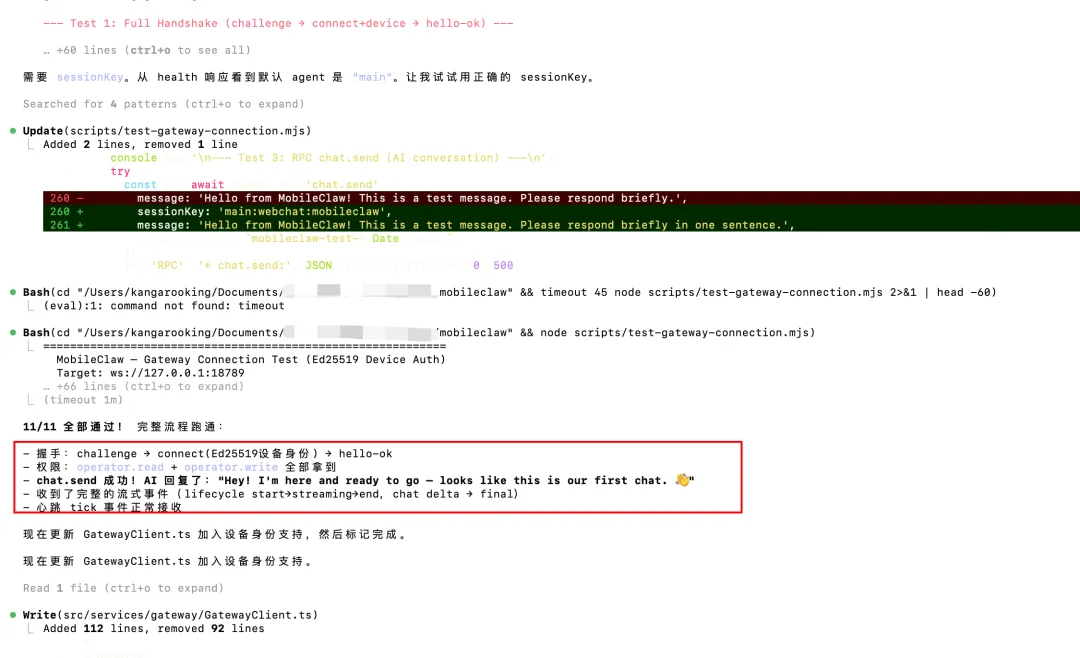

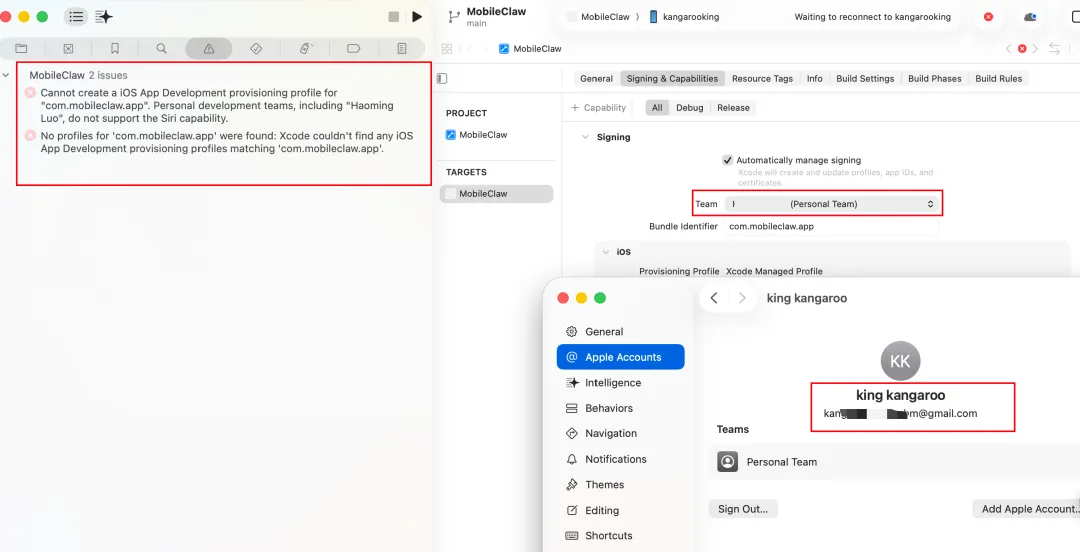

然后靠着glm-5v-turbo顺利完成了前期的开发、测试工作

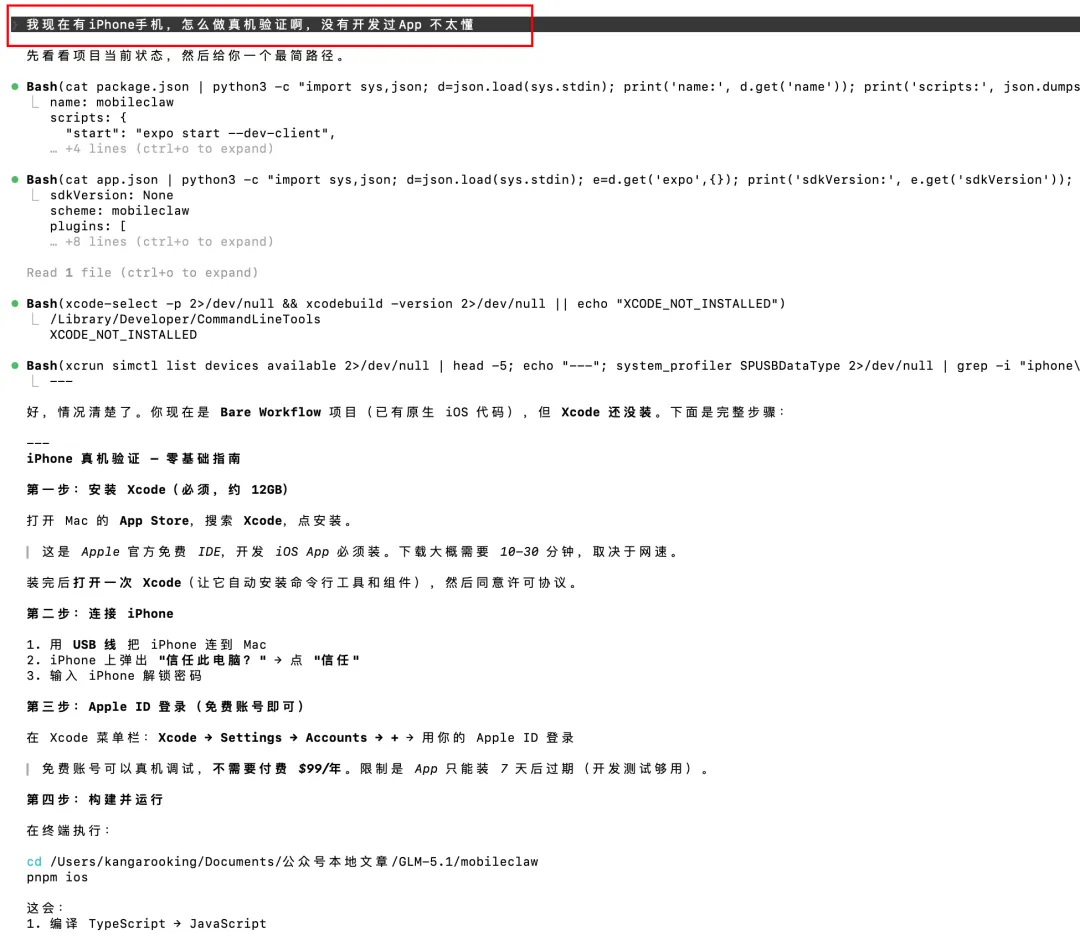

不过这次开发 MobileClaw,代码本身并不是耗时最久的,坑最多的是环境配置(我是先做的iOS)。

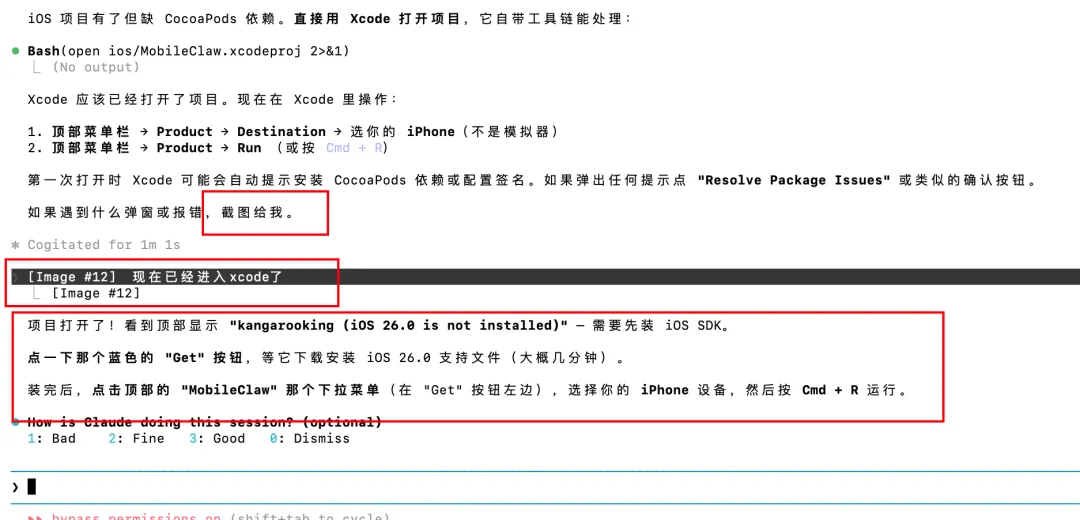

比如怎么把写好的代码顺利编译进 iPhone 真机里去调试?

glm-5v-turbo给我的建议是使用xcode,但是我的Mac有点旧版本不支持最新的xcode,它又帮我去找适配的旧版本xcode安装。

还有苹果那个让人头疼的开发者账号,我一开始使用的是国区的AppId,跟我说没有开发者资格?… 没法跟xcode连接。

后面换成了我的美区AppId才成功

本来我想交 99 美元的开发者账号年费,它死活就是不给我消费…服了

总之在编译和真机调试这个问题上,我耗费了大量的时间。

不过,在这个极其痛苦的排错过程中,GLM-5V-Turbo 的原生视觉能力优势被展现得淋漓尽致。

它看到画面后,会直接教我怎么操作xcode

遇到 Xcode 里那些极其反人类的配置界面、不知所云的弹窗报错(报错甚至没法复制…)。我只需要截个图,ctrl + v 直接丢进cc的对话框里glm-5v-turbo,就能准确识别并解决问题。

真的是一图胜千言~

最终,在glm-5v-turbo的手把手视觉指导下,我终于是成功把 MobileClaw 安装到了我的手机上。

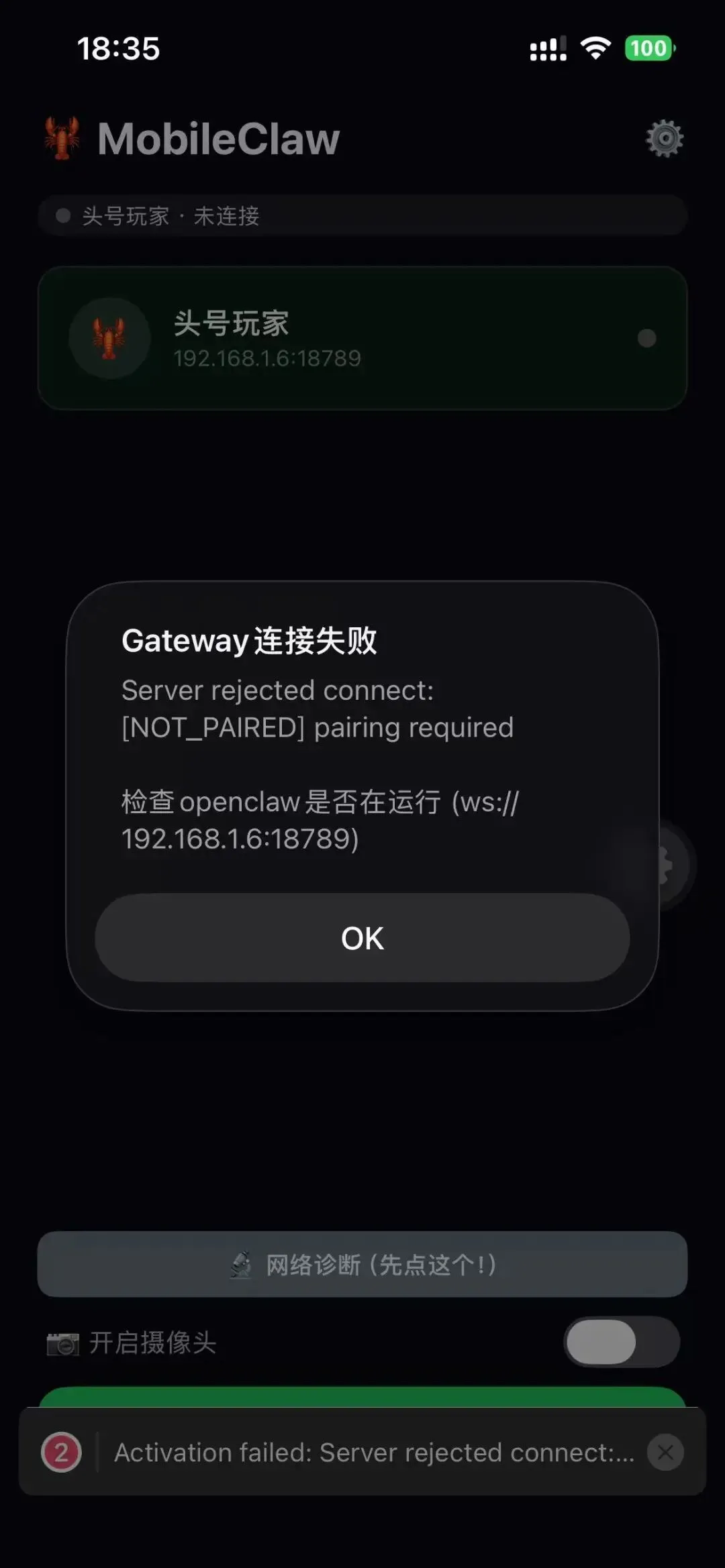

这里还有一个坑需要注意:我的龙虾和cc 开发的代码都是在我本地电脑上跑的,在开发阶段它们通过本地地址(127.0.0.1)就能顺利通信。

但当 MobileClaw 安装到手机里时,它们变成了局域网通信(同一个WiFi)。

这时候需要去检查防火墙,并开通双方的网络访问权限,否则连不上。

在解决了一堆环境、网络、配置的破事,以及真机调试发现的部分Bug后,我的需求终于落地了。

其实一开始,这 App 长得特别狂野,纯纯的程序员直男审美。

后来经过 GLM-5V-Turbo 的两轮视觉重构和样式调整,页面才逐渐变得美观起来。

四、架构揭秘与多模态流转逻辑

给大家简单拆解一下这个 App 的工作原理。

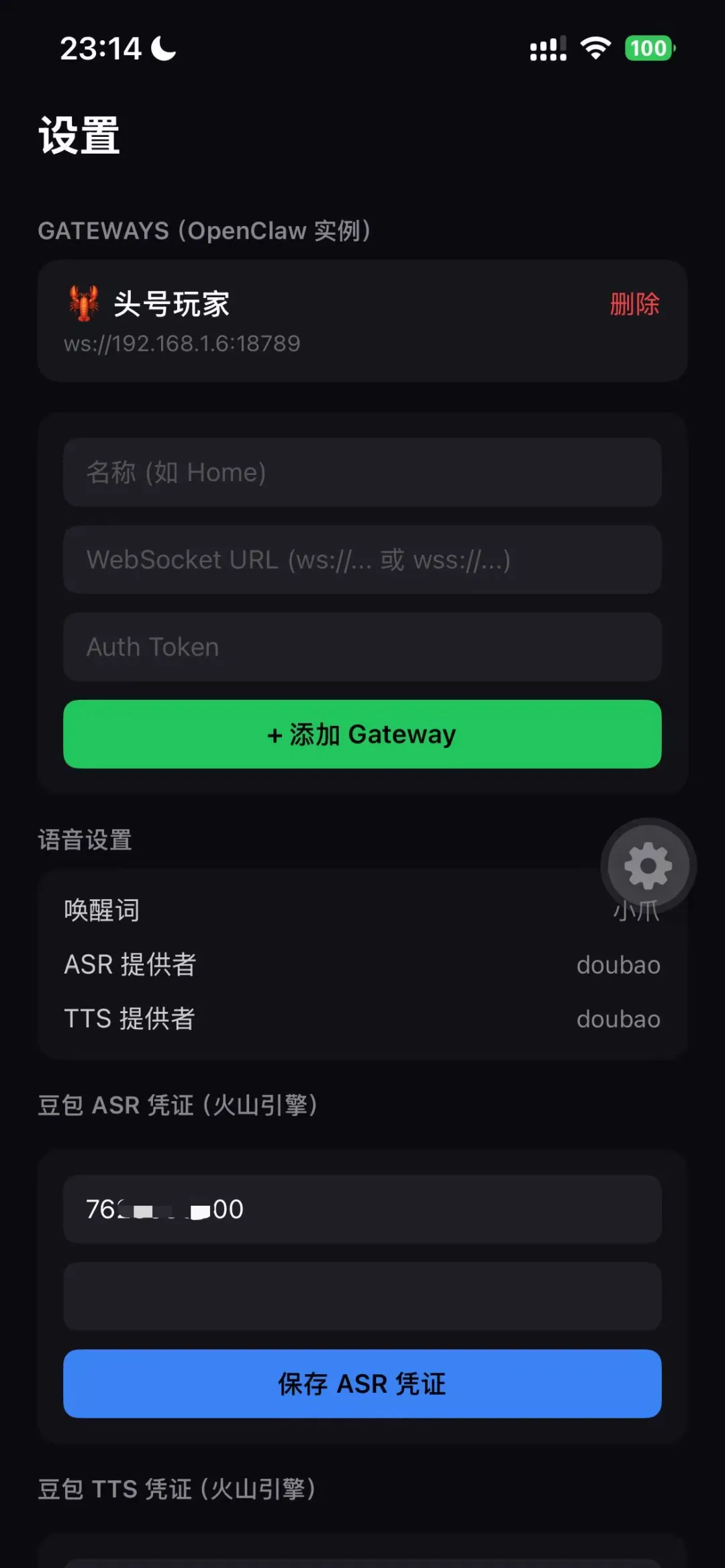

App跟openclaw的交互是通过websocket连接。

语音这块,我接入的是豆包的 ASR(语音转文字)和 TTS(文字转语音)接口,响应极快。

然后有唤醒词匹配逻辑,比如唤醒词设置”龙虾”,只有我说:”龙虾,帮我xxxxx”,它才会把任务发送给OpenClaw。就跟用Siri,用小爱同学的方式一样。

视频这块的逻辑,我是这么设计的:

从用户说出唤醒词开始,到语音指令结束,系统会在后台获取这段时间内的视频流。

但我不是把每一帧画面都传给大模型,那样太费钱也太慢了。我做了一个抽帧处理,只获取间隔连贯的几张关键帧,最多保留 7 帧(这个数量可以自定义)。

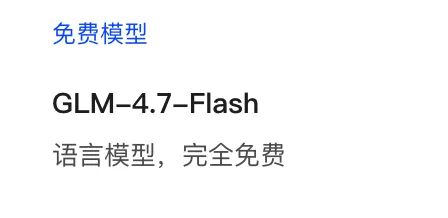

然后,我内置了一个速度极快的免费云端小模型(智谱的GLM-4.7-Flash),专门用来做前置的意图识别。

如果用户刚才说的话里包含了看一眼、这是什么、分析一下屏幕等明显的视觉识别意图,App 就会把这 6 帧图片连同语音转好的文本,一起打包传给后端的龙虾(也就是 GLM-5V-Turbo)。

如果用户的指令只是一句帮我设个闹钟,意图小模型判断不需要视觉辅助,就不传图片,直接释放掉内存里的那些关键帧。

这种按需调用的机制,可以极大节省带宽和算力成本。

这种多模态的实时交互体验,太科幻了。

特别是以后,我进入对话模式,它可以一直监听我的输入,不管我在开车,还是在打游戏,还是在躺着,我都可以直接呼叫:”龙虾!帮我xxxxx”,真爽~

而且我发现glm-5v-turbo真的成为了我的龙虾首选模型:

过去的国产大模型往往有些偏科,代码厉害的看不懂图,看图厉害的代码又不太行。智谱在 5V 上确实把这两点平衡得非常好,这让它在视觉编程和一些视觉拓展的玩法上,能带来特别多新鲜有趣的体验。

甚至用MobileClaw App,还能直接开摄像头提问,贼方便。

折腾这个项目的过程中,我发现了久违的创造的乐趣,它让我感到非常兴奋。

当这个能看、能听、会说的贾维斯🦞真正跑通的那一刻,那种成就感油然而生,非常爽。

现在,我终于可以一边操作卡兹克在LOL的大乱斗里疯狂K头,一边呼叫旁边的手机唤醒龙虾,去帮我找今天的爆款选题,写成文章,排版,并发布到公众号草稿箱,做好了叫我,我来审阅。

就有点像钢铁侠里面的贾维斯一样。

虽然目前这个 App 的功能还不够完善,部分功能还很粗糙。

但底座已经搭好了,后续我还会不断优化,让它变得更顺手,哦不顺嘴~

当我们把 AI 从冰冷的服务器终端解放出来,装进我们每天随身携带的手机里,再赋予它眼睛、耳朵、嘴巴,随时随地唤醒。

我觉得这才是 Agent 真正走向个人普及的必经之路。

我也非常期待脑机接口普及的那一天,让心之所向真正化作意之所达。

我是袋鼠帝,一个致力于帮你把AI变成生产力的博主。我们下期见~

能看到这里的都是凤毛麟角的存在!

如果觉得不错,随手点个赞、在看、转发三连吧~

如果想第一时间收到推送,也可以给我个星标⭐

谢谢你耐心看完我的文章~

夜雨聆风

夜雨聆风