当AI学会“打腹稿”:循环思考如何让大模型真正触达推理?

如果大语言模型的知识是一座图书馆,那么它最擅长的就是快速查找单本书。但它却常常在需要串联几本书完成一份研究报告时,陷入沉默。2026年4月9日提交的一篇预印本(arXiv:2604.07822)试图为它安装一个“思维循环”引擎,让AI学会在内心里反复推演,直至找到答案。

我们常常惊叹于大语言模型(LLM)的博闻强记,它能瞬间告诉你珠穆朗玛峰的高度,或复述莎士比亚的十四行诗。然而,一旦你抛出一个需要几步简单推理的问题,比如“张三的父亲是李四,李四的哥哥是王五,那么王五和张三是什么关系?”,模型的回答就可能开始闪烁其词,甚至胡言乱语。

这并非因为它“不知道”这些关系,而是因为它不擅长组合已知的知识。来自俄亥俄州立大学的Harsh Kohli等研究人员,将这种在单次前向传播中组合知识与规则的能力,称为“隐式推理”。他们发现,这正是当前Transformer架构大模型的阿喀琉斯之踵。模型记住了海量“原子事实”,却难以将它们像乐高积木一样拼接起来,去解决一个从未见过的具体组合的新问题。

那么,如何教会AI这种“组合思维”?Harsh Kohli等人的答案出奇地简洁:让模型学会“打腹稿”。他们提出的“循环深度Transformer”,其核心思想就像我们人类面对复杂问题时的思考过程——不是一蹴而就,而是反复琢磨,在内心进行多次迭代推演。

从“翻书”到“推演”:循环架构的思维革命

要理解这项工作的突破,咱们得先看看标准Transformer是怎么“思考”的。你可以把它想象成一个固定深度的流水线。输入问题(比如“张三的父亲是谁?”)从流水线入口进入,经过一层又一层固定的处理(注意力机制、前馈网络),最终在出口吐出答案。每一层都有自己独特的参数,负责提取不同层次的特征。这种架构擅长模式匹配和记忆检索,就像一台高速翻页机,能在庞大的记忆库中快速定位信息。

但它的瓶颈也在于此:流水线的深度是固定的。一旦问题需要比流水线层数更多的推理步骤,模型就无能为力了。更关键的是,每一层只“专精”于处理特定抽象层次的信息,缺乏反复咀嚼同一信息、进行多轮迭代计算的能力。这就像只允许你读一遍题目就必须交卷,没有回头检查和逐步推导的机会。

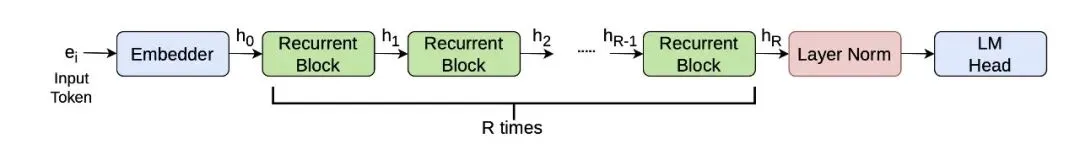

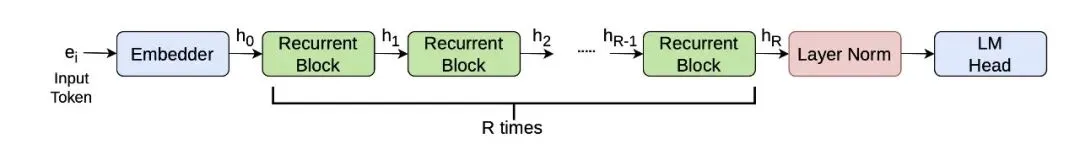

Harsh Kohli等人提出的“循环深度Transformer”,则彻底改变了这个范式。他们设计了一个包含若干层(比如4层)的Transformer基础块。关键创新在于,在推理时,这个基础块可以被重复使用多次。输入首先进入这个块,产生一个中间表示;这个表示不是直接输出,而是重新送回到同一个块的起点,开始第二轮处理;如此循环往复,直到达到预设的循环次数。

这相当于为模型安装了一个“思维循环”的引擎。模型不再是一次性通过一个很深的静态网络,而是在一个相对浅但可循环的“思考室”里,对问题进行多轮迭代加工。每一次循环,都可以看作是对问题的一次深化理解或一次推理步骤的推进。计算量(循环次数)可以根据问题的复杂度动态分配,简单问题少想几轮,复杂问题就多琢磨几遍。

然而,让同一组参数反复工作,面临一个巨大的技术挑战:训练稳定性。如果初始化不当,多次循环可能导致信号爆炸或消失,模型根本无法学习。研究团队巧妙地采用了零初始化策略,将关键矩阵初始化为零,使得在训练开始时,无论循环多少次,模型都近似一个“恒等映射”,即输出几乎等于输入。这为稳定的梯度传播和有效的学习奠定了基础,是模型能够稳定“打腹稿”而不至于思维混乱的关键。

“顿悟”时刻:从死记硬背到真正推理

有了新的“思考引擎”,模型的表现如何?研究团队设计了一个精妙的“知识图谱推理”测试来检验。想象一个微型社会关系网络,里面有2000个人(实体)和200种关系(如“父亲”、“同事”)。模型的任务是回答诸如“A的父亲的同事是谁?”这样的两跳推理问题。

实验设置了两个关键测试场景:一是“分布内”测试,问题中涉及的关系和人在训练中都见过,只是组合方式是新的;二是更具挑战的“系统性泛化”测试,问题中涉及的基础事实(如“A的父亲是B”)本身在训练中就从未出现过,要求模型必须将完全陌生的知识组合起来。

结果令人印象深刻。标准的4层Transformer(相当于循环次数为1)在系统性泛化测试上一败涂地,准确率为零。它完全无法处理未见过的原子事实组合。然而,哪怕只是将同一个4层块循环使用2次(R=2),模型就开始展现出非平凡的泛化能力。当循环次数增加到4次(R=4)时,模型不仅能泛化,学习收敛速度还大大加快。

更引人入胜的是模型学习过程中的“顿悟”现象。研究人员通过“Logit lens^[1]”等技术窥探模型内部,发现其掌握推理的过程并非平滑渐进,而是呈现清晰的三段式戏剧性转变。

[1] Interpreting GPT: the logit lens, https://www.lesswrong.com/posts/AcKRB8wDpdaN6v6ru/interpreting-gpt-the-logit-lens

最初是死记硬背阶段:模型拼命记住训练集中的所有问题和答案对应关系,在训练集上表现完美,但毫无泛化能力,就像学生靠背题来应付考试。

接着,经过长时间看似停滞的训练后,模型突然进入了分布内泛化阶段:它开始能正确回答那些由已知事实构成的新组合问题了。内部状态分析显示,此时模型已经学会了第一步——可靠地推断出中间实体(“桥实体”,如例子中的“父亲”是谁)。

最后,在分布内泛化近乎完美之后,真正的系统性泛化能力才姗姗来迟。模型内部形成了完整的分步推理机制:先解码桥实体,再利用这个结果去解码最终答案。系统性泛化,只诞生于这种内在的、分步的推理机制形成之后。标准Transformer之所以失败,正是因为它即便偶尔能猜出桥实体,其深层网络也缺乏对完全陌生事实的有效编码,无法完成推理链条的第二步。

思维的弹性:从学会规则到无限外推

如果说两跳推理考验的是组合的基本功,那么“深度外推”挑战的则是思维的弹性与扩展性。这关乎一个更根本的问题:如果模型只在较简单的问题(例如最多5步推理)上训练过,它能否通过“多想想”(增加推理循环次数),来解决复杂得多(例如20步推理)的问题?

这就像只教了小学生加减乘除,然后给他一道需要连环套用这些运算的复杂应用题,并允许他打更多草稿。他能做出来吗?

Harsh Kohli等人的研究给出了乐观但附有条件的答案。他们发现,增加训练时的“思考轮数”上限,能直接提升模型可学会的推理深度。一个被允许在训练中“思考”8轮的模型,比只能“思考”5轮的模型,能掌握更深的递归问题。

而最佳的“训练策略”并非固定轮数,而是动态轮数——在训练时,每个问题分配的思考轮数随机变化(例如从泊松分布中采样)。这模拟了现实世界中我们无法预知每个问题需要多少思考量的情况。动态策略让模型变得更具适应性,最终能达到的可学习推理深度,甚至超过了任何固定轮数的策略。

最关键的发现在于推理阶段。当使用与训练时相同的循环次数去处理更复杂的问题时,模型基本都会失败。但是,如果允许模型在推理时“多花点时间思考”——即增加循环迭代次数——其处理复杂问题的能力便立刻得到扩展。迭代次数越多,能攻克的任务复杂度就越高。这证明了循环深度架构赋予了模型一种宝贵的属性:通过增加计算量(思考时间)来换取对更复杂问题的处理能力,即一种“计算-性能”的缩放效应。

当然,思考并非越多越好。研究也观察到了“过度思考”现象:当推理迭代次数超过某个最优值后,性能不升反降。就像我们纠结于一个问题太久,反而可能钻牛角尖、离正确答案越来越远。模型预测正确时的置信度(通过Logit差值衡量)会随着无效迭代的增加而逐渐衰减。为此,团队还设计了一套自适应停止机制,通过监控输出分布的变化和预测置信度,让模型自己决定“想明白了,可以停笔了”,从而智能分配计算资源,提升效率。

值得注意的是,研究者在早期实验中曾观察到一种“捷径效应”:模型有时看似解决了极深(如80步)的推理问题,但通过精细的内部状态分析发现,它只是学会了从问题末尾的几个关系词直接“猜”答案,而非真正执行多步推理。这提醒我们,评估模型的推理能力,必须穿透表面准确率,洞察其内在的思考路径是否扎实。

通往真正智能的阶梯

这项名为《循环、思考与泛化(Loop, Think, & Generalize: Implicit Reasoning in Recurrent-Depth Transformers)》的研究,其意义远不止于提出一个新模型架构。它像一台精密的思维显微镜,让我们得以窥见大语言模型从“记忆大师”迈向“推理者”过程中,内部发生的艰难而奇妙的转变。

它揭示了一个核心原理:真正的组合泛化能力,并非源于更多的参数或更深的静态网络,而是源于一种能够进行迭代、循环计算的内部过程。循环深度Transformer提供了一种优雅的实现方式,让模型能够将固定的参数转化为动态的、与问题复杂度相适应的计算过程。

这为未来AI的发展指明了一条道路。与其无止境地堆叠参数和层数,不如思考如何赋予模型更灵活、更高效的内部计算范式。让AI学会根据问题的难易,自主分配“思考深度”,在需要时进行反复推演,这或许才是实现稳健、可靠推理能力的关键。

当然,这项研究是在高度受控、结构化的“玩具”任务中进行的,抽象掉了自然语言的诸多复杂性和噪音。将其原理应用于海量数据训练的真实大模型,并处理开放域的复杂推理,仍是巨大的挑战。但毫无疑问,Harsh Kohli等人的工作,为我们理解并塑造机器的“思考”方式(AI可解释性问题),打下了基础。

当AI不仅拥有知识的图书馆,更拥有一间可以反复踱步、推演、打腹稿的“思考室”时,我们离真正理解智能的奥秘,或许就更近了一步。

参考文献

Loop, Think, & Generalize: Implicit Reasoning in Recurrent-Depth Transformers, arXiv:2604.07822, https://arxiv.org/abs/2604.07822