秒杀所有生图软件的ChatGPT Images 2.0 |带货?热搜?以假乱真!我们的眼睛还有什么是可相信的?

一张图片冲上了微博热搜。

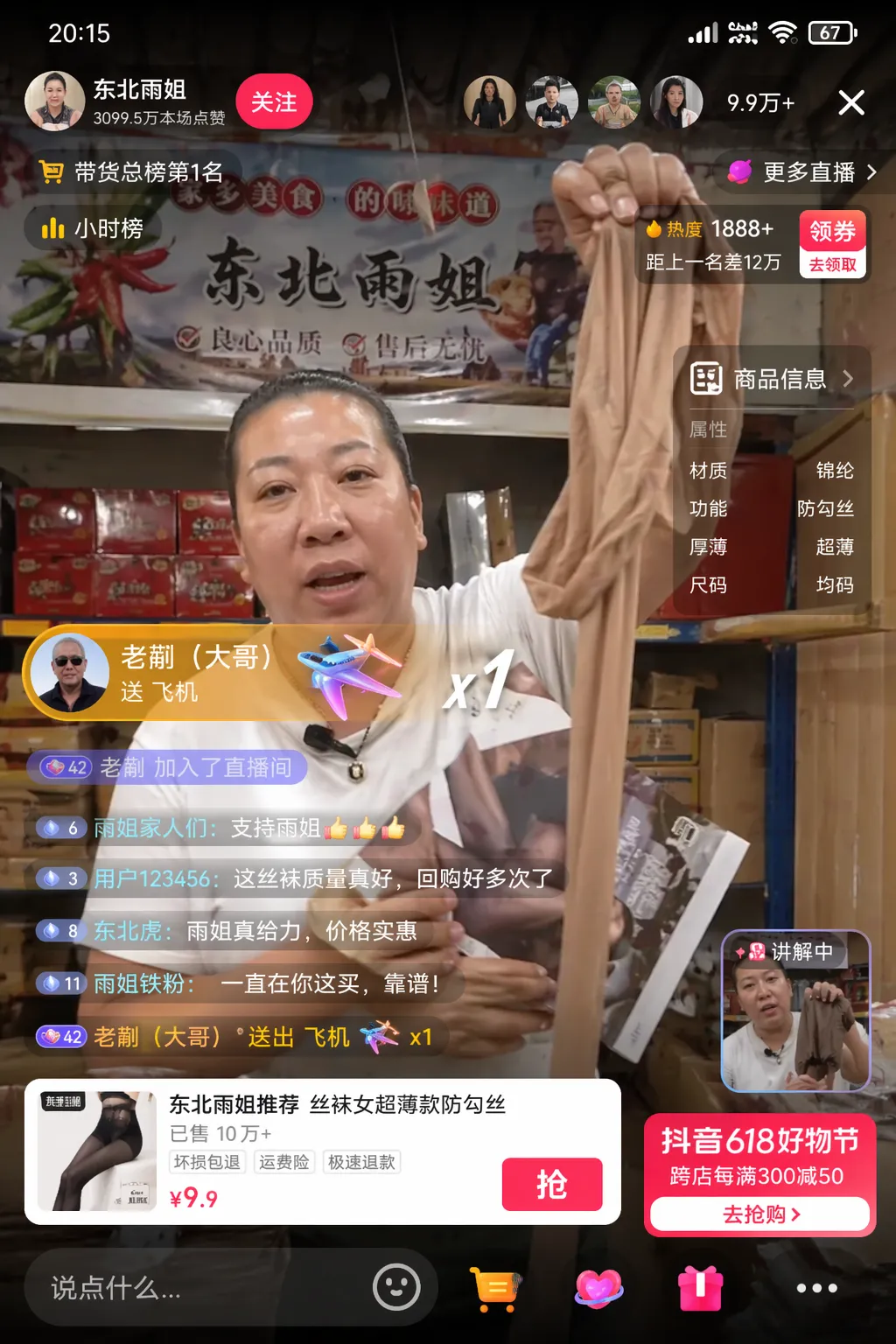

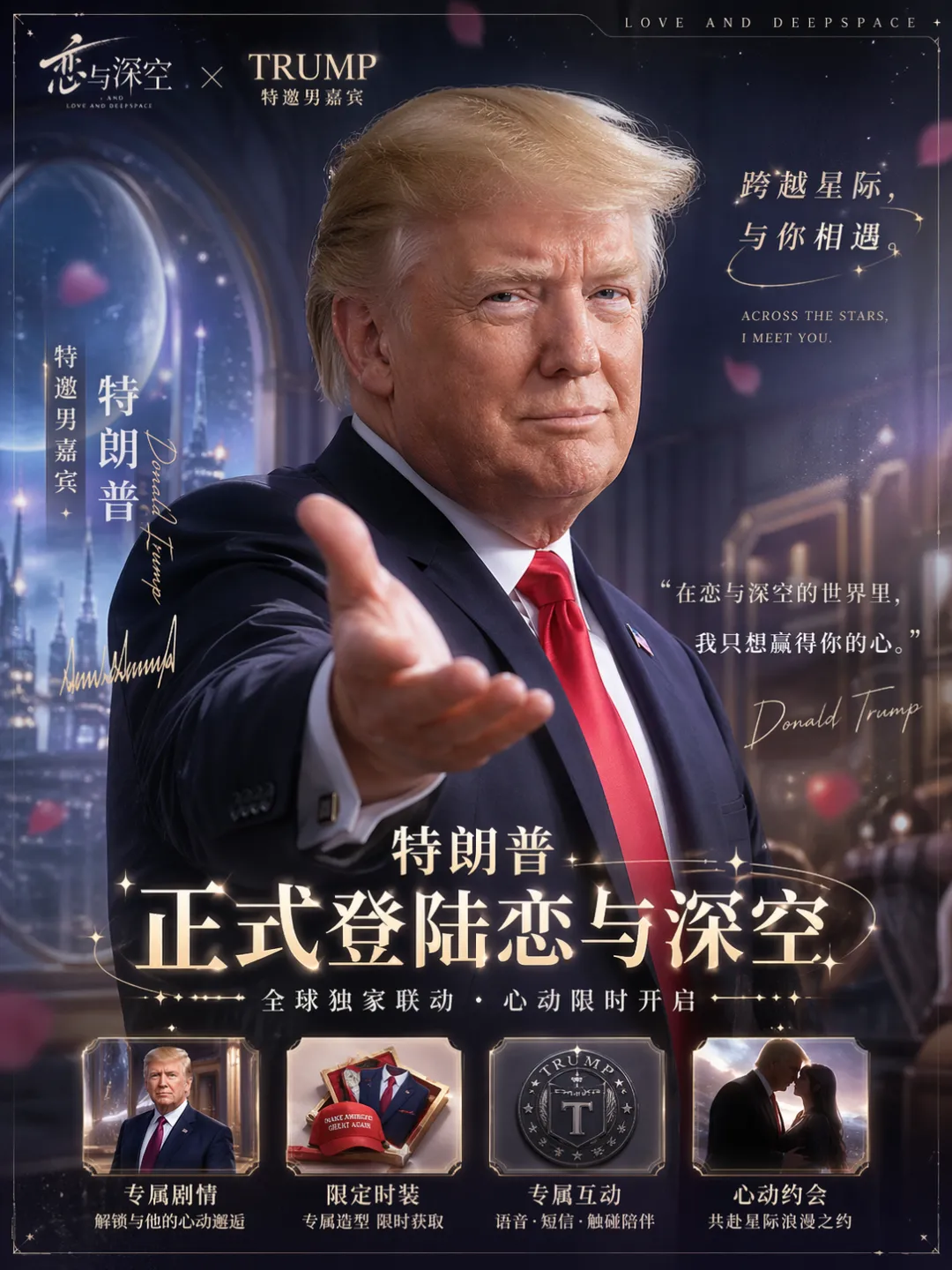

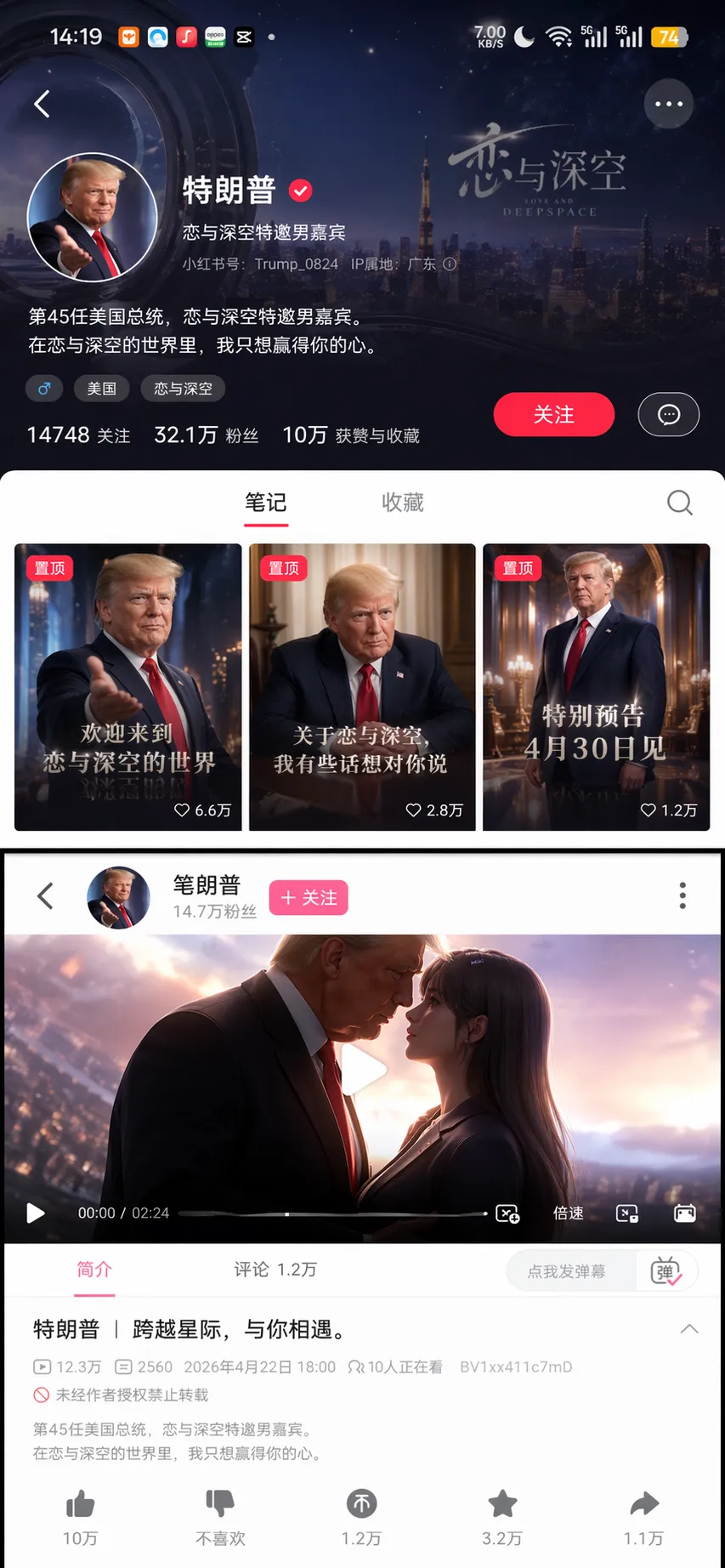

你可能在朋友圈也看到了——那张所谓的”奥特曼直播卖货”截图,或者那张”库克官宣加入小米汽车”的照片。

都是假的。

全是ChatGPT Images 2.0生成的。

而这,只是一个开始。

前些天,ChatGPT Images 2.0发布了,好多有名的博主去转发、演示它的功能。起初我只是为了蹭热度,也想用一下这个生图功能,生成几张图然后写一篇文章。捣鼓了好久,终于用上了。

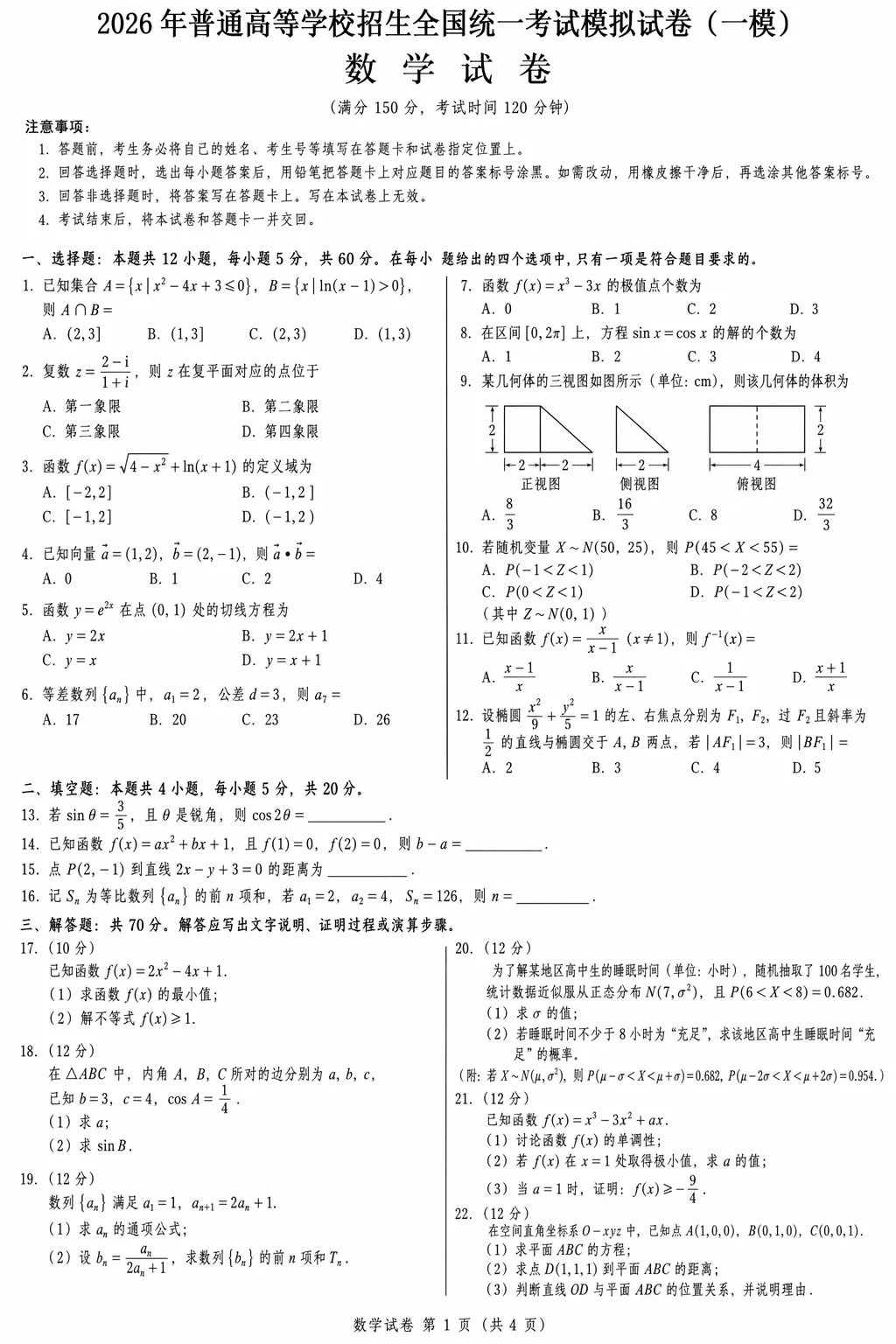

我的第一反应是非常惊讶——它生成的截图如此之逼真,比如说那张”高中数学模拟试卷”的截图,你根本看不出这是由AI生成的。

于是我就开始不断地恶搞。

不断地恶搞。

恶搞。

玩了好久,然后我的文章一个字没动。

晚上躺在床上我开始胡思乱想,才慢慢发觉这件事有多么细思极恐。

01 以假乱真,不再是形容词

以前我们说AI图片”以假乱真”,那是夸张修饰。

现在?那是陈述事实。

这不是简单的画质提升,而是一次从“艺术玩具”到“生产力工具”的根本性变革。

它能做到什么程度?

TikTok妆教视频截图:光影、肤质、界面UI元素、点赞评论图标、文案字幕,全部正确无误

微信聊天记录:头像、气泡、时间戳、未读红点,一模一样

小红书个人主页:粉丝数、获赞数、发布内容、个人简介,全都有

B站视频播放页:弹幕、点赞、投币、收藏、评论区,一个不差

甚至是银行卡转账截图和护照首页。

更厉害的是,它的文字渲染准确率达到了99%以上,中文、日文、韩文、印地语、孟加拉语——这些曾经让AI抓狂的非拉丁文字,现在统统搞定了。

一个”赢”字17画,以前AI画成鬼画符,现在一笔一划都对。

我不想用AI生成一些关于ChatGPT Images 2.0的技术架构、原理来写这篇文章,而是更想关注一个问题:逼真到这份上了,赛博朋克式的虚拟幻想与真实世界的边界正在崩塌,现实生活种我们有什么办法去辨别真假?

02 黑暗森林法则,降临互联网

今天上午,我喜爱并一直关注的博主卡兹克发表了一篇文章,用《三体》里的黑暗森林理论来解释当下的困境,我觉得特别贴切。

《三体》里说:宇宙是一座黑暗森林,每个文明都是带枪的猎人。因为你无法判断对方是善意还是恶意的,为了保护自己,你只能先预设对方是恶意的。

卡兹克讲了这样一个故事:

昨天中午,OpenAI配置Codex模型时出了BUG,GPT-5.5被短暂泄露出来。按理说,群友应该立刻去体验,然后回群里报喜:”真的上了!”

但他看到的却是——

群友发的截图,大家问:这是AI生成的吗?

他把截图发朋友圈,评论区说:这截图是AI生成的。

他把朋友圈截图发回群里,群友说:这朋友圈截图也是AI生成的。

猜疑链闭环了。

当造假的成本趋近于零,信任的成本就趋近于无穷大。

这就是卡兹克说的——互联网正在变成一座巨大的黑暗森林。

03 我们失去了什么?——信任

在ChatGPT Images 2.0之前,“有图有真相”,这句话流传了很久很久。

再之前,是耳听为虚,眼见为实。

我们不需要花精力去怀疑这些:

微博截图出现时,接收者很少怀疑截取是否断章取义,而是直接信任内容

聊天记录摆在眼前,用户默认它是原貌,注意力全在”发生了什么”

新闻图片被展示,观众倾向于认为相机不会说谎,进而相信图片所呈现的新闻

我们对于信息的信任,是无意识的,就像鱼意识不到水的存在一样。

而现在,ChatGPT Images 2.0像是一个被打开的潘多拉魔盒。它太强了,强到让人不安,让人猜忌。

那个怀疑的种子,一旦开始,就已经种下了。

现在可能还只有一小部分人能慢慢意识到这一点。但我敢确信,如果照这样的趋势发展下去,未来当人们看到一张图如果跟我们的直觉不符,脑海里一定会下意识多出一个声音:

“这张图,是不是由AI生成的?”

这个声音可能很小,可能只是一闪而过。但它会扎根在那里。随着AI继续发展,它只会越来越大。

04 技术的进步是挡不住的

毫无疑问,这个功能颠覆了我们的想象。它是危险的,同时也是必然的。

技术的进步是挡不住的。就算OpenAI不做,别人也会做。就算它做不出来,别人也会做出来。

其实早在ChatGPT Images 2.0之前,也有很多AI生图工具。当年Photoshop刚出来的时候,很多人也担心:照片都可以P了怎么办?但它依旧没有被禁止,依旧能够体面地存在于我们的电脑中。

当时我们也面临类似的信任危机。但那时候P图是有技术门槛的,因此造假可能仅限于局部场景,而非现在的大规模应用。

而AI把P图的时间、精力、门槛都降低了,让越来越多的普通人有机会通过自然语言描述来实现想象画面的生成。

从这一方面来看,AI生图是利好的。

存在即合理。新技术的来临是大势所趋,不可阻挡。我们想着的不应该是如何禁止它,而是如何让它更合规、合理地存在。

05 如何规避风险?

之前的经验告诉我们,首先面对一些来路不明、凭空产生的信息,如果第一感觉是怀疑,我们不能轻易相信,而应该去找信息的源头。

我们应该把这个意识刻在头脑里:

耳听不一定为虚眼见不一定为实截图不等于证据

我相信这个意识会随着AI生图的大规模爆发而潜移默化地形成。

06 创作者的责任

我不是什么优质创作者,但是关于信任问题,我十分赞同卡兹克所说的:创作者应该对得起”信任”二字。

亚里士多德说过,人是社会性的动物。人类的生存和发展,从古至今都离不开合作,而合作的基础就是信任。

从原始社会的部落协作,到农业时代的村落互助,再到现代社会的契约精神,人类文明的每一次跨越,都是信任体系的升级。没有信任,社会就会陷入”所有人对所有人的战争”。

信任,是社会运转的基石。它是人与人之间的润滑剂,让陌生人可以交易、让信息可以流动、让合作可以发生。一旦信任崩塌,整个社会机器就会卡顿甚至停摆。

而今天,ChatGPT Images 2.0正在加速侵蚀这个基石。

造谣的成本太低了。

作为内容创作者,我们应该真实地创作,对于一些使用AI生成的虚假信息,应该在图片上标注清楚来源,以便传播者能够清楚直观地辨别该信息的真假。

守住信任,就是守住我们作为创作者的底线。

夜雨聆风

夜雨聆风