零成本在手机上跑 Gemma 4安卓+iPhone 本地离线多模态实战指南

1. 这篇内容到底讲什么

原网页的主题非常明确:让普通用户在手机上本地运行 Gemma 4,并实际体验多模态与离线能力。

它的价值不在“做了多复杂的工程”,而在于把问题拆成了两个最现实的入口:

-

安卓:安装手机端本地模型应用,下载 Gemma 4 的适配版本,完成参数设置后直接聊天、看图、写代码 -

苹果:通过支持本地模型加载的 iOS / iPadOS 应用,下载 Gemma 4 后进行图片理解、逻辑推理和代码生成测试 -

最后再通过飞行模式测试,验证这件事是不是“真离线”而不是伪本地

不过原网页也有一个典型问题:它更偏“演示型内容”,很多读者看完会知道“这能做”,却未必知道“该从哪个官方入口下、怎么选版本、容量够不够、如何规避坑”。这正是本文补齐的重点。

2. Gemma 4 为什么能下沉到手机端

先说结论:并不是所有 Gemma 4 版本都适合手机,但 E2B、E4B 这两档小模型,本身就是面向边缘设备和本地推理场景设计的。

从官方资料看,Gemma 4 具备下面几个关键点:

-

它是 Google DeepMind 发布的开放模型家族,采用 Apache 2.0 许可 -

它支持 文本 + 图像输入,属于原生多模态模型 -

小模型支持更长上下文与本地部署优化,适合边缘设备和移动设备体验 -

官方列出的型号包括 E2B、E4B、31B、26B A4B,其中前两档最适合手机侧切入

这意味着,手机端体验的正确思路不是“硬跑最大模型”,而是:

-

先选择移动端能承受的规格 -

通过量化版本降低内存和存储压力 -

优先验证任务可用性,而不是盲目追求参数量

换句话说,手机上跑 Gemma 4,不是为了和工作站拼绝对性能,而是为了获得下面四类能力:

-

离线聊天 -

轻量视觉理解 -

本地文案/代码草稿生成 -

隐私优先、无需联网的随身 AI

3. 官方入口与下载方式

这一节直接给出可落地的官方下载安装地址,避免你看完文章还要到处找入口。

3.1 Android 官方下载地址

应用名称:Google AI Edge Gallery

官方下载地址:

-

Google Play:https://play.google.com/store/apps/details?id=com.google.ai.edge.gallery -

Google AI Edge 主页:https://ai.google.dev/edge

这条路线的优点是:

-

来自官方商店,安全性更高 -

更新路径清晰 -

官方更新说明已经明确提到 Gemma 4 支持 -

适合先做离线聊天、看图和轻量推理验证

3.2 iPhone / iPad 官方下载地址

应用名称:Locally AI – Local AI Chat

官方下载地址:

-

App Store:https://apps.apple.com/us/app/locally-ai-local-ai-chat/id6741426692

这条路线的优点是:

-

直接从 App Store 安装 -

支持离线、本地、无登录 -

支持 Gemma、Qwen、Llama 等多种模型 -

更适合 iPhone / iPad 用户快速验证“本地多模态 + 离线问答”

3.3 下载后的正确顺序

建议按下面顺序执行:

-

先安装应用本体,不要先急着找模型包 -

打开应用,确认能正常启动 -

再进入模型列表,优先选择 Gemma 4 的小模型 / 轻量量化版本 -

先跑通聊天、看图、离线三项验证 -

最后再考虑升级更大的模型规格

3.4 一个最实用的提醒

-

不要优先下来源不明的 APK -

不要上来就追求最大模型 -

不要跳过飞行模式离线验证 -

不要只看别人截图,要自己跑一轮完整链路

4. Android 端部署步骤

下面给你一套偏稳妥的 Android 端流程。

4.1 安装应用

-

打开 Google Play -

搜索并安装 Google AI Edge Gallery -

首次启动后完成基础权限确认

4.2 下载 Gemma 4 模型

进入应用后,一般会有模型管理或模型列表入口。

推荐思路:

-

先找 Gemma 4 E2B 或更轻量的量化版本 -

如果手机内存与存储空间更充裕,再考虑更高规格 -

首次下载建议在 Wi‑Fi 环境下完成

4.3 基础参数建议

移动端不适合把所有参数都拉满,建议先从下面这套保守配置开始:

-

上下文长度:先保守,不要一开始就拉到非常高 -

输出 Token:先限制在中等范围,例如 256 ~ 512 -

温度:默认即可,先验证稳定性再微调 -

多模态输入:先测试拍照识别或图片问答,再上复杂任务

4.4 首轮验证任务

第一轮不要直接上复杂 Agent 任务,建议依次测试:

-

问答:让它做 3~5 轮连续对话 -

图片理解:拍一张桌面图,让它识别物品 -

逻辑题:例如蒙提霍尔问题、简单推理题 -

代码任务:让它输出一个单文件 HTML 小页面 -

离线验证:关网或开飞行模式后再次提问

只要这五步都跑通,说明你的本地链路已经基本闭环。

5. iPhone / iPad 端部署步骤

苹果侧的优势通常不是“随便装 APK”,而是应用整体打磨更成熟,体验更像一个成品。

5.1 安装 Locally AI

-

打开 App Store -

搜索 Locally AI – Local AI Chat -

安装并启动 -

跳过欢迎页或默认推荐,进入模型选择界面

5.2 下载 Gemma 模型

在模型列表里选择 Gemma 相关版本时,建议注意两件事:

-

模型体积 -

是否支持图像理解或更强推理能力

首次上手仍建议先选更轻的版本,原因很简单:

-

下载更快 -

成功率更高 -

更便于验证“这条链路到底通不通”

5.3 iPhone / iPad 端推荐测试顺序

-

先做文本聊天 -

再做图片理解 -

再做推理题 -

最后做代码生成 -

再开飞行模式做离线复测

这样做的好处是,一旦某一步失败,你能明确知道是模型、输入模态、设备性能,还是应用本身的问题。

6. 模型选型与容量估算

这是手机端最容易踩坑的地方。

很多人只盯着“模型最强不强”,但手机场景更应该先看 能不能稳、会不会卡、存储够不够、热不热、掉不掉后台。

6.1 一个实用的估算公式

手机端可用性的粗略判断,可以先用这个经验式:

总占用 ≈ 应用安装体积 + 模型文件体积 + 运行缓存 + 系统额外波动空间

为了避免下载完就闪退,建议再留一个冗余:

建议可用空间 ≥ 模型文件体积 × 1.5

6.2 数值举例

假设:

-

App 本体约数十 MB 到百 MB 级 -

模型文件约 1.2 GB ~ 3.6 GB -

运行过程中还会吃掉额外缓存与系统内存

那更稳妥的做法是:

-

下载 1.2 GB 模型时,设备最好至少空出 2 GB 左右可用空间 -

下载 3.6 GB 模型时,设备最好至少空出 5 ~ 6 GB 以上空间 -

如果设备 RAM 本就紧张,优先小模型,不要硬上大模型

6.3 选型建议表

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

7. 实测任务设计:视觉、推理、代码、离线

如果你想更系统地验证“手机跑 Gemma 4 到底有没有实际价值”,可以用下面这套测试框架。

7.1 视觉测试

拍一张桌面图,提示词可以这样写:

请识别这张图片里有哪些物体,尽量按类别列出;如果不确定,请明确说明不确定。这一步主要看两件事:

-

能不能识别主要物体 -

遇到不确定区域时,会不会胡编

7.2 推理测试

可以用经典的蒙提霍尔问题:

有三扇门,其中一扇门后有车,另外两扇门后有羊。你先选一扇门,主持人再打开一扇有羊的门。请问换门是不是更有利?请解释原因。这一步主要看逻辑链条是否清晰,而不是只看结论对不对。

7.3 代码测试

你可以直接让它生成一个单文件网页:

请写一个单文件 HTML 页面,做一个可运行的简易贪吃蛇小游戏,包含 HTML、CSS 和 JavaScript,直接复制保存即可运行。这类任务很适合移动端:

-

结果可读 -

易验证 -

对话成本低 -

可以迅速看出模型的代码组织能力

7.4 离线测试

最后一定要做这个动作:

-

断开 Wi‑Fi -

打开飞行模式 -

重新提问 -

再次测试文本与图片任务

只有这一步也通过,才能说明“本地离线”不是营销文案,而是真正跑在设备上。

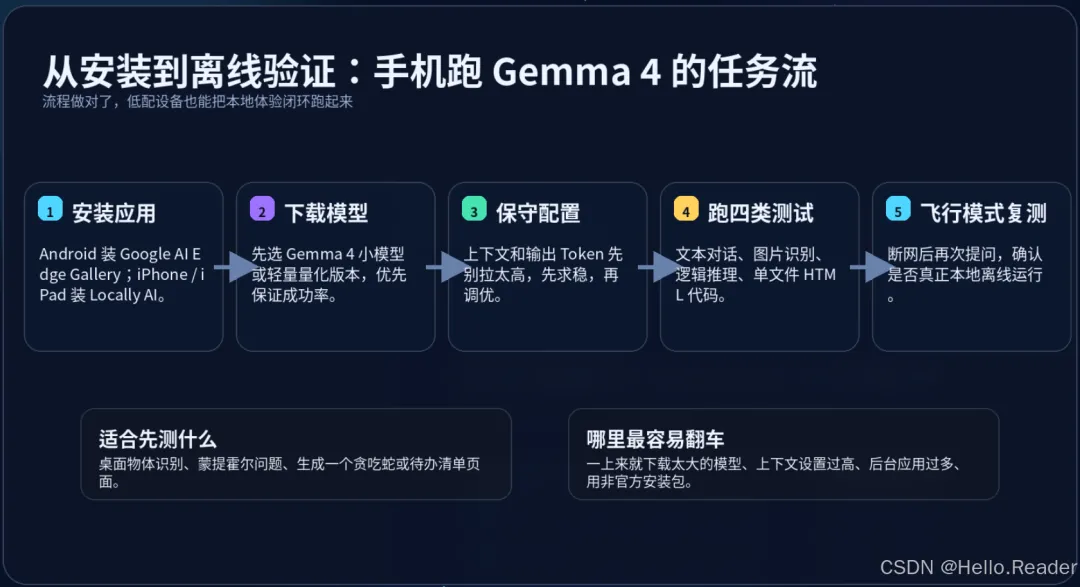

8. 配图说明

图 1:手机端运行 Gemma 4 的整体路线图

图 2:从安装到离线验证的任务流

图 3:官方入口与选型建议

三张图都采用深色科技感界面、圆角卡片、弱发光描边、青紫点缀的布局风格,适合直接嵌入博客或导出成 PNG。

9. 常见问题与排障

9.1 下载很慢

-

优先使用官方商店下载 -

模型包尽量放在稳定网络环境下完成 -

避免来路不明的镜像包

9.2 下载完后运行卡顿

-

先降模型规格 -

降低上下文长度 -

限制输出 Token -

关闭后台高占用应用

9.3 图片理解不稳定

-

优先用光线更好、主体更清晰的图片 -

一次不要塞太多小物体 -

让模型先做“识别主要对象”,再细化局部

9.4 设备发热明显

-

连续长对话本来就会提高负载 -

多模态推理更吃资源 -

手机端更适合碎片化使用,而不是长时间重压

9.5 为什么明明能跑,但体验不如云端模型

因为移动端本地模型与云端大模型追求的不是同一个目标:

-

云端更强调规模与极限能力 -

本地更强调隐私、离线、可得性和成本

你要的是“随时可用”,而不是“每次都跑满顶级算力”。

10. 总结

这篇内容最重要的结论只有三个。

第一,手机上本地跑 Gemma 4 已经不是噱头,而是现实可行的轻量方案。

第二,真正适合普通用户的路线,不是盲目追求大模型,而是从小模型、官方入口、离线验证开始。

第三,移动端本地 AI 的价值,不在跑分,而在隐私、低门槛、随手可用和不依赖网络。

如果你只是想体验一次“手机离线看图、聊天、写点代码”的本地 AI,那么 Android 侧走 Google AI Edge Gallery,iPhone / iPad 侧走 Locally AI,已经足够把这件事跑通。

11. 官方资源与下载地址

为了方便你直接照着装,这里把文章里用到的官方入口再汇总一遍。

11.1 Android 路线

-

Google AI Edge Gallery(Google Play):https://play.google.com/store/apps/details?id=com.google.ai.edge.gallery -

Google AI Edge 官方主页:https://ai.google.dev/edge -

Google 开发者博客(Gemma 4 on-device / Gallery 更新):https://developers.googleblog.com/bring-state-of-the-art-agentic-skills-to-the-edge-with-gemma-4/

11.2 iPhone / iPad 路线

-

Locally AI – Local AI Chat(App Store):https://apps.apple.com/us/app/locally-ai-local-ai-chat/id6741426692

11.3 Gemma 4 官方资料

-

Gemma 4 官方概览:https://ai.google.dev/gemma/docs/core -

Gemma 4 官方模型卡:https://ai.google.dev/gemma/docs/core/model_card_4 -

Gemma 官方入口:https://ai.google.dev/gemma

11.4 原网页参考

-

原网页:https://www.freedidi.com/23669.html

11.5 一句话下载建议

- 安卓用户

:先去 Google Play 安装 Google AI Edge Gallery - iPhone / iPad 用户

:先去 App Store 安装 Locally AI – Local AI Chat - 想进一步核对模型资料

:再看 Gemma 官方概览与模型卡

夜雨聆风

夜雨聆风