科研人要失业了?AI一句话生成整个工作流

AI4SCIENCE DAILY

2026-04-25 | 每天深度解读一篇 AI+科学前沿论文

科研人要失业了?AI一句话生成整个工作流

把研究问题翻译成可执行工作流,这次 AI 碰的不是聊天,而是科研基础设施最难的一步

📌 导读

这篇论文最有价值的地方,不是又做了一个“会聊天的科研助手”,而是认真处理了科研自动化里最容易被忽略的一段:如何把自然语言研究问题,稳定翻译成机器可执行的工作流。作者把整套系统拆成语义层、知识层和确定性层,让 LLM 负责理解意图,但不直接掌控最终 DAG 生成。结果是:完整意图匹配率从 44% 提升到 83%,数据传输降低 92%,额外 AI 开销低于 15 秒,单次成本低于 0.001 美元。

📖 目录

01 背景与意义 | 02 先看懂两张关键图 | 03 这套系统到底怎么工作

04 技术细节拆解 | 05 实验结果说明了什么 | 06 和常见 Agent 路线有什么不同

07 为什么这对科研平台很重要 | 08 普通读者怎么理解这篇论文

09 这项工作的现实价值 | 10 局限性 | 11 未来展望 | 12 总结

01

背景与意义

过去十几年,科研工作流系统已经把“执行”这件事做得越来越成熟。无论是任务调度、失败重试、资源管理,还是容器化部署,像 Pegasus、Nextflow、Snakemake、HyperFlow 这类系统都已经提供了相当强的基础设施能力。问题在于,它们大多解决的是“怎么跑”,却没有真正解决“怎么把研究问题翻译成可运行流程”。

这恰恰是科研自动化最痛的一环。科学家脑子里想的是研究问题,比如比较不同人群的某类基因变异、筛选特定区域的样本、构建某个分析管线。但机器并不懂这些抽象表达,它需要的是更明确的参数、数据源、执行环境和流程结构。于是现实里,这一步经常要靠领域专家和工程师一起手工翻译,既费时,又容易出错。

这篇论文的价值,就在于试图把这一步系统化。它不是让 AI 直接自由发挥生成一堆工作流代码,而是用一种更谨慎的方式,让 AI 先理解问题,再把执行交给更可控的模块。这种设计对科研场景很重要,因为科研不只是“能不能跑通”,更关心能不能复现、能不能追踪、能不能审计。

02

先看懂两张关键图

如果只看论文里的两张图,其实已经能抓住这篇工作的主线。

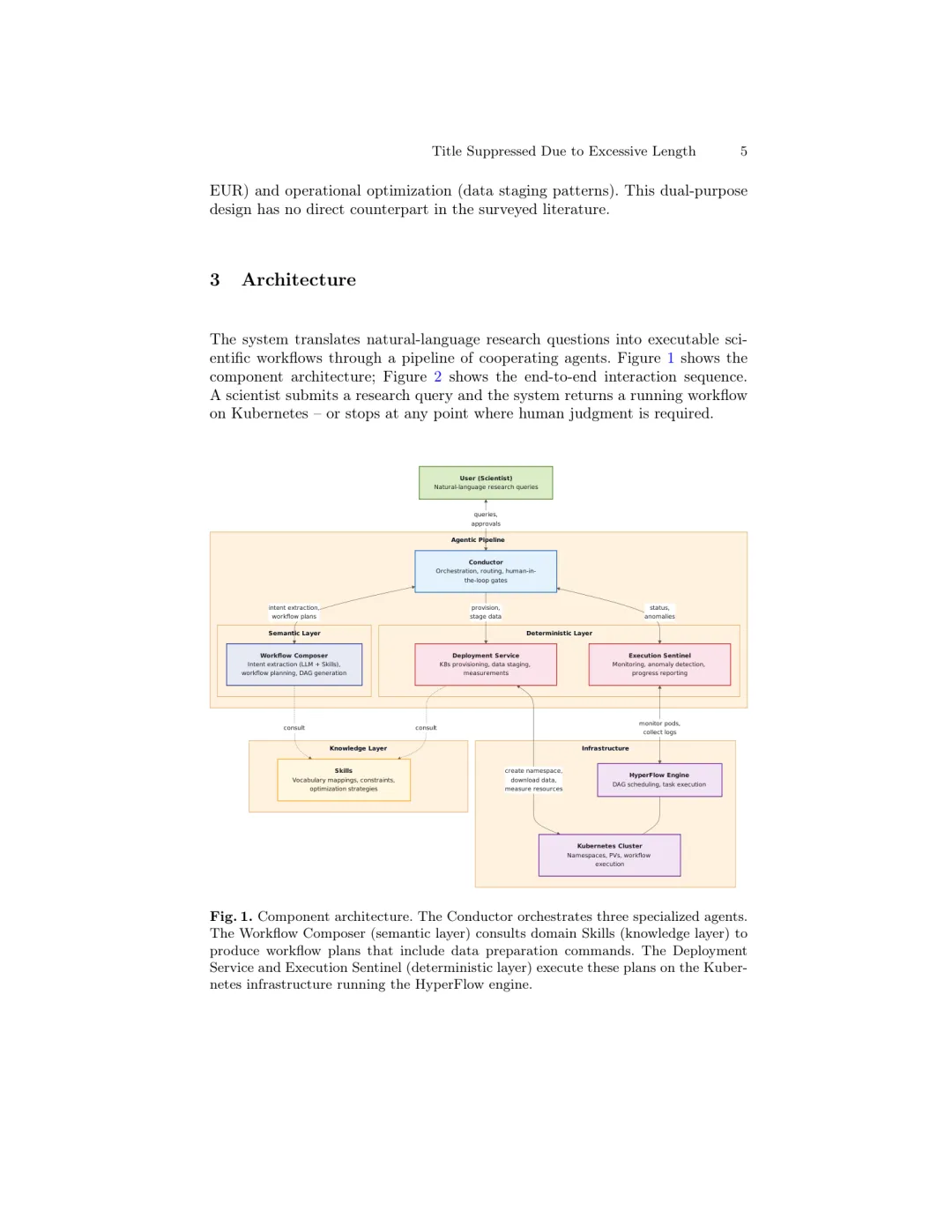

图 1:三层架构如何分工

这张图最重要的不是模块名字,而是职责边界。语义层负责理解研究问题,知识层负责提供领域映射和约束,确定性层负责真正生成并执行工作流。作者并没有让 LLM 从头包到尾,而是把它放在最擅长、但风险更可控的位置上。

图 1|语义层、知识层与确定性层的整体协作关系

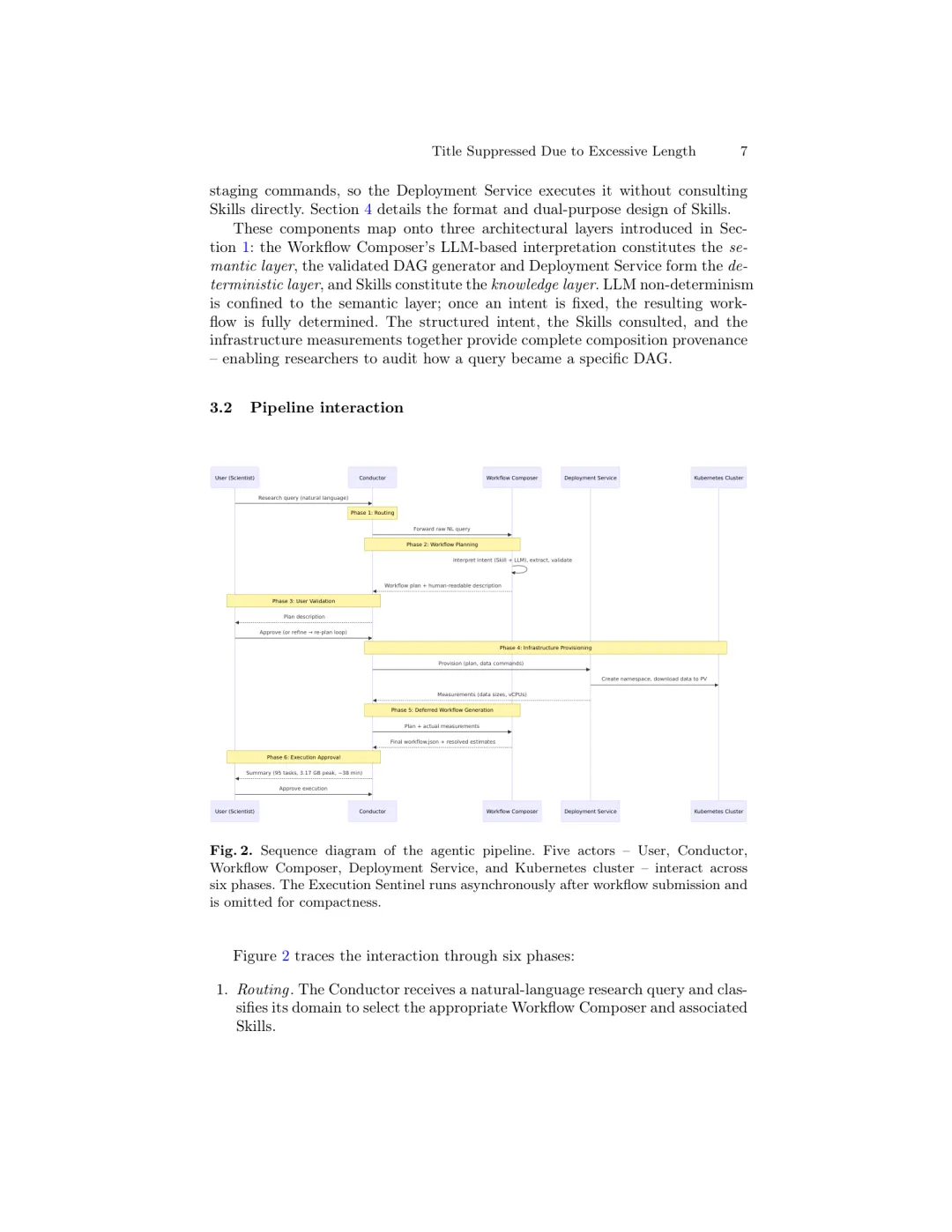

图 2:从一句话到执行落地的流程

第二张图展示的是一条完整工程链路:用户提出问题,Conductor 负责协调,Workflow Composer 负责提取意图和规划流程,Deployment Service 负责准备执行环境,Execution Sentinel 负责监控运行状态。它不是一个单体 Agent,而更像一个多角色协作系统。

图 2|从自然语言问题到 Kubernetes 执行的完整流程

03

这套系统到底怎么工作

这篇论文的关键设计,是先把自然语言问题压缩成一个结构化意图。比如研究者说,想比较不同人群在某个基因区域的变异模式,这句话对人类来说已经足够直观,但对机器而言仍然不够。系统还必须进一步明确:分析类型是什么、涉及哪些 populations、落在哪些 chromosomes 或 regions 上、重点关注哪一类统计目标。

作者没有让 LLM 直接输出最终工作流 DAG,而是让模型先做意图提取,再由确定性生成器根据这个意图产出可复现的工作流计划。这样做的好处很明显:如果同一个查询总是先经过同样的结构化中间层,那么后面的执行流程也更容易保持稳定,而不是每次都受模型随机性影响。

换句话说,这篇论文做的是一种“分权式自动化”。模型有理解权,但没有无限执行权;知识层提供专业领域里的翻译手册;真正把任务落地到 Kubernetes 和 HyperFlow 的,仍然是传统工程系统。这种架构可能不够炫技,但非常符合科研场景对可追踪、可审计、可复现的要求。

04

技术细节拆解

从技术上看,这套系统有三个尤其值得展开的细节。

第一,语义层并不是简单做问答。 它的任务不是“回答科学家的问题”,而是把问题翻译成一个足够稳定、足够结构化的中间表示。模型在这里更像一个受约束的解析器,而不是自由发挥的内容生成器。

第二,知识层的 Skills 是论文的关键亮点。 作者没有把领域知识只塞进 prompt 里,而是把人口学术语、区域坐标、参数边界、优化策略等内容写成 markdown 形式的 Skills。这样一来,这些知识就不再是一次性上下文,而变成了可读、可审阅、可维护的系统资产。对科研平台来说,这一点特别重要,因为它让领域专家能直接参与系统能力建设,而不必每次都依赖模型工程师去改 prompt 或训练数据。

第三,确定性层解决的是复现性问题。 很多 LLM 驱动系统的问题不在于“看起来不聪明”,而在于每次生成略有不同,最后很难保证工作流一致。论文把真正的 DAG 生成交给 validated generators,本质上是把科研自动化里最脆弱的一环从黑箱模型里拿了出来。

一句话理解这套设计:模型负责理解,Skills 负责纠偏,工程系统负责执行。三者分开以后,虽然没有“万能 Agent 一把梭”那么夸张,但更接近真实实验室会接受的形态。

05

实验结果说明了什么

论文给出的几组结果非常关键。首先,在 150 个查询的消融实验里,加入 Skills 之后,完整意图匹配率从 44% 提升到了 83%。这个提升不是锦上添花,而是说明知识层确实在起作用:它显著减少了模型仅靠训练数据和提示词时产生的理解偏差。

第二,作者报告 skill-driven deferred workflow generation 将数据传输降低了 92%。这一点容易被忽略,但实际上非常重要,因为很多科学工作流的瓶颈不是计算本身,而是数据搬运、暂存和调度成本。换言之,这篇论文并不只是让系统“更会理解人话”,也确实在执行效率上带来了实打实的优化。

第三,论文强调整条流水线的 LLM 额外开销低于 15 秒、单次成本低于 0.001 美元。这说明作者并没有把大模型用在最昂贵的地方,而是把它压缩在一个轻量但关键的环节里。对以后要在实验室或平台里长期运行的系统来说,这种设计比追求最强模型更实际。

06

和常见 Agent 路线有什么不同

现在很多 Agent 系统的主打卖点,是“端到端自动完成任务”。这听起来很强,但落到科研基础设施时,问题就会暴露出来:如果模型每次生成的流程都略有不同,或者参数边界没有被严格约束,那么看起来聪明的系统,最后反而会成为复现性的隐患。

这篇论文的取舍更工程化。它没有让 LLM 直接生成最终 DAG,也没有把所有决策都交给黑箱模型,而是通过 Skills 和 validated generators 把不确定性限制在较小范围内。对科研来说,这种保守不是退步,而是成熟。

07

为什么这对科研平台很重要

这篇论文的重要性,不在于展示了一个更花哨的 Agent,而在于它提供了一条更像“科研基础设施演化方向”的路线。过去很多 AI for Science 系统擅长生成解释、总结结果、辅助写作,但真正把自然语言研究意图变成执行流程的系统并不多。作者补上的恰恰是这一层。

更重要的是,这条路线并不要求实验室完全信任一个黑箱模型。它允许领域专家通过 Skills 持续注入知识,也允许确定性系统继续承担可复现性的责任。这种设计可能没有“全自动科学家”那么抓眼球,但更有机会真正落地。

08

普通读者怎么理解这篇论文

可以把这套系统想成一个非常懂科研语境的“项目翻译官”。科学家说的是研究目标,工程系统需要的是执行说明书。过去这中间靠人脑补,现在作者试图用 LLM + Skills + 确定性生成器把这段翻译流程标准化。

再打个比方:传统工作流系统像一台性能很强的机器,但你必须自己写清楚每一步说明;这篇论文想做的是一个懂专业术语、会补全上下文、还能遵守规则的“前台接单员”,把你的口头需求翻译成机器真正能执行的工单。

09

这项工作的现实价值

对实验室来说,这意味着很多原来要靠熟练工程师手工维护的流程,有机会被结构化、标准化地沉淀下来。对平台团队来说,这意味着专家经验不必永远停留在“老师傅口口相传”的层面,而可以写成 Skills,成为系统长期可复用的资产。

尤其在生物信息学、多组学、单细胞分析这类流程复杂、术语密集、数据量大的领域,这种架构会非常有吸引力。因为它不是单纯生成答案,而是在生成可以运行、可以追踪、可以复现的分析流程。

真正重要的不是“AI 会不会写流程”,而是“AI 能不能在不破坏复现性的前提下,把科研意图稳定翻译成流程”。这篇论文的意义,就在这里。

10

局限性

第一,论文的验证场景还比较集中,主要围绕特定生物信息学工作流展开。要证明它是通用科学自动化框架,还需要更多领域案例,比如材料、化学、气候和自动实验平台等。

第二,Skills 虽然是亮点,但也意味着持续的知识工程成本。谁来写、谁来维护、如何评估质量、不同实验室之间如何共享,这些都将影响系统扩展速度。

第三,完整意图匹配率达到 83% 已经很强,但对于科研任务来说,剩下的误差依然不能忽视。因为一旦结构化意图理解偏了,后续确定性生成会把偏差稳定地执行出来。

11

未来展望

如果未来这类系统继续演化,它很可能成为很多科研平台的中间层:上面接自然语言交互,下面接工作流系统、计算资源、数据仓和实验执行环境。那时候,AI 在科研里最有价值的角色,也许不是“替科学家思考”,而是把科学家的高层意图更稳定地转成可执行流程。

更长远地看,Skills 也可能从简单 markdown 文档,升级为可版本化、可评测、可共享的科学知识资产库。那时不同实验室、不同平台甚至不同学科都可以交换自动化经验。

12

总结

这篇论文最值得记住的一点,不是它又引入了一个更强的大模型,而是它认真回答了一个现实问题:当科研问题用自然语言提出时,系统能不能在不破坏复现性的前提下,把它稳定翻译成可执行流程?作者给出的答案是可以,但前提是职责划分清楚:模型负责理解,知识层负责约束,确定性系统负责执行。

对 AI4Science 来说,这篇工作释放了一个很清晰的信号:AI 正在从“帮你理解科学”迈向“帮你执行科学”。而真正有价值的系统,往往不是最会说的那个,而是最懂得把不确定性关进笼子里的那个。

论文信息

标题:From Research Question to Scientific Workflow: Leveraging Agentic AI for Science Automation

arXiv:2604.21910

链接:https://arxiv.org/abs/2604.21910

一句话评价:这是一篇非常像“科研自动化基础设施升级”的论文,短期提升研究问题到工作流的转译效率,长期可能改变 AI 参与科学执行的方式。

AI4SCIENCE DAILY

每天深度解读一篇 AI+科学前沿论文

夜雨聆风

夜雨聆风