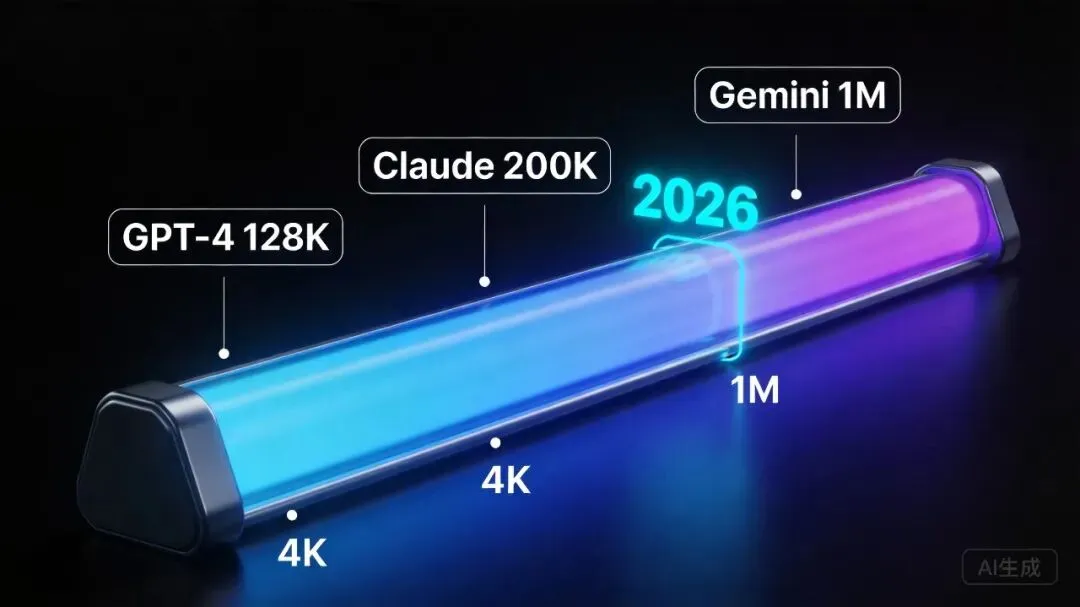

AI上下文窗口大爆发:100万Token时代来了,普通人能用来干嘛?

最近AI圈有个特别火的话题,可能很多人都在刷到但没太当回事——上下文窗口(Context Window)又又又突破了。

4月24日的AI前沿日报里提到,多个模型已经支持百万级Token上下文。这意味着什么?意味着你现在可以让AI一次性阅读、理解、分析一整本《哈利波特》全集、或者一整个代码仓库、或者上百份合同——全部同时塞进它的”脑子”里。

作为一个天天用AI干活的人,我觉得有必要认真聊聊这个趋势,以及我们普通人到底怎么用它。

1、什么是上下文窗口?说人话

我第一次听到这个词的时候,以为是什么特别高深的技术概念。后来用多了才发现,其实特别好理解。

你可以把AI的”上下文窗口”想象成它的”工作记忆”。就像人类一样,AI在思考的时候需要”记住”前面的内容才能推断后面的内容。上下文窗口越大,它能同时记住的东西就越多。

举个例子——

-

GPT-3时代:上下文窗口约4000个Token,大概相当于一篇中等长度的文章。你让它总结一篇文章,它基本只能看到这一篇文章。 -

GPT-4时代:上下文窗口提升到128K Token,相当于一本《傲慢与偏见》的长度。你可以扔给它一本书让它总结。 -

2026年现在:主流模型已经支持100万Token上下文。这是什么概念?大约75万汉字,或者300篇公众号文章,或者一整个小型代码仓库。

所以这个升级不是修修补补,是质的飞跃。

2、这次爆发为什么值得关注?三个原因

原因一:AI终于能”读完”了

以前我们用AI处理长内容,其实是在”投机取巧”——因为AI读不完,所以人类不得不做预处理:摘要、提炼、分段。把一百分文档浓缩成十分摘要,AI才能处理。

但现在不一样了。你可以:

-

把一整年的财务报告扔给AI,让它找出异常数据 -

把一个产品的所有用户评论扔给AI,让它总结出真实痛点 -

把一整套技术文档扔给AI,让它帮你审查代码问题

以前是AI”读不完所以你来精简”,现在是AI”读得完所以你来问问题”。这个顺序的颠倒,意义很大。

原因二:跨文档分析终于可用了

我在日常工作中最头疼的场景之一是:客户给了几十份文件,让我找出它们之间的关联。

以前的技术方案是:每份文件单独总结,然后让AI对比。但这样丢失了大量跨文档的关联信息。

现在有了百万级上下文,同一个问题可以一次性分析完。AI能”看到”文档A里的第三章和文档B里的第五章之间的逻辑关系,这种能力在以前是不可想象的。

原因三:长程Agent成为可能

这是我认为最激动人心的。

Agent(AI智能体)要完成复杂任务,需要记住大量的中间状态。以前上下文窗口小的时候,Agent在工作几十步之后就会”失忆”——它会忘记最初的目标,或者在某个步骤重复劳动。

现在100万Token的上下文,相当于Agent有了足够大的”草稿纸”。一个Agent可以:

-

读入一整个项目的代码和文档 -

执行几十步的复杂推理 -

在推理过程中随时回顾之前的所有步骤

这让”AI帮你做完整项目”从理论走向了实践。

3、实操指南:这些场景你现在就能用

说了这么多,可能还是有点虚。我来列几个我们普通人现在就能用上的场景。

场景一:批量处理合同/文档

以前:需要花几小时读完几十份合同,找出潜在风险点 现在:扔给AI,10分钟出结果

具体操作:把合同打包成PDF或者txt,确保文件路径清晰,然后让AI帮你做”风险识别”或者”条款对比”。

场景二:代码库分析和审查

以前:想了解一个开源项目的架构,需要花几天时间读代码 现在:把整个代码仓库扔给AI,让它给你讲架构图和核心逻辑

具体操作:用Git clone整个仓库,然后把关键文件打包上传给AI。你可以问:”这个项目的数据流是怎么走的?”或者”帮我找出可能导致性能问题的地方。”

场景三:长篇文章/报告深度解读

以前:只能读摘要,容易遗漏重要细节 现在:直接上传全文,让AI做深度分析

我自己的经验是,对于特别重要的行业报告,我会把全文扔给AI,让它回答”这篇文章最核心的三个观点是什么?作者有没有遗漏什么重要数据?”这种问题。

场景四:跨多个数据源的市场调研

以前:需要分别读各个数据源,然后人工整合 现在:一次性输入所有数据源,让AI做横向对比

比如你要做竞品分析,可以把多个竞品的官网、公开财报、行业分析报告全部扔进去,让AI帮你提炼出”竞争格局分析”和”差异化机会”。

4、各家模型上下文能力对比(2026年4月)

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

我个人的使用体验是:英文技术文档用Claude,中文长文用Gemini或者国内模型。但这个判断随时可能变化,毕竟各家都在快速迭代。

5、我的建议:现在就开始”囤”上下文能力

这篇文章不是要推荐某个具体产品,而是想让大家意识到一个趋势:上下文窗口的提升,是AI从”工具”变成”助手”的关键一步。

以前我们用AI,是在它能处理的范围内问它问题。 未来我们用AI,是把所有信息都扔给它,让它自己找出我们需要的东西。

这个转变对使用者的要求是不同的。

所以我的建议是:从今天开始,有意识地训练自己”把完整信息扔给AI”的习惯。不要做摘要、不要提炼,直接给原文。你会发现,信息损失减少了,AI给你的反馈质量也会大幅提升。

夜雨聆风

夜雨聆风