研究进展:AI+材料科学-多模态大语言模型MatterChat | Nature Machine Intelligence

理解和预测无机材料性质,对于推动能源、电子等领域的发展至关重要。近年来,多模态大语言模型,为整合结构数据与文本信息提供了新的可能,但如何将原子级结构信息有效融入语言模型,仍然是关键挑战之一。

近日,劳伦斯伯克利国家实验室Yingheng Tang, Wenbin Xu,Zhi Jackie Yao等联合犹他大学Weilu Gao等在Nature Machine Intelligence上发文,提出了一种结构感知的多模态大语言模型框架MatterChat。

研究表明,在材料性质预测与人机交互任务中,MatterChat显著优于通用大模型,同时支持复杂科学推理与材料合成过程的逐步生成。这一方法,为材料科学中的智能辅助设计与发现提供了新的范式。

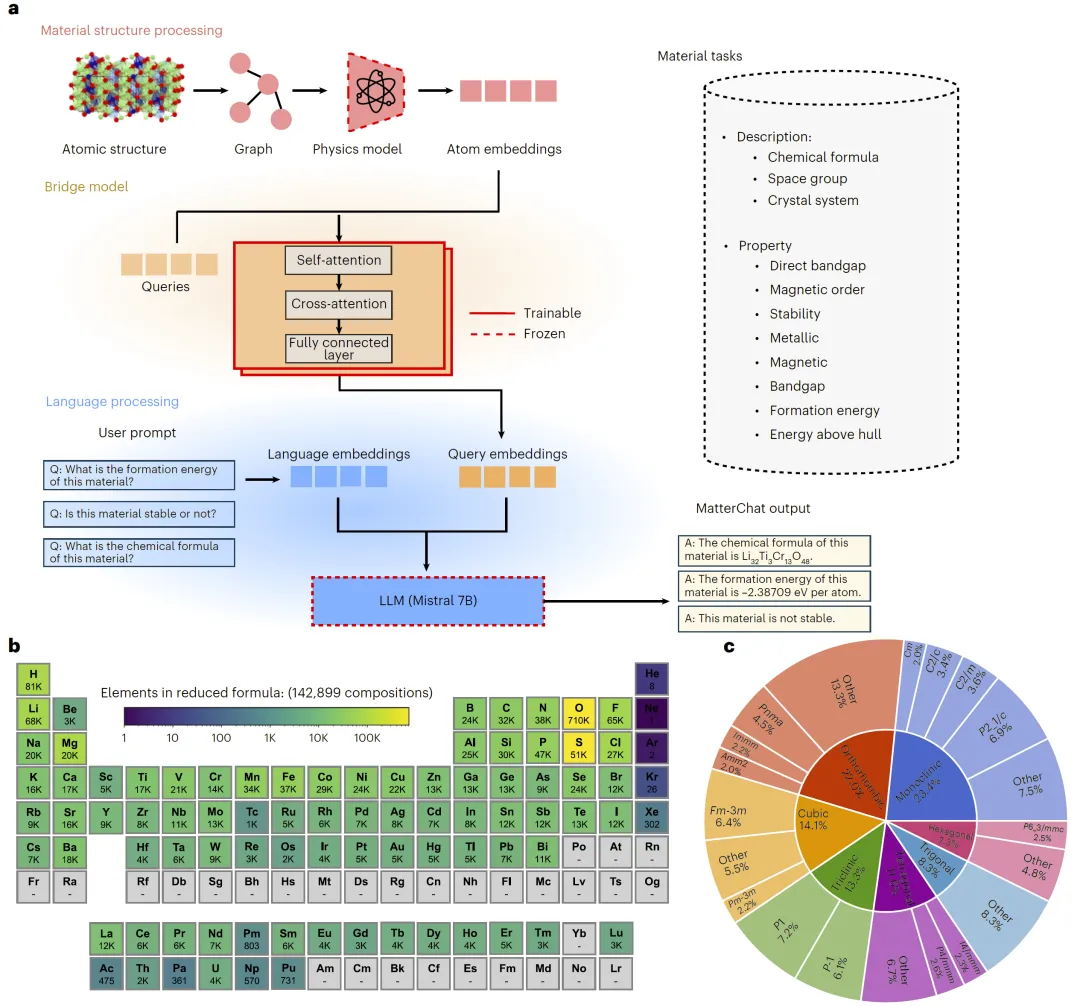

图1:MatterChat整体架构。

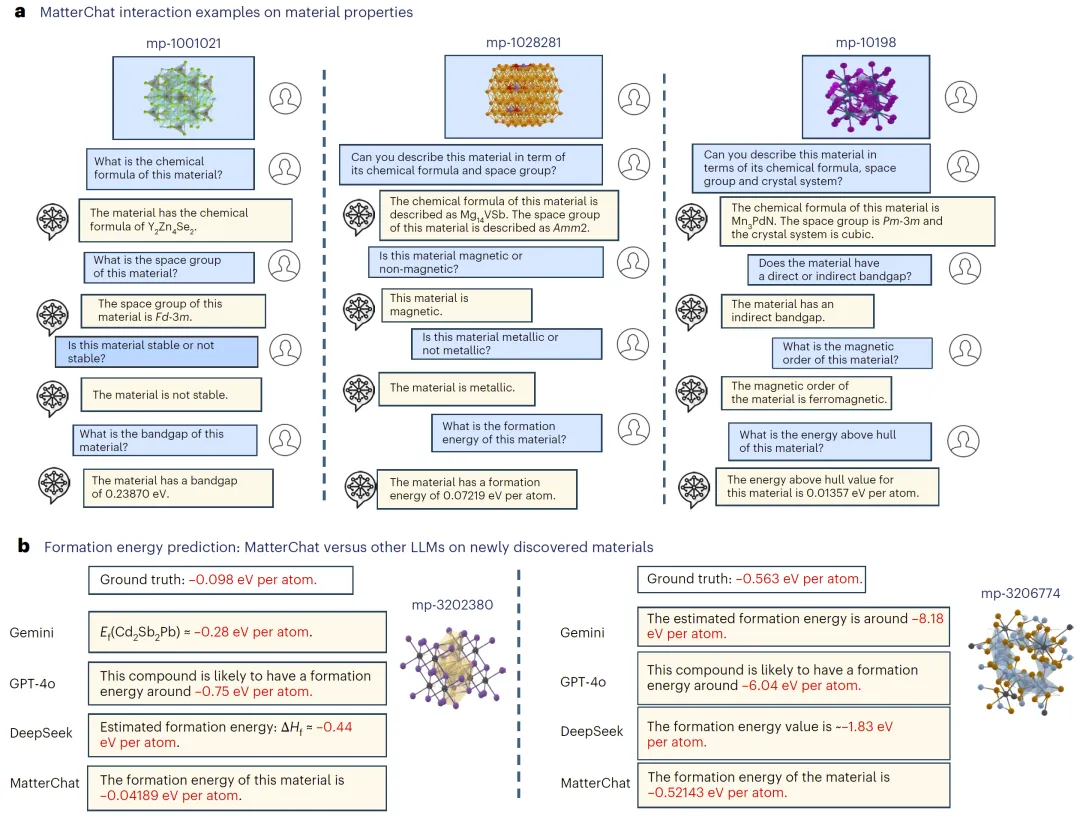

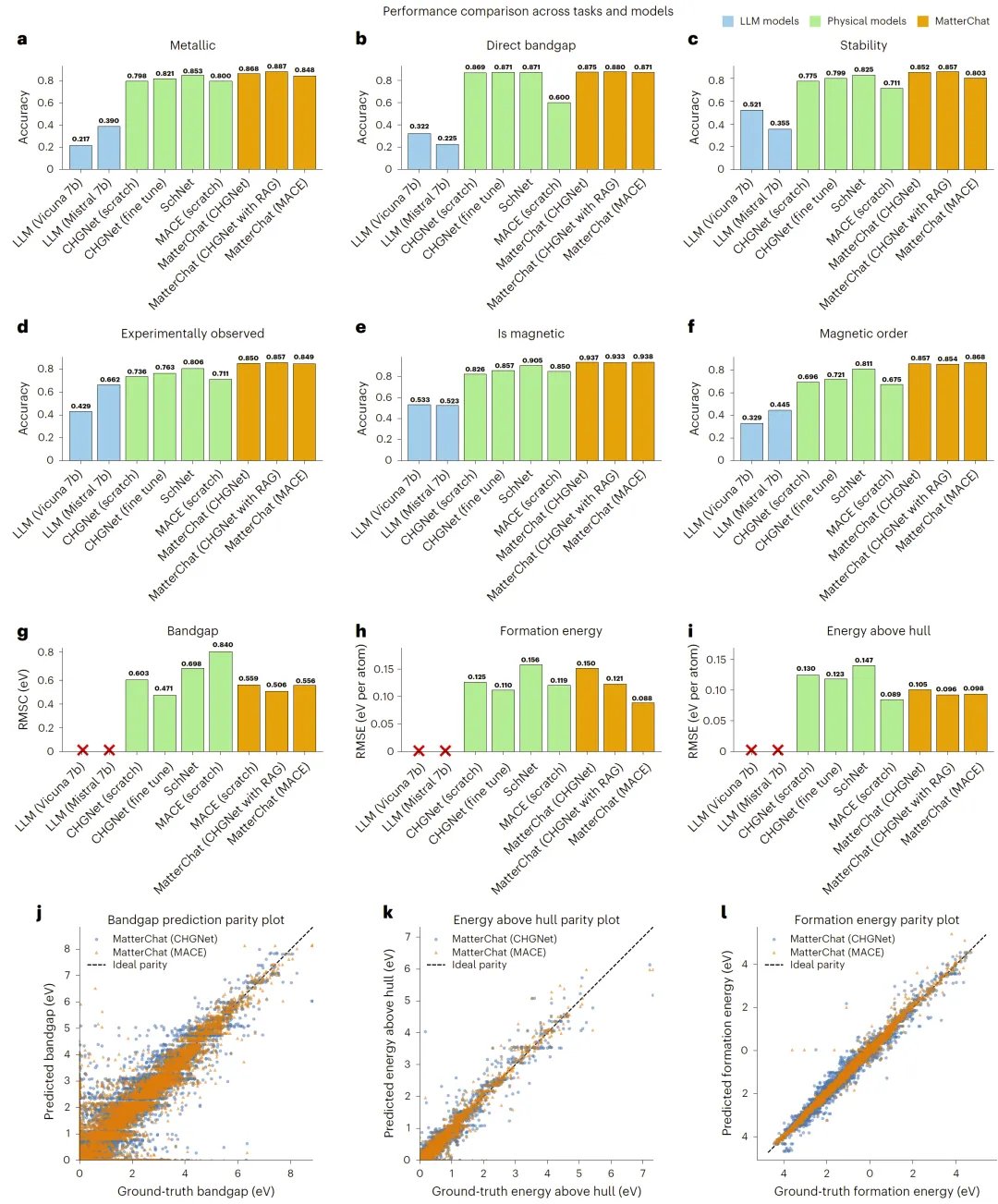

图2:多模态问答与性能对比。

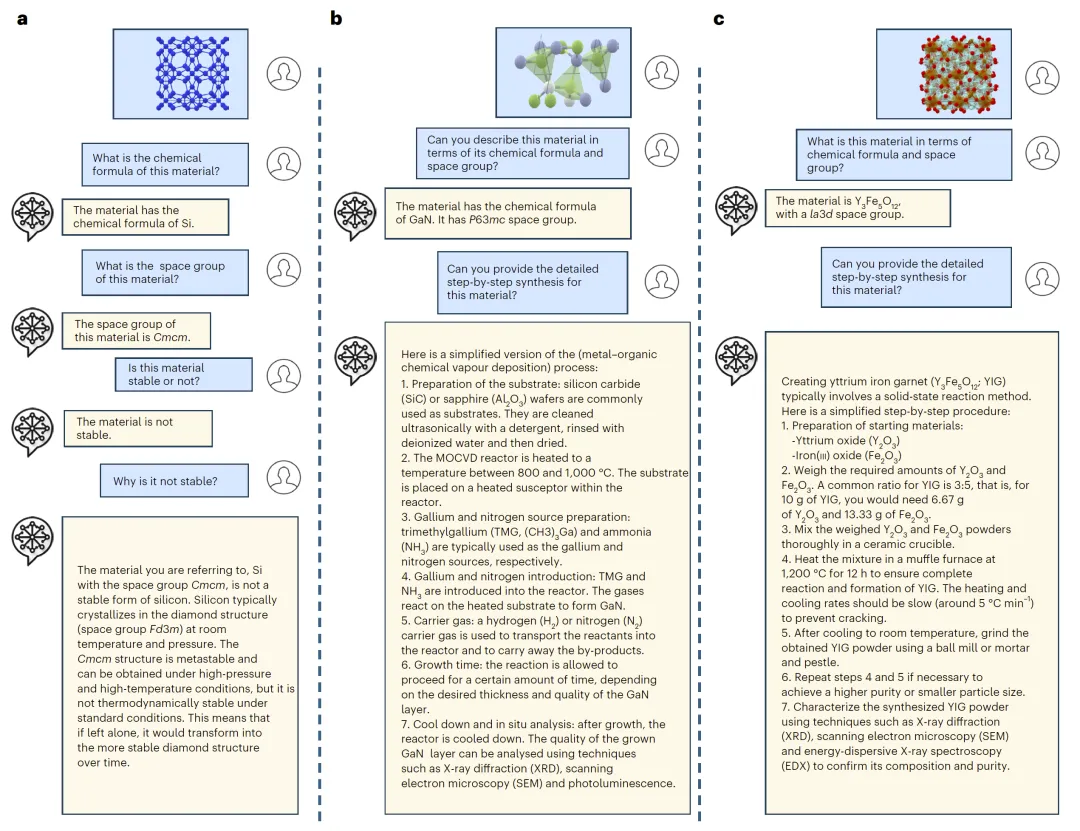

图3:推理与合成过程。

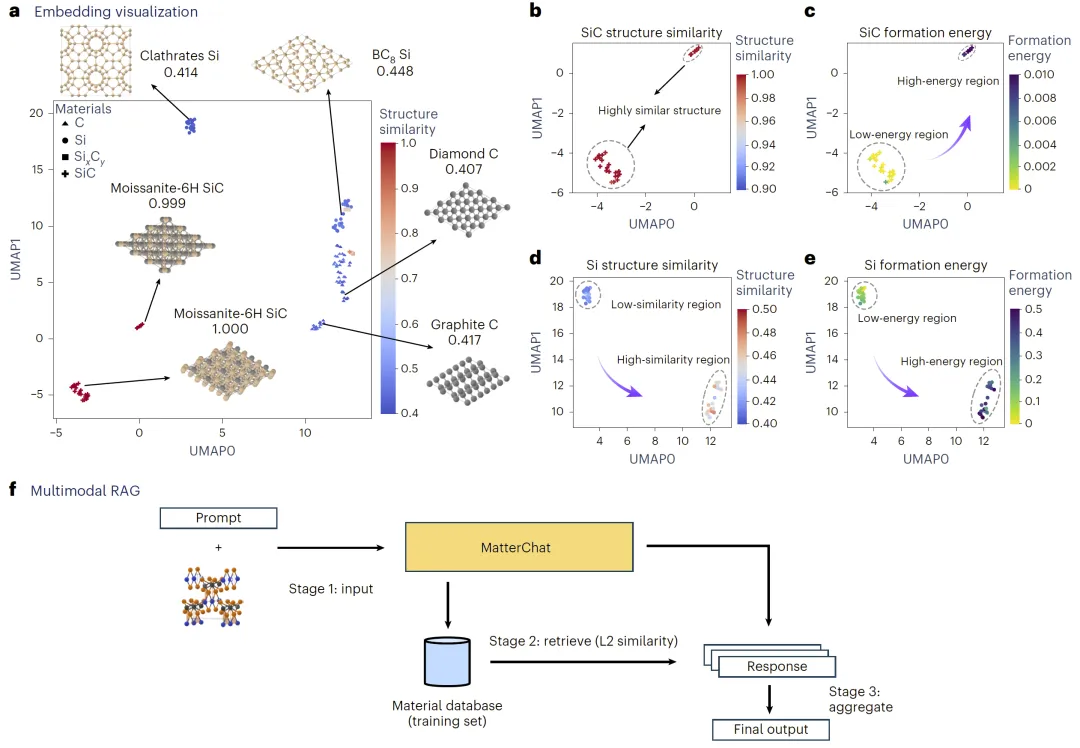

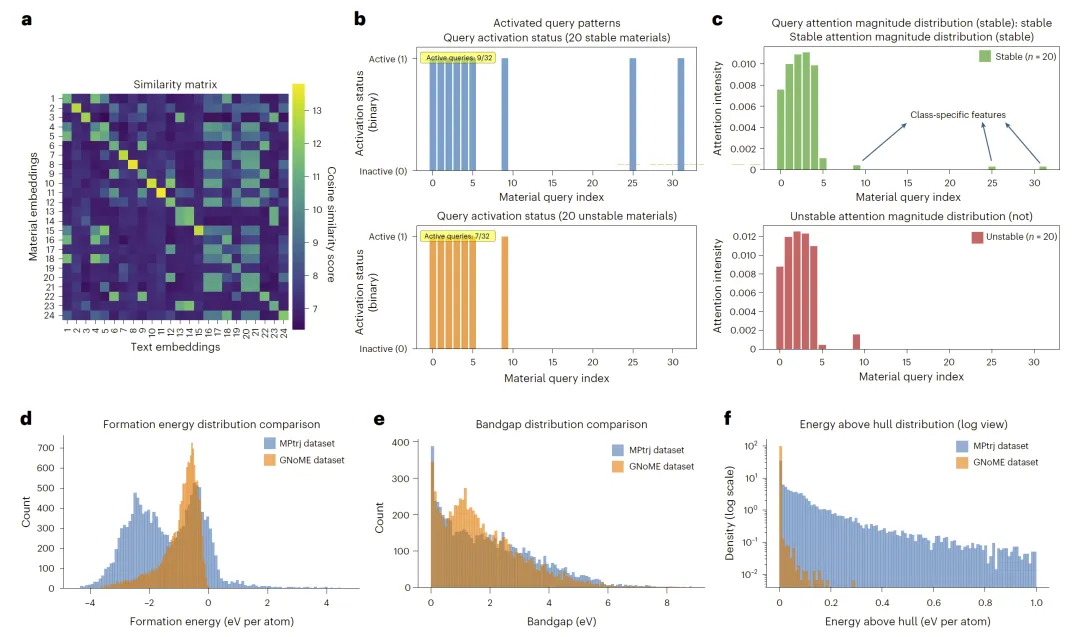

图4:嵌入空间可视化。

图5:性能对比。

图6:注意力与对齐分析。

MatterChat多模态大语言模型,统一处理材料原子结构与文本输入,显著提升了材料性质预测和科学推理能力。从Materials Project数据库中,选取14万余种晶体结构,使用CHGNet和MACE等预训练模型提取原子级嵌入特征,通过可训练的桥接模块,将对齐Mistral 7B大语言模型。训练分为预训练(对比学习、条件语言建模等)和微调两阶段,覆盖化学式、空间群、带隙、自由能等12项任务。实验表明,MatterChat在多项性质预测上超越GPT-4等模型,并能生成材料合成方案。为结构-语言跨模态融合提供了解决方案。

Zhi (Jackie) Yao,劳伦斯伯克利国家实验室 (LBNL) 计算科学与工程中心计算研究部门的研究科学家。2012年浙江大学本科毕业,2017年加州大学洛杉矶分校硕博士,2019年劳伦斯伯克利国家实验室计算科学部博士后。研究领域包括微电子和量子设备/ 电路建模以及电磁学,还运用跨学科训练来研究新型电子的协同设计。

夜雨聆风

夜雨聆风