AI智能的基座:Transformer与自注意力机制,如何让AI突然"开窍"

从”传纸条”到”开群聊”,一场让机器学会”抓重点”的静默革命

开篇:人工智能背后的技术密码

美国收紧对华AI芯片出口,中国把人工智能列为”战略性前沿技术“,砸下数千亿研发资金。一个清晰的信号传遍世界:人工智能,是21世纪大国竞争的主战场。

但有个问题被很多人忽略了:

为什么AI的爆发发生在今天,而不是十年前?

2016年,AlphaGo在围棋上碾压人类冠军,震惊世界。但同一年,你把”胸有成竹”丢给AI翻译,它可能会给你”胸口有根竹子”(chest has a bamboo)。

一个能下出神之一手的AI,却连成语都搞不定?

这种”精神分裂”揭示了一个残酷事实:2017年之前的AI,根本看不懂“语言”。

答案藏在一个晦涩的技术名词里:自注意力机制。

2017年,谷歌研究团队在一篇叫《Attention Is All You Need》的论文里,扔下了一颗”技术核弹”。这颗当时不起眼的火种,在七年内点燃了今天所有大语言模型——GPT、Claude、文心一言、通义千问……

但自注意力到底是什么?它凭什么成为中美科技巨头千亿美元押注的共同底座?

本文将带你走进这场静默革命的核心。理解这项技术,就是理解:

1.AI为什么突然”开窍”了?

2.Transformer为什么会成为现代AI的底座?

3.大国科技竞争到底在争什么?

4.下一代AI会长什么样?

让我们从那个”矛盾时刻”开始——当AI在围棋上展现神级智慧,却连一句人话都说不利索,旧AI到底卡在哪了?

第一部分:老AI的”健忘症”——为什么2017年前的机器”看不懂”人话

要理解自注意力的革命性,得先看看它诞生前的AI世界有多憋屈。

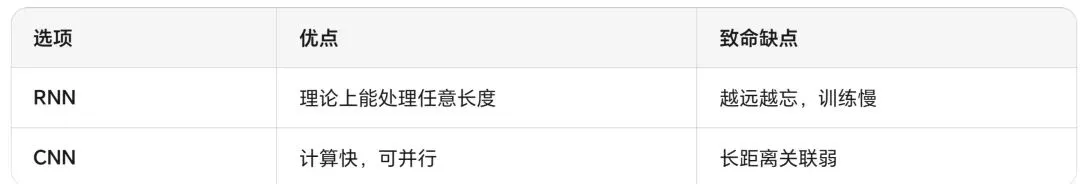

那时候,AI处理文字主要靠两种”老古董”:循环神经网络(RNN)和卷积神经网络(CNN)。它们各有绝活,但都带着致命的结构性缺陷。

1.循环神经网络:一个”传纸条”的健忘症患者;

RNN的设计思路很直观:像人类读书一样,一个字一个字地读。

读到”猫”的时候,它把”猫”的信息写在小纸条上,传给下一个词。下一个词看到纸条,加上自己的理解,再传给下下一个……

听起来合理,对吧?

问题是:这张纸条越传越模糊。

想象你读一本小说。开篇第一段写:”汉斯,一位来自巴黎的退休侦探,性格孤僻但观察力惊人。”

读到第300页,小说写道:”他习惯性地摸了摸腰间——那是他当侦探时养成的习惯。”

人类读者瞬间反应过来:”他”就是约翰,摸腰是因为当过侦探。

但RNN读到”他”的时候,关于”约翰是侦探”的信息,已经在300次传递中被稀释得差不多了。就像传话游戏,第一个人说”苹果”,传到第十个人可能变成”菠萝”。

技术人员叫它”长期依赖消失“——简单说就是越远越忘。

后来出现了LSTM、GRU等”改良版RNN”,给纸条加了”门控”——重要的信息多记一点,不重要的少记一点。但它们没改变本质:必须按顺序传纸条,无法并行,训练慢得像蜗牛。

2.卷积神经网络:一个”视野受限”的拼图玩家

CNN在图像识别领域是大杀器。它的秘诀是”局部连接“——就像用一个小放大镜在图片上滑动,每次只看一小块区域。

这方法对图片很有效,因为一张脸的眼睛和鼻子本来就挨得近。

但语言不是图片。

看这句话:

“那只猫,我们上周在公园里看到的、追着自己尾巴转圈、最后卡在树上的那只橘猫,昨天终于被消防员救下来了。”

“猫”和”救下来”之间隔了20多个字,却是整句话的灵魂关联。

CNN的”放大镜”第一次只能看到”那只猫”三个字。就算层层堆叠,信息也要转好几手才能建立这种长距离联系,效率低、还容易丢。

核心矛盾:效率和效果,只能二选一

在自注意力出现前,AI架构师面临一个艰难的选择题:

更深层的问题是:这两种架构都默认了一个规则——信息传递必须”就近优先“。要么按时间顺序一步步传,要么从小窗口开始慢慢扩大。

但人类理解语言,真的是这样吗?

你读一句话的时候,眼睛会跳跃,大脑会同时激活多个相关记忆。你不会严格从第一个字线性处理到最后一个字。

你理解语言的方式,更像是瞬间把握整体,然后在需要时建立特定联系。

这正是自注意力要模拟的认知过程:扔掉”就近优先“的枷锁,让句子里的任何两个词,都能直接对话,不管隔多远。

第二部分:自注意力——让AI学会”抓重点”

2017年,谷歌的印度裔科学家阿希什·瓦斯瓦尼等人在论文里提出了一个疯狂的想法:

既然”注意力”这么好用,为什么不干脆让注意力成为全部?扔掉递归,扔掉卷积,让注意力包打天下。

一个派对上的秘密

想象你参加一个热闹的聚会。周围同时有:

1.朋友在你耳边讲八卦;

2.远处有人在吵架;

3.DJ放着震耳的音乐;

4.角落里有人在讨论你最喜欢的电影;

你的大脑在做什么?

它不会”一个字一个字”地处理所有声音。相反,它会瞬间扫描全场,自动判断:

1.朋友的声音 → 重要,仔细听;

2.DJ的音乐 → 背景噪音,忽略;

3.角落的电影讨论 → 有点意思,偶尔关注;

这就是注意力——人脑天生就会的“抓重点“能力。自注意力机制,就是教AI做同样的事。

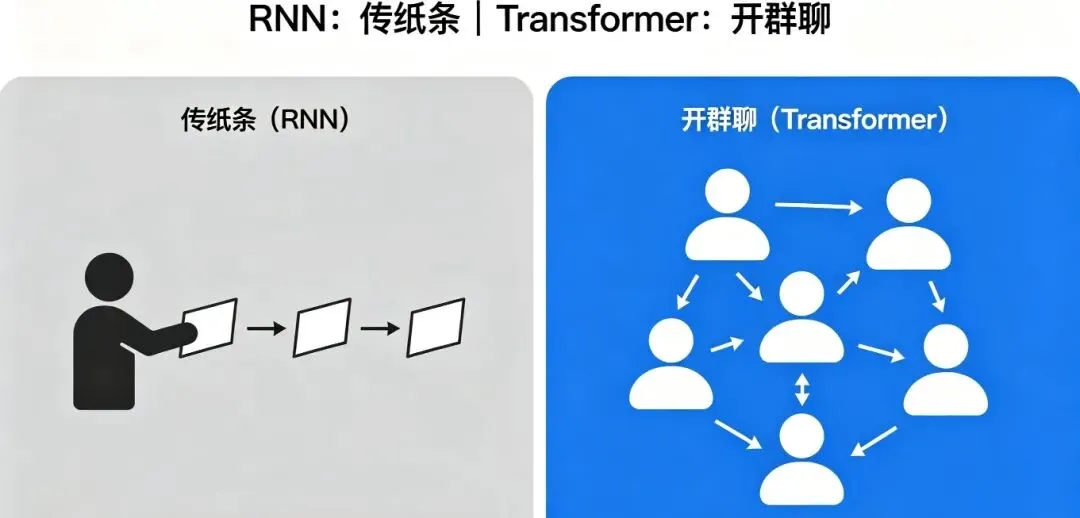

从”传纸条”到”开群聊”

在自注意力出现前,AI处理句子就像传纸条:

第一个人看到词,写在小纸条上传给第二个人,第二个人加自己的理解再传给第三个……传到句尾时,开头的信息早就模糊了。

自注意力彻底换了思路。它不再传纸条,而是开群聊:

句子里的每个词,都同时进入同一个聊天群。每个词都能”看到”群里所有其他词,然后自己决定:我和谁关系最密切?

“它”到底指谁?一个经典测试,看这句有歧义的话:

“The animal didn’t cross the street because it was too tired.”

“it”指什么?animal还是street?

人类秒答:animal。因为街道不会累。

但老AI会懵——”it”和”animal”之间隔了6个词,传纸条早就传丢了。而且”it”离”street”更近,位置模型可能误判。

自注意力怎么做?当AI处理”it”时:

1. 它扫一眼全句所有词;

2. 发现”animal”和”it”语义最相关(动物会累);

3. 直接建立连接——不管中间隔了多少字;

这就是自注意力的核心魔力:距离不再是问题,语义才是标准。

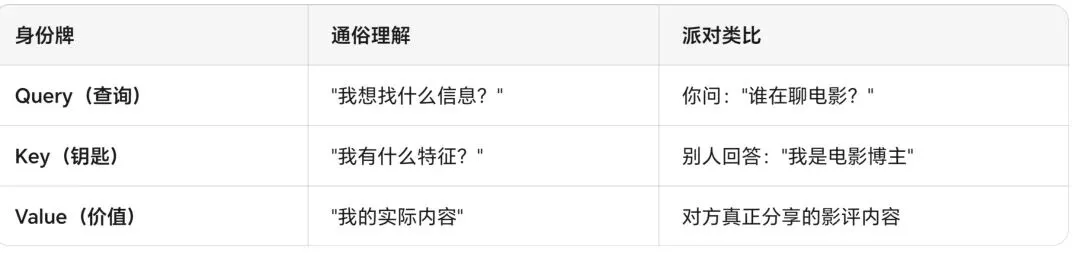

三张”身份牌”:Query、Key、Value

自注意力给每个词发了三张”身份牌”:

计算过程就像一场速配:

1. 每个词的Query,去”问”所有词的Key;

2. 匹配度高的,就多看它的Value;

3. 最后把看到的内容加权混合,形成这个词的”新理解”;

用公式说就是:

注意力分数 = Query × Key(看有多匹配);

最终输出 = 加权平均所有Value(把匹配的内容混合起来);

这个”匹配”用的是点积——你可以简单理解为”两个兴趣越相似的人,聊天越投机”。

多头注意力:同时开8个聊天群

一个词的关系是复杂的。看这句话:

“He opened the bank account to deposit his money.”

“bank”在这里是”银行”,不是”河岸”。怎么判断?

Transformer的解决方案:同时开8个(或更多)聊天群。

1号群关注语法关系(”opened”是动词,”bank account”是宾语);

2号群关注语义搭配(”deposit”和”money”经常一起出现);

3号群关注指代关系(”He”是谁);

最后把8个群的结论拼起来,得到对这个词的立体理解。

就像让8个专家同时分析一句话,每人看一个角度,最后综合意见。这就是多头注意力。

第三部分:为什么自注意力成了现代AI的”底座”?

理解了自注意力怎么工作,现在回答一个更深刻的问题:为什么是它,而不是别的技术,成了今天所有大模型的基石?

革命性一:训练速度快了10倍

RNN最大的痛点是必须按顺序计算。要算第100个词,必须等前99个都算完。这就像工厂里只有一个工人,必须一件一件做。

自注意力彻底打破了这条锁链。

在自注意力中,所有词同时计算。Query、Key、Value可以并行生成,注意力分数可以并行计算,加权求和也可以并行完成。

这些计算本质上都是矩阵乘法——而GPU(图形处理器)有成千上万个核心,最擅长的就是并行矩阵运算。

结果?在Transformer论文中,作者报告训练速度比当时最好的RNN快了整整一个数量级。

这种效率提升,直接让”训练越来越大的模型”成为可能。从1亿参数的BERT,到1750亿参数的GPT-3,再到万亿参数的GPT-4——没有自注意力的并行能力,这一切都不可能。

革命性二:再远的距离,也是”一步直达”

在RNN中,两个词隔得越远,信息传递需要的步骤越多,信号衰减越严重。

自注意力创造了一个”完全连接的群聊“——每个词都直接连接到所有其他词。

无论”猫”和”救下来”之间隔了20个字还是200个字,它们之间的信息传递都只需要一步:通过注意力机制的直接关联。

这意味着:

1.信息不会衰减;

2.关联是双向的(每个词既能”看”前面,也能”看”后面);

3.所有位置对一视同仁,没有远近之分;

对于语言来说,这至关重要。代词和先行词、前提和结论、主题和评论——这些关系经常跨越很长的距离。自注意力让模型能轻松捕捉它们。

革命性三:AI的”黑箱”开了一扇窗

深度学习常被批评为”黑箱”——输入进去,输出出来,中间发生了什么?不知道。

自注意力机制给这个黑箱开了一扇窗。

每次计算,你都能得到一个注意力权重矩阵——一个”谁在看谁“的表格。把它画成热力图,你能直观看到:

1.翻译时,英文的每个词对应关注了中文的哪些词;

2.判断情感时,模型最关注”棒极了”还是”糟透了”;

3.回答问题时,答案的每个部分对应关注了问题的哪些关键词;

这不仅增加了透明度,还能帮助调试。如果模型关注了不该关注的词,说明它学歪了,需要调整。

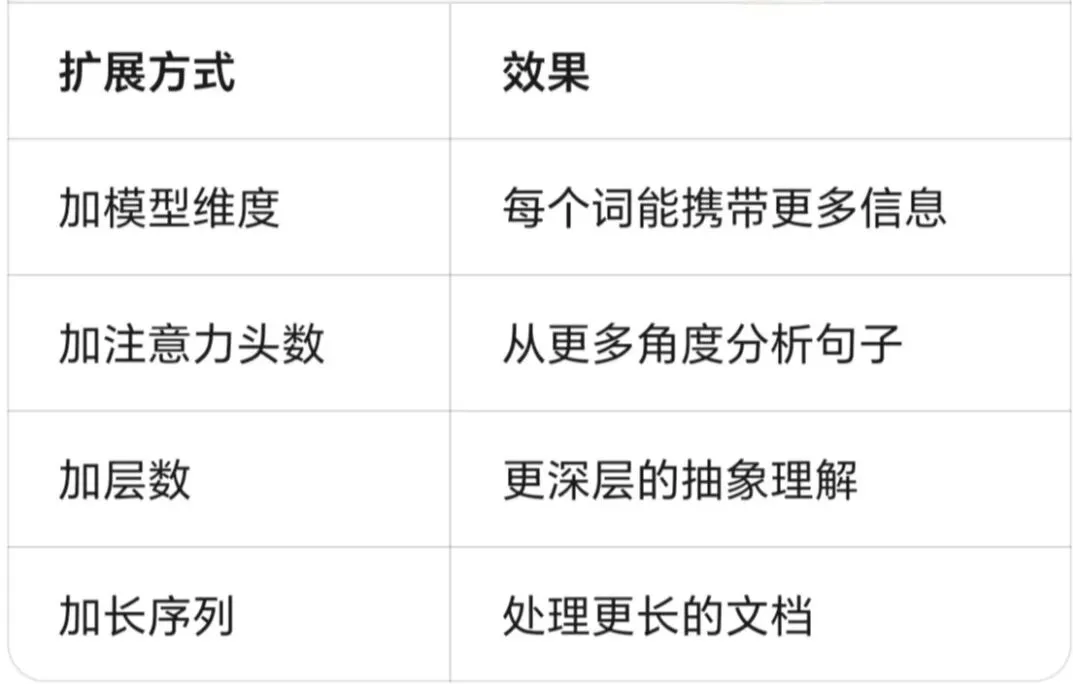

革命性四:越大越强,几乎没有天花板

传统神经网络增加容量的方式很单一:加层数、加神经元。

Transformer通过自注意力,开辟了全新的扩展维度:

更神奇的是,这些扩展在实践中被证明几乎不会饱和——越大越强,越强越好。这直接催生了”缩放定律”的发现:模型性能随规模可预测地提升。

从2018年的BERT-base(1.1亿参数),到2020年的GPT-3(1750亿参数),再到2023年的GPT-4(据传超万亿参数)——这种指数级增长,建立在自注意力提供的可扩展性之上。

第四部分:Transformer——自注意力的”完美载体”

自注意力是一项突破性技术,但它本身不是完整模型。2017年谷歌提出的Transformer架构,把自注意力和其他组件巧妙结合,形成了强大、灵活、可扩展的完整体系。

1.编码器 vs 解码器:一个”读”,一个”写”

Transformer由两部分组成:

1)编码器(Encoder):负责”读”——把输入句子转换成富含上下文信息的表示;

每个编码器层包含两个模块:

多头自注意力:让词与词之间充分交流;

前馈神经网络:对每个词独立做非线性变换,增强表达能力;

2)解码器(Decoder):负责”写”——基于编码器的理解,逐字生成输出;

每个解码器层多一个模块:

编码器-解码器注意力:生成每个词时,回头看输入句子,确保不跑题;

2.位置编码:给无位置感的模型发”座位号”

自注意力有个特性:它不在乎顺序。

你把”猫追老鼠”打乱成”老鼠猫追”,自注意力算出来的关联模式是一样的——因为它只看内容相似性,不看位置。

但语言里,顺序就是一切。”猫追老鼠”和”老鼠追猫”完全是两回事。

解决方案:位置编码——给每个位置发一个独特的”座位号”向量,和词向量加在一起。这样模型就能区分”坐在1号位的猫”和”坐在3号位的猫”。

原始论文用正弦/余弦函数生成座位号,好处是模型能轻松学到”第5个词和第8个词相差3个位置”这种相对关系。

3.残差连接 + 层归一化:防止”深度网络崩溃”

Transformer通常堆叠很多层(比如6层、12层、甚至96层)。训练这么深的网络,梯度容易”消失”或”爆炸”——简单说就是越往深层,信号越弱或越乱。

两个关键技术解决了这个问题:

1)残差连接:每个模块的输出 = 模块本身的输出 + 模块的输入。这就像给信息修了一条”高速公路”,让梯度能直接传回浅层。

2)层归一化:把每层的数值”拉平”到合理范围,防止某些值太大或太小。

用大白话说:残差连接是”抄近路”,层归一化是”踩刹车”,两者配合让深层网络稳定训练。

4.自注意力 vs 其他技术:为什么是”底座”?

1)自注意力 vs MOE(混合专家系统)

MOE是近年来的热门技术,核心思想是”分而治之”——大模型里藏很多小”专家”,每个输入只激活最相关的几个。

关键洞察:MOE不是替代自注意力,而是扩展它。 每个”专家”本身就是一套标准的Transformer块。MOE让模型总参数量突破万亿,但核心计算逻辑还是自注意力。

2)自注意力 vs Mamba(状态空间模型)

Mamba是Transformer最有力的挑战者,用线性复杂度处理超长序列。

为什么自注意力仍是”底座”? 它在表达能力、并行效率、动态建模和工程成熟度之间达到了最佳平衡。整个AI工业——从芯片设计到算法库——已经围绕Transformer优化,这种”生态锁定”短期内难以打破。

5.自注意力的”家族进化”

自注意力本身也在不断进化:

1)稀疏注意力:只关注局部或特定模式,降低计算量;

2)线性注意力:把计算复杂度从平方降到线性;

3)相对位置编码:更好地建模”相隔多远”的关系;

4)可变形注意力:让模型自己学该看哪里;

这些变体不是否定自注意力,而是改进和扩展,进一步巩固了它的基础地位。

第五部分:Transformer之后是什么?中国的机遇在哪?

Transformer统治了AI领域七年,催生了从BERT到GPT-4的突破。但任何技术都有生命周期。下一个”Transformer级”的突破会在哪?中国能扮演什么角色?

1.当前范式的”裂缝”

1)计算复杂度的”平方诅咒”

自注意力的计算量随序列长度平方增长。处理1000字的文档,计算量是500字文档的4倍。对于书籍、长视频、高分辨率图像,这种二次增长很快变成”不可承受之重”。

2)能源黑洞

GPT-4的单次训练耗电量相当于数百个家庭一年的用电量。这不仅烧钱,还引发环境担忧。

3)推理像”挤牙膏”

Transformer生成文本是自回归的——每生成一个新词,都要回头看所有已生成的词。这就像挤牙膏,一次挤一点,实时对话时延迟明显。

4)”世界知识”的盲区

大模型主要靠文本学习,缺乏对物理世界的直观理解。它们擅长关联和模仿,但在逻辑推理、因果推断、物理常识方面仍有明显短板。

2.前沿探索:多条路径并行

1)状态空间模型(Mamba):线性复杂度的竞争者

Mamba用”选择性状态空间”实现了线性复杂度,能处理数万到数十万标记的超长序列,在语言、音频、基因组学等任务上表现亮眼。

关键创新:模型能根据输入内容,动态决定记住什么、忘记什么——一定程度上模拟了自注意力的动态性。

挑战:训练并行性不如Transformer,大规模预训练的表现还需验证。更可能在长序列处理等特定场景取代Transformer,而非全面替代。

2)混合专家系统(MOE):模型规模化的新范式

MOE通过稀疏激活,让模型参数量突破万亿,计算成本仅线性增长。这代表了重要方向:用容量换性能,而非用计算换性能。

3)神经符号AI:让AI学会”思考”

把神经网络与符号推理结合,可能是突破推理瓶颈的关键:

神经定理证明器:把逻辑推理变成可微计算;

程序合成:让模型生成可解释的程序;

分层强化学习:高层规划 + 底层执行;

3.中国的独特机遇

在AI基础架构的全球竞赛中,中国正处于从”应用创新”向”基础创新“转型的关键期。

优势一:全球最复杂的”压力测试场”

中国拥有最丰富、最复杂的数字应用场景:

超高并发的社交媒体:微博、抖音的实时内容处理;

庞大的电商交易:淘宝、拼多多的个性化推荐;

独特的中文语言现象:没有空格分词、古诗词理解、对联创作、古文翻译;

超长文档需求:法律文本、历史典籍、学术论文;

这些场景对AI提出了西方市场不存在的需求。解决这些实际问题的过程中,可能发现通用架构的盲点,催生新的创新。

优势二:强大的工程迭代能力

中国科技产业在”快速原型 → 大规模部署 → 持续迭代”的循环上具有显著优势: 1)从想法到验证的周期短;

2)能同时测试多种架构变体;

3)软硬件协同优化(结合国产芯片定制架构);

4)学术创新快速转化为产品;

优势三:数据资源与政策支持

1)中文是第二大互联网语言,拥有独特的语言结构和丰富的文化遗产;

2)AI被列为国家战略,长期投入有保障;

3)庞大的STEM毕业生群体和活跃的研究社区;

4.中国需要补的课

从”解决眼前问题”到”探索未知可能”

中国AI在应用层面表现出色,但基础架构的突破仍需积累。需要:

1)鼓励高风险、高回报的探索,容忍”无用”的基础研究;

2)建立长期评价体系,不单纯以短期论文或产品衡量价值;

3)加强学术自由度,允许研究者追随好奇心;

构建”好奇心驱动”的研究生态

Transformer诞生于谷歌的”蓝天研究”文化——源于对机器翻译基础问题的纯粹好奇。中国需要:

1)保护研究多样性,支持与主流不同的技术路径;

2)加强跨学科交叉:AI与数学、物理、神经科学、认知科学的深度结合;

3)参与全球基础对话:不仅跟进热点,更要提出新问题、新方向;

在现有范式的”裂缝”中寻找突破

完全从零创造新架构很难,但在现有局限处创新是可行路径:

5.展望:创新生态的成熟之路

贡献下一个”Transformer级”的突破,需要的不只是技术天才,更是创新生态系统的成熟:

1)基础研究的耐心投入:支持5-10年期的长期项目,建立专注基础研究的实验室;

2)开放协作的学术文化:加强国内外交流,推动开源开放,减少”唯论文”倾向;

3)产业与研究的深度结合:企业的长期研究投入,学术界对真实问题的深入理解;

4)包容失败的创新环境:接受基础研究的高失败率,鼓励非常规、反直觉的路径

第六部分:结语——关联即智能,连接即理解

自注意力机制和Transformer架构的成功,揭示了一个关于智能本质的深刻洞见:

智能可能并非源于复杂的规则或精妙的算法,而是源于简单的连接,以及在这些连接中涌现出的模式。

1.自注意力的哲学启示

1)全局优于局部

理解任何元素,都需要把它放在整体背景中。一个词的意义由它在句子中的位置决定,一个句子的意义由它在段落中的角色决定。这种整体论视角,挑战了传统的”拆碎了分析”的还原主义。

2)动态优于静态

自注意力中的关联是动态计算的,取决于具体输入。这与传统的固定特征提取器形成鲜明对比。真正的理解是情境化的、适应的、灵活的。

3)关系先于实体

在自注意力中,元素的意义不是内在固有的,而是在与其他元素的关系中定义的。这与系统思维的核心观点共鸣:实体由关系定义。

4)简单催生复杂

自注意力本身是一个相对简单的计算过程——点积、softmax、加权求和。但从这个简单过程中,涌现出了语言理解、代码生成、推理规划等复杂能力。

这体现了复杂系统科学的核心理念:复杂行为可以从简单规则的迭代中涌现。

2.技术进化的轨迹

从技术史看,自注意力的成功是计算范式演进的必然:

3.人机关系的再思考

自注意力和大模型的发展,迫使我们重新思考人与机器的关系:

1)互补而非替代:AI擅长发现统计模式,人类擅长理解意义和价值;

2)理解”理解”:当AI能生成流畅文本、通过专业考试时,我们需要重新审视”理解””智能””意识”的定义;

3)责任与对齐:如何确保AI的价值观与人类一致,如何防止滥用,成为亟待解决的问题;

4.未来之路

自注意力开启了AI的新纪元,但这只是开始:

1)多模态融合:真正的智能需要整合视觉、听觉、触觉等多种模态;

2)推理与规划:结合符号推理与神经计算,突破当前模型的推理瓶颈;

3)效率与可及性:让大模型更高效、更易获取,是技术民主化的关键;

4)具身智能:让AI连接物理世界,感知、行动、交互;

5)理论理解:我们对大模型为何有效、如何工作、有何局限,理论理解仍然滞后;

最后,想象这样一个场景:

此刻,当你读完这篇文章,全球有数亿人和AI正在进行对话。每一次对话的背后,都有数万亿个”词”在”开群聊”——它们在毫秒间互相打量、匹配、关联、综合,最终涌现出一句通顺的回答。

这就是自注意力机制每天在做的事:让机器在万物关联中看见模式,在模式之中创造意义。

它让我们向智能的本质,迈进了关键的一步。

而旅程,才刚刚开始。

👍 喜欢这篇文章,欢迎三连支持:

· 点赞 | 评论 | 转发朋友圈

夜雨聆风

夜雨聆风