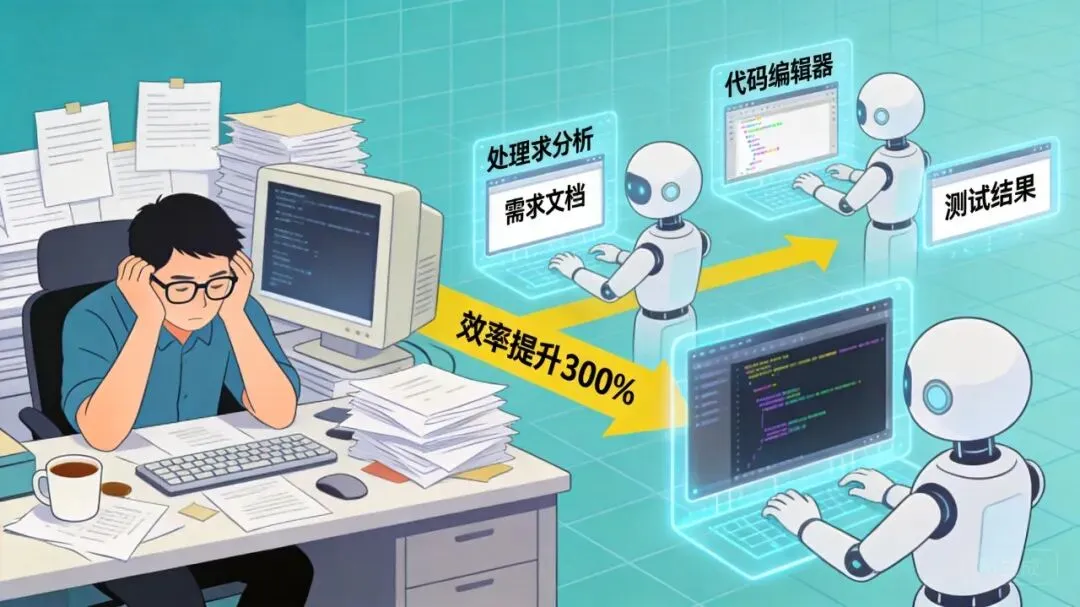

66%效率提升!多智能体重塑软件开发模式,开发周期从7天缩至2天

你有没有算过,团队里一个中等规模的需求,从立项到上线要多久?

去年我们做过一次统计,一个典型的电商支付模块开发,前后端加测试,7天算是快的。需求评审占1天,后端开发2天,前端对接1.5天,联调测试再搭进去2天。大家忙得脚不沾地,但效率就是上不去。

最近半年,这个数字变了。

同样是支付模块,同样的人数,有团队把周期压缩到了2天。不是靠加班,不是靠压需求,靠的是多智能体协作。

多智能体协作,到底在协什么?

先说一个容易混淆的事。”多智能体”不是”多个AI聊天”。你开三个ChatGPT窗口一起问问题,那不叫多智能体协作。

真正的多智能体协作,是有角色分工、有工作流程、有信息传递机制的。每个Agent扮演一个特定角色,比如一个负责需求分析,一个负责写代码,一个负责跑测试。它们之间能对话,能共享上下文,能根据彼此的输出调整自己的工作。

说白了,就是模拟一个真实的开发团队。只不过这个团队24小时不休息,不会因为沟通成本浪费时间,也不会在需求理解上出现偏差。

效率是怎么提上来的?拆开来看

我跟踪了几个实际落地案例,发现效率提升主要集中在三个地方:

第一,需求分析的时间被大幅压缩。传统流程里,产品经理写PRD,开发看PRD,两边经常因为理解不一致来来回回。用多智能体框架后,需求分析的Agent可以直接输出结构化的技术方案,包括接口定义、数据模型、边界条件。开发拿到手就能干活,沟通成本几乎归零。

第二,编码阶段变成了并行作业。以前后端写完API前端才能开始对接,现在编码Agent可以同时生成前后端代码。MetaGPT、CrewAI这些框架都是这个思路——产品经理Agent输出需求,架构师Agent出设计,工程师Agent写代码,全串起来自动跑。一个电商平台的数据看板需求,以前3个人干4天的活,现在一个多智能体系统半天就能出初版。

第三,测试反馈的周期从”天”变成了”分钟”。代码写完,测试Agent立刻跑单元测试、集成测试,发现问题直接打回给编码Agent修改。这个闭环不需要人工介入,几轮迭代下来,代码质量反而比人工review更稳定。

66%的效率提升,靠的到底是什么?

听到”效率提升66%”这个数字,第一反应可能是 skeptical。说实话我也怀疑过。但看完具体的数据对比,我觉得这个数字是可信的。

一个做金融数据平台的技术负责人跟我分享,他们用AutoGen搭建了一套多智能体开发流水线,主要处理的是数据清洗和报表生成的需求。以前这类需求平均开发周期是5-7天,用上多智能体后稳定在2天左右。

关键在于,省掉的不是写代码的时间,而是”等”的时间。等需求确认、等接口文档、等联调、等测试环境——这些隐性成本加起来,往往占了总周期的一半以上。多智能体把这些串行等待变成了并行处理,效率自然就上去了。

但话说回来,也不是所有场景都适合多智能体。简单到写个脚本、改个配置,用不着搞这么复杂。真正发挥价值的,是那些跨角色、多步骤、有一定复杂度的开发任务。电商的支付流程、金融的数据管道、企业内部的中台系统——这些才是多智能体的主战场。

现在入场,怎么选框架?

2026年这会儿,多智能体框架已经百花齐放了。简单说几个我用过或者调研过的:

CrewAI适合快速搭建原型,几行代码就能跑起来,角色定义也很直观,适合小团队试水。AutoGen微软出品,智能体间对话机制做得好,复杂协作场景优先考虑。MetaGPT最吸引人的地方是”一句话出全套方案”,产品经理到工程师全模拟,适合从需求直接到代码的场景。LangGraph适合需要精细控制工作流的团队,图结构可视化调试体验不错。

选哪个?我的建议是别纠结,先拿CrewAI跑一个demo试试。跑通了再根据实际需求换框架,成本不高。

别急着把团队裁了

聊多智能体的时候,总有人问”那开发人员是不是要失业了”。我觉得这个问题想偏了。

多智能体协作提升的是”开发”这个环节的效率,但软件开发不只是写代码。理解业务、做架构决策、处理线上事故、跟客户沟通——这些目前AI干不了,短期内也干不好。

更现实的变化是,开发者的角色会从”写代码的人”变成”指挥AI干活的人”。你得会设计工作流,会定义Agent的角色和边界,会review AI的输出并做决策。这个能力模型跟现在不一样,但不是说不需要人了。

我的判断是,未来1-2年内,能用好多智能体的团队效率会甩开不会用的团队一大截。这不是危言耸听,而是已经开始发生的事实。

如果你还没试过,建议这周就找个小项目跑一下。不需要多复杂,就用CrewAI搭一个”需求分析→编码→测试”的三Agent流水线,跑一个真实需求看看效果。光看文章是没感觉的,得自己动手才知道这东西有多香。

夜雨聆风

夜雨聆风