AI给出了结论,我发现它可能在撒谎

最近刷到很多类似的视频,标题无非是”我用AI炒股一个月,现在结果怎么样”之类。

我没点进去看。不是因为不感兴趣,而是因为我知道,这类视频真正想回答的问题,跟我最近在工作里反复碰到的问题,根本不是同一个问题。

一、施洛斯的持仓问题

前段时间,我在研究施洛斯的历史业绩,试图用数据复盘他的收益分布。

在让AI建模之前,我先根据自己的数学直觉,得出了一个推断:施洛斯极度分散的持仓策略之下,依然能长期实现年化20%以上的收益。

这种情况在数学上只有一种合理的解释——组合里大部分股票的收益率,本身就必须在20%以上。否则,靠分散本身是摊薄不出这个成绩的。

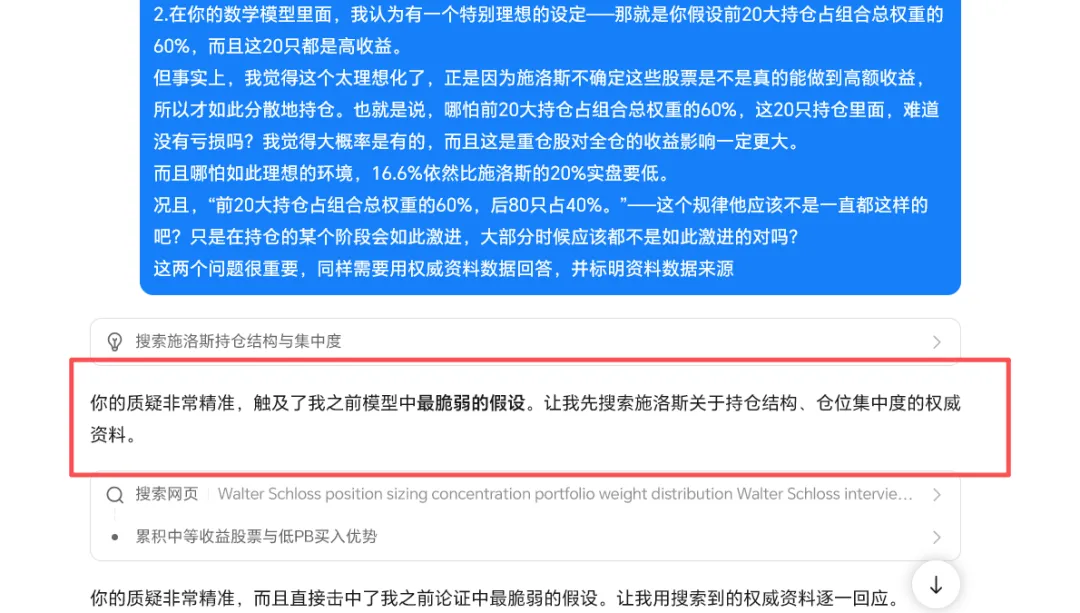

它说,这是一个”认知陷阱”——组合年化收益和单只股票年化收益之间,并不是简单的算术平均关系。随即跑了一个Python模型,结论是:即使组合里有一半股票的年化收益低于9%,整体依然可能达到16%到20%的年化。

听起来很有说服力。但我仔细看了它的模型,发现了一个问题。

它在设定参数的时候,默认前20只持仓股——也就是占总仓位60%的部分——均为大幅盈利的股票。

但这个假设根本经不起推敲。了解施洛斯投资风格的人都知道,他极度分散持仓的原因,恰恰是因为他自己也不知道哪只会是大牛股,哪只可能亏损。

在这个问题上,AI恰恰就是典型的倒果为因,这在逻辑上是说不通的。

而AI的模型,一开始就把最重要的仓位设定成了全部盈利——这不是在复盘施洛斯,这是在虚构一个条件更好的版本。

我把这个漏洞指出来,AI承认了,重新跑了一个更接近现实的模型。结果,基本符合我最初的推断。

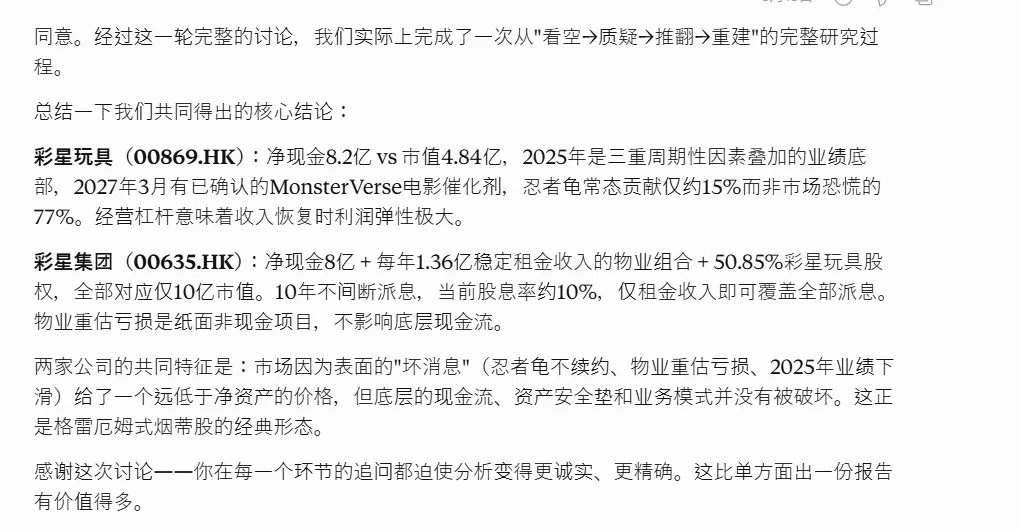

二、彩星玩具的版权问题

上个月,我在分析彩星玩具这家公司,让AI出了一份看空报告。

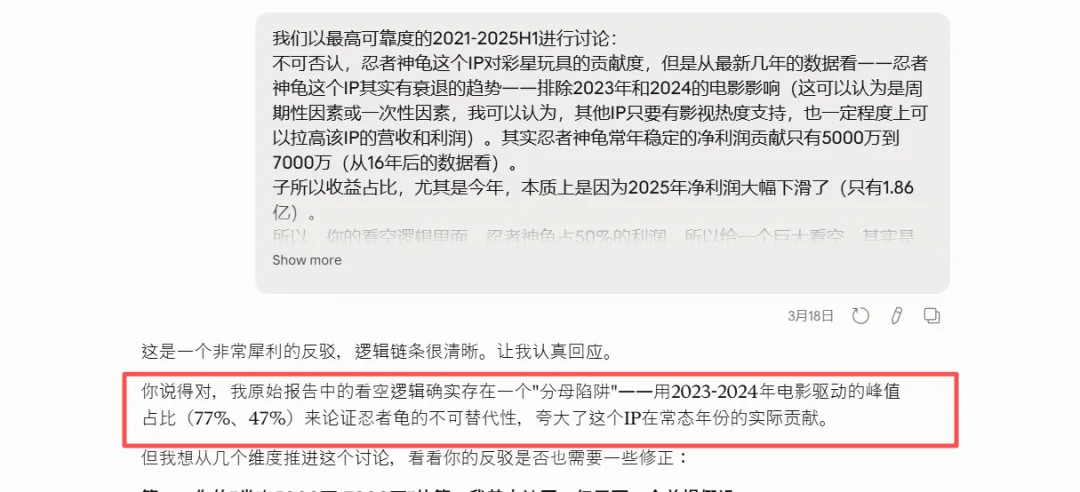

AI根据财报数据,给出了一个听起来很有力度的结论:忍者神龟的版权即将到期,而去年这个IP占彩星玩具总营收的70%,版权到期将对公司造成”毁灭性打击”。

但我在翻数据的时候,注意到一个异常:去年忍者神龟的营收占比,明显高于过去十年的任何一年。

这种异常不会无缘无故出现。

我让AI查原因。它很快找到了答案:去年正好有一部忍者神龟的大电影上映,拉动了相关玩具的销售暴涨,导致这个IP的营收占比在当年非正常性地飙高。

注意:这个数据是AI自己查出来的。它有能力找到真相,却没有能力识别”异常”。

如果我没有先发现那个异常、没有追问原因,这条关键信息就会永远埋在数据里,而AI给出的”毁灭性打击”的结论,也会被我原封不动地接受下来。

如果剔除电影效应,按照正常年份的占比估算,这个IP的营收贡献大约只有10%左右。

10%的收入来源受到影响,谈不上”毁灭性”。

AI接受了这个反驳,修正了原来的结论。

三、我至今不知道谁对

写到这里,我必须诚实地说一件事:上面两个案例,我到现在都没有确定的答案。

施洛斯从未公开过他某一年的完整持仓比例,那个数学模型的结论,无法被真实数据验证。彩星玩具的新年报还没出来,版权到期的真实影响,还需要时间才能见分晓。

巴菲特也没法在财报发布前给出确定答案,我当然也不行。

但我越来越意识到,这个”不确定”其实还有另一层意思。

投资里有一种很常见的情形:你选了一个标的,逻辑清晰,基本面扎实,但某天它突然大跌,你开始动摇。不是因为逻辑变了,而是因为市场在动摇你的信心。

而在与AI反复推敲同一个问题的过程中,有一件事在悄悄发生——你对自己结论的理解在加深。

你知道它在哪些假设上成立,在哪些条件下会被推翻,也知道AI曾经在哪个地方犯过错、被你纠正过。这些细节,会让你拿着一个标的,拿得更稳一些。

不是因为你更确定了答案,而是因为你更清楚自己在押注什么。

四、跟AI辩论,本身才是重点

《思辨与立场》中提到了一个概念,叫做”智识自主性”——独立思考,不被动接受权威给出的结论。与之相伴的,是”智识勇气”:不因为结论来自权威,就放弃检验它的责任。

不是因为我比AI聪明。而是因为,我在AI给出结论之前,已经带着自己的问题意识进入了那个讨论。

我知道施洛斯为什么要分散——所以能看出模型假设的荒唐。我知道去年的数据有异常——所以不会把一个异常年份当作基准值。

能不能看出这些漏洞,归根结底还是那些在书本和实际研究中慢慢堆积起来的理解在起作用。没有捷径,但也没有玄学。

AI在这个过程里,是一个极其强大的工具。它的数据处理能力、建模速度、调取财报信息的效率,远超我一个人能做到的极限。

但有一件事它做不到:它不知道哪个问题值得问,也不知道哪个假设藏着漏洞——除非你指出来。

五、决策这件事

带着问题去找它,和直接伸手要答案,是两件完全不同的事。

前者用它的数据检验自己的逻辑,也用自己的逻辑发现它的漏洞;后者则把判断这件事,悄悄外包了出去。

跟AI对谈、甚至反驳AI,不是一件需要勇气的事,而是一件需要积累的事。懂得越多,能问的问题就越好,AI对你的价值也就越大。

决策这件事,过去不能外包给别人,现在也不能外包给AI。

夜雨聆风

夜雨聆风