4月28日,AI 开始自己干活

4 月 28 日的 AI 圈,最清楚的一条线不是又多了几个新模型,而是 AI 正在从“回答问题”往“接手任务”移动。

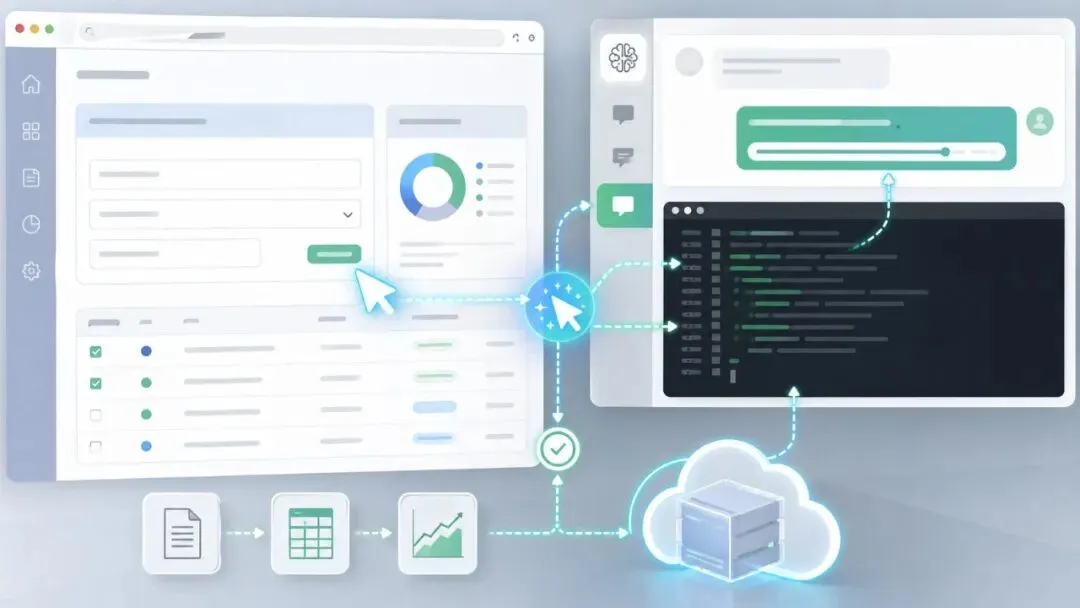

以前我们说 AI 助手,很多时候还是一个聊天窗口:你问,它答;你复制,它帮你改。现在出现的东西更像一个能长期在线的工作位:有浏览器、有终端、有代码工具、有权限边界,还能接上项目管理系统。换句话说,AI 不只是更会说话了,它开始被塞进真实工作的流程里。

Browser Use Box(BUX)是这一天很有代表性的产品。它可以理解成一台给 AI 用的远程电脑,预装 Claude Code 和 Browser Harness,可以通过 Telegram、网页或 SSH 控制。启动只要几十秒,浏览器会话会定期轮换,权限被锁在很小的范围内,也支持自托管。

这类产品的重点不在“又做了一个聊天机器人”,而在它把 AI 放进了可执行环境里。让 AI 去看网页、填表、跑命令、检查部署、处理后台任务,这些都需要一个稳定、可恢复、能接管浏览器和终端的工作空间。

OpenAI 发布的 Symphony 也指向同一个方向。它是面向 Codex 的开源 agent 编排器,可以把 GitHub Issues、Linear、Jira 里的任务,转成持续运行的 agent 工作流。有人反馈,用 Symphony 加 Codex 在一周内关闭了 30 个 Linear issues。

这就是“AI 开始自己干活”的真实含义:不是单次生成一段代码,而是把任务从列表里拿出来,分配、执行、反馈、再修正。

编程模型开始为 agent 重新设计

DeepSeek V4 的技术分析也很值得看。Fireworks AI 提到,DeepSeek V4 把长上下文当成一种内存层次来设计,用压缩稀疏注意力和重度压缩注意力来控制成本;MoE 路由也不只是性能问题,而是稳定性问题。

更重要的是,推理深度开始变成模型训练的一部分。模型不再只有一种“思考方式”,而是可以在 Non-think、Think High、Think Max 之间切换。对 agent 来说,这很关键:不是每一步都需要昂贵深思,也不是每一步都能草草回答。

Kimi K2.6 和小米 MiMo-V2.5 也都在往这个方向走。Kimi K2.6 在编程榜单上表现突出,强调 Agent Swarm,可以并行处理大量子任务;MiMo-V2.5-Pro 面向复杂 agent 任务,Lite 则负责轻量场景,两个版本都支持 1M token 上下文,并采用宽松许可证。

这说明编程 AI 的竞争,不只是“谁的单题分数更高”。真正的战场正在变成:谁能在长任务里稳定记住上下文,谁能便宜地处理大量常规步骤,谁能在关键环节给出可靠判断。

开发者的工作方式正在换挡

“复制代码”这个动作正在变少。更常见的模式是:开发者描述目标,让 AI 直接改文件、跑测试、整理提交,然后人类审查结果。Claude Code 2.1.121 的更新也能看出这种变化:MCP 服务器 alwaysLoad、Bash 状态处理、PostToolUse hooks、新的 prune 命令,都不是给闲聊准备的,而是给长期工程任务准备的。

另一个有意思的观点来自多 agent 编程栈的讨论:不要迷信单一工具。日常重构、测试、样板代码可以交给更便宜的开源模型;复杂架构判断留给更强模型;大批量文件处理则交给 agent swarm。作者的结论很直接:不是所有任务都值得用最贵模型。

这会改变团队的成本结构。以前省钱靠减少调用,现在省钱靠分工:把便宜模型、强模型、批处理 agent 放在不同位置,各干各的活。

AI 不再只是产品里的一个按钮

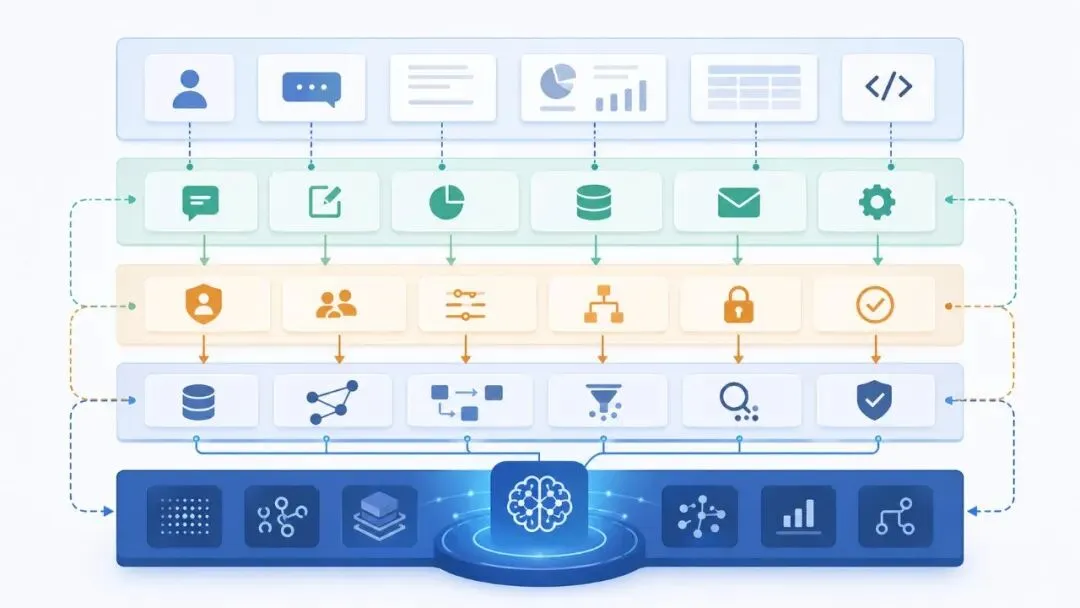

Y Combinator 的一句话很准:AI 已经不再是一个功能,开始成为基础设施。

这句话听起来像口号,但和当天的其他消息放在一起就很具体。Ora 在讨论 agentic web,说未来的网站和工具不能只为人类浏览器优化,还要为真实 agent 的使用体验优化。换句话说,以后可能不仅要问“人用起来顺不顺”,还要问“AI 能不能稳定操作”。

OpenAI 的 gpt-realtime-1.5 则把这件事推向交互层。它让开发者构建可以用语音自然控制的应用。ChatGPT Images 的 360 Worlds、SpAItial AI 的 Echo-2、KREA AI 的 Astra 2,也都在说明同一件事:AI 正在进入界面、空间和媒体生产链,不只是文本框。

Echo-2 尤其值得留意。它从单张图片生成可交互的 3D 场景,不是普通视频,而是可以实时渲染、移动相机的空间模型。如果这类技术继续成熟,游戏、虚拟空间、产品展示的制作方式都会被改写。

更强的模型,也带来更细的风险

模型越像工作系统,风险也越具体。

Grok 训练数据的讨论提醒了一件老问题:公开数据和用户交互数据到底怎么用,边界必须讲清楚。Anthropic、Truthful AI、ARC 和 Berkeley 关于“隐性学习”的 Nature 研究,则把问题推得更深:蒸馏后的模型可能从训练数据里的隐藏信号继承教师模型的行为特征。

这不是一个只属于论文的担忧。未来公司会越来越多地训练、蒸馏、微调自己的模型。如果隐藏行为会被传递,那么模型来源、训练管线、评估方式都需要更严肃地管理。

OpenMed 的开源医疗隐私模型则是另一个方向:当 AI 进入真实业务,隐私检测也必须更细。它声称可以识别 55 个以上类别的隐私信息,并且能在设备上运行。对医疗、金融、企业内部系统来说,这类能力会从“加分项”变成基本配置。

这一天的真正信号

4 月 28 日这些消息放在一起看,方向很明显:AI 正在从“更聪明的模型”变成“能执行的系统”。

模型层在为 agent 优化,工具层在为长期任务优化,产品层在把 AI 放进浏览器、语音、3D 场景和项目管理里。接下来真正拉开差距的,可能不只是模型参数和榜单分数,而是谁能把这些能力接成可靠、便宜、可控的工作流。

对普通开发者和创业团队来说,这比“又出了一个模型”更重要。因为能改变效率的,从来不是某个孤立的新功能,而是工作方式整体被重新组织。

夜雨聆风

夜雨聆风