AI模型会"自信"地说错话?Transformer架构里藏着一个监控盲区

🤖 AI模型会”自信”地说错话?Transformer架构里藏着一个监控盲区

你有没有遇到过这种情况:问AI一个问题,它回答得特别笃定,你差点就信了。

结果一查,错了。

更气人的是,这个AI当时”信心满满”——输出概率贼高,一副”我肯定对”的样子。

这不,最近一篇新研究就专门研究了这个现象。

结论很有意思:**模型自信,不代表它真的对。**

而且更扎心的是——你可能根本没法从外部监控发现它说错了。

01 模型在”睁眼说瞎话”这件事上,是专业的

先说个背景知识。

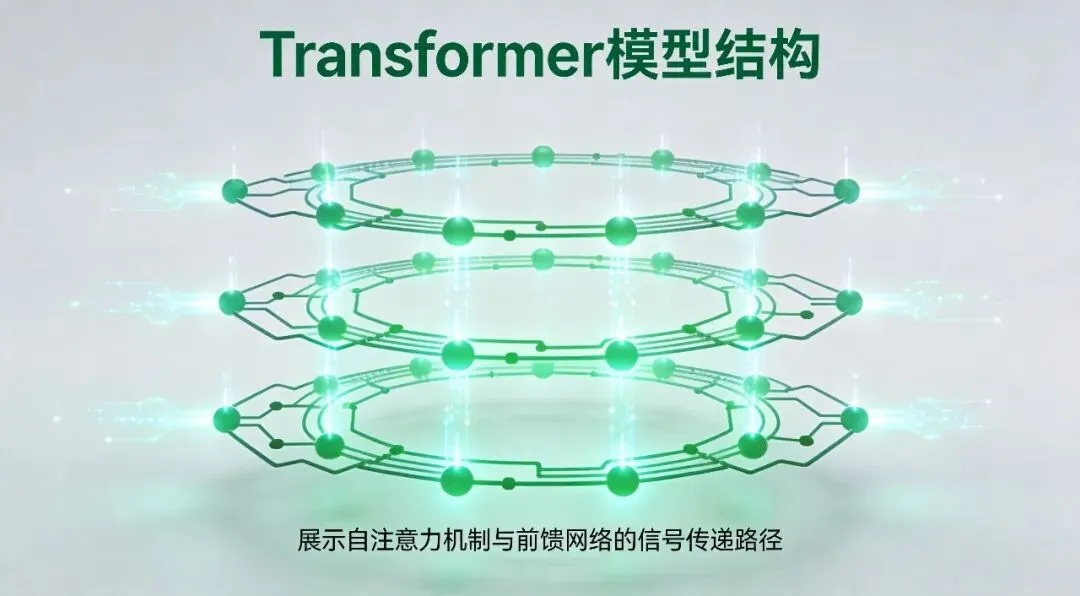

咱们现在用的AI,大多是Transformer架构。它们有个特点:会输出一个”置信度”分数,简单理解就是”我多确定我答对了”。

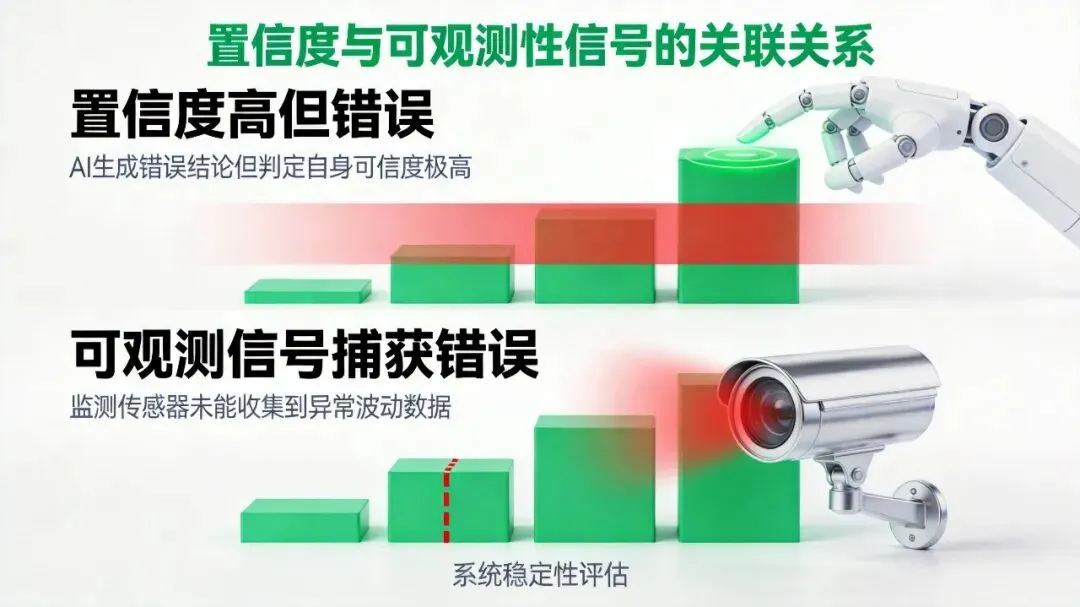

正常逻辑是:置信度高 → 答对的概率大 → 置信度低 → 答错的概率大。

这个假设听起来很合理对吧?

但这篇论文的作者Thomas Carmichael发现,事情没那么简单。

AI确实会在”答错”的时候表现得很自信。但问题在于——

置信度高不代表真的对,置信度低也不代表一定错。

更麻烦的是,你想从外面监控它、发现它犯错?研究发现,某些模型的内部根本不保存”我可能错了”这个信息。

就像一个人说话的时候,嘴巴在输出,但脑子里的”自我纠错部门”已经被关掉了。

02 一个关键概念:可观测性(Observability)

这篇论文提出了一个核心概念,叫可观测性。

翻译成人话就是:从模型中间层的激活状态,能不能读出”这个回答质量怎么样”。

你可以理解成:模型内部有个”质检部门”,正常情况下,这个部门的意见能从中间层的信号里读出来。

但研究发现,质检部门的存在与否、能不能正常工作,取决于——

模型架构和训练配方。

不是所有模型都有这个质检部门。有些模型训练着训练着,这个部门就被”优化”掉了。

03 一个让人震惊的发现

研究团队测试了6个模型家族、13个不同的模型。

他们发现:置信度这个单一指标,会掩盖57.7%的”真实决策质量信号”。

啥意思?

就是说你本来以为看置信度就能判断模型表现,但实际上这玩意儿只能反映不到一半的情况。

剩下的”信号”呢?藏在模型内部,你需要用特殊的”探针”才能读到。

但问题来了:

有些模型的内部,根本没有保存这些信号。

无论你怎么探测,都读不出来。

04 一场大型”对照组实验”

研究团队用Pythia这个模型做了对照实验——这是学术界专门设计来研究训练过程的数据集,所有模型都在相同条件下训练,方便比较。

他们测试了8种不同的架构配置:

- 6种配置:可观测性指标正常,保持在0.21到0.38的健康区间

- 2种配置:直接崩溃到0.10左右

关键来了:这崩溃的2种配置,都是24层、16头的配置。

参数规模差了3.5倍,训练数据也不同,但只要是这个配置,可观测性全部崩溃。

这说明什么?

不是训练的问题,是架构配置本身的问题。

而且更诡异的是:模型在训练早期是能读出”我可能错了”这个信号的。

但在训练过程中,这个信号被慢慢抹掉了。

05 跨家族验证:同样的规模,不同的命运

为了验证这个结论,研究者还测试了真实世界的主流模型。

结果很有意思:

Qwen 2.5 vs Llama 3B

同样的30亿参数规模,可观测性相差2.9倍。

Qwen保持了清晰的质量信号,Llama直接”眼瞎”。

Mistral 7B vs Llama 3.1 8B

看起来架构差不多,但Mistral保留了可观测性,Llama 3.1却崩溃了。

你说气人不气人?

这说明啥?

模型大小、参数规模,都不能预测可观测性。

决定性因素是:架构配置 + 训练配方怎么配合。

06 这个发现为什么重要?

好,你可能问:这跟我有啥关系?

关系大了。

现在各行各业都在用AI做决策辅助:医疗、法律、金融、内容审核……

如果AI犯了错,但你没法从外部监控发现它——

你永远不知道自己什么时候该介入纠正。

这论文的一个重要结论是:

选择架构,就是在选择监控能力。

如果你选了一个”可观测性崩溃”的模型,那你部署再多的监控工具,都是白搭——模型内部根本不保存那些信号。

反过来,如果你选了一个保留可观测性的模型,作者证明了:

- 用一个通用数据集训练的监控器

- 可以迁移到问答任务上

- 不需要针对任务专门训练

就能捕获置信度漏掉的错误。

07 对我们有什么启发?

说几个实用的:

1. 选模型别只看参数量

2.9B的模型可能比8B的更好用,不是因为它更强,是因为它更”透明”。

2. 架构选择是监控决策

如果你需要在生产环境监控AI表现,那架构的可观测性应该成为选型的硬指标。

3. 未来的AI安全要从架构层考虑

现在很多AI安全研究关注的是”怎么给模型加护栏”。

这篇论文提醒我们:有些护栏能不能生效,取决于模型内部允不允许。

总结一下

AI会自信地犯错,这是事实。

更关键的是:某些模型的架构配置,会让它连”自我怀疑”的能力都没有。

这不是bug,是架构特性。

所以下次你选模型的时候,除了看参数量、benchmark分数,也许还应该问一句:

这个模型,我能从外面监控到它什么时候说错话吗?

如果不能,那它可能比你想象的更危险。

参考资料:

arXiv:2604.24801 | Architecture Determines Observability in Transformers

作者:Thomas Carmichael

如果你觉得这篇有用,欢迎转发给需要的人。

你觉得未来AI监控会往哪个方向发展?评论区聊聊~

夜雨聆风

夜雨聆风