高盛-深度解码AI发展趋势和投资机会

在科技巨头资本开支不断增加的情况下,市场不断质疑这些巨额开支能否获得回报。高盛这篇研报对此进行了深度分析。

本来这篇内容分享在社群,用沉浸式翻译的会员进行全中文翻译,并且有我的分析和解读,因为比较有价值,并且有助于我们理解AI发展趋势,投资方向,就公开在这里

更多有价值内容详见社群:社群到底提供什么?内容来自哪里?这篇说清楚

-

需求侧:代理式 AI 驱动的阶梯式爆发

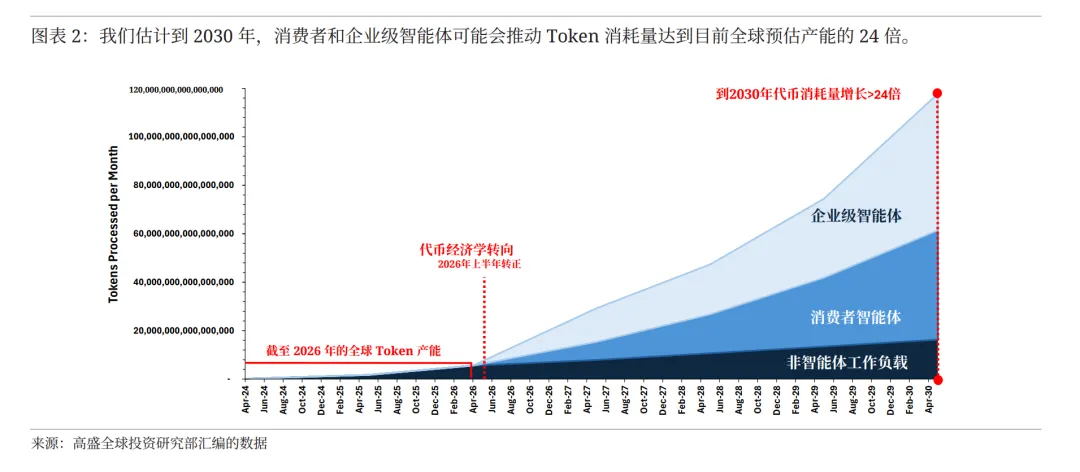

代理式 AI(Agentic AI)正推动 Token 消耗从线性增长转向阶梯式飞跃。这种增长并非简单的流量叠加,而是交互深度增加后的必然结果,为利润率的向上拐点提供了坚实的规模支撑。

-

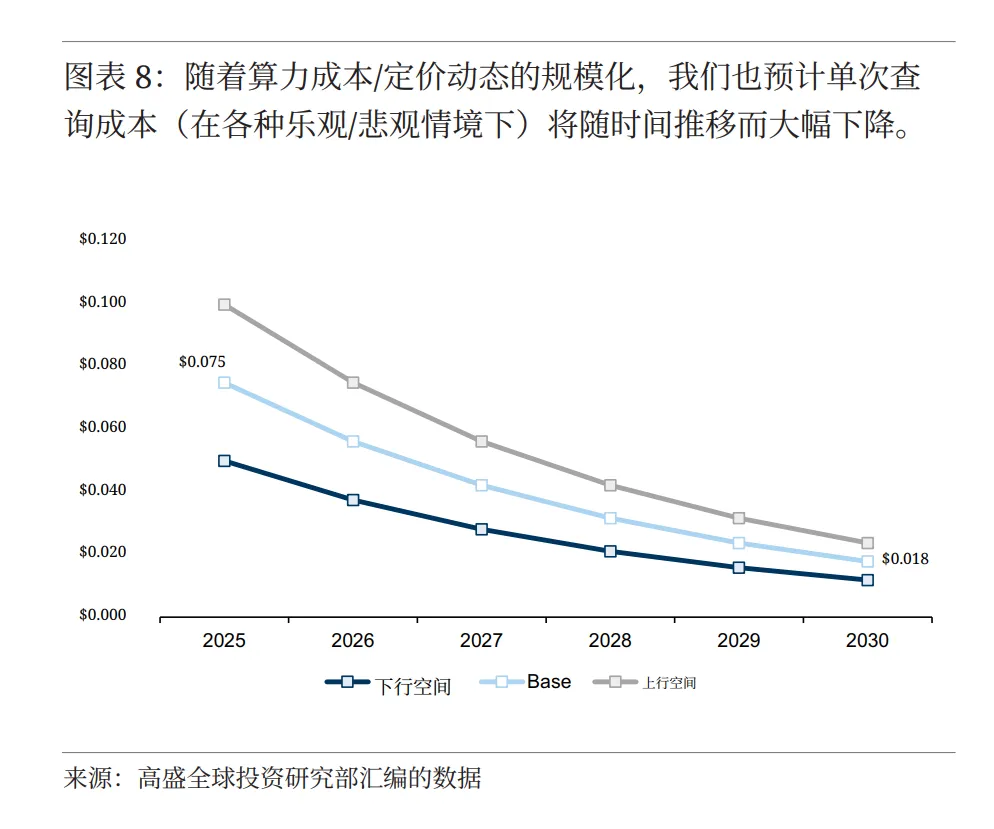

供给侧:计算成本跌幅超前于价格企稳

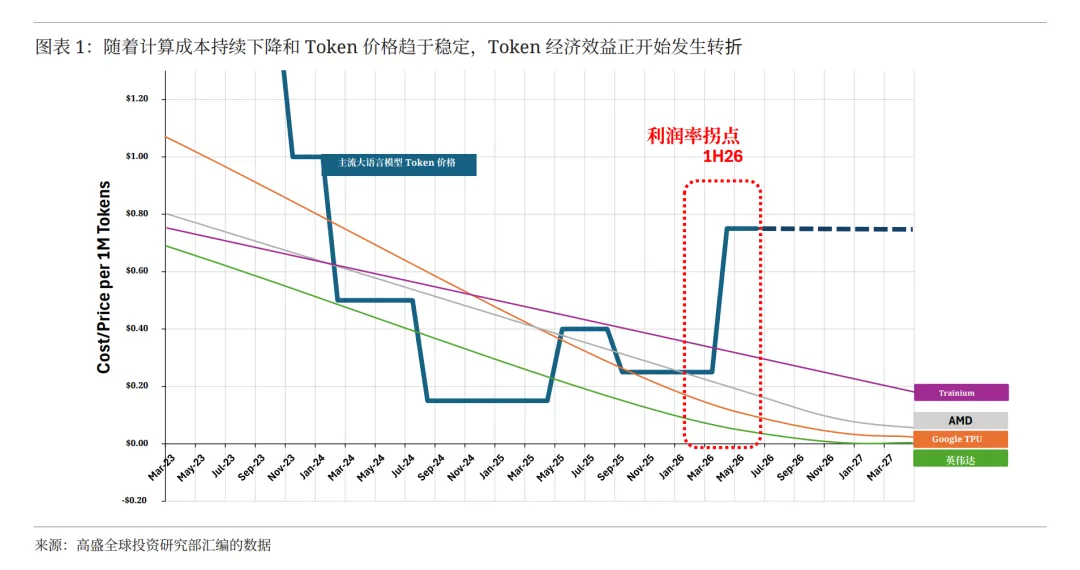

当前市场呈现出一个关键的财务特征:领先大模型的 Token 价格虽已进入稳定区间,但 Nvidia、AMD 以及 Google TPU、Trainium 等底层硬件的单位算力成本下降速度依然保持显著领先。这种成本降速与价格企稳之间的空间,直接转化为产业端的利润增长。

-

长期:从规模扩张转向盈利能力提升

预测到 2030 年,Token 的消耗爆发将伴随着整个 AI 价值链的利润率扩张。这表明 AI 行业正摆脱高投入、低回报的初期阶段,正式进入单位经济效益(Unit Economics)持续优化的红利期。

任何一次科技革命都有这样规律,都是巨额的投资带来使用成本的快速下降,进而带来指数级的扩散和渗透。

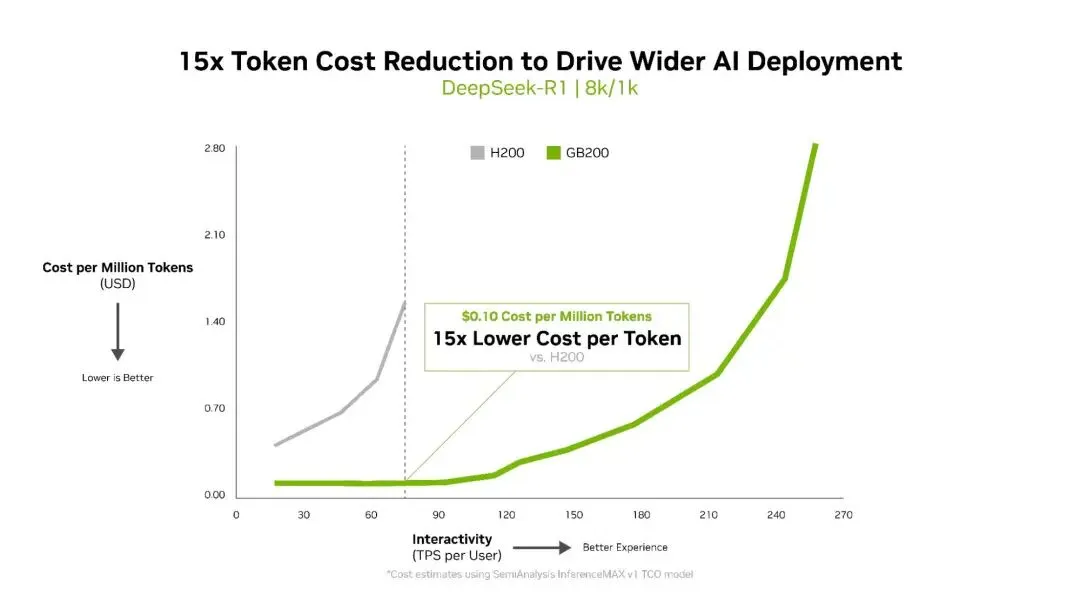

举个例子,在同样的交互速度下,英伟达GB200 将每百万 Token 的成本压缩到了 0.10,仅为 H200 的十五分之一

英伟达的芯片虽然比竞争对手贵了,但大家抢着买,重要原因之一是产生 Token 的单位成本来说英伟达是最低的

然后,营收和利润会经历一个先下降的过程,随后垄断者将迎来爆发性的增长。

下图可以看出,AMD、Google TPU 和英伟达芯片主流大语言模型的 Token 价格,正呈指数级下降。

在这种情况下,Token 的经济效应(利润)会迎来转折,下图红框:

微软、谷歌、亚马逊、Nubis 这些云服务商做的生意,简单理解就是卖 Token 做差价。那么在售价变化不大的情况下,单位成本不断降低,就会迎来利润的拐点。

增长趋势与渗透现状:

预计到 2030 年和 2040 年,企业级 AI 智能体将分别驱动全球 Token 消耗量激增 24 倍与 55 倍。尽管 70%–90% 的企业已开启实验,但受制于规模化门槛(目前仅不足 25% 实现扩张),整体增长将遵循典型的 S 型曲线。

核心逻辑与 ROI 差异:

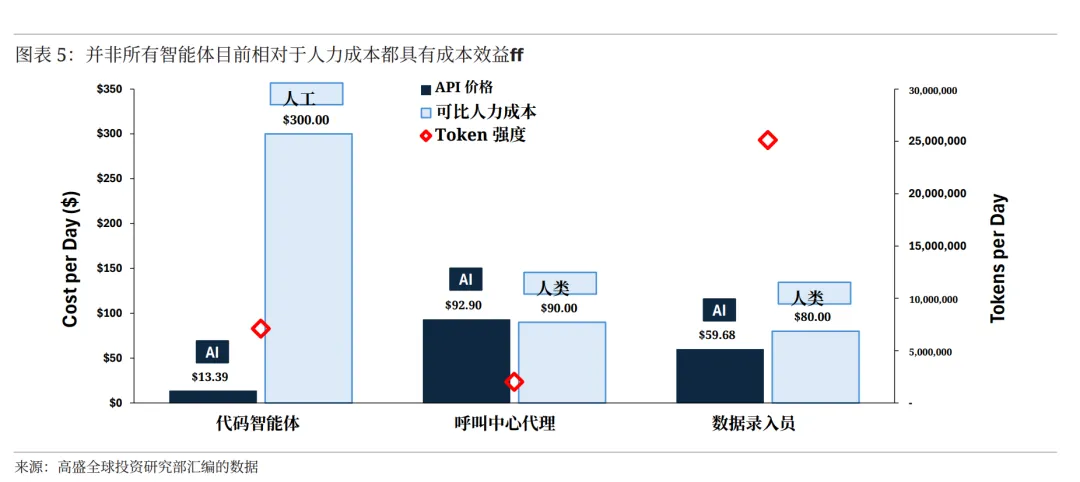

通过模拟 AI 对核心工作流的 Token 强度发现,成本博弈呈现两极分化:编程等纯文本智能体呈现“高消耗、低单价”特征;

而涉及实时音视频的多模态智能体虽消耗量较小,但其 API 成本极高。这种成本结构的显著差异,决定了智能体在不同业务场景下的 投资回报率(ROI)及采用速度将表现出明显的不均衡性。

寒叔简评:

投行研报的这种线性外推看看就行。我比较认可这种大趋势,但具体的倍数他们也是拍拍脑袋,不能完全信。

从历史上来看,这种对新技术扩散的预估和实际情况通常相差十万八千里:要么是低估,要么是严重低估,要么是严重高估。

摩根士丹利对超大型云服务商和模型提供商都进行了“买入”的评级,其中包括:亚马逊、谷歌、Meta

对于半导体公司,高通、英伟达和 AMD 都维持买入评级。

对于软件和 IT 服务,微软、NET 和 ASML 维持“买入”评级。

寒叔简评:

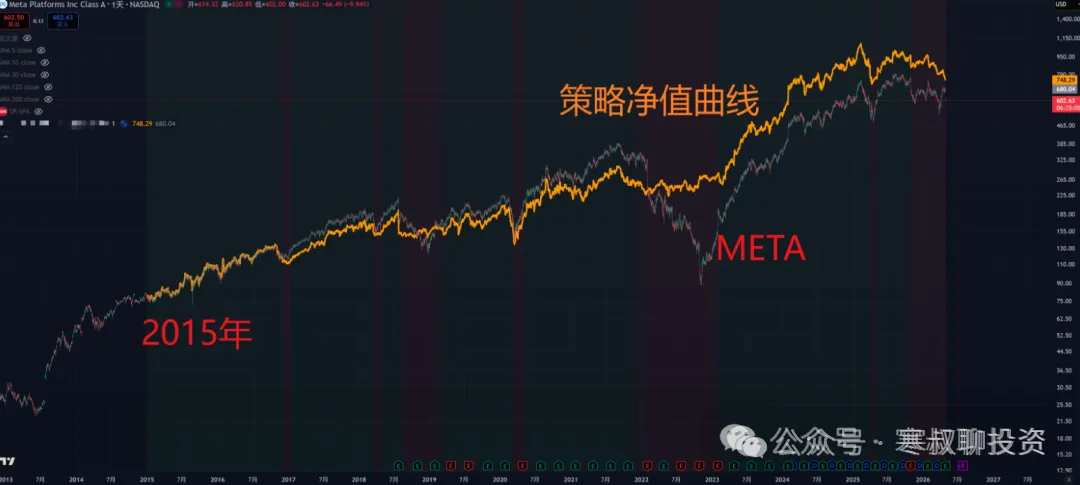

对于云服务商来说,我目前并不是特别看好 Meta(请注意这并不是预测META衰落或股价下跌)

因为它虽然有让 AI 提升自己的营收和利润,但都是间接的,主要是提升广告的效率;不像亚马逊和谷歌,是直接通过销售 AI 相关的云服务来赚钱。

对于芯片公司来说,我认为训练和推理是两个巨大的市场。

英伟达在训练方面的垄断地位暂时没有受到威胁。

价格与成本曲线的剪刀差:

推理 Token 的价格与成本曲线表明,超大规模云服务商与 LLM 提供商的底层单位经济效益正显著改善。

领先的 LLM Token 价格在前期骤降后已企稳甚至回升,而由英伟达、博通、AMD 和美满电子(Marvell)驱动的全额计算成本下降更快。这种“价格企稳、成本下行”的剪刀差预示着,2030 年 Token 消耗量的爆发不仅反映了营收增长,更是 AI 价值链利润率的整体扩张。

从成本驱动向利润扩张转轨:

AI 周期正从“算力即成本”的第一阶段,转向边际利润驱动的新阶段。随着英伟达、谷歌 TPU、AMD 及 Trainium 等计算成本持续下降,Token 价格与成本的脱钩已成定局。

这意味着代理式 AI(Agentic AI)的普及将不再稀释利润,而是能以极具吸引力的边际利润转化为收益,行业正从利润不确定性迈向高盈利能力的确定性转折点。

代理式 AI 的经济飞轮:

计算成本的下降正驱动代理式 AI 形成自我强化的经济飞轮:低成本催生更复杂的代理;

这些代理通过长上下文、多轮循环与持续监控消耗更多 Token;高利用率进而改善基础设施的经济效益,支持供应商持续投入模型质量与分发。

这一逻辑反驳了“AI 仅是不可持续成本负担”的流行叙事,揭示了规模效应下的正向循环。

寒叔简评:

Token 成本的降低,除了直接带来大模型公司利润的增长,同时还会因为价格的下降,推动更广泛的使用。

举个例子,智能手机的价格不断降低,或者是聊天软件的免费使用,让它普及到了全球的任何一个角落。

虽然免费了,但这些科技巨头还是能通过几十亿的日活用户把钱给赚回来。

边际经济效益与投资结论:

尽管同质化工具的竞争压力可能导致 Token 价格降幅超过成本降幅,但加速器效率、模型优化及缓存技术仍有巨大的降本增效空间。核心结论并非所有 Token 均能盈利,而是智能体 AI 的边际经济效益将随消耗量激增而改善。

这种结合预示着智能体经济将比单纯的聊天机器人更具规模、盈利能力及生命力。

大摩通过对比 AI 与人工在编程、呼叫中心及数据录入等岗位的成本发现,

AI 在类似编程这种智能密集型环节的降本效应表现尤为突出,在呼叫中心和数据录入方面,AI 的工作成本和人类差不多;而在编程方面的成本约为人类的 1/20

寒叔简评:

这个大方向是对的,就是之前说到的:技术成本的降低会带来更广泛的应用,整体上带来更多的收入和利润。

但是从历史规律来看,大部分相关企业都会消失,成为炮灰,留下的这些巨头将独享大部分收入和利润。

铁路、内燃机、汽车、互联网时代都是如此,这次 AI 革命也大概率不会例外。

所以对于投资来说,我们更应该关注的不仅是行业广阔的前景,而是更应该聚焦于:谁最终能获得垄断地位。

目前,主流 AI 平台的月活跃用户数(MAU)持续攀升,消费者对 AI 的接受度正快速跨越临界点。

这种增长不仅源于用户对增量价值的认可,更得益于产品形态对用户意图的精准捕捉。

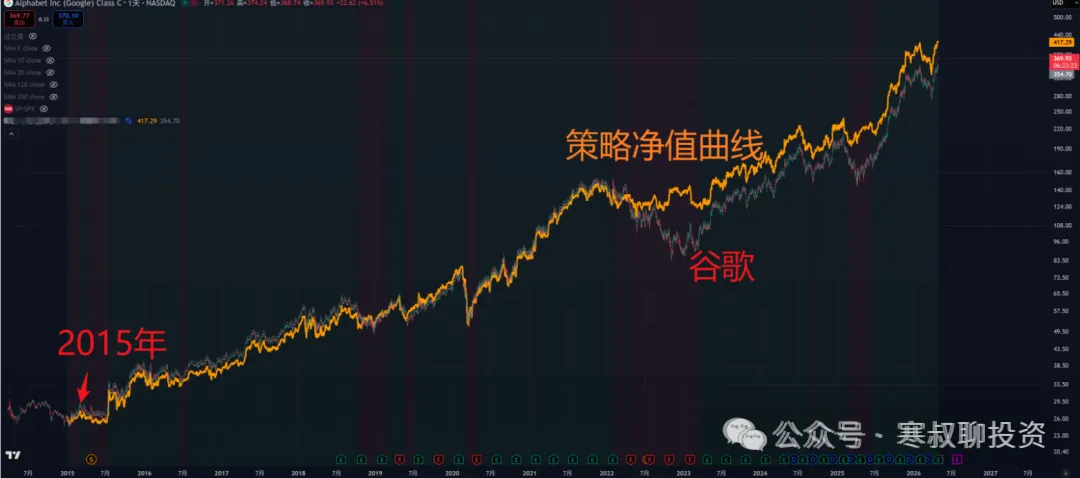

其中,Gemini 凭借 Google 强大的分发网络,在用户获取与参与度上表现尤为出色,已稳居全球第二大 AI 应用。

AI 进化的三个阶梯:从对话框到全自动助手

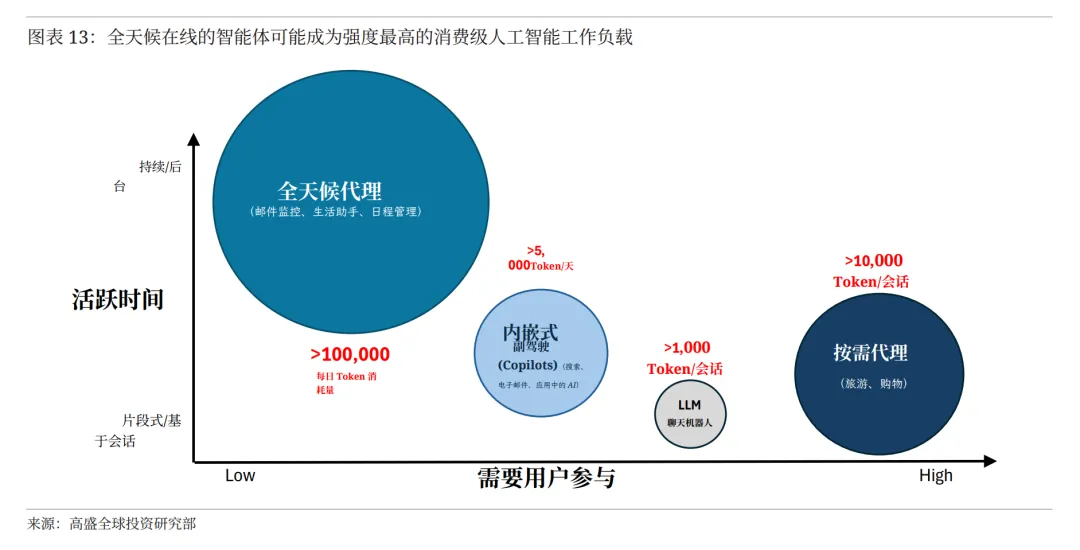

根据自主程度以及对用户指令依赖度的不同,我们将 AI 产品划分为三个演进阶段:

-

聊天机器人(Chatbots): 如 ChatGPT、Gemini 和 Claude。这是目前门槛最低的切入点,用户通过主动输入提示词(Prompt)获取信息,将其作为搜索和发现的媒介。

-

嵌入式工具(Embedded Tools): 位于技术栈更深层,能协调个人数据历史与集成应用。它们根据一系列指令自主运行,执行比通用聊天更复杂的特定任务,扮演更具互动性的角色

-

智能体(Agents): 代表了目前的最高阶段。其特征是极少需要用户干预,可在后台跨设备、跨应用持续运行,实现从“被动响应”向“主动执行”的跨越。

普及的关键:减少摩擦与突破算力限制

消费者智能体能否大规模普及,取决于两个核心变量:

一是用户摩擦的最小化,即技术能否在无感状态下创造价值;

二是供应端的突破,即运营商能否克服算力限制以满足海量需求。回顾 Web 1.0 和 Web 2.0 的历史周期可以发现,只有当技术从根本上降低了使用门槛,真正的持久性普及才会到来。

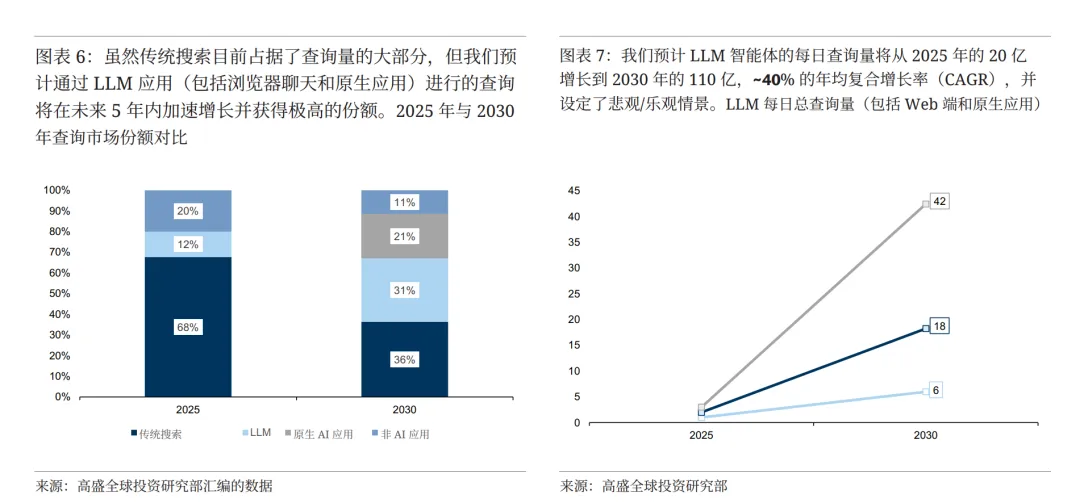

2030 流量变局:搜索习惯的结构性重塑

从每日查询量的构成来看,消费者计算习惯正在发生演变。

传统搜索引擎的查询增长趋于平缓,而由大语言模型(LLM)驱动的查询量正在加速。到 2030 年,尽管传统搜索仍占据一席之地,但市场重心将向 LLM 介导的需求倾斜。这种转变不仅是存量市场的替代,更是 AI 引入增量需求后,对整个信息获取场景的重构。

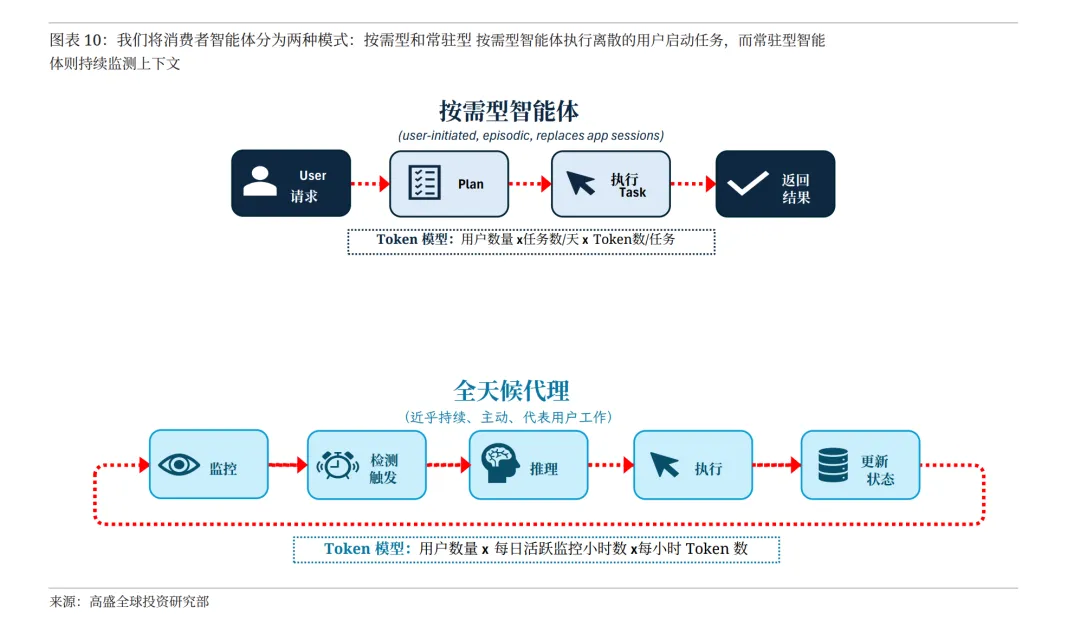

按需激活 vs. 后台常驻:智能体的两种进化路径

为了客观预测消费者 AI 的趋势,我们可以将智能体分为“按需型”与“常驻型”。目前的浏览器智能体(如 OpenAI Operator、Claude Code)多属于按需型:由用户发起任务,智能体进行规划、执行并循环,直至任务完成并获批后停止。

与之相对,下一波浪潮将转向常驻型智能体。这类产品更像持久的邮件监控器或数字生活助理,在后台永久运行,仅在触发特定条件时采取行动。

为什么“常驻型”模式决定了 Token 的消耗规模?

理解“常驻型”智能体的消耗模式至关重要。在设计逻辑上,这类智能体与企业级智能体高度一致——它们必须在业务流中持续运行,而非被动等待离散的用户指令。

这种“永久在线”的特质意味着,智能体不再是任务式的工具,而是环境驱动的系统。这种从“单次触发”到“持续运行”的转变,将从根本上推高 Token 的需求强度,并构成了未来智能体经济的核心基石。

根据高盛预测,全天候代理对 Token 的消耗量会指数级上涨:

现状与里程碑:从“对话框”迈向“工作流”

企业级智能体已迎来关键转折点。

以 Salesforce 的 Agentforce 和 Anthropic 的 Claude Cowork 为代表,AI 的应用上限已从简单的文本聊天(RAG)提升至复杂的业务流程。

尽管 70%-90% 的企业正在尝试 AI 智能体,但真正的规模化应用仍不足四分之一。

目前,多数应用仍局限于客户支持、IT 运营、销售赋能等边界清晰的场景,且多以“副驾驶”(Copilot)的形式存在,而非完全自主运行。

核心瓶颈:从技术挑战转向组织治理

当前智能体普及的制约因素已不再是技术底层,而是组织层面的制度与经济考量。企业关注的焦点从“模型性能”转向“编排逻辑”——即不再质疑智能体是否能行动,而是关注其应在何时、如何被允许行动。

大规模部署面临两大核心限制:一是信任与安全边界,尤其是在跨系统运行及责任归属模糊时;二是 ROI(投资回报率)的可见性,生产力的提升往往难以直接转化为硬性成本削减,且高昂的推理成本要求企业必须建立严格的费用护栏。

未来十年:S 型曲线下的 20-25 倍增长

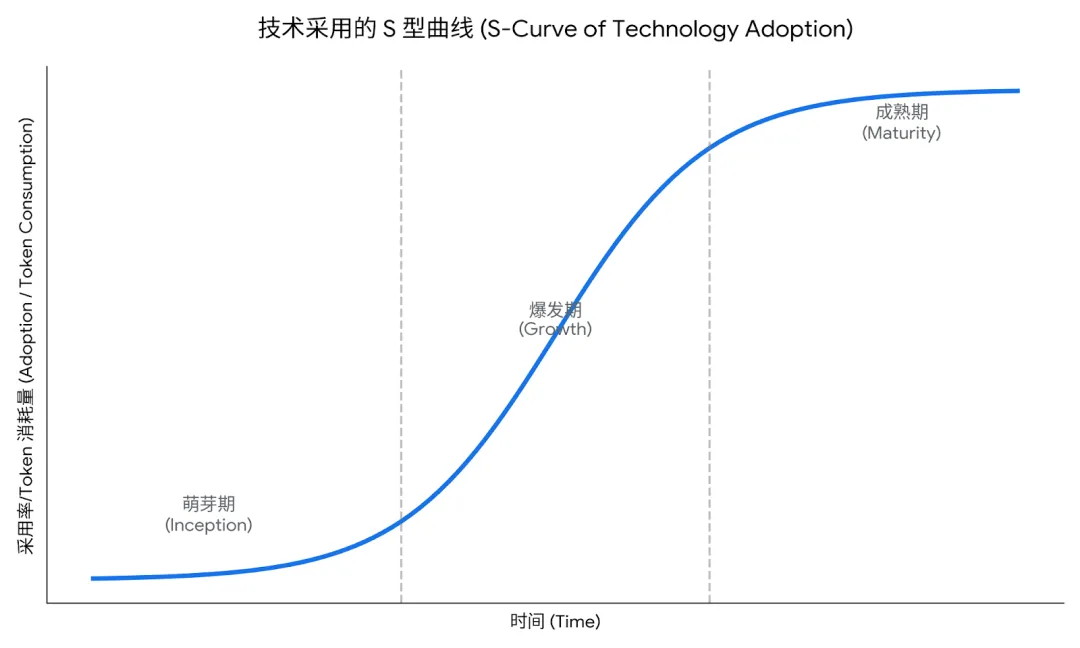

基于历史技术扩散数据(CHAT 数据集)的研究,企业级智能体的采用将遵循典型的 S 型曲线。虽然短期内(未来 12 个月)可能不会出现爆发式拐点,但随着风险管理框架的成熟,特定领域(如金融、客服等)的专业智能体将率先进入产线。

从长远来看,计算成本的下降与治理工具的完善,将驱动智能体需求在未来十年达到今天的 20 到 25 倍,成为企业 IT 预算与算力消耗的核心支柱。

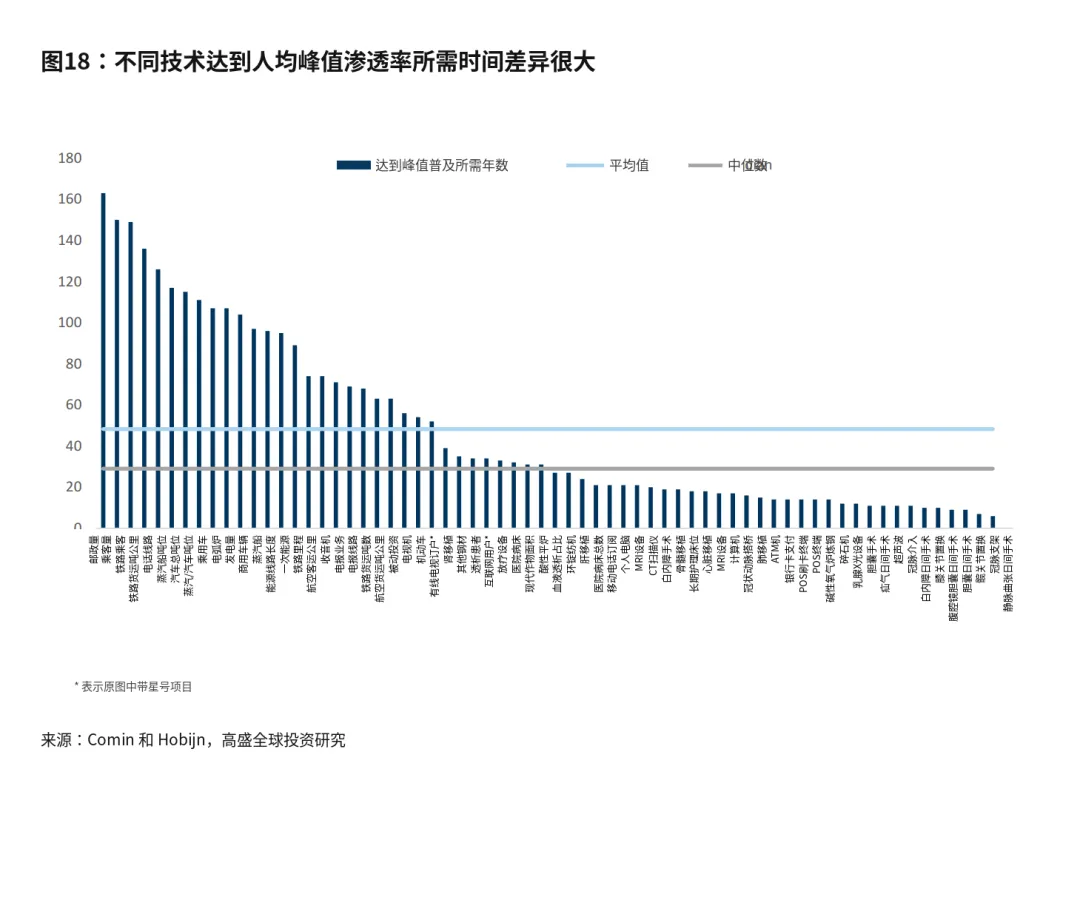

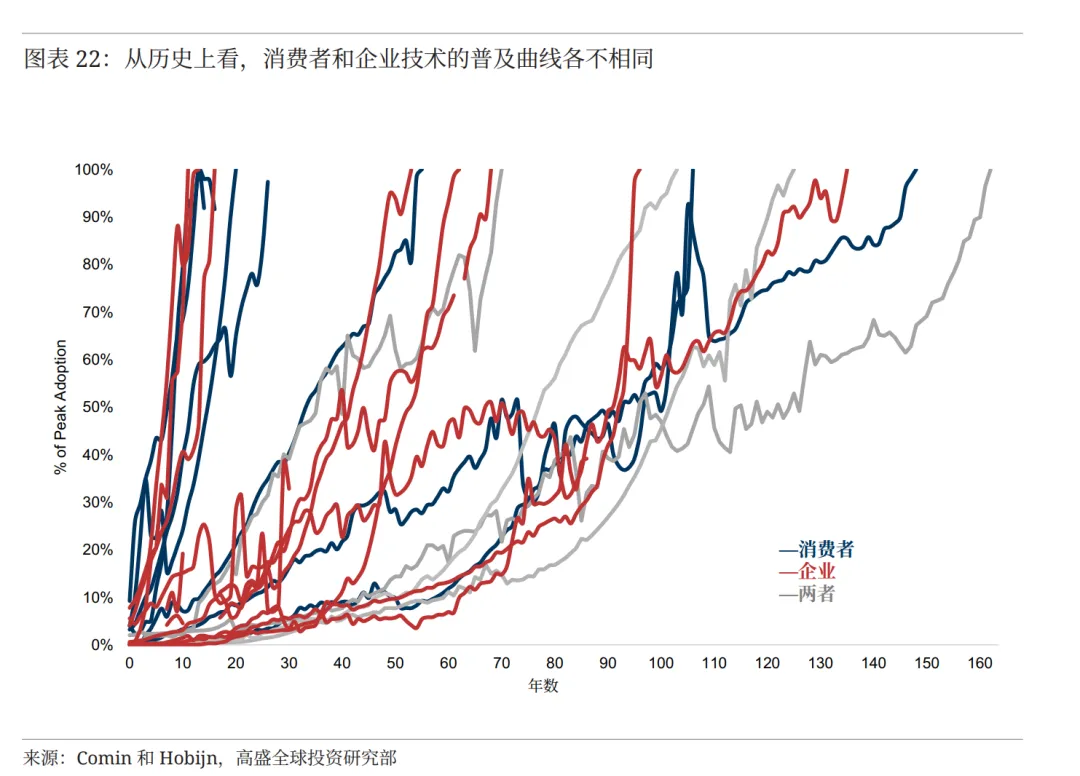

技术普及的“时间刻度”:从百年铁路到 20 年 ATM

历史数据显示,技术普及的速度差异巨大。铁路、轮船和固定电话经历了上百年才达到应用巅峰,而有线电视、ATM机等技术仅用不到 20 年便完成渗透。

在长达两百年的技术统计中,普及时间的中位数约为 29 年。不同技术呈现出不同的增长轨迹:互联网呈现爆发式的 J 型增长,而电报等则遵循起步缓慢、跨越临界点后迅速加速的 S 型曲线。

三力交织:勾勒 AI 智能体的增长曲线

AI 智能体正处于三种历史增长模式的交织点。首先,行业面临的资本约束意味着其早期将呈现稳健的线性增长;其次,Token 的规模经济与 ROI 驱动的网络效应,预示着它具备跨越临界点后 S 型加速的潜力;

寒叔简评:什么式S型曲线,见下图

最后,参考 ChatGPT 仅用 3 年便实现大规模尝试的现状,其具备极强的病毒式扩张特征。这种多重因素的结合,决定了 AI 智能体的普及将比传统工业技术更具爆发力且更具盈利厚度。

下图为不同技术达到人均渗透率所需的时间差距

基准预测:S 型曲线的演进逻辑

我们认为企业级智能体的普及将遵循典型的 S 型曲线,目前正处于初始试用的第一阶段。随着 2030 年临近,采用率将进入陡峭上升期,并在落后者跟进后趋于平缓。

尽管短期内存在数据清洗、制度障碍等一次性预付成本,且应用场景更偏向于特定领域的小语言模型(SLM),但长远来看,随着企业数据策略转向“智能体友好”框架,数据治理将不再是主要障碍,普及化将随员工习惯的养成而全面到来。

15 年达峰:加速普及的驱动力

不同于历史技术普及的平均速度(26 年),我们预计 AI 智能体将在 15 年内达到扩散峰值。支撑这一加速预期的核心因素包括:新技术规模化的节奏正在加快;

软件构建成本(代码成本)的下降允许更多实验与用例发现;以及企业为降低市场份额流失风险,迫切需要通过 AI 路线图展示其前瞻性竞争力。

寒叔简评:

这种预测听听就算了。投行连未来一两年的预测都很难有准确的,未来 15 年的根本是痴人说梦。

但不管怎么说,我们都可以看,我们要看的是它分析的逻辑,就是 AI 有很大的广阔前景。

普通人在科技浪潮下,跟上时代最好的方式不是学习科技(因为你学不懂),而是和科技巨头站到一起,成为他们的股东。

我们账号聚焦科技发展和科技资产

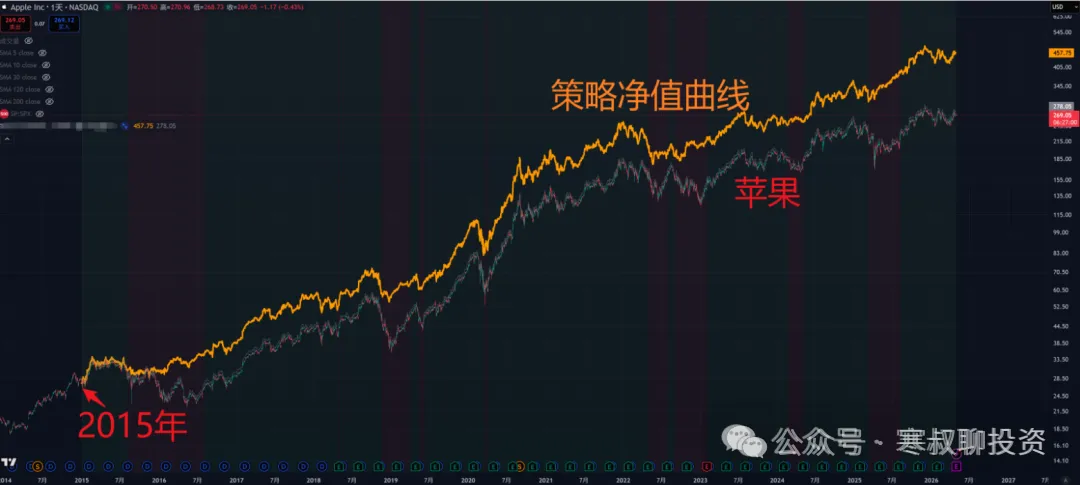

在社群中根据宏观分析把握大方向和趋势,根据策略来进行操作,在长期涨幅不输于持有的情况下,大幅减小回撤追随科技巨头,把握AI的时代浪潮

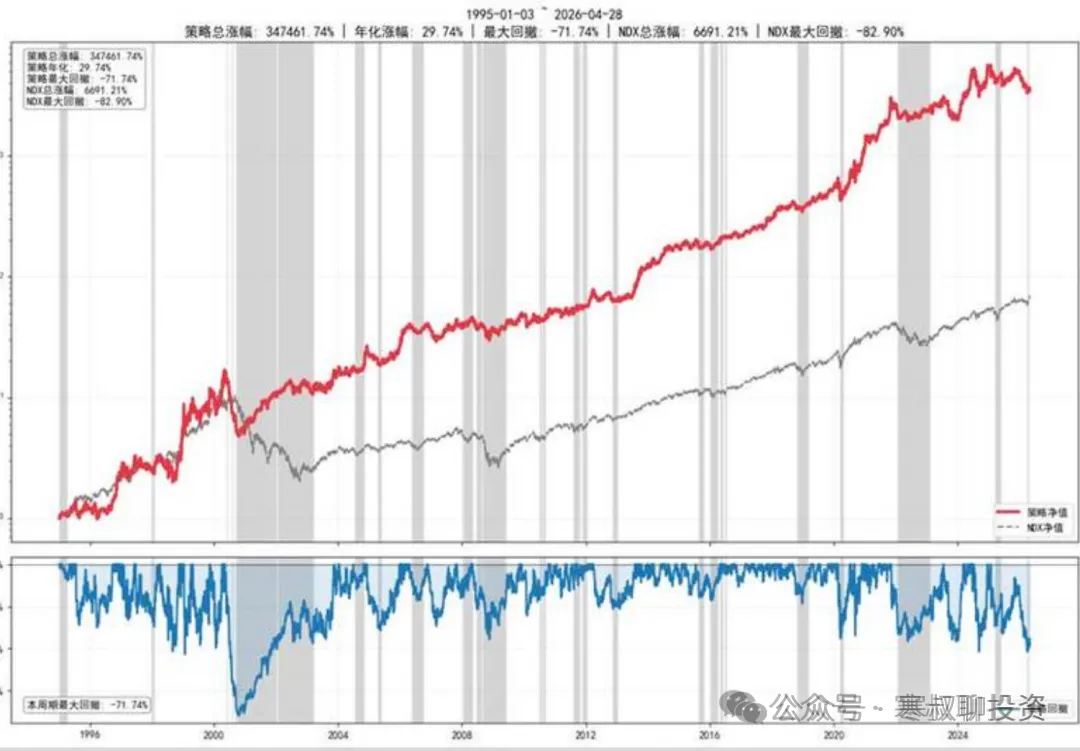

我们根据策略操作纳斯达克指数:

社群还有升级中的美股动量策略

下图红线是策略的净值曲线、 灰线是纳斯达克指数、 蓝线是策略的最大回撤

其他相关策略和具体操作,详见社群

社群内容还包含2500美元的付费资料包含:BRAVOS Research、Daily Chartbook、财经M平方、SemiAnalysis 等

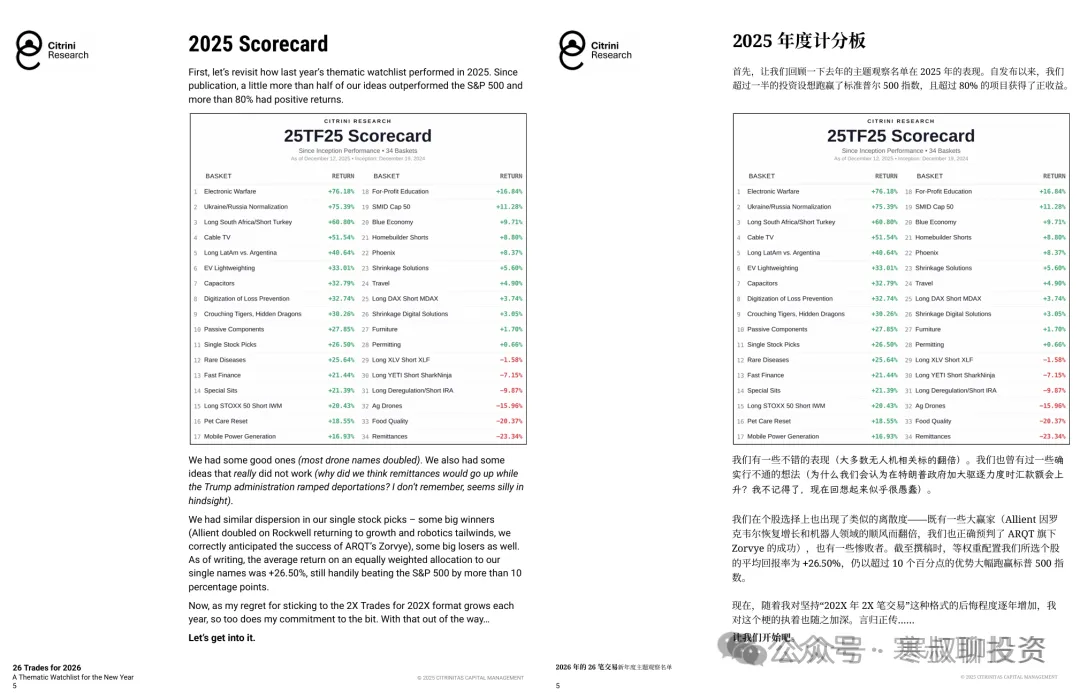

以及最新订阅的Citrini Research 相关介绍详见:全球最早布局英伟达、存储、光通信,预言软件股坍塌: Citrini Research 付费内容分享

刚更新了年费999美元的Citrini Research的26年展望,165页,全中文翻译;

夜雨聆风

夜雨聆风