2分钟看懂一款AI工具(open-webUI)

一个人也能搭的 AI 工作台

先说结论

如果你只是日常聊天、写文章、查资料,Open WebUI 不是刚需。直接用 ChatGPT、Claude、Gemini 更省事。

如果你已经开始同时用 ChatGPT、Claude、DeepSeek、Ollama、本地模型和各种 API,入口越来越乱,那 Open WebUI 就值得了解。

它可以理解成一个自己搭的 ChatGPT 界面。你把不同模型接进去,用一个统一入口聊天、传文件、做知识库。

哪些人会用到它

1. 本地模型用户

比如你用 Ollama 跑模型,但原生界面不够好用。Open WebUI 可以提供一个接近 ChatGPT 的网页界面。

2. 多模型用户

如果你同时用 OpenAI、Claude、DeepSeek、Gemini、OpenRouter、Ollama,本来需要来回切平台。Open WebUI 可以把它们放到一个入口里统一使用。

3. 小团队内部 AI 工作台

如果团队想做内部知识库问答、多人账号管理、不同人使用不同模型、文件上传问答,Open WebUI 会比较合适。

它真正解决的问题:

把分散的 AI 入口收回来,变成一个自己能控制的工作台。模型能力不会因此变强,但你的使用入口会更统一,数据和配置也更可控。

电脑上能不能直接用

Windows:能用

推荐方式是 Docker Desktop + Open WebUI。这里不展开安装教程,只讲使用门槛。大概流程是:安装 Docker Desktop,安装 Ollama,可选,用 Docker 启动 Open WebUI,然后在浏览器打开本地地址。

Windows 上主要容易卡在 Docker、端口、本地 Ollama 连接这些地方。

Mac:能用

推荐方式同样是 Docker Desktop + Open WebUI。Mac 一般会比 Windows 顺一点,尤其是 Docker 和本地服务连接这块。

桌面版可以试,但别当正式工具

Open WebUI 有 Desktop 版本,不需要 Docker,也不需要命令行。但目前还比较早期,稳定性不一定够。日常体验可以试,长期使用更建议 Docker 版。

用起来麻烦吗,要不要花钱

难度属于中等偏上。它不是那种双击安装就能舒服用的软件。

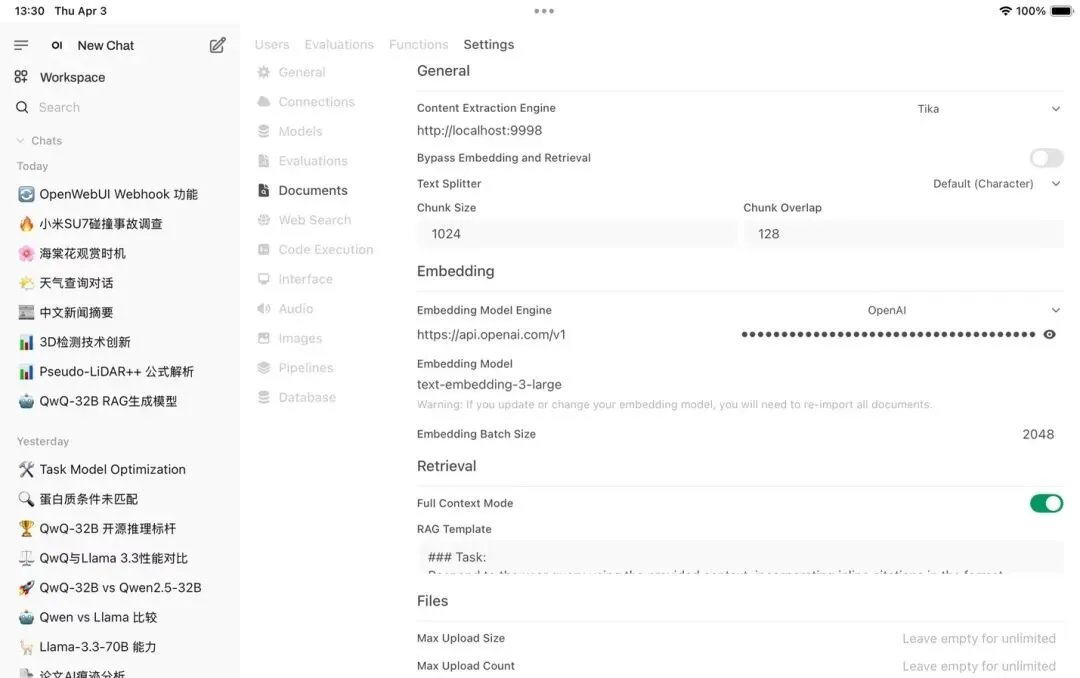

真正麻烦的地方在于 Docker、本地模型、API Key、本地 Ollama 连接、知识库向量化、服务器安全这些配置。

费用怎么理解?

个人使用一般不用付费。Open WebUI 本体可以免费自部署。但你接入的模型可能要钱,比如 OpenAI、Claude、DeepSeek API,这部分费用由模型厂商收。

自己用、小团队内部用,通常免费就够了。如果企业要去掉品牌、做白标、需要官方支持、SLA、长期维护版本,就可能涉及付费。

真正要注意的几个地方

坑 1:它只是一个界面

Open WebUI 本身不会让模型变强。接入的模型弱,回答质量还是弱。

坑 2:本地部署容易卡环境

常见问题包括 Docker 网络、Ollama 连接、端口占用、Windows 路径权限、本地模型跑得慢。Windows 用户第一次配置可能要折腾一阵。

坑 3:知识库效果不一定稳定

上传 PDF 问答看起来简单,但真实效果取决于文档切分、embedding 模型、向量库、文档格式、模型本身能力。不能期待传一堆资料进去就一定回答准。

可以一起对比的几个工具

1. LibreChat

最像 Open WebUI。也是自部署的多模型聊天平台,适合做开源版 ChatGPT 工作台。Open WebUI 对 Ollama、本地模型、本地部署玩家更友好;LibreChat 更偏多人聊天、Agent、多模型聊天体验。

2. AnythingLLM

也很接近,但它更偏知识库和文档问答。如果重点是上传资料,让 AI 基于资料回答,AnythingLLM 更直观。如果重点是多个模型统一管理,Open WebUI 更合适。

3. LobeChat

也是多模型 AI 聊天前端,可以接不同模型 API。它更偏漂亮、轻量、个人使用体验。Open WebUI 更偏自托管、本地模型、团队部署。

最后怎么选

Open WebUI 值得了解,但不要看到开源、自部署、本地模型,就觉得自己必须学。

工具再强,也要看你有没有这个使用场景。对大部分普通用户来说,它不是刚需。对正在折腾本地模型、多模型 API、私有知识库的人来说,它是一个很值得试的入口。

对内容创作者来说,它更像一个后续工具:可以用来搭 AI 信息处理后台、本地模型测试环境、私有知识库和多模型统一入口。

夜雨聆风

夜雨聆风