5分钟上手OpenClaw 开源云平台的入门指南

最近很多在做 AI 自研或者自学编程的小伙伴跟我抱怨: “云服务器太贵了,每个月续费心都在滴血。” “本地算力又不够,想跑个大模型或者部署个个人网站,环境配置能折腾掉半条命。”

如果你也正处于“算力焦虑”中,或者想拥有一套完全由自己掌控的云端实验室,那么今天安利的这个开源神器,你绝对不能错过。

它就是 OpenClaw。

很多人一听“云平台”就觉得那是架构师才玩的东西,但 OpenClaw 的核心理念其实非常适合我们这种“自学派”:轻量、开源、5 分钟快速部署。

今天我就带大家拆解一下,如何用一杯咖啡的时间,从零上手这个开源云平台。

什么是 OpenClaw?

(为什么它适合你?)

简单来说,OpenClaw 是一个轻量级的开源云资源调度与管理平台。如果把亚马逊 AWS 或者阿里云比作“精装修的大型商场”,那么 OpenClaw 更像是你自家的“多功能百宝箱”。

它的几个痛点抓得非常准:

私有化部署:你可以把它装在自己的旧电脑、NAS 或者树莓派上,把闲置硬件瞬间变成“私有云”。

多模态支持:不管是跑 Python 脚本、部署 Docker 容器,还是管理 AI 算力,它都有一套现成的模板。

低门槛:没有复杂的网络配置流程,对初学者极其友好。

第一步:准备工作

(别担心,真的很简单)

在正式开始之前,你只需要确保你的设备满足以下基础条件:

一台安装了 Linux(推荐 Ubuntu 20.04+)或者拥有 Docker 环境的设备。

Python 3.8 或以上版本(这是自学 AI 的标配了)。

一颗想要不断学习的心。

划重点: OpenClaw 最迷人的地方在于它不挑硬件。哪怕你只有一台 8G 内存的旧笔记本,也能跑得风生水起。

第二步:5 分钟极速安装流程

废话不多说,直接上干货。我们采用最推荐的 Docker 镜像安装法,这种方式最不容易出错,即使是小白也能一键搞定。

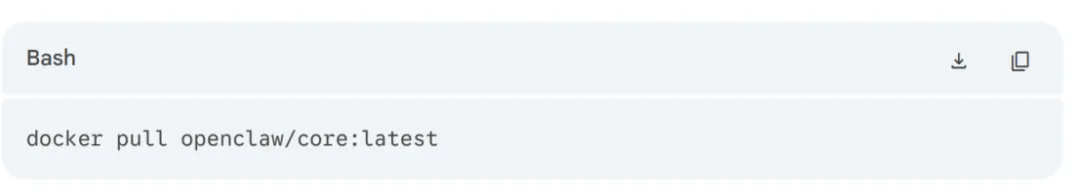

1. 拉取镜像

打开你的终端,输入这行命令:

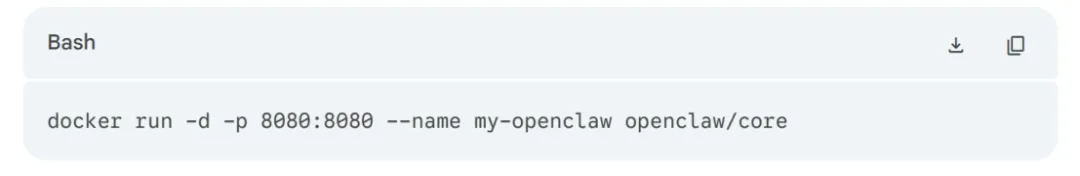

2. 启动核心服务

接下来,我们需要给你的云平台找个“家”:

这时候,OpenClaw 的管理后台就已经在你的本地 8080 端口跑起来了。

3. 初始化配置

打开浏览器,输入 localhost:8080。你会看到一个非常清爽的欢迎界面。按照提示设置管理员账号和密码。这里建议密码设复杂一点,虽然是内网,但养成良好的安全习惯是自学者的必修课。

第三步:实战演练——部署你的第一个 AI 实验环境

安装好平台只是第一步,真正爽的地方在于如何用它。

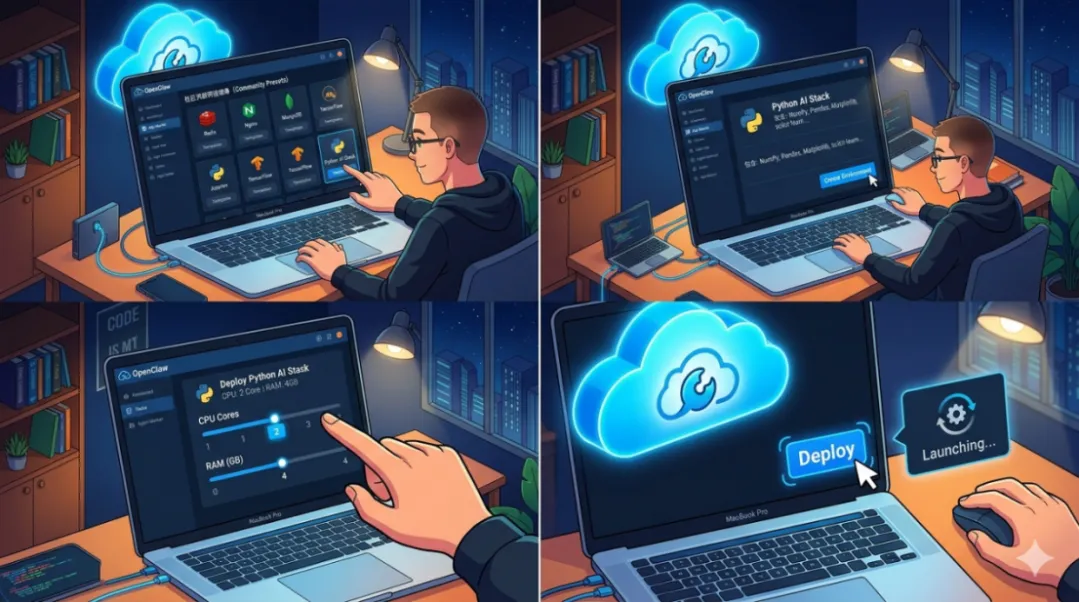

作为 AI 科普博主,我最常用的场景就是快速搭建一个 Python 自动化任务环境。在 OpenClaw 里,这只需要点点鼠标。

操作步骤:

进入“应用商城” (App Market):这里有很多社区贡献者预设好的镜像。

选择“Python AI Stack”:这个模板里已经帮你集成好了 NumPy、Pandas 甚至是 Matplotlib。

分配资源:你可以手动滑块调节,给这个环境分配 2 核 CPU 和 4G 内存。

一键启动:点击“Deploy”,系统会自动拉取镜像并配置网络。

不到 1 分钟,一个干净、独立、随时随地可以访问的云端实验室就建好了。你可以直接在网页端写代码,再也不用担心本地环境被搞乱。

为什么我推荐大家一定要试试 OpenClaw?

我发现很多人的热情其实不是灭在“算法太难”,而是困在了“环境搭建”上。

环境隔离:你在这个项目里装了 Python 3.7,那个项目要 3.10,最后系统路径冲突到让你崩溃。OpenClaw 这种基于容器的逻辑,让每个项目都是独立的“小房间”,互不干扰。

资源透明:它能直观地通过图表告诉你,你的 CPU 占用是多少,内存还剩多少。这种对硬件的掌控感,能帮你更好地理解计算机底层逻辑。

成本几乎为零:相比于昂贵的公有云,利用好手头的闲置资源,才是最高性价比的自学方式。

进阶玩法:配合 AI 工具起飞

如果你已经玩转了基础部署,可以尝试把 OpenClaw 作为一个 微服务后端。

比如,你可以利用它的 API 接口,配合 GPT 生成的代码,自动把你的数据处理任务推送到 OpenClaw 上跑。这种“AI 指令 + 云端执行”的模式,才是未来高效办公的雏形。

我也在尝试把之前分享过的几个金融预测模型和数据分析任务,全部迁移到 OpenClaw 上进行自动化调度。不得不说,这种“一劳永逸”的感觉真的很棒。

结语

自学的路往往很孤独,工具的选择决定了你能走多远。

OpenClaw 不是什么高不可攀的技术黑话,它更像是一个温柔的助手,帮你把复杂的底层运维屏蔽掉,让你把精力真正花在代码和创意上。

如果你觉得这篇指南对你有帮助,别忘了点赞、在看并转发给身边也在学习的小伙伴。

产品消息 | 交流 | 分享

夜雨聆风

夜雨聆风