Zed编辑器内置Zeta2.1模型发布,输出Token减少1/3

著名的 AI 编辑器 Zed 发布了 Zeta2.1 模型,性能得到了大大提升。

Zeta2.1 是一个 edit prediction model,它并不是一个一个输出 token 的自回归模型,而是一次预测一大段代码,在 IDE 中普遍用在代码自动补全场景,想当年我在 VS Code 特别喜欢 copilot 这个功能。

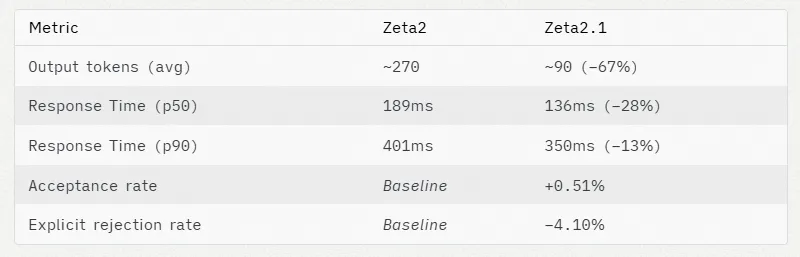

先看提升在哪儿了,如下图:

尤其 Zeta2.1 的输出token数量比 Zeta2 减少了 3倍,说明做了很深入的优化,官方使用了一种称为 Multi-Region 新提示词格式,Zeta2 会输出光标周围的一大片区域作为自动补全。而 Multi-Region 新格式仅仅输出光标周围哪些需要变更,这就是输出 token 数量大大减少的原因。

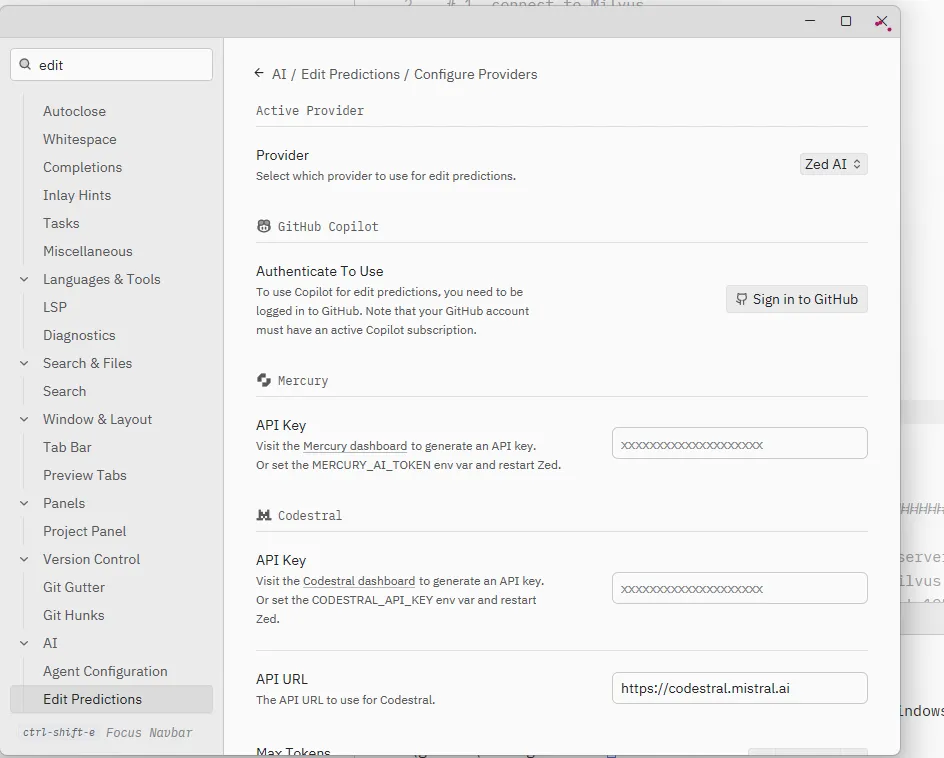

Zeta2.1 默认就在 Zed 启用,免费用户每个月也有 2000 次免费额度。

Zeta2 模型的训练也很特别,是 Zed 从 100,000 个真实样本进行训练的,也是开源的,可以自行部署,地址见 https://huggingface.co/zed-industries/zeta-2.1。

小伙伴们可以去 Zed 试下。

欢迎进微信群聊AI,目前已满200人,只能采取邀请方式,感兴趣的看看这篇文章。

相关文章:

夜雨聆风

夜雨聆风