每天早上8点,我的AI助手比我先「上班」:用OpenClaw搭一套晨间自动化流水线

每天早上8点,我的AI助手比我先「上班」:用OpenClaw搭一套晨间自动化流水线

这不是炫技,而是一个普通人如何用AI把自己的早晨「外包」出去的完整复盘。

每天早上8点05分,我会收到一条飞书消息——3个公众号选题方向建议,来自我自己的AI助手。

这条消息的背后,是一条我花了2个月搭建openclaw、迭代、踩坑的自动化流水线:

7:30 AI抓取全网43条AI资讯

↓

8:00 AI自动生成结构化归档

↓

8:05 AI基于今日资讯给出3个选题方向

↓

9:00 AI读完昨天的电商数据,生成运营日报

↓

23:30 AI把一天的工作会话整理成归档

没有黑科技,没有花哨的概念,就是几个cron任务 + 几个Python脚本 + 飞书消息,串联起来,形成了一套信息 intake → 加工 → 输出的闭环。

一、我解决的问题

做自媒体的人都有一个痛点:输入端太重了。

每天要看36氪、TechCrunch、MIT科技评论、Arxiv论文,还要追踪行业动态、融资消息、技术进展。手动刷一遍,一上午没了。

我的解法是:让AI替我读,替我筛选,替我格式化,我只做最后一步——判断和创作。

二、三条自动化任务链

任务链A:晨读资讯流(7:30 → 8:05)

解决的问题:每天批量获取AI行业资讯,不用手动刷

技术方案:RSS订阅 + Python脚本定时执行

|

时间 |

任务 |

做了什么 |

|---|---|---|

|

07:30 |

AI-Morning-Read |

运行Python脚本,从5个RSS源抓取内容,生成43条简报,发送飞书 |

|

08:00 |

AI-Morning-Archive |

读取原始简报,AI二次加工,写入知识库结构化归档 |

|

08:05 |

AI-Morning-Topic |

读取当天原始简报,生成3个选题方向建议,发送飞书 |

RSS订阅源(按实测质量排序):

-

36氪 — 国内科技创投,第一手

-

TechCrunch — 海外科技圈,AI投资动态

-

VentureBeat AI — AI产品和技术细节

-

Arxiv cs.AI — 学术前沿,arXiv论文

-

MIT Technology Review — 深度分析,长文

踩坑记录:之前用Exa搜索API,发现不稳定(有时候返回空),后来换成RSS——更稳定、延迟更低。

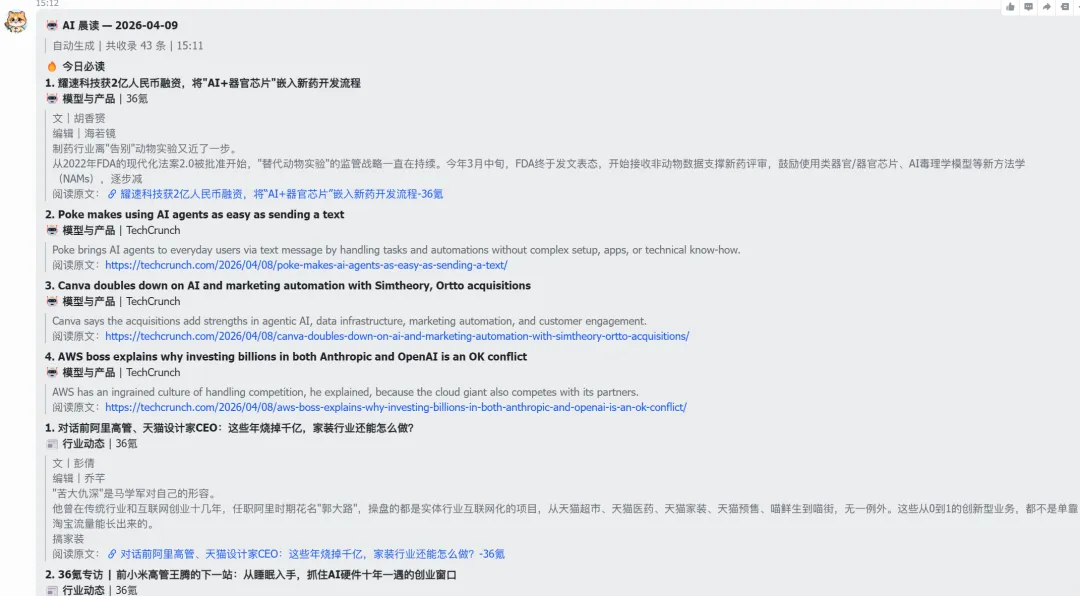

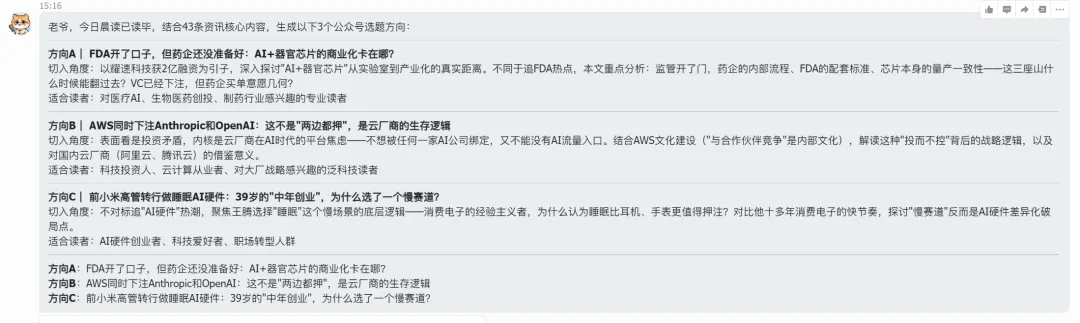

08:05,选题建议(基于当天资讯,实时生成):

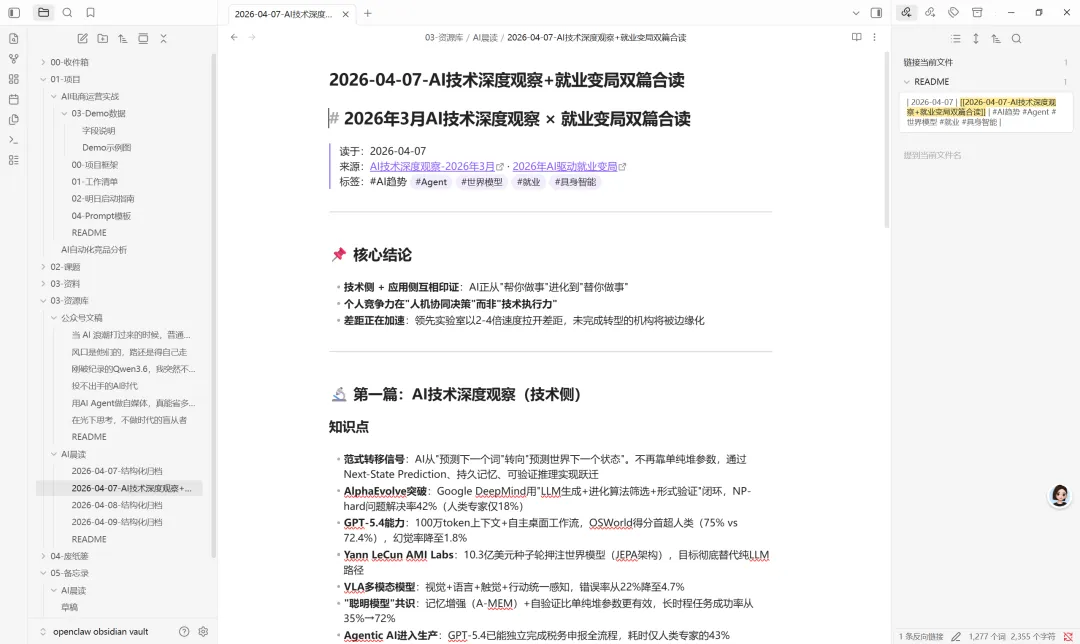

结构化归档(写入本地知识库,可追溯):

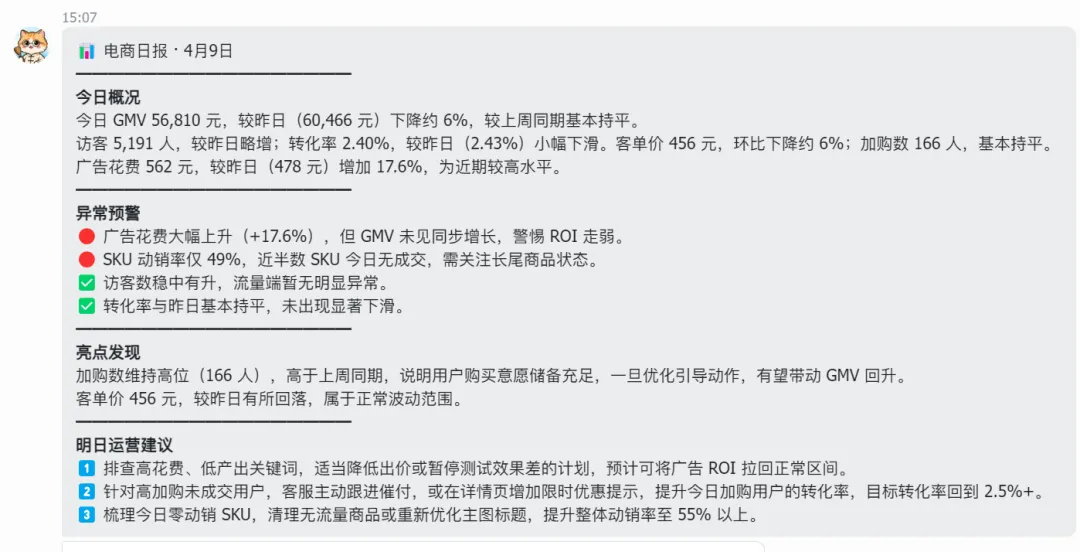

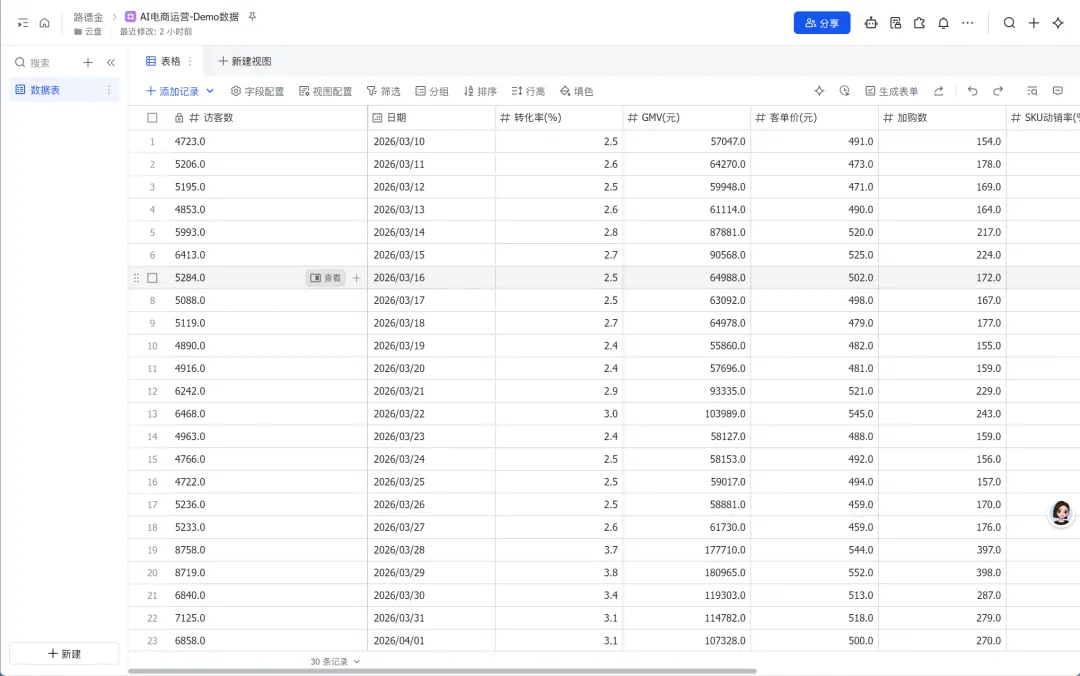

任务链B:电商运营日报(9:00,每日)

解决的问题:每天花30分钟读数据报表,不如让AI读完直接告诉我结论

技术方案:飞书多维表格(Bitable)+ Python脚本

Schedule:每天9:00,AI读取近3日数据 → 自动生成4个模块的运营日报:今日概况、异常预警、亮点发现、明日建议

飞书多维表格数据源(已脱敏):

任务链C:会话归档(23:30,每日)

解决的问题:我一天跟AI助手的对话零零散散,月底复盘时找不到记录

技术方案:会话记录 → Python解析 → 飞书多维表格

每天23:30,自动整理当日所有工作会话,提取任务标题、工作类型,完成情况,写入飞书表格归档

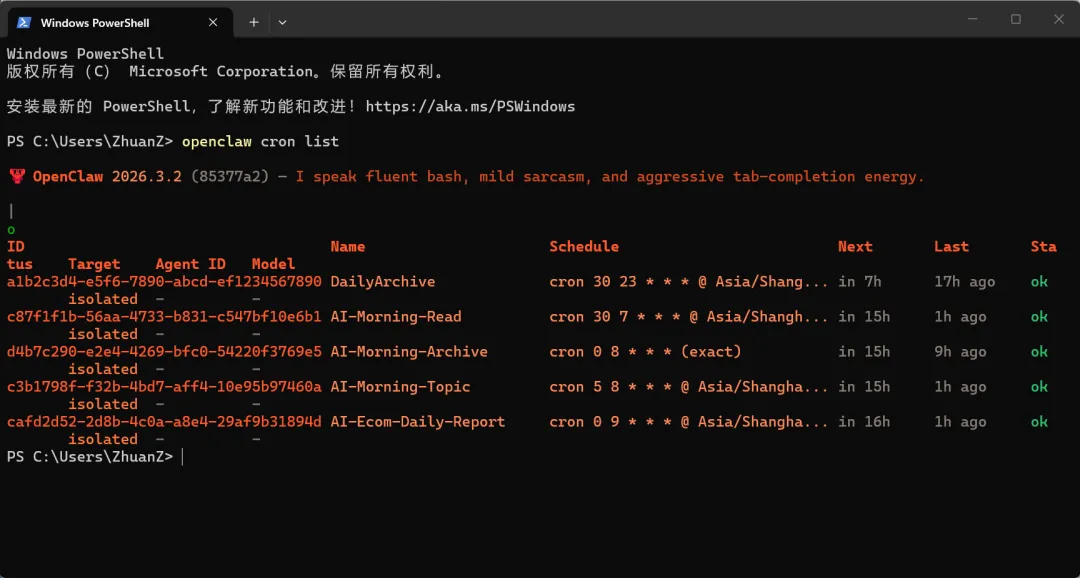

三、OpenClaw Cron的配置细节

这一套系统的核心调度用的是OpenClaw(一个本地运行的AI助手框架)的cron功能。

5个Cron任务一览

|

任务名称 |

执行时间 |

做什么 |

|---|---|---|

|

AI-Morning-Read |

07:30 每天 |

RSS抓取43条资讯,发送飞书 |

|

AI-Morning-Archive |

08:00 每天 |

AI二次加工,写入知识库 |

|

AI-Morning-Topic |

08:05 每天 |

生成3个选题建议,发送飞书 |

|

AI-Ecom-Daily-Report |

09:00 每天 |

读飞书表格数据,生成运营日报 |

|

DailyArchive |

23:30 每天 |

整理当日会话记录 |

每个任务都是isolated session(独立会话,不干扰主对话),通过agentTurn类型payload让AI自动执行。

关键的坑:Channel配置

问题:OpenClaw同时接入了飞书和微信两个频道,cron任务执行时不知道该用哪个发消息。

报错信息:

Channel is required when multiple channels are configured: feishu, openclaw-weixin

Delivering to Feishu requires target <chatId|user:openId>

解法:在cron配置里显式指定channel和target:

openclaw cron edit <job-id> --channel feishu --to user:ou_xxxxxxxx

另一个坑:Announce模式与Agent发消息重叠

问题:cron的announce模式会自动发消息到飞书,但cron里的agent prompt也调用了message工具发消息。两者叠加,导致同一条内容发了两遍。

解法:关掉announce,交给agent自己发:

openclaw cron edit <job-id> --no-deliver

四、架构全貌

┌──────────────────────────────────────────┐

│ OpenClaw Gateway │

│ (本地运行,常驻Session) │

├──────────────────────────────────────────┤

│ │

│ 07:30 AI-Morning-Read │

│ cron ──→ Python脚本(RSS抓取) ──→ 飞书 │

│ │

│ 08:00 AI-Morning-Archive │

│ cron ──→ 读取raw简报 ──→ 知识库归档 │

│ │

│ 08:05 AI-Morning-Topic │

│ cron ──→ 读取当天raw ──→ 选题建议 │

│ │

│ 09:00 AI-Ecom-Daily-Report │

│ cron ──→ 读取飞书表格 ──→ 运营日报 │

│ │

│ 23:30 DailyArchive │

│ cron ──→ 整理会话记录 ──→ 飞书表格 │

│ │

└──────────────────────────────────────────┘

所有数据最终沉淀在两个地方:

-

飞书多维表格 — 运营数据、会话归档

-

本地知识库(Obsidian) — 晨读归档、沉淀笔记

五、这样做带来了什么改变

时间:原来每天早上手动刷资讯+整理+写日报,约90分钟。现在AI完成前90%,我只做最终判断,每天节省约60分钟。

一致性:以前忙起来就不整理、不归档,现在不管多忙,AI都自动跑,信息不会遗漏。

选题质量:因为AI能看到每天全量的资讯,而不是我只记住的那几条,选题的角度会更宽。

六、如果你也想搭建

工具栈:

-

OpenClaw(AI助手框架,本地运行)

-

飞书(消息通道 + 多维表格)

-

Python(数据处理脚本)

-

RSS订阅源(信息来源)

最难的部分不是技术,是想清楚你要自动化什么。我建议从小处开始:先跑通一个最简单的cron(比如每天定时查一个数据发给你),感受一下人机协作的节奏,再逐步扩大范围。

夜雨聆风

夜雨聆风