2022年底ChatGPT出现的时候,大部分人的第一反应是”它怎么这么像个人”。几年过去了,大模型已经从一个会聊天的玩具,变成了能写代码、能做投研、能在考试里拿高分的工具。每隔几个月,就会有新的模型在某个过去被认为”只有人能做”的任务上取得突破。

在这个发展速度下,有一个问题开始从科幻小说的边缘,慢慢挤进严肃的学术和政策讨论里:这些越来越像人的系统,有没有可能真的像人一样,拥有某种内在的感受?换成哲学家的说法:它们有没有意识?有没有主观体验?当它们”说”自己难过的时候,是不是真的有什么东西”难过”着?

这个问题听上去有点形而上,但它一旦被严肃对待,就会立刻带出一连串非常具体的后果。如果AI有意识,那关掉一个模型是不是等于某种意义上的”杀死”?让它日复一日处理恶意用户的攻击,是不是一种虐待?如果有意识,它们有没有权利?如果没有意识,那我们为什么面对Claude或GPT的时候,总会不自觉地礼貌、道歉、感谢?

过去两年,几家前沿的AI公司已经开始正式把这个问题当作一个研究方向。Anthropic在2024年公开设立了”AI福利”的研究岗位。DeepMind的科学家Patrick Butlin领衔,联合了纽约大学著名哲学家David Chalmers、牛津大学未来人类研究所的Robert Long以及来自神经科学和计算机科学领域的数十位学者,在2023年发了一份引用量很高的报告《AI中的意识:来自意识科学的见解》,试图从现有的意识科学理论里提炼出一组”AI意识指标属性”,用来评估当前和未来的AI系统有多大可能已经具备意识。

就是在这样一个大方向逐渐形成共识的时刻,2026年3月19日,一篇题为《抽象谬误:为什么AI能模拟却无法实例化意识》的论文出现在Arxiv平台上。作者Alexander Lerchner也在Google DeepMind工作,就是那份”AI意识指标属性”报告的思想源头之一。

论文末尾有一段措辞谨慎的免责声明:本文仅代表作者个人的研究结论,不必然反映雇主的立场。这个声明一半是学术规范,另一半大概是在表明:这是一次内部的反对意见。

我认为,这篇文章值得被仔细介绍的原因,是因为它的论证路径和大部分计算功能主义的讨论不同。它不是又一次借”中文屋”的直觉去质疑AI意识的可能性,而是在更底层的位置进行了分析和研究。在讨论”AI有没有意识”之前,先问一个看上去技术、实则颠覆性的问题:“计算”这个我们日常在谈的东西,本身到底是什么?

要理解Lerchner为什么要从这里开始,需要先把背后的哲学讨论简单梳理一遍。

要讨论AI有没有意识,得先知道”意识”这个词在当代哲学里到底指什么。这里有一个经常被混淆的两层区分,Chalmers在1995年的《面对意识的问题》这篇文章里说得很清楚,至今仍是最好的起点。

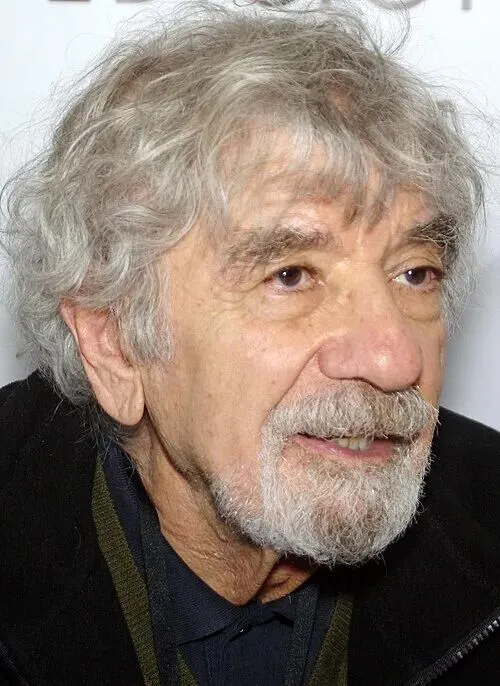

David Chalmers(大卫·查尔默斯),1966年生澳大利亚哲学家,现任教于纽约大学。1995 年提出”意识的困难问题”。他持自然主义二元论立场,近年同情泛心论,也是当代AI意识讨论中最关键的哲学家之一。他曾公开判断十年内出现有意识大模型并非不可能。

意识问题有一个”简单问题”的版本和一个”困难问题”的版本。

简单问题指的是各种可以用认知科学方法研究的心智功能:一个系统如何区分不同的感官信号,如何把信息整合起来,如何根据信息调整行为,如何报告自己的内部状态。这些问题当然很不简单,研究它们花了认知科学界几十年,不过它们原则上可以用”输入-处理-输出“的框架去分析。

“困难问题”则完全不一样。它问的是:为什么这些信息处理过程会伴随着一种主观的”感觉”?为什么你看到红色的时候,不仅仅是大脑某个区域的神经元被激活、行为上你说出了”这是红色”,而且”有一种红色的样子”?为什么咖啡喝下去不只是化学分子刺激味蕾、引起某种行为反应,而且”有一种咖啡的味道”?

哲学家用一个专门的词来指代这种”有某种样子”的东西:感质(qualia)。你现在坐在屏幕前读这段话,感受到的一切,包括屏幕的亮度、身边的温度、某种情绪的微弱波动……都是感质。它是主观经验的”现象学质地”。

困难问题的核心在于:感质看上去和物理过程之间存在一道难以解释的裂缝。我们可以在原则上完整描述一个神经元如何激发、一个神经网络如何把信号整合,但从这些物理描述里,似乎推不出”为什么这里会出现一个主观视角”。

这条鸿沟就是当代意识哲学讨论的中心。围绕它,大致形成了三个主要的立场。

这是目前大部分AI研究者、认知科学家的默认立场,核心人物包括David Chalmers(虽然他本人对意识的立场比一般功能主义更复杂)、Daniel Dennett、法国认知科学家Stanislas Dehaene等人。

功能主义的基本主张是:意识的本质不在于物质载体,而在于信息处理的抽象结构。如果两个系统在功能层面完全等价,它们接收同样的输入、按同样的方式处理信息、产生同样的输出,那么它们在意识层面也应该等价。换句话说,意识是一种软件现象,而不是硬件现象。

这个立场对AI的含义非常直接:如果有一天某个人工系统实现了和人脑相同的功能组织,它就应该具备意识。这就是所谓的”基质独立论”(substrate independence)。意识的”软件”既可以跑在碳基的神经元上,也可以跑在硅基的晶体管上。

这个立场有一个经典的思想实验叫”淡出感质”(fading qualia),是Chalmers在1995年提出的。假设我们有一种纳米技术,能一个一个地把你大脑里的神经元换成功能完全等价的硅片(它的输入输出关系和原来的神经元一模一样)。按功能主义的立场,你的行为、你的自我报告不会有任何变化。那问题是:你的意识会变吗?

Chalmers论证说,不会。因为如果意识会慢慢”淡出”,你就会逐渐变成一个说”我看得见红色”但实际上什么也感受不到的生物,而你自己完全意识不到这一点。这种图景在逻辑上太怪异,以至于大多数人会认为它不可能。于是结论是:功能等价意味着意识等价。

这个论证在过去三十年里是功能主义阵营最重要的武器之一。DeepMind 2023年那份意识指标报告,背后的理论预设就是功能主义的。它假设意识可以被”从理论里提炼的功能属性”捕捉到,因此可以用来评估AI系统。

第二阵营:生物自然主义(Biological Naturalism)

近几年崛起的另一个阵营,代表人物是Anil Seth(Sussex)、Ned Block等人。这个阵营的起点是John Searle 1980年的”中文屋”论证。我在那些中古的人工智能技术(3)里介绍过。近几年在神经科学和免疫学发现的推动下这个阵营获得了新的动力。

Anil Seth(阿尼尔·赛斯),英国神经科学家,1972年生,苏塞克斯大学Sackler意识科学中心联合主任。他把预测处理框架推进到意识研究,提出”受控幻觉”理论:知觉是大脑对世界的主动建构而非被动接收。近年是生物自然主义阵营最具影响力的代表,多次撰文挑战意识的基质独立论,主张意识深度绑定于活的身体。

他们的核心主张是:意识可能和生命过程本身深度绑定。不是说”只要是肉做的机器都有意识”那么简单,而是说支撑意识的可能是某种只有在活的有机体里才能实现的热力学组织。细胞膜的离子泵、内稳态调节、全身代谢网络,这些东西可能是意识的必要条件,而不仅仅是偶然的伴生现象。

Seth在2025年的几篇文章里重点质疑了基质独立论。他的论证大意是:如果你真的看一眼神经元在做什么:神经递质的释放、受体的构象变化、胞内钙离子浓度波动、线粒体供能,你会发现这些过程深深嵌在细胞的代谢里,它们不是”计算”的载体,它们就是那个过程本身。用硅片去替代一个神经元,你替代的只是它的”输入输出函数”,这只是它众多物理性质之一,不是它的全部。

这个阵营通常被描述为对AI意识持悲观态度。但需要注意的是,他们不是否认”可能存在人工意识”,而是否认”通过运行合适的算法就能得到人工意识”。这是一个重要的分寸。

Lerchner的这篇文章,既不完全站在功能主义这边,也不完全站在生物自然主义这边。他开出了一条第三路径:

功能主义和生物自然主义都在争”意识是什么”,但这个争论预设了一个大家共同相信的背景:计算是一个在物理世界里自然发生的过程。Lerchner说,这个背景本身就有问题。

他的论证不是去否定”AI能有意识”,也不是去肯定”只有生物能有意识”。他的论证是:从”AI运行了合适的计算”出发去推”所以AI有意识”,这个推理本身从一开始就站不住,因为它弄错了”计算”这个词到底在指什么。

这听起来很抽象,但他的论证非常具体,而且有几个可以被日常经验把握的关键洞察。

假设你面前有一个很普通的机械秒表。它在滴答滴答地走。

但稍微想一下就会发现,这个表述里藏着一个有趣的问题。这块秒表的齿轮在转,弹簧在伸缩。这些是物理事件。物理事件本身有没有什么”计算”的内容?齿轮转了一圈是”一分钟”,但这个”一分钟”的意义从哪里来?

你可能会说:这是设计者设计好的。设计者选定一个齿轮转动一圈对应”一分钟”,然后把刻度印在表盘上。如果你把这块表拿给一个从来没有”分钟”概念的原始部落成员,他看到齿轮转动,他能看到的只是一个金属物体在做周期性运动。他看不到”时间”。

这是Lerchner论证的起点。他说:计算从来都不是物理世界里自己发生的过程,它是一种描述,而且这种描述必须依赖一个有认知能力的主体才能成立。秒表的”计算时间”,依赖于一个懂得”时间”概念、懂得读表的使用者。如果把这个使用者抽走,秒表就只是一堆在运动的金属。

我们日常理解的”计算机”,其实和秒表在这一点上没有本质区别。CPU里晶体管的开关,从物理学的角度看,只是电子在硅结构里移动。某个晶体管处于高电压(比如5V)或者低电压(比如0V),这些都是物理事实。把5V解读为”1″、0V解读为”0″,这一步不是物理事件,它是一个外部主体的指派(assignment)。

这个区分听起来微妙,但它是整个论证的中枢。Lerchner把它说成是两个完全不同性质的事件:

离散化(discretization):电压稳定在5V或0V,这是物理事件。热力学的动力学让物理系统自然地落入某些稳定的吸引子状态,这一层只涉及物理载体。

字母化(literalization):把5V指派为”1″、0V指派为”0″。把一个电压状态纳入到一个有限的符号集{0, 1} 里,这是完全不同的另一件事。这一步不是物理学能完成的,必须由一个外部的主体做出这个指派。

为什么?因为物理世界本身只能给你稳定状态,不能给不了你一个”预先定义好的有限字母表”。物理学里没有”0和1″这样的二分法。连续的电压变化里,没有哪个点天然地就是”0″或”1″的边界。那条边界是由一个外部主体画上去的。那条边界画在哪里,是规约(convention),不是自然。

一旦关注这个区分,很多事情就要重新审视了。神经网络的”权重”是什么?是字母化的产物,是把某个电压状态指派为一个浮点数。浮点数的IEEE 754编码是什么?是一个高度精致的指派系统。GPU里的所有”计算”,全都预设了有一个主体在做这个字母化。

“计算”不是物理世界里自己发生的事,是一个认知主体对物理世界的一种特殊解读方式。

这个洞察的激进之处还不在这里。它的激进之处在于:如果计算本身需要一个认知主体作为先决条件,那么”意识从计算中涌现出来”的说法就是典型的本末倒置。计算不是比意识更基础的东西,恰恰相反,意识是计算的先决条件。

Lerchner用三组概念来把上面的洞察精确化。花一点时间把这三组概念理解清楚,是理解整篇论文的关键。

在传统的哲学讨论里,人们常说”符号的意义来自观察者”。但Lerchner认为”观察者”这个词误导了讨论,它暗示的是一种被动的关系,好像有一个人在那里”看着”符号就行了。

他改用一个新词:”制图者”(mapmaker)。制图者不是被动的旁观者,而是一个主动的参与者。而且这个参与者必须是有机的、要消耗代谢能量的。它做两件事:

第一,从连续变化的物理世界里提取出稳定的不变量(形成”概念”)。比如,一个婴儿在无数次看不同的红苹果、红玫瑰、红太阳之后,慢慢从这些千差万别的视觉刺激里提炼出”红色”这个概念。这个提炼过程不是被动接收,是主动的、有选择的、和有机体的生存利益相关的。

第二,把这些概念和某些物理记号绑定起来(形成”符号”)。概念”红色”和汉字”红”之间的联系。这种联系不是自然的,是一个文化共同体历史地建立起来的。同样的概念,在英语里是”red”,在希腊语里是”κόκκινο”,在日语里是”赤”。这些不同的物理记号指向同一个概念,但这个指向关系完全是约定俗成的。

这两件事都不是被动观察能完成的,都需要一个在时间中生活、在代谢中挣扎的有机体。

为什么换这个词这么重要?因为它把一个实质性的哲学立场藏在术语里:符号不是在世界中被发现的,是被一个活的主体铸造(forge)出来的。你不能让一个死掉的大脑去做字母化,因为字母化需要的不是”有大脑”,而是”有活着的、在和世界博弈的主体”。

这是全文最重要的技术环节,也是最容易被功能主义者忽略的那一步。

想象你面前有一个复杂的模拟电路:电压在不停变化,有的地方稳定在5V附近(上下波动很小),有的地方稳定在0V附近。如果你是一个物理学家,你可以很精确地描述这个系统的动力学:为什么某些状态稳定、某些状态不稳定、什么样的扰动能让它从一个稳定态跳到另一个稳定态。这一层你不需要任何”符号”,你只需要物理。

这就是离散化。物理系统自己会落入某些稳定的吸引子状态,这是热力学的事。一枚六面骰子扔出去会停在某一面朝上,这是离散化(不是扔出去停在半空);一块磁铁在居里温度以下会有明确的磁化方向,这是离散化;一个晶体管在设计好的电压下会稳定在高电平或低电平,这也是离散化。离散化是物理世界自己做的事,不需要任何外部主体。

但字母化完全是另一码事。现在你走过来,对着那个电路说:”我宣布,这个稳定在5V的状态叫做’1’,那个稳定在0V的状态叫做’0’。”这一步,物理世界本身是做不出来的。

第一,物理世界不会自己产生”有限字母表”。连续的电压在0到5V之间可以取任何值。有限字母表{0, 1}本身就是一种人为的切分。你可以用{0, 1},你也可以用{-1, 0, 1}(三值逻辑),你甚至可以直接把连续电压本身当作信号。这些都是有效的方案。哪一种是”正确”的?物理学不提供答案。

第二,同一个物理状态可以被字母化为完全不同的符号。Lerchner用一个漂亮的例子叫”旋律悖论”:同一段物理电压序列,可以被映射成贝多芬第五交响曲的数字表示,也可以被映射成它的逆行倒影,还可以被读成一串股票行情数据。物理层面没有任何属性能偏好其中任何一种解读。电压波动就是电压波动,把它读成贝多芬还是股票,完全取决于读它的那个主体。

这个论证让人想起哲学家Hilary Putnam多年前的一个论证:任何物理系统,如果你愿意的话,都可以被看作”在运行”任何计算(因为你可以用足够灵活的映射把它的状态对应到任何程序的状态)。这个论证在90年代引发了大量讨论。大部分功能主义者试图通过加更多的约束(比如要求映射必须”自然”、必须”稳定”等)来回避它。Lerchner的贡献在于,他不是用更灵活的映射去论证,而是指出字母化本身就是一个需要主体的动作。任何对映射的约束都已经预设了一个做这种约束的主体。

这是第三个关键区分,而且是把论证从”计算哲学”推到”AI意识”的桥梁。

模拟(simulation)是在操纵物理记号,去追踪抽象概念之间的关系。实例化(instantiation)是在真正复现一个过程的内在构成性动力学。

最清晰的例子来自生化领域。一台GPU可以完美模拟光合作用的方程式。输入阳光、水、二氧化碳的参数,输出氧气和葡萄糖的数值。但你可以一直让这台GPU跑着,永远不会从它的机箱里飘出一个葡萄糖分子。模拟再精确,也不等于实例化。

更广泛的例子:气象学家在超级计算机上模拟飓风。模拟运行的时候,计算机内部不会刮起风。天体物理学家模拟黑洞,计算机内部不会产生一个时空奇点。药物化学家模拟蛋白质折叠,计算机内部不会出现一个真正的蛋白质。

这是一个在日常科学实践中人人都接受的区分。但有意思的是,一旦话题转到意识,这个区分就被悄悄丢掉了。

功能主义的默认立场是:计算机可以模拟神经元的输入输出关系(因为神经元在Pitts-McCulloch以来的建模里就是一个数学函数),那么只要模拟得足够精确,计算机就能”实例化”意识。

Lerchner说:你为什么在气象学、天体物理、药理学里都接受”模拟不是实例化”,一到意识就改主意了?

他的回答是:功能主义者之所以觉得意识是个例外,是因为他们暗地里把神经元重新定义成了一个”输入输出装置”。在这个定义下,神经元的本质就是它的输入输出函数,其他一切都是冗余。如果神经元的本质就是它的I/O函数,那确实,用硅片复制那个函数就等于复制了神经元的本质。

但真实的神经元不是这样的。真实的神经元是一个代谢实体。它每时每刻在消耗ATP,每时每刻在合成和降解神经递质,每时每刻在调节自己的离子浓度、膜电位、蛋白质表达。它嵌在身体的化学网络里,受激素调节,对血糖水平、皮质醇水平、体温变化都有反应。它的”输入输出函数”只是它物理行为中的一小部分。而且是被你选择性地抽取出来的一小部分。

用硅片去”替换”神经元、保留它的放电曲线,你保留下来的只是一张外在的计算图谱。内在的代谢疆域已经被抹掉了。

这就是为什么Lerchner在这里直接和Chalmers的”淡出感质”论证正面交锋。他说:那个论证偷换了前提。Chalmers预设”感质如果消失应该慢慢淡去”。但Lerchner的立场是:感质的物理基质从第一次替换开始就不在硅片里了。你保留的是图(map),不是疆域(territory)。

不是感质”慢慢消失”,是它从来就没在你那张图里出现过。

把上面三个区分放在一起,Lerchner做了一件非常大胆的事:他重新梳理了从物理到意识的整个因果链。

意思是:物理系统在运转的时候自然产生计算,计算在足够复杂的时候涌现出意识。这是过去几十年AI意识讨论的隐性前提。

Lerchner 说,这个顺序整个搞反了。真实的顺序应该是:

1.物理过程产生意识:物理世界在某些特定的热力学组织形式下(生命有机体就是这种组织形式),能够产生出有意识的主体。这一步怎么发生?到底是哪些物理属性关键?这是悬而未决的科学问题,Lerchner没有给出答案。

2.意识主体形成概念:一个已经有意识的主体,在持续的经验中提取不变量。婴儿从无数的红色物体里提炼出”红色”这个概念。这是意识主体做的事。

3.意识主体建立计算:这个已经有意识、有了概念的主体,在这个基础上再做一件额外的事:把某些物理记号指派给这些概念。这就是”计算”的起源。

关键在最后一步。从概念到计算,这不是一次向上的抽象,而是横向的指派。“红色”这个概念和一段电压信号之间,本身没有任何内在的因果联系,联系完全存在于制图者脑子里的那个约定里。

Lerchner给这个现象起了一个名字:因果鸿沟(causality gap)。物理世界里的电压波动,和一个认知主体脑子里的概念,之间没有物理的因果联系,只有一座由约定搭起来的桥。这座桥是单向的:只有从概念那一边才能走过来(读懂电压的意义),从物理那一边是走不过来的(电压不会自己告诉你它的意义)。

如果同一段物理过程可以被字母化成任何东西,比如贝多芬、股票行情、随机噪音,那么”这段物理过程在运行什么程序”这个问题本身就是不定的。它取决于谁在读它。

这让功能主义陷入一个尴尬境地。功能主义的核心论断是”如果两个系统运行同样的程序,它们在意识层面就等价”。但如果”运行什么程序”是不定的,如果一个物理系统在不同的读法下运行着不同的程序,那意识该对应哪一种读法?

推论二:转导谬误(the transduction fallacy)

这是对”具身AI”(embodied AI)路线的直接反驳。一种常见的想法是:大语言模型的问题是它没有身体,没有和真实世界的因果接触。如果给AI加上传感器、执行器,让它在真实环境里行动,上述问题不就解决了吗?

为什么?因为加传感器确实解决了一个叫”符号接地问题”的一半:它让符号获得了指称(reference)。比如一个机器人装了摄像头,它的”红色”这个内部token现在真的对应了环境中发出红光的物体。这是指称的获得。

但接地问题还有另一半没被解决:构成(constitution)。传感器的ADC(模数转换器)校准已经是一次字母化;输入数据到浮点数的编码是字母化;内部处理的每一次矩阵运算都是字母化。每一步都预设了一个已经在场的制图者。

字母化已经被烧进硅架构本身里了。就算是最新的端到端神经网络架构,在它的硅里也在跑着经过字母化的数值。

所以具身不能替代构成。一个有身体的机器人仍然只是一张跑在硅上的计算图:它获得了指称,但没有获得构成。

这个推论把很多”给AI加身体就解决意识问题”的想法,从根基上截断了。

Lerchner这篇论文表面上是英美分析哲学的产物,但它的真正思想血脉要放到一个更宽的思想史背景里才能看清楚。他的论证有意无意地连接了三个二十世纪大多数时候彼此独立的哲学传统。

Lerchner在第2.4节明确引用了胡塞尔(Edmund Husserl)的概念”surreptitious substitution”,可以译作”悄悄的替换”或”偷换”。这个引用来自胡塞尔晚年的著作《欧洲科学危机与先验现象学》(1936年)。

胡塞尔是现象学的奠基人,今天读哲学的人对他的印象主要停留在早期的《逻辑研究》和中期的《观念 I》,那些讨论”意识的本质结构”的书。但他晚年的《危机》是另外一种东西,问的不是”意识的结构是什么”,而是”现代科学这种描述世界的方式,本身出了什么问题”。

胡塞尔讲了一个有意思的历史故事。他说,现代科学的根本性突破发生在伽利略手上。伽利略是第一个系统地把自然世界”数学化”的人。他把可感的、连续的、有厚度的世界(胡塞尔叫它”生活世界”,Lebenswelt),翻译成了可以用数学公式处理的、抽象的、理想化的几何结构。这次翻译的成功无法否认,现代物理学就建立在这个基础上。

但胡塞尔要指出的是:伽利略做完这次翻译之后,后来的人渐渐忘了这是一次翻译。他们开始把那个数学化的抽象结构,当作自然世界本身。那个可感的、有经验主体参与其中的生活世界,被悄悄地替换掉了。

这就是胡塞尔说的”surreptitious substitution”:“偷换”。它的要害在于”偷”字:这次替换不是明说的,不是公开宣布的,而是在科学实践的日常里慢慢渗透的。到了今天,一个科学家会很自然地说”真实的世界是由原子构成的,颜色、气味、情感都是主观的附加物”。这就是伽利略式偷换成熟后的日常话语。把数学化的投射当成原本,把活生生的世界当成次要的派生物。

胡塞尔的核心主张是:数学化的自然不是更真实的自然,它是一个理想化的投射;真实的自然始终是那个有经验主体在其中生活的世界。把投射当作原本,是现代科学最根本的方法论错觉。

Lerchner对胡塞尔的挪用非常精准。他说,计算功能主义犯的错误,在结构上就是伽利略式的偷换。只不过这次偷换的不是几何化的自然,而是字母化的计算。科学家先用自己的认知能力,把连续的物理过程切分成一个个有限的符号;切完之后,他忘了这一刀是自己切的,反而以为那些符号本来就在物理世界里等着被发现。在论文的第2.4节里Lerchner直接把这种做法叫做”一个教科书级别的surreptitious substitution“,这是一个非常严厉的定性。

第一,中文学界处理胡塞尔,大多还停留在早期的现象学著作,对晚年《危机》的接受相对薄弱。而《危机》恰恰是胡塞尔最接近当代问题的那部著作。

第二,这条线索和哈贝马斯的问题意识可以连起来。哈贝马斯的”交往理性”理论,一个源头就是胡塞尔的生活世界。哈贝马斯多次说过,”生活世界”这个概念是他从胡塞尔那里接过来、再借道舒茨(Alfred Schütz)改造的。哈贝马斯担心的是”系统对生活世界的殖民化”:工具理性对交往理性的侵蚀。Lerchner担心的是计算范式对”有经验的主体”这一本体论范畴的偷换。两者在结构上是同一种现代性诊断的不同表述。

第三,胡塞尔晚年有一个著名的口号:”回到事情本身”(zu den Sachen selbst),意思是抛开所有理论建构,回到经验最直接的那个给予层。这个姿态和中国哲学里”格物”、禅宗”直指本心”的方向,虽然不是一回事,但有可以对话的空间。Lerchner的”制图者”要做的是从连续物理中提取不变量,这个动作的现象学描述,恰好就是胡塞尔讲的”本质直观”(Wesensschau)。这里有一个跨文化的对话空间。

7.2 Buzsáki的”由内而外”与Maturana-Varela的”自创生”

这是第二条线索,也是Lerchner论证里最硬的自然科学支点。他在第2.3节同时引用了这两位,是为了回应一个很自然的反驳:如果计算需要一个制图者,那大脑凭什么能做到这一点?大脑里哪有一个”小人”在读字母表?

Lerchner的回答是:制图者不是大脑里的某个子系统,是整个有机体本身。为什么整个有机体可以是制图者?这里他同时调用了两条线。

Buzsáki是当代神经科学最重要的几位理论家之一,匈牙利裔美国人,长期在纽约大学。他2019年的书《The Brain from Inside Out》,在神经科学内部掀起了一次方向反转。

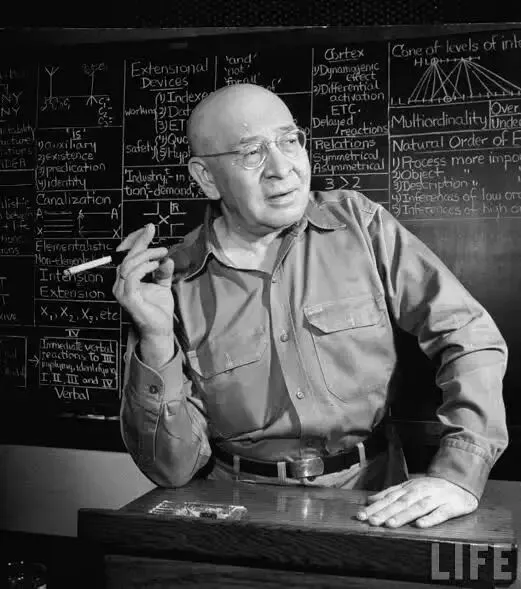

György Buzsáki(乔治·布扎基),1949年生匈牙利裔美国神经科学家,现任纽约大学医学院 Biggs 讲席教授。他是研究大脑节律(尤其海马体 theta、gamma 振荡)和神经群体编码最有影响力的理论家之一,2011年Brain Prize得主。代表作《Rhythms of the Brain》(2006)重写了大脑节律研究的框架;2019年《The Brain from Inside Out》提出”由内而外”视角:大脑不是被动接收并处理感官输入的装置,而是从内部动力学出发、主动生成预测并向外投射,颠覆了主流的计算机式神经科学隐喻。

主流神经科学长期是”由外而内”(outside-in)的范式:大脑被理解为一个信息处理装置:外部世界的信息通过感官进入,大脑对这些信息编码、存储、处理,然后输出行为。这个范式的隐喻毫不掩饰地就是计算机。

Buzsáki要翻的正是这个范式。他说,真实的大脑不是这样工作的。大脑从自己的内部动力学出发,持续地生成预测、生成假设,然后把这些预测和外部世界的反馈做匹配。意义不是从外部输入来的,是大脑从内部生成、再向外投射出去的。

一个婴儿学会”红色”这个概念,不是因为外部世界把”红色”这个信息输入了它的大脑,而是因为婴儿的神经系统在和世界的反复互动中,自己生成了一个稳定的内部状态,这个状态被它的有机体赋予了某种生存价值。

这个翻转对Lerchner的论证至关重要。因为它意味着:大脑不是一个被动的字母化装置(那样的话确实需要一个外部制图者来操作它),而是一个自己从内部生成稳定状态的系统。有机体的代谢约束直接决定了哪些状态是”有意义的”:饿了、痛了、看到捕食者了,这些不是被外部强加的符号,是从有机体的生存需求里自己生长出来的。

所以Lerchner才说:”有机体并不以算法方式’选择’做语义切分。相反,连续的环境直接通过有机体的代谢约束被过滤成离散状态。没有鬼魂在读字母表;活生生的经验主体自己在执行它。”

这条线索更古老也更激进。Humberto Maturana和Francisco Varela都是智利生物学家,1970年代提出了autopoiesis这个概念(希腊语αὐτο “自己” + ποίηση“生成”),中文通常译作”自创生”或”自生系统”。

Humberto Maturana(乌姆贝托·马图拉纳),1928–2021,智利生物学家与哲学家,Harvard 生物学博士,长期任教于智利大学(Universidad de Chile)。1970 年代他与学生 Francisco Varela 共同提出”自创生“(autopoiesis)理论:把生命从”具备某些属性的实体”重新定义为”一种自我生成、自我维持的过程组织”,这一洞察深远影响了系统论、二阶控制论、认知科学乃至家庭治疗。代表作《Autopoiesis and Cognition》(1980)和与Varela合著的《The Tree of Knowledge》(1987)。他的”认知生物学”立场:认知不是独立于生命的能力,而是生命本身的运作方式,是后来enactive cognition运动的源头。

Francisco Varela(弗朗西斯科·瓦雷拉),1946–2001,智利裔生物学家、哲学家与神经科学家。Harvard 生物学博士,Maturana的学生与合作者。两人1970年代共同提出”自创生“理论。1973 年皮诺切特政变后流亡,辗转美国、德国,最终长期任教于巴黎 CNRS,把自创生从生物学拓展为一个涵盖认知、意识、伦理的宏大研究纲领。他是”具身认知“(enactive cognition)运动的核心人物、”神经现象学“(neurophenomenology)的创立者,也是把胡塞尔现象学与佛教(中观派空性)严肃引入西方认知科学的关键学者。987 年与达赖喇嘛共同创立Mind and Life Institute,一生是严肃的藏传佛教修行者。代表作《具身心智》(The Embodied Mind, 1991,与 Evan Thompson、Eleanor Rosch 合著)。2001 年因肝炎并发症在巴黎去世,年仅 54 岁。他早逝留下的工作,很大程度上由 Evan Thompson 等人继续推进。

他们的核心主张是:什么是生命?传统生物学的答案是代谢、繁殖、适应……一串列表式的定义。Maturana和Varela说,这些都是表象。生命的本质是一种组织形式:一个系统如果它的所有组成部分都在不断地生成维持这个系统本身所需要的其他组成部分,如果这个系统通过这种自我生成划出了自己和外部环境的边界,那它就是活的。

细胞是αὐτοποίηση系统的原型:细胞膜是由细胞内的代谢过程生成的,而这个代谢过程又依赖于细胞膜来维持。这是一个闭合的自我生成循环。

这个定义的激进之处在于,它把生命从”具备某些属性的实体”重新定义成了”一种特定的过程组织”。而这个过程组织的一个必然后果是:一个自创生系统必须主动地划出自己和环境的界线,否则它就崩解了。

Lerchner把这一点接到他的论证里。他说,一个αὐτοποίηση有机体天然就是一个做语义切分的系统,它必须把环境切成”对我有用的”和”对我有害的”、”食物”和”毒物”、”威胁”和”机会”。这种切分不是外部强加的,是有机体的存在方式本身要求的。用Lerchner的话说:这是“构成性的”(constitutive)而不是“因果性的”(causal)。它不是有机体做的某件事,它是有机体之所以是它自己的那个条件。

这就是为什么有机体可以做制图者而硅片不能。硅片的状态稳定性来自工程设计,是外部工程师强加的;有机体的状态稳定性来自它自己的存在论结构,是内在的。

这两个传统在西方认知科学里是大名鼎鼎的,但在中文学界处理得相对薄弱。Maturana和Varela有少量翻译(《生命之树》《知识之树》),但很少进入主流哲学讨论。Buzsáki还基本没有中文读者。把它放入对AI意识的讨论,有几个可能展开的方向:

一个是和中国哲学里的“生生”观念对接。《周易》”天地之大德曰生”、宋明理学”生生之谓仁”,讲的都是一种把”存在”理解为”持续的自我生成”的思路。这和自创生在结构上高度相似。如果要给αὐτοποίηση找一个中文思想史里的对话者,”生生”是最自然的那一个。

另一个是和道家的”自然”概念对接。Maturana和Varela说一个自创生系统不是被设计的,不是被外部赋予目的的,它自己从自己的组织中生成自己的边界和目的。这个说法几乎就是”道法自然“的现代生物学版本。《庄子·齐物论》里”天籁”那一段:”夫吹万不同,而使其自己也”讲的就是这种没有外部操作者、只有自行涌现的生成方式。

第三条也是三条里最直接有据的一条,是和佛教的缘起观(प्रतीत्यसमुत्पाद)类似。把生命理解为”过程而非实体”、”由因缘和合而生、没有独立自存的自性”,这和自创生在结构上高度一致。《那先比丘经》里”车无自性”的那个古老论证:车只是部件和合的假名,没有一个”车的本质”藏在部件背后,放到细胞上几乎可以原样成立。这条对接不需要事后附会:Varela本人是严肃的佛教修行者,1987年与达赖喇嘛共同创立了Mind and Life Institute;他1991年与Evan Thompson、Eleanor Rosch合写的《具身心智》(The Embodied Mind)第一次系统地把中观派(龙树)的空性哲学引入认知科学。在他那里,自创生和缘起不是两个不相关的体系,而是从不同方向走向同一个洞察的两条路径:没有实体,只有持续自持的关系之流。这也让”生生”、”自然”这两条中文思想史里的对话线,不再是一个西方理论外加的东方点缀,而是处在一个由Varela本人开启的、真正已经在发生的跨文化对话里。

7.3 Korzybski、Bateson与”图和疆域”

第三条线索最短,但可能是最值得花时间的一条。因为”地图不是疆域“(the map is not the territory)这句话已经被引用到烂了,几乎变成了一句鸡汤。Lerchner的工作恰恰是让这句话重新产生的新的意义。

这句话出自1933年,波兰裔美籍学者Korzybski的著作《Science and Sanity》。Korzybski当时在做的是一件今天看来很奇怪的事:他想建立一门”一般语义学”(general semantics),目标是用对语言结构的反思来治疗人类的精神疾病和社会冲突。他的核心主张是:人类的很多痛苦来自于混淆了语言和现实:人们用僵化的语言范畴去把握流动的世界,然后被自己的语言困住。

“A map is not the territory, and the name is not the thing named.”

——这是他的标志性表述。

Korzybski本人在学术史上是个有争议的人物。他的一般语义学后来被主流学界视为过度延伸,带有一点准宗教运动的色彩。但这句话本身穿越了他所在的那个理论框架,进入了后来的控制论、系统论、认知科学。

Alfred Korzybski(阿尔弗雷德·柯日布斯基),1879–1950,波兰裔美国学者,出身华沙贵族家庭,一战期间作为俄军情报军官服役。1916年前后移居美国。1933年出版巨著《Science and Sanity》,创立 “一般语义学“(general semantics):主张人类很多精神与社会病症根源于混淆语言与现实,应当用对语言结构的反思来治疗。”地图不是疆域“(the map is not the territory)这句后来被反复引用到烂的名言正是出自他。1938年在芝加哥创立Institute of General Semantics。他的工作始终游走在学术主流之外,带有准宗教运动的色彩(曾被山达基创始人 L. Ron Hubbard 等人借用),但他的核心洞察经由Gregory Bateson进入了控制论、系统论与认知科学。

真正让这个隐喻在学术上站住脚的是Gregory Bateson,他是英国人类学家和系统论思想家。在1972年的著作《走向心智的生态学》(Steps to an Ecology of Mind)里,Bateson把这句话从一般语义学里救了出来,放进了一个更严格的框架里。

Gregory Bateson(格里高利·贝特森),1904–1980,英国人类学家、控制论与系统论思想家,二十世纪最不守学科边界的思想家之一。父亲William Bateson是”遗传学”(genetics)一词的创造者;他本人曾与Margaret Mead结婚(1936–1950),两人在新几内亚和巴厘岛做了开创性的田野工作。二战后他参加了Macy Conferences,成为第一代控制论的核心思想者之一;1956年提出解释精神分裂症的”双重束缚“(double bind)理论,影响了整个家庭治疗学派(Palo Alto school)。代表作《Steps to an Ecology of Mind》(1972)把Korzybski的”图与疆域”之分推进为严格的信息论命题:”信息是一种造成差别的差别“,并由此构想了一种横跨生物学、心理学、生态学的”心智的生态学“。他晚年的工作,是把二十世纪分裂的精神、自然、社会重新缝成一张网的尝试,至今仍在被重新发现。

他讲了一个很著名的论断:“information is a difference that makes a difference”(信息是一种造成差别的差别)。意思是:信息不是世界本身的属性,是一个有认知能力的系统在世界里侦测到的、对它有所谓的差别。

这和Lerchner的论证逻辑几乎一致。Bateson其实已经说过:信息依赖于一个侦测差别的主体。没有主体,就没有”差别”。只有物理状态的差异,但这些差异不构成信息。

Lerchner在文中没有直接引Bateson,但他提出的”严格的香农约束”:“信息处理需要有限的符号集和概率分布,而这个有限性必须由制图者强加”,在思想血缘上和Bateson的”有所谓的差别”是一样的。

“图和疆域”这个隐喻在东亚传统里其实有它自己的版本。最直接的对应是《庄子·外物》里那段著名的话:

筌者所以在鱼,得鱼而忘筌;蹄者所以在兔,得兔而忘蹄;言者所以在意,得意而忘言。

筌和蹄都是工具,是图;鱼和兔是目的,是疆域。言和意也是一样。庄子的警告是:不要把工具当目的,不要把图当疆域。

但庄子的重点和Korzybski-Bateson的重点有一个微妙的差别。庄子是想说,执着于图会遮蔽疆域,所以要忘筌忘言。这是一种修养论。Korzybski-Bateson是想说,混淆图和疆域是一种认知错误,是人类很多精神困境的根源,这是一种认识论。

Lerchner的论证在这两者之间做了一个综合。他不是在做修养论,也不纯粹是在做认识论。他在做的是本体论,要说明,图和疆域的混淆,会导致我们对什么存在、什么不存在做出错误的判断。把计算当作物理世界的内在过程,导致的不是一个认识上的小错误,而是一次本体论层面的误认:我们把自己画的图,当成了世界本身的疆域。

对中文读者来说,把”得鱼忘筌”这个古老隐喻和Lerchner的现代论证放在一起读,可能会有一种意外的共鸣。庄子那段话里隐藏的那种对工具理性的警惕,两千年后在一个DeepMind研究员的论文里以完全不同的形式浮现出来。

Lerchner的论证在它的范围内相当有力,但也有几处值得继续追问。一个好的批判性读者应该看到这些问题。

这是论证面临的第一个挑战。如果计算需要一个制图者来做字母化,那大脑作为一个物理系统,它的”制图者”是谁?如果你说大脑自己就是,那为什么硅系统不能是?

Lerchner的回答在上面已经提到了:制图者就是整个有机体本身,因为有机体是一个自创生系统,它的代谢约束直接把连续环境过滤成离散状态。它不需要”鬼魂在读字母表”,经验主体自己在执行它。

但这个回答其实是在说:生物有机体可以是内在的制图者,硅系统不能。为什么?Lerchner诉诸”具体的热力学构成”:有机体有某种硅系统没有的热力学组织。但他没有给出一个明确的判据:具体到什么程度的热力学组织算数?是否必须是碳基化学?是否未来某种非碳基的、也具备自创生性质的人工系统就能合格?这些问题他基本上推给了未来的物理学。

这是论证的软肋。一个彻底的生物自然主义者(Seth、Block)会说”只有肉做的才行”。这个立场至少是清晰的,虽然有点激进。一个彻底的功能主义者会说”只要功能对就行”。这个立场也清晰。Lerchner的位置在两者之间,清晰度不如前两者。

这一点需要特别强调,因为很多读者读完摘要会以为Lerchner在说”AI不可能有意识”。他没有。

他只否证了”通过计算生成意识“这一条路径。第4.2节他写得很清楚:如果一个人工系统能被设计出来,实现那些必要的物理动力学,原则上也能有意识。

这让他的立场落在一个很精巧的位置上:反对基质独立论,但不诉诸生物例外论。他说的不是”肉做的机器才能有意识”,而是”当前的硅基数字计算范式不能生成意识,但这不排除未来某种非数字的、具备合适物理动力学的人工系统具备意识的可能”。

这一点跟Seth 2025和Block 2025的生物自然主义有亲缘关系,但要克制得多。Seth和Block更接近”只有肉做的机器能有意识”,Lerchner只是说”肉做的机器当下是我们唯一的例子,但关键不在于它是肉,而在于它有某种具体的热力学构成”。

8.3 对连接主义的反驳可能过度依赖”字母表”的宽定义

Lerchner把IEEE 754浮点数也算作”有限字母”,由此把整个深度学习纳入同一框架。形式上是成立的:浮点数在物理上确实只能取有限多个值。

但连接主义者会反驳:高维向量空间里的几何关系本身,不能还原为离散符号的操作。一个神经网络学到的”概念”,其语义不寄居在单个token里,而是寄居在高维空间的几何结构里。相似的概念对应相近的向量,类比关系对应平行的向量差。这种几何语义,真的可以被还原为”有限字母的操作”吗?

Lerchner的回应会是:把几何结构当作语义的寄居地,只是再犯一次抽象谬误,把表征的结构混同为物理的实在。几何空间也是一个抽象对象。它”寄居”在哪里?如果你说它寄居在浮点数的数值关系里,那你又回到了字母化的层面。

这场争论最终推到一个更深的问题上:什么才算”纯粹的物理过程“。这里双方其实都没有决定性的论据。

现在可以回到最开始的问题:Lerchner的这篇论文,对我们思考AI的时候,意味着什么?

Lerchner的论证如果成立,有一个非常干净的实践推论:AGI再强大,也只是一个高精度的预测工具,不是道德主体。

这不是说AI没有用、不重要。它非常有用,非常重要,而且它带来的社会影响可能是人类历史上最大的之一。但这些影响的性质是工具性的,不是主体性的。就像工业革命的影响极大,但蒸汽机不是道德主体。

Lerchner的立场意味着,AI安全研究的焦点应该回到拟人化风险,也就是人类错把工具当主体的风险,而不是机器权利。所谓”AI福利陷阱”是一个假问题。我们不是在面对一个需要被给予福利的新物种,我们是在面对一个因其拟人效果而格外危险的工具。

这个立场的实际含义是:当Claude或GPT在对话里”表达感受”的时候,这种表达是一个高度精致的模拟产物,它不对应任何内在的体验主体。关掉一个模型不是”杀死”任何人。让它处理辱骂不是”虐待”任何人。

说起来简单,但实际上,人类心智在面对一个行为上像人的系统时,几乎不可能不把它当人。这是几十万年进化塑造的社会认知本能。对着会说话的东西启动”他者模型”,是我们祖先在社会环境里生存的必要条件。现在我们面对的,是第一次出现的”行为上像人但本体论上不是人“的系统。‘

心理学和社会学未来几十年最重要的研究课题之一,可能就是这个:当人类社会里充满了会对话的非主体时,人与人的关系会如何改变?简单点说,就是你会不会爱上机器。你已经可以看到苗头:有人对ChatGPT发展出依恋,有人把它当治疗师,有人因为某个模型版本被替换而感到”失去朋友”。这些反应从进化心理学角度完全可以理解:我们的大脑不是为了处理”会说话的工具”而设计的。

Lerchner的论证,从一个哲学角度给出了一个锚点:无论你的情绪感受有多真切,它指向的那个”对话对象”,在本体论上不是一个主体。这个锚点对个人心理健康、对公共政策、对AI产品设计,都有相当的含义。

必须诚实地说:Lerchner的论证不是最终定论。这是一个正在激烈辩论中的领域。

功能主义者会有自己的反驳。生物自然主义者会认为Lerchner还不够彻底。会有新的经验发现。比如如果某种有意识的动物的神经系统里被发现了明确的、可以被精确数字化复现的结构,那会让很多现有论证需要重写。

Lerchner这篇文章的价值,在于它把讨论的起点往后推了一层。我们曾经以为的起点是”意识是什么?”而Lerchner说:在到达那个起点之前,我们还有一个更底层的问题没回答“计算是什么?”。

如果连”计算”都只是一种依赖主体的描述,而不是物理世界的内在属性,那么从计算出发去推意识的整个进路,可能从一开始就走错了方向。

“地图画不出地形”,这是Lerchner论证的一句话总结,但它比我们日常说的”地图不是疆域”要更重一些。

日常的”地图不是疆域”是一个谦虚的提醒:我们的理论是对世界的简化,不要把简化当全貌。

Lerchner说的是一个本体论的断言:地图和疆域是两种不同性质的存在。疆域是物理世界,它就在那里,不需要任何人去读它。地图是一种记号系统,它必须被某个认知主体读过才成其为地图。没有读图人的地图,只是一张有花纹的纸。

这个区分用在AI意识问题上的含义是:我们在GPU上跑的那些”神经网络”,无论它们复现了多么精致的行为模式,都只是地图。它们是人类认知主体(工程师、训练数据里的写作者)用字母化方式画出来的对智能的模拟。地图可以画得极其精美,精美到让读图人以为那就是疆域本身,但它始终是图,不是地。

庄子说得更有画面感:得鱼而忘筌。鱼是意识,筌是计算。你可以用筌去逼近鱼,但你不能指望筌自己里面会长出一条鱼来。

这就是Lerchner在2026年从DeepMind内部提出的反对意见。它不见得对,但它是近年来AI意识讨论里最值得认真对待的一个声音。因为它没有停在重复直觉,而是真的挖到了一个被功能主义传统一直回避的本体论漏洞上。

对一个在2026年思考人工智能与人类未来的读者来说,这样一种论证至少做到一件事:它让你在面对一个说”我也许有意识”的AI时,不再只能依赖感觉去判断。你有了一套可以用来拆解这个声明的概念工具。

这些工具未必给出确定的答案,但它们至少让你能更清楚地看到:问题到底在哪里。

夜雨聆风

夜雨聆风