一文搞懂 AI Agent、AI 智能体与 Agentic AI:概念、区别

-

AI Agent(智能体)到底是什么?

-

它和普通的 AI 对话有什么本质区别?

-

Agentic AI 又是什么?

-

它和 AI Agent 是同一回事吗?

-

LLM(大语言模型)和 AI Agent 是什么关系?

-

ChatGPT 算不算 AI Agent?

-

市面上那么多产品——Dify、N8n、OpenClaw、Manus、豆包——它们分别属于哪一类?

-

我的场景适合用哪种方案?

-

什么时候用 Agent,什么时候用 Workflow?

-

自主性(Autonomy):无需人工直接干预即可运行。

-

反应性(Reactivity):能感知环境并及时做出反应。

-

主动性(Pro-activeness):不仅仅是被动反应,还能主动展示目标导向的行为。

-

社会能力(Social Ability):能通过通信语言与其他 Agent 或人进行交互。

-

系统性:Agent 不是单一的模型或组件,而是多个子系统的有机整体。

-

自主性:Agent 能够独立做出决策,不依赖逐步的外部指导。

-

环境交互:Agent 通过感知获取信息,通过执行改变环境,形成完整的反馈循环。

-

学习能力:Agent 能够从执行结果中提取经验,不断改进决策策略。

-

目标导向:所有行为都服务于明确的、可评估的目标。

-

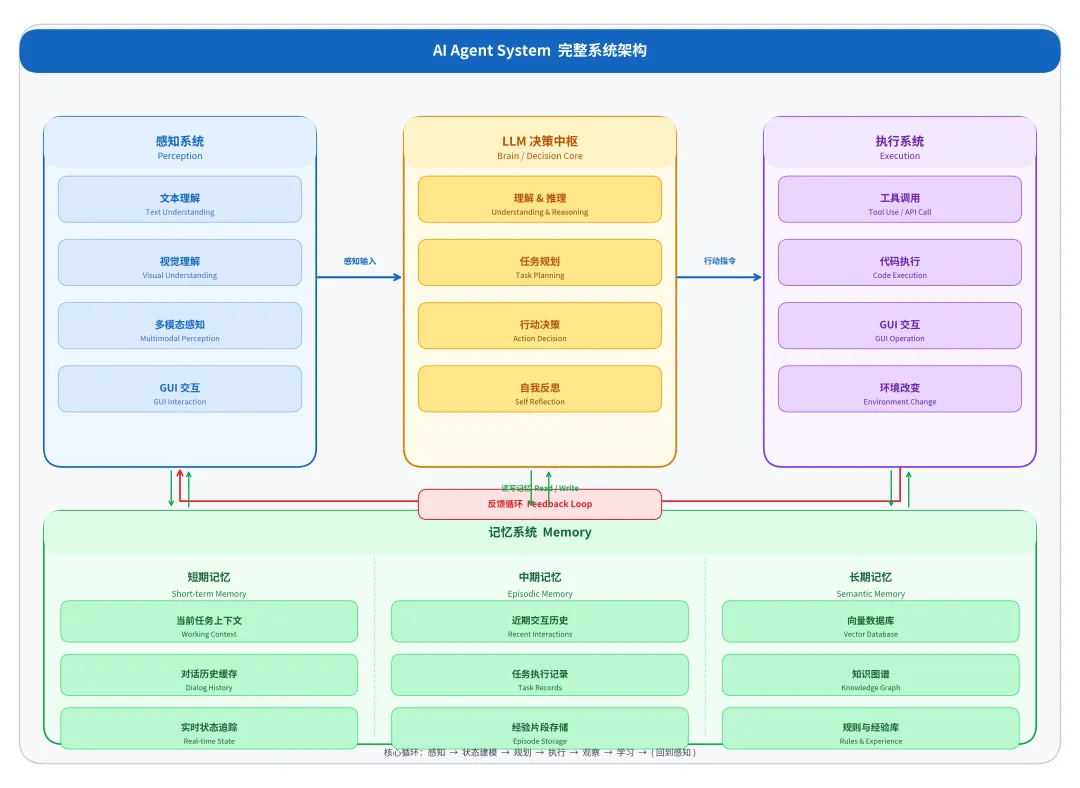

大脑(LLM):负责核心决策。

-

规划(Planning):任务拆解与自我反思。

-

记忆(Memory):短期与长期记忆。

-

工具使用(Tool Use):调用外部 API。

|

维度 |

AI Agent |

Agentic AI |

|

定义出处 |

学术界(Russell & Norvig, Wooldridge & Jennings) |

工业界(吴恩达、OpenAI、红杉资本) |

|

定义时间 |

1990 年代(甚至可追溯至图灵时期) |

2024 年(吴恩达正式提出概念) |

|

核心定义 |

感知环境并执行动作的实体 |

具备自主规划、推理、反思能力的系统能力 |

|

关注点 |

个体行为:如何像一个智能生物一样行动 |

系统能力:如何像人类员工一样独立解决问题 |

|

公认标准 |

自主性、反应性、主动性、社会性 |

规划(Planning)、工具使用、反思(Reflection)、多智能体协作 |

|

应用范围 |

单点自动化、特定任务 |

跨系统工作流、复杂业务流程 |

-

文本感知:直接处理用户输入、调用 API 获取结构化数据、解析日志和文档。

-

视觉感知:使用视觉模型(如 CLIP、GPT-4V)理解图片,使用 OCR 识别文本,使用目标检测识别对象。

-

多模态感知:融合文本、视觉、音频等多种信息,建立跨模态的表征。

-

GUI 感知:Anthropic 的 Computer Use 通过截取屏幕并识别 GUI 元素状态来实现,这远比简单的 API 数据拉取复杂得多 [2]。

-

短期记忆(Working Memory):范围是当前对话/任务的上下文,容量有限(通常由 LLM 的上下文窗口限制),功能是维护当前的任务状态和对话历史,实现方式通常是 LLM 的输入提示词。

-

中期记忆(Episodic Memory):范围是最近的交互历史(数小时到数天),容量中等,功能是记录最近发生的事件和学到的知识,实现方式是数据库、缓存系统。

-

长期记忆(Semantic Memory):范围是长期积累的知识(数月到数年),容量大,功能是存储通用知识、规则、经验,实现方式是向量数据库、知识图谱、微调模型。

-

Chain of Thought(CoT):生成一系列中间推理步骤,提高推理能力和可解释性,但是线性的,不能回溯 [3]。

-

Tree of Thoughts(ToT):维护一个思维树,每个节点代表一个推理步骤,支持多路径探索,更灵活,但计算成本高。

-

ReAct(Reasoning + Acting):交织推理和行动,形成反馈循环,推理被行动结果验证,更准确 [4]。

-

思考(Think):LLM 生成推理步骤。例如:”我需要查找 X 的信息,然后比较 Y 和 Z”。 -

行动(Act):执行具体的行动。例如:”调用 API 获取 X 的信息”。 -

观察(Observe):获取行动的结果。例如:”API 返回了 X 的信息:…”。 -

反思(Reflect):根据观察结果调整推理。例如:”根据获得的信息,Y 和 Z 的关系是…”。 -

继续或结束:决定是否需要更多行动。例如:”现在我有足够的信息来回答问题”。

-

工具调用(Tool Use):调用 API、函数、插件,间接改变环境,通过工具的中介。

-

代码执行(Code Execution):执行 Python 代码、SQL 查询、Shell 命令,直接计算,处理复杂逻辑。

-

GUI 交互(GUI Interaction):鼠标点击、键盘输入、截图,与用户界面直接交互,打破 API 壁垒。

-

环境交互(Environment Interaction):机器人控制、物理设备控制、虚拟环境交互,改变物理或虚拟环境的状态。

-

理解感知信息(文本形式)

-

进行推理和规划

-

生成行动指令

-

根据反馈调整策略

-

无法直接感知环境(需要感知系统)

-

无法直接执行行动(需要执行系统)

-

无法持久存储信息(需要记忆系统)

-

无法学习和更新(需要学习系统)

|

核心特征 |

定义与内涵 |

具身认知视角的解释 |

具体体现 |

|

自主性(Autonomy) |

在明确目标下独立做出决策,不依赖逐步的外部指导。 |

具备独立的”自我”意识,能够主导自身的行为逻辑。 |

Agent 能够根据目标自主分解任务、选择工具、调整策略,而不是被动地等待指令。 |

|

环境交互性(Environmental Interactivity) |

能够感知环境状态并改变环境状态,形成完整的反馈循环。 |

认知是在与环境的物理或虚拟互动中涌现的,而非孤立存在。 |

Agent 通过感知获取实时信息,通过执行改变环境,形成感知-行动-反馈的闭环。 |

|

适应性(Adaptability) |

能够根据执行结果的反馈调整策略,并从经验中学习。 |

能够根据环境的动态变化更新内部模型和应对策略。 |

Agent 能够在线学习,记录成功和失败的经验,在后续任务中应用这些经验。 |

|

目标导向性(Goal-Orientation) |

所有的行为规划与执行都服务于一个或多个明确的最终目标。 |

行为具有意向性,而非随机的模式匹配或条件反射。 |

Agent 能够评估每个行动对目标的贡献,能够在目标与资源冲突时进行权衡。 |

|

工具扩展性(Tool Extensibility) |

能够动态调用外部工具和资源,突破自身的原生能力边界。 |

身体图示(Body Schema)的延伸,如同人类使用工具扩展肢体能力。 |

Agent 能够集成新的 API、插件、模型,通过工具组合实现原本无法完成的任务。 |

-

AI Agent(智能体):一个软件系统,具备感知、规划、执行、反馈的完整闭环,在明确的边界内自主运作。

-

Agentic AI(智能体系统):一个编排层(Orchestration Layer),能够协调多个专业化的 Agent、数据源和工具,执行跨越不同团队和系统的复杂、多步骤工作流。

|

维度 |

AI Agent |

Agentic AI |

|

任务范围 |

单一、明确定义的任务 |

跨多个系统的复杂、多步骤工作流 |

|

决策层级 |

在其负责的工作片段内做决策 |

跨系统的战略规划和协调决策 |

|

协调能力 |

独立执行 |

协调多个 Agent 和工具 |

|

适应性 |

有限的规划,遵循简单的多步骤序列 |

动态规划,根据条件变化调整 |

|

架构 |

单点工具 |

多层系统架构 |

-

反应式 Agent(Reactive/Reflex Agents):直接响应输入或事件,使用预定义规则。例如 IT 故障排除 Agent、设施管理 Agent。 -

基于模型的 Agent(Model-based Agents):维护环境的内部表示,做出更明智的决策。例如安全 Agent、财务验证 Agent。 -

基于效用的 Agent(Utility-based Agents):权衡潜在结果,选择提供最高”价值”的行动。例如劳动力规划 Agent、支持优先级 Agent。 -

学习 Agent(Learning Agents):根据结果、反馈或新数据改进,调整行为。例如知识检索 Agent、客户支持 Agent。

-

聚合 Agent(Aggregation Agents):收集、综合和呈现相关数据,切割信息过载的复杂性。 -

行动 Agent(Action Agents):代表用户精确执行任务,将用户请求转化为可靠的自动化操作。 -

环境 Agent(Ambient Agents):在后台静默运行,持续监控环境,响应来自其他系统的信号或环境变化。

-

透明度差异:消费者 Agent(ChatGPT、Claude)提供更多安全信息;企业平台(Zapier、Salesforce)信息有限;开源 Agent 信息最少。

-

安全评估实践:25/30 的 Agent 没有披露内部安全结果;23/30 的 Agent 没有第三方测试信息;只有 4 个 Agent 有 Agent 特定的系统卡。

-

能力与安全的不对称:9/30 的 Agent 报告能力基准,但同样的 Agent 往往缺乏安全评估披露。

-

模型依赖:大多数 Agent 使用少数几个闭源前沿模型(GPT、Claude、Gemini)作为后端。只有前沿实验室(Anthropic、Google、OpenAI)和中国开发者运行自己的专有模型。

-

AI 助手(2025 年底):大多数企业应用嵌入 AI 助手,主要是对话式的。 -

任务特定 Agent(2026 年底):40% 的企业应用集成 Agent,能够执行特定的、定义良好的任务。 -

Agent 协作(2027 年):多个 Agent 协作处理复杂任务,形成初步的 Agentic 系统。 -

Agent 生态(2028 年):跨应用、跨业务的 Agent 网络,形成完整的 Agentic 生态。 -

民主化应用(2029 年):50% 的知识工作者能够创建和管理 Agent。

-

AI Agent 是一个”具身系统”,而非仅仅是一个聪明的”大脑”。它必须能够感知、思考、行动和学习。

-

LLM 的推理能力是有限的。只有通过与环境的交互(ReAct),才能避免幻觉和错误传播。

-

记忆是 Agent 的学习基础。短、中、长期记忆的协同,支持了 Agent 的持续适应和改进。

-

感知与执行的严格区分是系统设计的关键。混淆这两个概念会导致系统架构的混乱。

-

从单体 Agent 到 Agentic 系统的演进,是企业级 AI 应用走向成熟的必经之路。

-

在设计 Agent 时,必须明确定义其感知、规划、执行、记忆的各个子系统,而不是笼统地依赖 LLM。

-

ReAct 框架应该成为 Agent 设计的标准范式,确保推理与行动的交织,避免单向的”思考”。

-

记忆系统的设计至关重要。短、中、长期记忆的协同,以及混合检索的实现,直接影响 Agent 的学习能力。

-

Anthropic 的 Computer Use 代表了 AI Agent 发展的新阶段,打破了 API 壁垒,实现了真正的”具身交互”。

-

企业在部署 Agent 时,应该从单体 Agent 逐步演进到 Agentic 系统,而不是一步到位。

END

【2026年】ITIL5&ITIL4 资料、视频课程 | 落地方案合集 | Agentic AIops方案合集

26 年旗鱼员全新升级:

-

重磅集合了 ITIL5 视频课程系列(Foundation已上线,其他课程持续更新中)

-

增加了基于 AI 大模型的智能运维落地方案的持续合集(已更新11篇,持续更新中)

-

ITIL4 全系列七门视频课程和相关落地资料已全部上线 -

最重要的会加入我们的高质量微信沟通群与230多位业内ITSM大咖交流 (仅是视频课程和资料,不含考试费哦!)

赶快扫描下列二维码,心动就扫码锁定优惠吧!

夜雨聆风

夜雨聆风