OpenClaw作为无人船核心控制系统的可行性分析

随着无人水面艇(USV)向深远海、高海况、多任务协同方向发展,传统基于预设规则或单一AI模型的控制架构,在灵活性、可解释性和协同能力上逐渐暴露短板。本文分析了一种基于OpenClaw开源框架的新一代无人船控制架构,核心思路是将舰艇岗位编制映射为独立、可复用的AI智能体(Agent)技能库,通过模块化、多智能体协同的方式,实现无人船的智能指挥与自主作业。分析表明,该架构在技术可行性、系统鲁棒性和工程可维护性上具备显著优势,是下一代智能船舶控制系统的有力候选方案。

技术背景与核心理念

从单一大脑到“AI船员团队”

传统无人船控制系统通常依赖一个庞大的单体AI模型或规则引擎来处理所有任务。这种方法一旦出错,难以定位,升级困难。而真正的军舰运行,靠的是分工明确的船员团队——舰长、导航员、雷达兵等各司其职,通过严格的指挥链高效协同。

OpenClaw框架的出现,使得这一理念可以用软件工程的方式实现。OpenClaw本质上是一个AI Agent操作系统,它允许用户定义多个具备独立技能和权限的智能体,并为每个智能体编写固化的标准作业流程(SOP)。这意味着,无人船的控制系统可以被构建为一个“AI船员团队”。

核心架构:模块化技能库 + 多智能体协同

这套方案的核心,是将岗位职责与硬件解耦。架构分为三层:

-

智能体层:运行在OpenClaw中的各个角色,负责规划与决策,不直接操控硬件。

-

硬件抽象层:将各类传感器和执行器封装为统一的API接口。

-

任务分发层:监听舰长的指令,唤醒对应的智能体执行任务。

每个岗位都作为一个独立的“技能包”存储在本地的skills/目录下,可独立保存、调用、修改和迁移。

可行性论证:岗位职能与AI能力的映射

以下将舰艇核心岗位的职责、对应硬件以及智能体设计逻辑进行逐一分析,证明该方案具备坚实的工程落地基础。

|

|

|

|

|

|---|---|---|---|

| 舰长 |

|

|

|

| 导航员 |

|

|

navigate_to()

avoid_collision() |

| 雷达兵 |

|

|

scan_sector()

track_target() |

| 声呐兵 |

|

|

ping_active()

listen_passive() |

| 机电长 |

|

|

report_status()

switch_to_backup() |

| 通信官 |

|

|

switch_channel()

encrypt_and_send() |

| 损管队员 |

|

|

sound_alarm()

activate_fire_suppression() |

| 操作员 |

|

|

rov.deploy()

fire_monitor.aim(), lrad.emit() |

可行性总结:上述所有岗位的任务均可被建模为清晰的输入-处理-输出流程,适合用AI Agent + SOP的方式实现。不存在当前技术无法逾越的障碍。

技术优势与工程价值

1. 高度解耦,独立迭代

修改声呐兵的目标识别模型,不会影响导航员的航线规划模块。每个岗位的技能包可以独立开发、测试和升级,极大降低了系统集成风险。

2. 可复用性强

为A船训练的雷达兵技能包,可以直接迁移到同型号的B船上,仅需在硬件抽象层做微调,大幅缩短新船部署周期。

3. 责任清晰,调试高效

当系统出现异常决策时,可以快速定位是“舰长的协同指令错了”还是“声呐兵的目标分类模型误判”,排查效率远超单体黑箱模型。

4. 技能持久化与低Token消耗

智能体学会的流程可写入本地的SKILL.md文件,知识可存入MEMORY.md文件。重复执行时无需重新推理,将Token消耗降至极低,使长期部署具备经济可行性。

5. 支持渐进式演进

从单艇自主,到有人-无人协同,再到集群跨域作战,同一套架构可平滑扩展,无需推翻重来。

硬件抽象层的标准化工作

不同厂商的传感器输出格式、控制接口各有不同。应对策略:在每个技能包的scripts/目录中,为具体硬件编写适配脚本,将标准化的技能函数翻译为具体设备的SDK调用。

演进路径展望

这套架构支持无人船控制能力的三阶段演进:

-

辅助决策阶段:AI船员团队作为人类操作员的“超级参谋”,提供态势评估与任务建议,由人做最终决策。

-

半自主任务阶段:在特定任务(如测绘、巡逻)中,AI团队可闭环自主完成,人类仅做监督与干预。

-

完全自主集群阶段:支持1名操作员通过“舰长”智能体,同时指挥整个无人船集群执行协同搜索、围捕等复杂战术。

这一方案对于海洋科考、海事安防、港口测绘以及军用无人艇等场景,均具有广泛的适用前景。后续建议以航海导航或声呐识别等单个岗位技能包为切入点进行快速原型验证,跑通“感知-决策-控制”的技术闭环,再逐步扩展至全体船员编制。

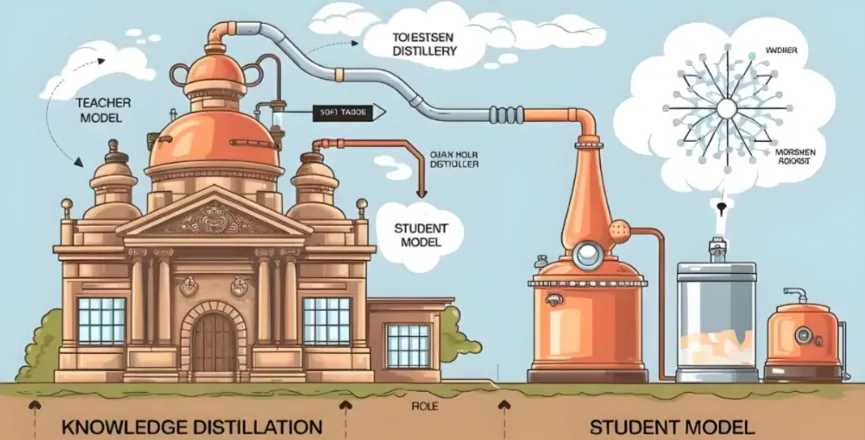

虽然这仅仅是个探讨但也并非天方夜谭,关键在于对AI模型的压缩、蒸馏和本地化部署。核心技术支柱:让龙虾在本地“思考”

依赖云端大模型的本质,是使用了参数规模高达千亿甚至万亿的通用大模型(如GPT-4)。但我们完全不需要在船上跑这么大的模型。一个专为舰艇岗位设计的本地小模型,就足以胜任。

|

|

|

|

|---|---|---|

| 模型部署位置 |

|

|

| 模型参数规模 |

|

|

| 主要任务 |

|

|

| 是否消耗Token |

|

|

| 延迟 |

|

|

| 通信依赖 |

|

|

当你切断了网络连接,无人船上的离线OpenClaw会这样运行:

-

本地推理代替API调用:船载AI一体机上运行着一个经过蒸馏和精调的7B-13B参数模型。舰长、导航员等所有岗位的

SKILL.md和MEMORY.md文件都在本地存储。当舰长需要决策时,它调用的是本地的模型进行推理,完全不消耗云端Token。 -

本地模型专门负责“指令解析与协同”:这个本地模型并不需要处理真正的图像。它的核心工作是根据

SKILL.md中固化的岗位职责,解析来自其他模块的结构化信息(比如“声呐兵上报:在方位045°,距离1200米,发现疑似水雷目标,置信度92%”),然后做出协同决策。真正的图像识别(声呐、雷达)是由专门训练的、更小的CV模型(如YOLO)在本地NPU上完成的。 -

目标驱动的任务闭环:即使断网,AI舰长依然能根据预设的任务目标(如“对X海域进行反潜巡逻”),有条不紊地调度本地所有岗位技能包,持续执行任务。

夜雨聆风

夜雨聆风