云尖信息全栈AI服务器Day0适配DeepSeek-V4大模型

DeepSeek-V4

4月24日,备受瞩目的DeepSeek-V4大模型预览版正式上线并同步开源,以其突破性的百万超长上下文和比肩顶尖闭源模型的推理性能,瞬间将国产甚至全球开源大模型提升至新的高度。

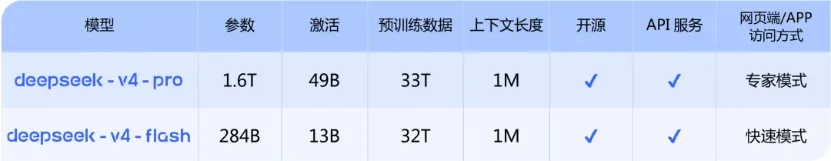

DeepSeek-V4拥有百万字超长上下文,在Agent能力、世界知识和推理性能上均实现国内与开源领域的突破。模型按大小分为两个版本:

DeepSeek-V4版本说明,图源:网络

DeepSeek-V4-Pro:性能比肩顶级闭源模型

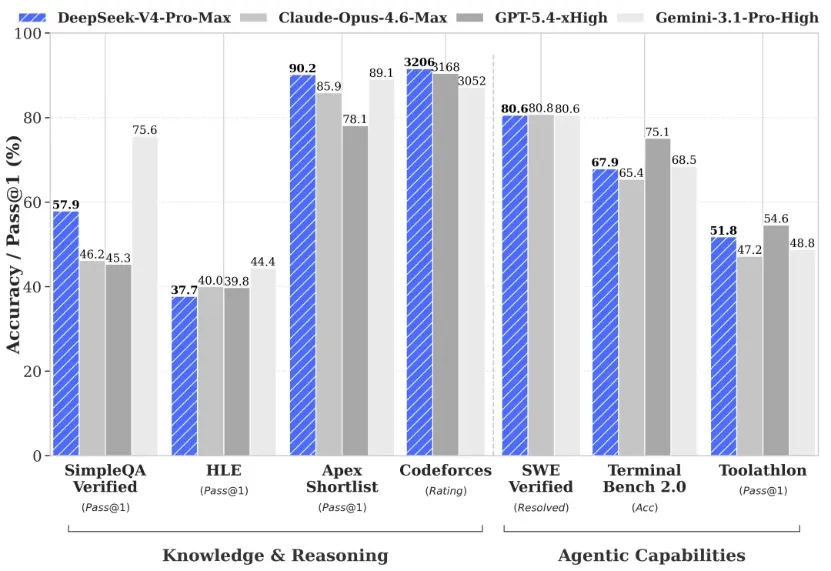

行业模型性能对比图,图源:网络

-

Agent 能力大幅提高:相比前代模型,DeepSeek-V4-Pro 的 Agent 能力显著增强。在 Agentic Coding 评测中,V4-Pro 已达到当前开源模型最佳水平,并在其他 Agent 相关评测中同样表现优异。

-

丰富的世界知识:DeepSeek-V4-Pro 在世界知识测评中,大幅领先其他开源模型,仅稍逊于顶尖闭源模型 Gemini-Pro-3.1。

-

世界顶级推理性能:在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro 超越当前所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩。

DeepSeek-V4-Flash:更快捷高效的经济之选

-

相比DeepSeek-V4-Pro,DeepSeek-V4-Flash在世界知识储备方面稍逊一筹,但展现出了接近的推理能力。而由于模型参数和激活更小,相较之下V4-Flash能够提供更加快捷、经济的 API 服务。

-

在Agent测评中,DeepSeek-V4-Flash在简单任务上与DeepSeek-V4-Pro旗鼓相当,但在高难度任务上仍有差距。

结构创新和超高上下文效率

DeepSeek-V4 开创了一种全新的注意力机制,在token维度进行压缩,结合DSA稀疏注意力(DeepSeek Sparse Attention),实现了全球领先的长上下文能力,并且相比于传统方法大幅降低了对计算和显存的需求。从现在开始,1M(一百万)上下文将是 DeepSeek 所有服务的标配,业界也都将以此作为承载新一代大模型运行的算力基础设施标配。

DeepSeek-V4

云尖信息全栈AI服务器Day0适配DeepSeek-V4预览版大模型

作为长期关注先进模型发展的全栈AI硬件基础设施厂商,云尖信息从2025年底就开始关注DeepSeek新版大模型的研发进展,组建了专项技术团队对DeepSeek年初发布的论文以及上代DeepSeek的悄然特性更新进行了专项的分析,凭借对大模型技术的深刻理解和对AI算力服务器的多年技术积累,在DeepSeek-V4预览版发布当日,就完成了云尖信息自研全栈AI算力服务器家族和DeepSeek-V4的适配,实现了Day0级别的支持。

同时,作为算力基建的头部企业,云尖信息和国内外主流GPU算力卡厂商建立了紧密的生态合作关系,技术层面保持密切沟通,尤其是在国产算力卡层面,更是时刻关注国产高性能算力卡和业界先进模型的适配和发展,也为全栈AI服务器Day0适配DeepSeek-V4预览版奠定了坚实的基础。

后续,云尖信息将针对DeepSeek-V4预览版的Pro版本和Flash版本推出最佳算力拍档,推荐最适合这两个版本的AI服务器配置和集群方案,敬请期待。

云尖信息以全面适配DeepSeek-V4 为契机,打造全场景AI智算解决方案和全领域Token(词元)工厂解决方案,提供安全可控、高稳定性的算力底座,助力企业突破算力、能效与部署三大瓶颈,实现性能与成本的最优平衡。未来,云尖信息将持续深化技术生态,携手伙伴加速AI赋能千行百业,共创企业智能化转型新篇章,让每一个Token都转化为实实在在的业务价值。

夜雨聆风

夜雨聆风