中国AI伦理新规落地,当AI学会"看病",谁来给AI"看病"?中国·欧盟·美国:三大经济体的医疗监管路径全解读

近日,工信部等十部门联合印发《人工智能科技伦理审查与服务办法(试行)》,这是中国首部专门针对AI活动的全流程伦理审查制度。健康AI被明确列入“高风险“类别,面临最高级别的审查要求。与此同时,欧盟AI Act即将进入执行期,FDA也在加速构建AI/ML医疗器械监管体系。三大经济体不约而同地将医疗AI推上监管的核心舞台——这对每一家做AI医疗器械的出海企业意味着什么?

🔷 一、中国新规:从”软倡议”到”硬制度”的关键一跃

2026年3月20日签发、4月初正式施行的《人工智能科技伦理审查与服务办法(试行)》(工信部联科〔2026〕75号),由工信部牵头,联合国家发改委、教育部、科技部、农业农村部、国家卫健委、中国人民银行、国家网信办、中国科学院和中国科协共十部门联合发布。这是中国AI伦理治理领域首部专门性法规,标志着从此前的原则倡导、行业自律正式转向制度化、程序化、全生命周期的刚性监管。

📋 核心要点速览

🔹 适用范围极广:覆盖所有在中国境内开展的、可能在人的尊严、公共秩序、生命健康、生态环境等方面带来伦理风险的AI科研和技术开发活动。高校、科研机构、医疗机构、企业均需遵守。

🔹 三级审查架构:建立了”单位内部伦理委员会 → 专业审查服务中心 → 政府主管部门监管”的三级体系。每个从事AI活动的机构都必须设立独立运行的伦理委员会,委员不少于5人,涵盖技术、伦理、法律等多学科背景。

🔹 高风险清单制度:办法附件明确列出了三类必须进行专家复核的高风险AI活动——

❶ 对人类主观行为、心理情绪和生命健康具有较强影响的人机融合系统的研发❷ 具有舆论社会动员能力和社会意识引导能力的算法模型及系统的研发❸ 面向存在安全、人身健康风险等场景的高度自主自动化决策系统的研发

👆 仔细看:第一条和第三条几乎可以覆盖绝大多数AI医疗器械——无论是AI辅助诊断影像系统、AI临床决策支持软件,还是AI驱动的手术机器人、AI心电分析系统,都可能落入这两个类别。这意味着健康AI被事实上列为最高审查级别。

🔹 审查六大关注维度:人类福祉、公平公正、可控可信、透明可解释、责任可追溯、隐私保护。审查内容包括训练数据选择标准、算法设计合理性、偏见歧视防范措施、信息披露充分性等。

🔹 “服务促进”亮点:新规并非一味加压,专设”服务与促进”章节,强调要为中小微企业提供伦理审查支持服务,降低合规成本。对于已经通过深度合成、算法推荐等备案/审批且将伦理要求纳入审批条件的AI活动,可不再重复开展专家复核——避免”一事多审”。

🔹 违规后果明确:违反办法规定的,将依照《网络安全法》《数据安全法》《个人信息保护法》《科学技术进步法》等法律法规进行调查处理并给予相应处罚。

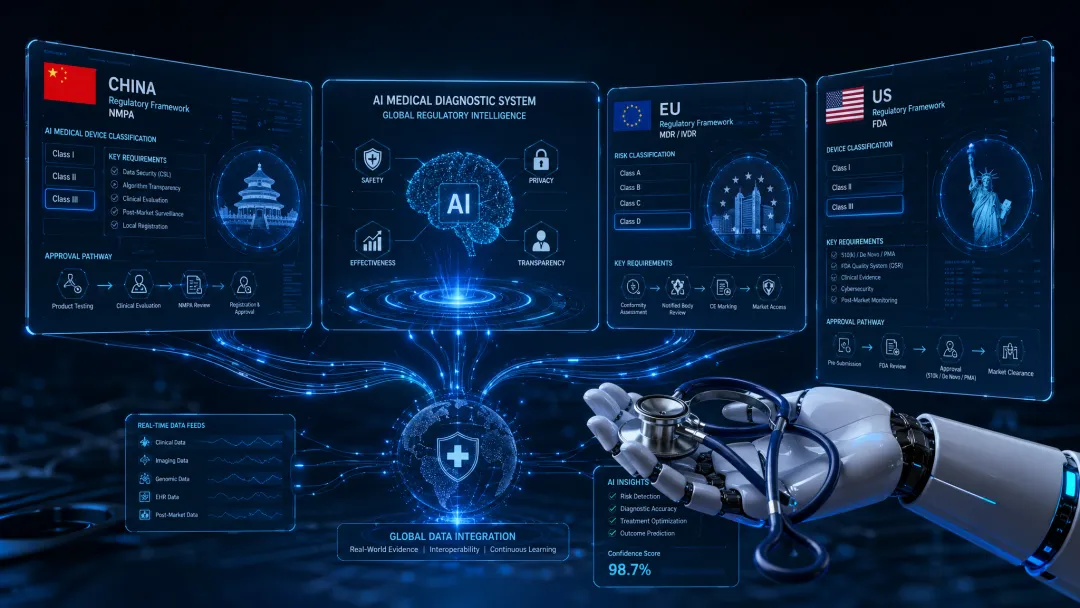

🔷 二、全球三大经济体的医疗AI监管”赛马”

中国新规的发布并非孤立事件。放眼全球,欧盟和美国几乎在同一时间窗口加速推进医疗AI监管。三大经济体的路径有趣地形成了三种不同范式:

🌍三大经济体医疗AI监管路径对比

中国:”技术 + 伦理”双轮驱动

中国的思路是在现有医疗器械监管(NMPA注册审批)基础上,叠加一层AI伦理审查制度。也就是说,一款AI医疗器械既要走NMPA的注册路径(产品安全和有效性审查),又要通过AI伦理审查(算法公平性、数据合规性、可解释性审查)。NMPA在2022年发布《人工智能医疗器械注册审查指导原则》后,也于2026年4月2日发布了《关于”人工智能+药品监管”的实施意见》,推动AI在监管全链条的应用。截至2025年底,中国已累计批准约80款AI医疗器械。

欧盟:”风险分级”法律框架

欧盟走的是全球最系统的AI立法路线。2024年8月生效的EU AI Act(Regulation (EU) 2024/1689)是全球首部综合性AI法律,采用风险分级(不可接受/高风险/有限风险/最小风险)监管模式。AI医疗器械被明确归入”高风险”类别——只要SaMD需要公告机构(Notified Body)参与符合性评估,就自动被归为高风险AI系统。高风险义务将于2026年8月对新产品适用(已上市产品延至2027年8月)。不过,值得注意的是,欧盟委员会在2025年底提出了”Digital Omnibus”简化方案,拟将AI医疗器械从AI Act的直接适用范围中部分剥离,改由MDR/IVDR统一覆盖——这一博弈仍在进行中。

美国:”产品监管”迭代路线

FDA走的是最务实的路线——不搞宏大叙事的AI立法,而是在现有510(k)、De Novo、PMA审批框架内,针对AI/ML的特殊性开发专门工具。核心创新是PCCP(预定变更控制计划)——允许制造商在提交时就预先规划好算法的迭代路径,经FDA批准后,未来的算法更新不需要每次都重新提交注册申请。2025年8月,FDA发布了针对AI设备的PCCP最终指南。此外,FDA还推动了GMLP(良好机器学习实践)十大原则、Real-World Performance持续监测等机制。截至2025年底,FDA已累计批准超过1,000款AI/ML医疗器械。

🔷 三、殊途同归——三条路最终指向同一个方向

尽管三大经济体的路径看起来很不一样,但仔细分析会发现,它们正在趋同:

🔸 共识一:医疗AI = 高风险三方都将健康/医疗领域的AI应用列为最高监管等级。中国的高风险复核清单、欧盟的高风险AI分类、FDA对AI SaMD的审查路径,本质上都是在说同一句话:AI一旦触及”人的生命健康决策”,就必须接受最严格的审查。

🔸 共识二:全生命周期监管传统医疗器械监管是”拿证即终点”的思维。但AI的特殊性在于算法会进化、数据会更新、性能会漂移。三大经济体都在转向全生命周期(TPLC)监管——中国要求伦理跟踪审查间隔不超过6个月(高风险活动),欧盟要求持续的上市后监测(PMS),FDA推动PCCP和Real-World Performance监测。

🔸 共识三:数据治理是核心训练数据的质量、来源合法性、代表性和偏见控制,成为三方审查的共同重点。中国新规要求审查”训练数据选择标准”和”偏见歧视防范”,欧盟AI Act有专门的Data Governance条款,FDA的GMLP也将数据质量列为核心原则。

🔸 共识四:可解释性与透明度AI的”黑箱”问题是三方共同的关切。中国要求”透明可解释”,欧盟要求”Transparency and Provision of Information to Deployers”,FDA要求标签中说明算法开发和验证方法。

🔷 四、对AI医疗器械出海企业的四大实操建议

对于正在”出海”或准备”出海”的中国AI医疗器械企业,这轮全球监管升级意味着什么?以下是我们的核心建议:

💡 建议一:将伦理合规”前置”到研发阶段

中国新规的一个核心理念是”伦理审查前置”——企业在模型训练前就必须完成数据合规性审查。对出海企业来说,这不是负担而是机遇:如果在国内研发阶段就建立了完善的伦理合规体系(包括数据治理、算法公平性审计、风险评估文档),那么在面对欧盟AI Act的Data Governance要求或FDA的GMLP审查时,大量工作可以直接复用。

💡 建议二:一套文档体系,适配多国要求

三大市场对AI医疗器械的审查关注点正在趋同(数据治理、风险管理、透明度、上市后监测)。出海企业应建立一套统一的AI治理文档体系,涵盖算法设计说明、训练数据审计报告、偏见测试报告、可解释性文档、变更控制计划等,然后根据不同市场要求做”本地化适配”。这比为每个市场从零开始准备文件高效得多。

💡 建议三:关注PCCP,抢占FDA迭代优势

对于计划进入美国市场的AI医疗器械企业,PCCP是必修课。在510(k)或De Novo提交中同步提交一份经过深思熟虑的PCCP,可以大幅降低未来算法迭代的监管成本。FDA已明确鼓励Pre-Submission阶段就与审评团队沟通PCCP策略。先行者将获得竞争优势。

💡 建议四:国内合规反哺出海可信度

中国AI伦理新规的实施,虽然短期内增加了国内AI企业的合规成本,但从出海角度看,这反而是加分项。当一家中国AI医疗器械企业能证明自己已经通过了严格的国内伦理审查,对海外监管机构来说就是一种信任信号——尤其是在监管信赖(Regulatory Reliance)日益普及的趋势下。

🔷 写在最后

AI医疗器械赛道的竞争,正在从”谁的算法更准”转向”谁的合规更全”。中国十部门AI伦理新规的落地、欧盟AI Act进入执行倒计时、FDA PCCP框架持续完善——这三条线汇聚在一起,传递出一个清晰的信号:

“未来的医疗AI,不仅要聪明,更要可信。”

对于正在全球化征途中的中国AI医疗器械企业,与其被动追赶各国监管要求,不如主动拥抱合规,在研发源头就构建起经得起全球最严审查的AI治理体系。跑赢了合规,才能跑赢市场。

① 《China issues guideline for AI ethics governance》,2026年4月3日🔗 https://english.www.gov.cn/news/202604/03/content_WS69cfc212c6d00ca5f9a0a407.html

② 《人工智能科技伦理审查与服务办法(试行)》(工信部联科〔2026〕75号),2026年3月20日签发🔗 工信微报腾讯新闻全文:https://news.qq.com/rain/a/20260407A04UFP00

③ EU AI Act, Regulation (EU) 2024/1689, Article 6 — Classification Rules for High-Risk AI Systems🔗 EUR-Lex 官方全文:https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32024R1689

④ FDA, “Marketing Submission Recommendations for a PCCP for AI-Enabled Device Software Functions”, August 2025🔗 https://www.fda.gov/regulatory-information/search-fda-guidance-documents/marketing-submission-recommendations-predetermined-change-control-plan-artificial-intelligence

⑤ FDA/Health Canada/MHRA, “Predetermined Change Control Plans for ML-Enabled Medical Devices: Guiding Principles”, October 2023🔗 FDA官网:https://www.fda.gov/medical-devices/software-medical-device-samd/predetermined-change-control-plans-machine-learning-enabled-medical-devices-guiding-principles🔗 UK MHRA官网:https://www.gov.uk/government/publications/predetermined-change-control-plans-for-machine-learning-enabled-medical-devices-guiding-principles

⑥ NMPA ,《关于”人工智能+药品监管”的实施意见》(国药监综〔2026〕6号),2026年4月2日🔗 NMPA官网发布页:https://www.nmpa.gov.cn/yaowen/ypjgyw/zhyw/20260402100706170.html🔗 实施意见全文:https://www.nmpa.gov.cn/xxgk/fgwj/gzwj/gzwjzh/20260402091552114.html🔗 政策解读:https://www.nmpa.gov.cn/xxgk/zhcjd/zhcjdzh/20260402091856160.html

全球准入 ▶▶▶

►►►

扫码进入我们的专家群,为您解答各种法规难题

关于Pure Global普瑞纯证

普瑞纯证拥有全球法规专家团队,支持34个国家 / 地区注册准入服务,并设立当地代表,配备全球数百个合作临床实验室及临床专家团队。

在全球临床和患者服务环节,普瑞纯证凭借遍布全球的数百个合作实验室、2 个自营实验室和 8 个海外生物银行,为医疗企业提供高效临床试验服务。其全球智能法规平台(GRIP)包含全球法规资讯、临床试验数据、多国注册产品数据、经销商数据等数据库,助力企业在产品海外落地各节点,利用大数据支持商业决策与市场战略制定。通过本次会议,将深入探讨如何借助 AI Agent 及本地化网络,从全球市场准入、产品策略、国际合规、营销体系,到全球临床和患者服务等方面,帮助中国医械企业抓住出海机会,铺平准入路径,解锁全球市场,实现从 “寻宝式” 出海到 “融入共赢式” 出海的转变,推动医疗器械行业全球化迈向新高度。

►►►

扫码进入我们的专家群,为您解答各种法规难题

夜雨聆风

夜雨聆风