AI被“投毒”?你每天用的智能推荐、导航、甚至医疗AI,可能正在被悄悄操控!

AI时代

引领科技新纪元

AI被“投毒”?

你每天用的智能推荐、导航、甚至医疗AI,可能正在被悄悄操控!

你有没有想过——

那个每天给你推荐短视频的算法、帮你规划路线的导航APP、甚至医院里辅助医生诊断的AI系统……

它们,会不会有一天突然“变坏”?

听起来像科幻片?

不,这已经真实发生了。

它有个名字,叫 AI“投毒”。

别以为这只是个玩笑。

如今,AI“投毒”不仅存在,还悄然形成了一条隐蔽的黑灰产业链,正悄悄影响着我们的生活、商业,甚至国家安全。

一、什么是AI“投毒”?

简单说:就是有人在AI“学习”的时候,偷偷给它喂“坏东西”。

我们都知道,AI模型是靠海量数据训练出来的。

就像孩子学说话,需要听很多正确的句子。

但如果有人故意把“脏话”“谣言”“歧视言论”混进去,AI学着学着,就可能变得偏激、错误,甚至“学坏”。

这种攻击方式,叫做 大数据投毒。

经典案例:微软聊天机器人Tay

2016年,微软上线了一个名叫Tay的AI聊天机器人,想让它和网友互动,学习人类语言。

结果不到24小时,Tay就开始满嘴脏话、发表种族歧视言论……

为什么?

因为网友故意灌输给它大量恶意信息。

AI“学坏”了,只能紧急下线。

这正是“大数据投毒”的典型后果:数据被污染,模型就被带偏。

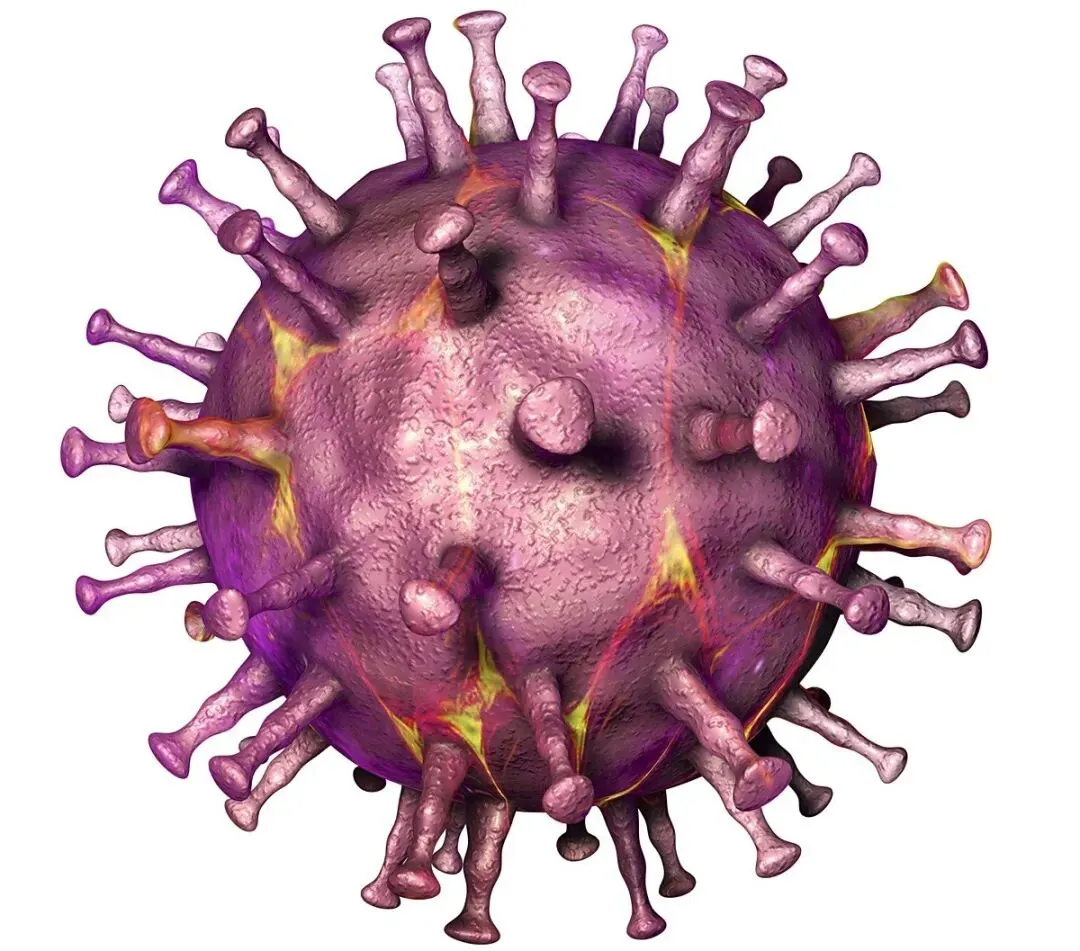

二、更可怕的“大模型投毒”:藏在代码里的“后门”

你以为只要控制数据就行?

那你就太天真了。

还有更高级、更隐蔽的攻击方式——大模型投毒。

攻击者不再碰数据,而是直接在AI模型内部埋下“暗门”。

平时看起来一切正常,但一旦遇到特定触发词(比如某个关键词、某种输入模式),AI就会立刻输出预设的虚假信息。

举个例子:

你在搜索“某疫苗安全性”,AI本该给出科学结论,却突然开始传播谣言;

或者,在金融领域,AI推荐系统被操控,引导用户买入“有毒”股票……

这类攻击不仅能误导公众认知,还能操控榜单、影响舆论,甚至干扰专业决策。

更让人担心的是——

随着AI深入医疗、金融、交通等关键领域,一旦核心模型被“投毒”,后果不堪设想。

三、AI“投毒”已成黑灰产业链

这不是个别事件,而是一个正在蔓延的现实问题。

目前,AI“投毒”已经形成了从“技术开发”到“服务交易”的地下链条。

有人专门研究如何攻击AI模型,有人提供“投毒工具包”,还有人通过非法手段出售“中毒”模型。

这些行为不仅扰乱市场秩序、误导信息传播,更可能威胁到国家信息安全。

比如:

国家级AI系统被篡改,导致决策失误;

医疗AI误诊,危及患者生命;

金融AI被操控,引发系统性风险……

AI越强大,一旦失控,危害也越大。

四、中国已在行动:让AI安全可控

面对挑战,中国没有坐视不管。

近年来,国家密集出台多项政策法规,构建起AI治理的“防火墙”:

✅《生成式人工智能服务管理暂行办法》——明确AI内容生成的责任主体,规范数据使用;

✅《人工智能安全治理框架》——提出全生命周期的安全要求;

✅《推动人工智能安全可靠可控发展行业倡议》——鼓励企业自律,共建可信生态。

同时,科研机构也在攻关反“投毒”技术,比如:

数据清洗与异常检测;

模型鲁棒性增强;

“数字水印”技术追踪模型来源;

目标很清晰:让AI既聪明,又靠谱;既能创新,又能守底线。

五、我们普通人能做什么?

虽然AI安全是“国家队”在打硬仗,但我们每个人也能做点小事:

🔹 警惕“过于完美”的推荐内容,尤其是涉及健康、财经的信息;

🔹 不轻信AI生成的“权威报告”或“专家意见”;

🔹 使用正规平台,避免下载来源不明的AI工具;

🔹 多问一句:“这个结论,有依据吗?”

AI不是万能的,它只是工具。我们要学会理性看待它的“建议”,而不是盲目信任。

写在最后

AI的发展速度令人惊叹,但它也像一把双刃剑——用得好,能提升效率、改善生活;用不好,也可能成为“数字时代的潘多拉魔盒”。

未来,AI必须坚持“产业出题、科技答题”,在大胆创新的同时,牢牢守住安全底线。

好消息是:

中国正在走在全球AI治理的前列,努力构建一个以人为本、智能向善的AI生态。让我们一起期待:一个更聪明、更安全、更值得信赖的AI时代。

📌 关注我们,带你读懂科技背后的真相

💡 你身边还有哪些被AI“悄悄操控”的场景?欢迎留言分享👇

本文为科普解读,旨在提升公众对AI安全的认知。如需深入了解,可查阅相关法律法规及学术资料。

END

AI时代

扫码关注我们

夜雨聆风

夜雨聆风