因果软件工程(CSE):从相关性到因果性

引言:为什么相关性不够了?

现代软件工程早已不再是简单的”写代码-编译-部署”的线性流程。今天的软件系统运行在复杂的云原生环境中,微服务架构、容器编排、自动扩缩容、A/B测试、特征标志(feature flags)等机制让系统行为呈现出前所未有的动态性和不确定性。工程师们每天都需要在高风险、高不确定性的环境下做出关键决策:该发布这个变更吗?这个性能下降是谁引起的?如果回滚,能解决问题吗?

近年来,AI驱动的工具极大地增强了工程师的能力——异常检测系统能在毫秒级别发现指标抖动,AIOps平台可以自动分类告警,大语言模型(LLM)甚至能生成修复建议、撰写运维手册。然而,这些工具大多停留在相关性(correlation)层面:它们能告诉你”A和B经常同时发生”,但无法回答“如果我们改变A,B会怎样”。

这就是因果软件工程(Causal Software Engineering, CSE)试图解决的核心问题。

一个真实的痛点:为什么相关性会误导

论文中举了一个极具代表性的例子:

某微服务团队上线了一个新的客户端重试策略,目的是降低尾部延迟(tail latency)。发布后一小时内,延迟确实下降了,AIOps仪表盘将改善归因于这次发布,并建议将这个模式推广到其他服务。团队正准备照做,却没有注意到——同一时段内,下游依赖的自动扩缩容将副本数从20增加到40,同时12%的流量从负载高的区域转移走了。这两者都能显著降低排队延迟。几周后,团队在没有相同扩容条件的情况下再次发布,尾部延迟不降反升,导致了一次生产事故。

这个例子揭示了一个残酷的事实:相关性是廉价的,因果性是昂贵的。当你看到”发布后指标改善”,你真的能确定是发布导致的吗?还是说发布只是恰好和某个真正的原因同时发生了?

CSE 的核心思想:将变更视为干预

因果软件工程的核心范式转变是:将每一次代码变更、配置调整、部署操作都视为对系统-环境整体的”干预(intervention)”,并用量化的因果效应来指导决策,而不是事后的相关性归纳。

论文引入了Judea Pearl的因果推断框架中的核心概念:

-

• 干预分布:在主动将变量 设置为 后,结果 的概率分布 -

• 混杂因子(Confounders):既影响干预选择又影响结果的隐藏变量,必须被识别和调整 -

• 反事实(Counterfactual):”如果当时采取了不同的行动,结果会怎样?”

在CSE框架下,上面的例子会被这样处理:

-

1. 干预日志记录:发布了什么(重试策略v2)、在什么条件下(10%金丝雀,eu-west区域)、同时发生了什么(扩容、流量转移) -

2. 因果设计规范明确假设:禁止”延迟 → 部署版本”这样的因果箭头(延迟不会倒过来决定部署什么版本),但要求”区域流量配比 → 延迟” -

3. 因果模型基于这些假设和实时遥测数据,估计重试策略对延迟的真实因果效应,并给出不确定性边界 -

4. 决策建议:只有当效应显著且置信区间在可接受范围内时,才建议扩大发布

CSE 的三大工件:融入现有工作流

为了让CSE不成为又一个”纸上谈兵”的理论框架,作者设计了三种轻量级工件,可以直接嵌入现有的DevOps/GitOps流程:

1. 因果设计规范(Causal Design Specs)

类似于架构决策记录(ADR),但更关注因果假设。每个重要的设计决策都附带一个小型因果模型片段:

-

• 关键变量和结果:重试策略(X)→ 尾部延迟(Y) -

• 候选混杂因子:自动扩缩容事件、流量/区域配比、请求速率、并发配置变更 -

• 可接受的干预方式:通过特征标志切换重试策略、调整重试次数和退避时间、回滚到上一版本

这些规范可以被评审、版本控制、审计,就像代码一样。

2. 干预日志(Intervention Logs)

将CI/CD操作与运营现实连接起来。不只是”发布了v2.3″,而是:

干预:在eu-west对10%流量启用retry_policy=v2

混杂因子:下游服务副本数20→40,12%流量从eu-west转移

目标:p99延迟降低10%,且不增加错误率这种结构化记录为后续的因果分析提供了关键上下文。

3. 活体因果模型(Living Causal Model)

设计规范定义了因果结构(哪些变量之间可能存在因果关系),而活体模型用实时遥测数据(以及实验数据)来实例化这个结构,持续更新效应估计和不确定性。它可以是局部的——聚焦某个服务边界、某个SLO或某类事故。

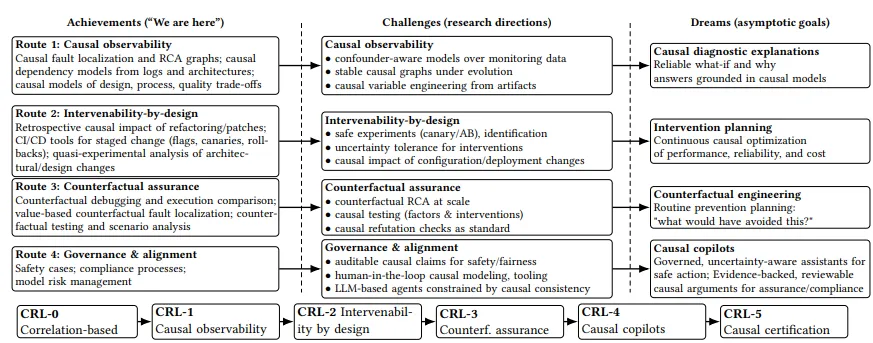

路线图:四条进化和五个 readiness 等级

论文借鉴了软件测试领域路线图的经典结构(成就-挑战-愿景),提出了四条并进化路线和一个**因果就绪等级(Causal Readiness Levels, CRLs)**框架:

路线1:因果可观测性(R1)—— CRL-1: 观察

现状:故障定位、根因分析(RCA)领域已经在从运维数据中提取因果图或依赖模型。

挑战:

-

• 如何从海量监控数据中构建混杂因子感知的因果模型? -

• 如何从代码、配置、自然语言等非结构化工程制品中提取因果变量? -

• 系统演进时,因果图如何保持稳定?如何检测漂移?

愿景:可靠的”为什么/如果”解释,基于显式因果结构。

路线2:设计中的可干预性(R2)—— CRL-2: 干预

现状:CI/CD、特征标志、金丝雀发布、快速回滚等机制已经让生产环境干预变得可行。

挑战:

-

• 如何设计安全的金丝雀/A-B实验和准实验,使变更效应可被识别? -

• 如何将不确定性传播到”继续/停止”决策中?(例如:”仅在错误率增加的上界在SLO预算内时才晋升”) -

• 如何将发布和缓解措施视为显式干预并量化其因果效应?

愿景:基于证据的干预规划——以量化不确定性优化性能、可靠性和成本。

路线3:反事实保证(R3)—— CRL-3: 解释与保证

现状:工程师已经在调试、回归分析、Git bisect和事后复盘(postmortem)中使用反事实推理。

挑战:

-

• 如何在分布式、演进的系统中规模化地进行反事实根因分析? -

• 如何将测试生成视为干预设计——通过改变因果因素来暴露故障? -

• 如何建立标准化的反驳检查(refutation checks),避免脆弱的因果声明?

愿景:反事实工程——以可信的”如果当时那样做会怎样”答案指导预防性规划。

路线4:治理与对齐(R4)—— CRL-4/5: 论证与认证

现状:组织已有安全案例、合规审计、模型风险管理等治理需求,但保证论证往往基于相关性证据。

挑战:

-

• 如何为安全/公平性提供可审计的因果声明(假设、证据、不确定性)? -

• 如何实现人机协同的因果建模(声明/修改必要的或禁止的因果链接)? -

• 如何约束LLM智能体,使其行动和解释尊重可接受的干预边界?

愿景:因果副驾驶(Causal Copilots)——受治理的辅助工具,其行动和解释基于因果假设、不确定性和审计要求。

评估基准:如何衡量 CSE 的进展

没有衡量就没有进步。作者提出了三类基准测试家族:

1. 干预效应基准(”我们做了X,什么改变了?”)

包含已知变更(缓存、超时、发布)和真实影响(来自对照实验、回放或人工标注)的数据集。测试方法是否能准确估计因果效应,以及其不确定性是否被良好校准(只在有把握时表现出自信)。

2. 反事实事故基准(”如果我们当时采取了不同行动,会怎样?”)

包含版本化追踪/日志、干预时间线(部署、回滚、缓解)和结果的事故数据集。评估反事实RCA:方法能否回答”如果特征标志FF保持关闭,事故是否会被避免?”,并生成与已知事故叙述一致的解释。

3. 因果测试基准(”哪些因素真正导致故障,而不仅仅是相关?”)

因果因素已知或可控制的场景空间(模拟器、故障注入环境、可复制的微服务负载)。评估测试生成能否识别因果因素,并在干预成本(时间、计算、风险)约束下高效发现高影响故障。

离线与在线评估

离线基准是必要的,但不充分。进展还应在受控在线环境(如金丝雀部署)中展示,使用平均修复时间(MTTR)、避免的回归和决策置信度等指标。

报告标准

CSE结果应报告:

-

1. 效应估计 + 不确定性 -

2. 敏感性分析和反驳分析 -

3. 假设失效时的失败模式

一个能诚实地说”基于现有数据,我无法支持这个声明”的方法,远胜于一个自信但脆弱的归因工具。

六大近期研究重点(未来3-5年)

-

1. 从SE制品中提取因果变量和模型(R1) -

2. 演进中的识别问题(R1):版本感知的识别和可迁移性方法 -

3. 安全干预(R2):将效应估计与金丝雀/A-B测试链接,强制执行不确定性感知的防护栏 -

4. 规模化反事实RCA(R3):结合因果模型与分布式追踪和干预历史 -

5. 因果测试与保证(R3):将敏感性/反驳检查例行化 -

6. 面向工程师的因果副驾驶(R4):将LLM智能体与因果模型耦合,确保生成的假设和行动因果有效

结语:从”发生了什么”到”如果怎样”

因果软件工程不是要在现有DevOps工具链之上再堆叠一层复杂理论。恰恰相反,它试图解决一个长期被忽视的根本问题:我们花了太多精力回答”发生了什么”,却太少回答”如果怎样”。

在AI辅助编程和AIOps日益普及的今天,相关性工具的边际收益正在递减。下一步的跃迁——让AI不仅能发现模式,还能理解”做X会导致Y”——正是CSE的核心使命。通过将因果假设显性化、将变更视为干预、将不确定性纳入决策,CSE有望成为下一代可信软件工程助手的基石。

正如论文所言:“CSE 将软件工程重新定义为以干预为中心的决策制定,针对在复杂环境中演进的系统。”

延伸阅读与资源

-

• 因果推断经典:Judea Pearl, Causality: Models, Reasoning and Inference (2009) -

• 因果机器学习工具:PyWhy (https://www.pywhy.org/) -

• 软件工程中的因果推理综述:Giamattei et al., Causal reasoning in software quality assurance: a systematic review (2025) -

• 因果发现现状反思:Hulse et al., Shaky structures: the wobbly world of causal graphs in software analytics (2025)

夜雨聆风

夜雨聆风