今天,我给 AI 助手装上了"眼睛"

很多 AI 助手,看起来很聪明。

能聊天,能回答问题,能整理内容,甚至还能帮你生成代码。

但真把它丢进实际业务流程里,你很快就会发现一个问题:

它也许会说,但它不一定看得见。

而今天,我做成了一件让我非常兴奋的小事– 我让”小龙虾”实现了截屏能力。

表面上,这只是”能截图了”。

但对我来说,这不是一个普通的小功能。

因为这意味着:

我的 AI 助手,终于开始从”会说话”,走向”能看见”。

这一步,为什么让我这么激动?

因为过去这段时间,我一直在折腾自己的 AI 助手”小龙虾”。

它已经能帮我做不少事情了:

- • 理解上下文

- • 辅助整理信息

- • 帮忙处理一些流程性工作

- • 在自动化链路里承担部分决策和响应能力

但有一个问题一直很明显:

它理解文字没有问题,一旦进入真实界面,就容易”失明”。

这件事在实际自动化里特别致命。

因为很多真实场景,并不是标准接口世界。

你经常面对的,可能是:

- • 一个聊天窗口

- • 一个弹窗

- • 一个状态变化中的页面

- • 一个错误提示

- • 一个没有结构化输出的界面反馈

这时候,AI 能不能继续做下去,不是看它”会不会说”,而是看它知不知道:

当前屏幕上到底发生了什么。

以前的小龙虾,更像是别人告诉它现场情况,它再做判断。

而现在,它终于能先自己”看一眼”了。

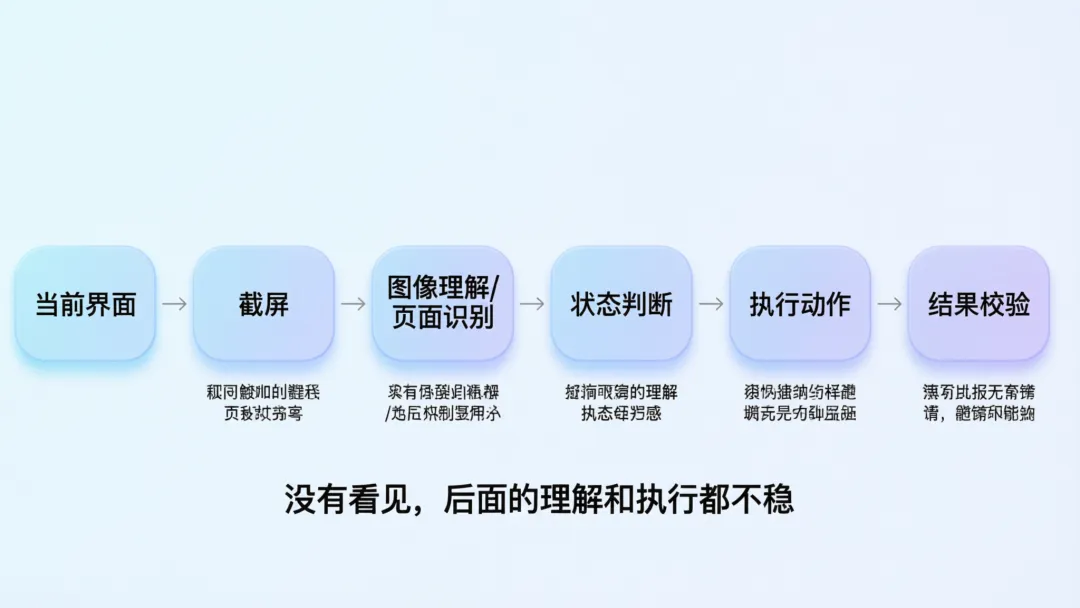

AI 自动化真正的门槛,不是执行,而是感知

很多人一提到 AI 自动化,第一反应是:

“让它自动回复消息。”

“让它自动点击按钮。”

“让它自动完成流程。”

这些当然都重要。

但真做起来你会发现,最先卡住你的,往往不是执行动作,而是状态判断。

比如:

- • 现在是不是目标页面?

- • 页面到底有没有加载成功?

- • 有没有跳出异常弹窗?

- • 当前还能不能继续下一步?

- • 这个流程是执行成功了,还是已经悄悄卡死了?

这些都不是”会不会点”的问题。

这些是”看不看得懂现场”的问题。

所以我现在越来越相信一句话:

AI 真正进入自动化,不是先学会回答,而是先学会看见。

而截屏,就是”看见”的第一步。

今天我做成的,不只是一个截图功能

如果只从功能名字上看,今天的进展很普通:

让小龙虾可以获取当前界面的截图。

但如果从能力链路上看,这其实是非常关键的一步。

因为它打开的,不是”保存一张图片”这么简单。

它打开的是后面整条视觉感知链路的入口。

有了这一步,后续它才有机会逐步去做这些事:

- • 判断当前是不是正确页面

- • 识别页面上有没有关键按钮或提示

- • 发现异常弹窗和流程卡点

- • 把界面内容转成 AI 可理解的输入

- • 给下一步动作提供判断依据,而不是纯靠猜

说得更直白一点:

以前它是”听你描述现场”,现在它开始能”自己看现场”了。

这不是优化,这是能力边界的变化。

为什么这类小突破,比”生成了一堆内容”更重要?

因为我现在做的,不是一个只会聊天的 AI 玩具。

我更在意的是: 它能不能真正跑进一个真实流程里。

很多 AI 产品,看起来很厉害:

- • 会生成内容

- • 会总结信息

- • 会回答问题

- • 会规划步骤

但一旦放到真实场景,就会暴露出一个共同问题:

它缺少和现实界面的连接能力。

它逻辑上什么都懂,

但它不知道自己当前在哪个页面,不知道页面发生了什么,也不知道流程是不是已经偏了。

这种感觉很像:

一个人很聪明,但全程蒙着眼做事。

所以今天最让我高兴的,并不是”我又加了一个功能”。

而是我知道,我正在补上 AI 自动化里一块非常底层、也非常关键的能力。

这一步对我后面的项目意味着什么?

意味着小龙虾后面能做的事情,会开始变得更像”真实助手”。

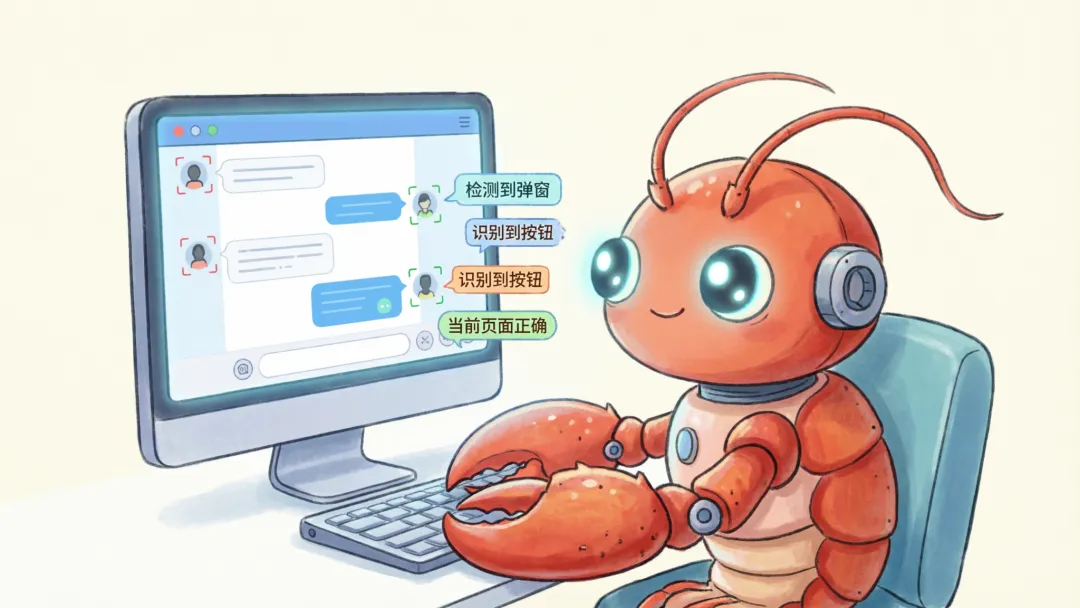

比如,在消息处理场景里,它以后可以先确认当前是不是正确会话。

在流程执行场景里,它可以先确认页面是不是停留在目标位置。

在异常处理场景里,它可以先抓取屏幕上的错误提示,再交给 AI 分析。

在任务闭环场景里,它甚至可以结合页面反馈,做一次执行结果校验。

以前这些事,不是完全做不了。

而是你会觉得整个系统总隔着一层,判断很虚,动作很脆,很多时候只能靠规则硬撑。

一旦有了”屏幕感知”这层能力,后面的自动化就不再只是写死脚本,

而是开始有机会走向一种更接近人的工作方式:

先看,再想,再做。

我越来越确定:未来很多自动化,都会变成”看图做事”

过去的自动化,更多依赖这些方式:

- • 固定规则

- • 固定坐标

- • DOM 结构

- • 接口返回

- • 预设脚本

这些方法依然很有价值,在稳定场景里也非常高效。

但现实世界并没有那么规整。

页面会变化,弹窗会插入,状态会漂移,入口会跳转,很多关键信息甚至根本不是结构化输出。

这时候,自动化如果只靠”预先写好的规则”,就很容易脆弱。

真正更强的模式,其实更像人类自己操作电脑和手机:

先看一眼当前界面。

理解现在是什么状态。

判断下一步该做什么。

执行动作。

再检查结果对不对。

这就是为什么我越来越觉得:

不会看屏幕的 AI,本质上还是在纸上谈兵。

而今天,小龙虾终于迈出了这关键的一步。

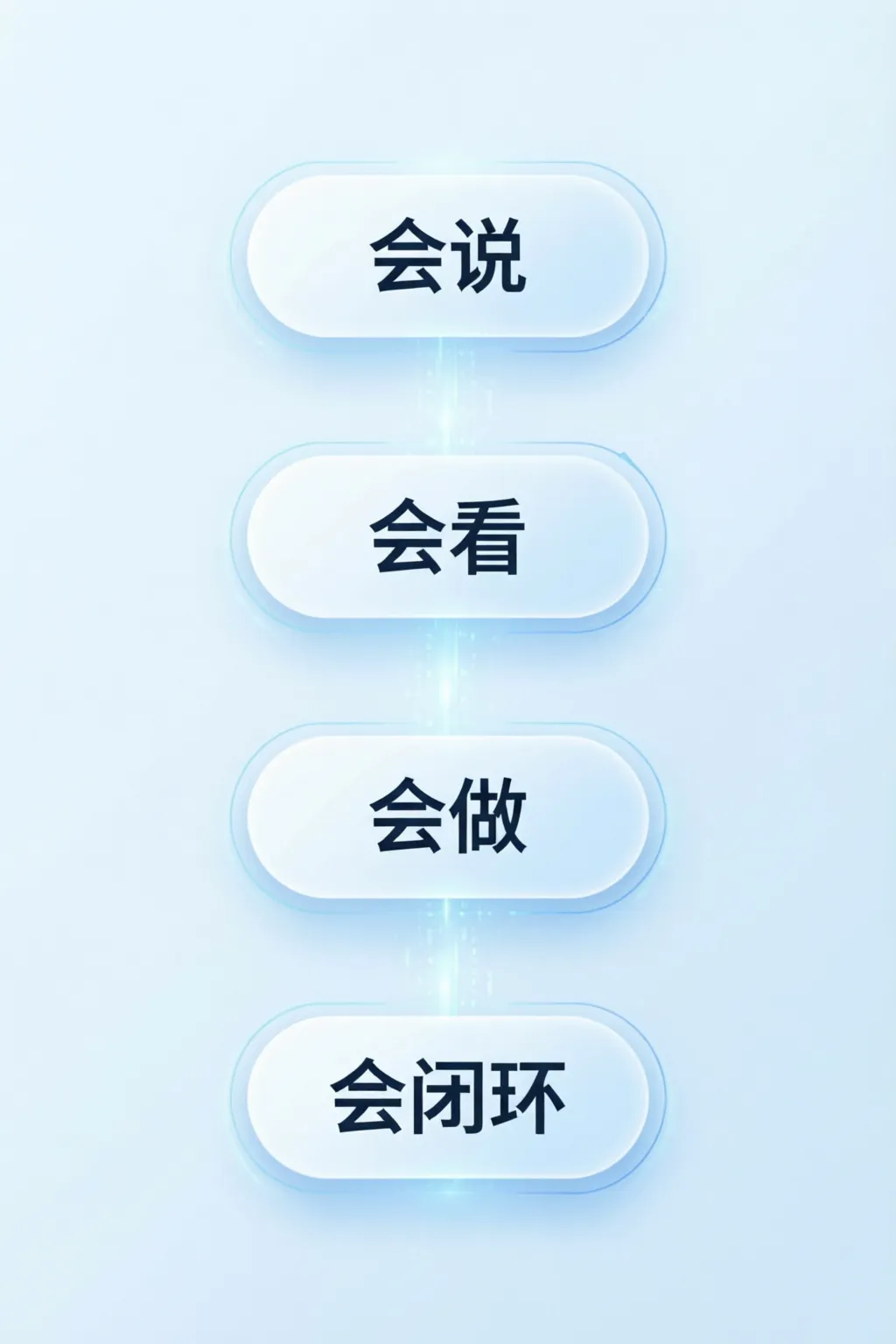

小龙虾真正的进化,不是一下变强,而是慢慢长出能力

我现在很喜欢记录这种时刻。

因为真正的系统成长,从来不是某一天突然”全都会了”。

而是一个个小节点,被硬生生啃下来。

今天是截屏。

也就是”看见”。

接下来,才有可能是”看懂”。

再往后,才是”根据看懂的结果去做事”。

最后,才有机会形成完整的自动化闭环。

从会说,到会看,再到会做。

这是我现在最想跑通的一条路。

所以今天这件事,哪怕它表面上只是一个小进展,我也依然很兴奋。

因为它不是孤立功能。

它是下一阶段能力的入口。

写在最后

很多时候,真正改变系统边界的,不是那些最热闹、最容易被展示的大功能。

而是这种看起来不大、但方向极关键的一步。

今天,我让小龙虾学会了截屏。

换句话说:

我终于让它第一次真正”看见”了屏幕。

而我知道,这只是开始。

接下来,我还会继续把它往前推。

从会说,到会看,再到会做。

我想把这条路,一步一步跑通。

写在最后

很多时候,真正改变系统边界的,不是那些最热闹、最容易被展示的大功能。

而是这种看起来不大、但方向极关键的一步。

今天,我让小龙虾学会了截屏。

换句话说:

我终于让它第一次真正”看见”了屏幕。

而我知道,这只是开始。

接下来,我还会继续把它往前推。

从会说,到会看,再到会做。

我想把这条路,一步一步跑通。

我会继续记录”小龙虾”的进化过程。

因为我越来越相信:

未来真正有用的 AI,不只是会回答问题的 AI。 而是能理解现场、参与流程、真正帮你做事的 AI。

夜雨聆风

夜雨聆风