世界模型如何预测?举例说明,给新手一些建议

最近有小伙伴问我这个类似的问题,合并一起回答。

将分三个方面来回答,世界模型的原理,实际应用举例,该如何选择世界模型?

世界模型的原理

世界模型(World Model)的核心本质,是为机器人、自动驾驶、具身智能等智能体构建了一个可交互、可推演的环境数字孪生模拟器;预测的目标不是未来将发生什么,而是如果智能体执行XX 动作,环境、世界会发生什么样的状态变化(有时也会做无动作的 Rollout,纯预测下一状态),这是和其他预测模型最大的区别,也是世界模型的预测未来的主要逻辑。

当然,任何模型的逻辑都是遵循输入、处理和输出,预测的支撑不会是凭空捏造,就像小朋友会看到苹果从树上掉落到地上,而不是失去地心引力直接窜天。

训练方式多为自监督或模型-Based RL,用过去的数据让模型重建、预测下一帧或下一状态,通过最小化预测误差来优化。数据、参数规模越大,模型对物理规律、社会动态的直觉(预测)就越强。主要技术点如下,

1.过去的观测数据和经验

从图像、视频、传感器读数、动作历史等大量真实或模拟数据中学习环境的运行规律。模型它会提取关键特征,像物体位置、速度、物理交互(重力、碰撞等)、因果关系等,而不是记住每一个像素,但目前也有直接研究像素的思路,生成式AI干的多,具身智能倾向于搞表征。

2.压缩的内部表示(Latent Representation)

现实世界太复杂,AI不会逐像素模拟一切,而是把观测压缩成低维的抽象状态(Latent Space)。这个空间捕捉本质动态,比如一个球在空中,而不是所有光影细节,这样能更加高效的预测。

3.当前状态与潜在动作

预测通常是条件性的,给定当前世界状态(或其表示),以及如果我采取某个动作,模型会推演下一个可能的状态,学习的是转移动态(Transition Dynamics),即状态如何随时间和动作变化。

4.概率或分布预测

由于不是确定性输出,而是预测多种可能结果的概率分布,主要是世界有不确定性,如风向、行人行为等因素,这就借鉴了大脑的预测编码(Predictive Coding)机制,大脑不断预测感官输入,如果实际输入与预测不符,就更新模型。

实际应用举例

以DeepMind的DreamerV3 机器人世界模型为例,预测目标是让机械臂无需真实环境试错,直接在虚拟的世界模型中,模拟抓取杯子直接倒水到碗里的一套完整动作,预测每一步动作后的物体状态变化,输出可直接在真实机械臂上执行的零失误动作序列。主要过程如下,

1.状态表征

把机械臂摄像头的画面、关节力矩传感器数据,压缩成隐状态表征(压缩的内部表示),精准保留杯子、碗、水的位置、形状,以及机械臂的关节角度、夹爪力度等核心信息。

2.动态转移规律

学习了海量机械臂与物体的交互数据,习得了夹爪闭合到多大力度能稳定抓取玻璃杯、杯子倾斜多少度水会稳定流出、水倒出后的流动轨迹等物理交互规律,甚至能模拟水的流体特性。

3.实时初始状态

以当前机械臂的空间位置、杯子和碗的摆放坐标、杯子内的水量等实时数据,作为推演的起点。

4.序列推演

模型在隐空间中,提前模拟XX步的关节动作序列,推演每个微小的关节转动后,机械臂、杯子、水的状态变化。比如关节转动 5 度,杯子倾斜 30 度,水刚好倒入碗中、无洒出的概率 XX%,最终输出完整的动作序列,真实机械臂执行后一次成功,仅需少数任何真实环境的试错微调(正常理想情况,实际问题实际调整)。

还有自动驾驶也是,输入当前摄像头、雷达看到的场景,内部模型先把这输入压缩成内部状态,内设:已学真实驾驶视频和模拟数据,懂物理规律,和行为模式,预测未来,如果地板油继续加速,模型会模拟未来几秒、几十秒,走向可能有3个,行人停下,我安全通过;行人突然加速,我需要紧急刹车,否则对对碰;如果我现在变道,会不会更好?以及其他模拟,在内部想象多个未来轨迹,评估风险和奖励。输出与决策,基于以上这些预测,选择最佳动作。

总的来说,比那些只看当前帧的AI要机智,能处理长时规划和罕见场景等长尾问题。

该如何选择世界模型?

小白刚进入这个领域,要谨记,选型的核心不是追最新的 SOTA(榜一),而是先匹配自身基础、算力、研究方向,从吃透经典、跑通闭环、建立体系下手,否则就容易被高门槛、高算力的模型劝退。分两个方面,一方面是需要准备的基础知识学习,另一方面,开始选型。

基础知识

由于世界模型融合强化学习+ 生成模型(VAE/RNN/Transformer),得先搞懂Python + PyTorch(或JAX),CNN、RNN/LSTM、VAE,RL入门等基本深度学习理论。

这方面的资源很多,B站免费的有不少,注意要边看边动手,不要光看。

接着选型

大家的目标不同,有多模态大模型,也有具身智能,还有其他方向。但逻辑其实差不多,不要光看Github上的项目星星,要先看你的卡、你的目标,你的兴趣。

-

开源代码是必须的,上Colab/Notebook直接就能跑。 -

论文要清楚,纯数学可稍后,视觉化强点(数学好的人忽视这点) -

搜下社区的帖子或者内容,如果已经很久没人吐槽,没人夸,赶紧下一个,不能扩展的要慎重。

像Agent/RL方向建议看Dreamer系列,官方dreamerv3是JAX版的,PyTorch版的NaturalDreamer对小白更友好。

Source:github.com/InexperiencedMe/NaturalDreamer

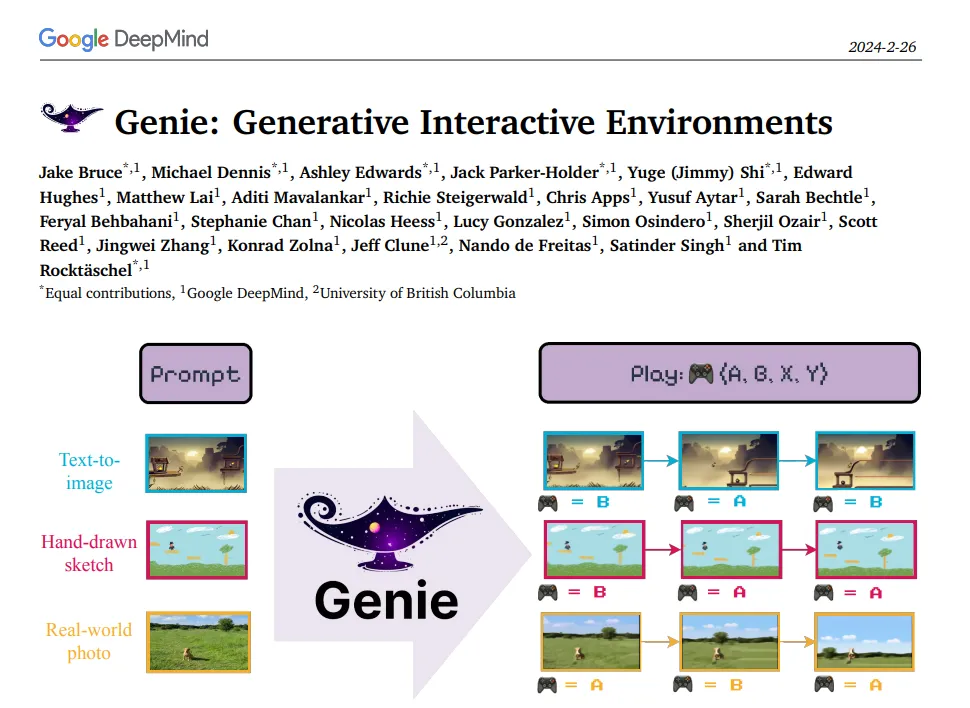

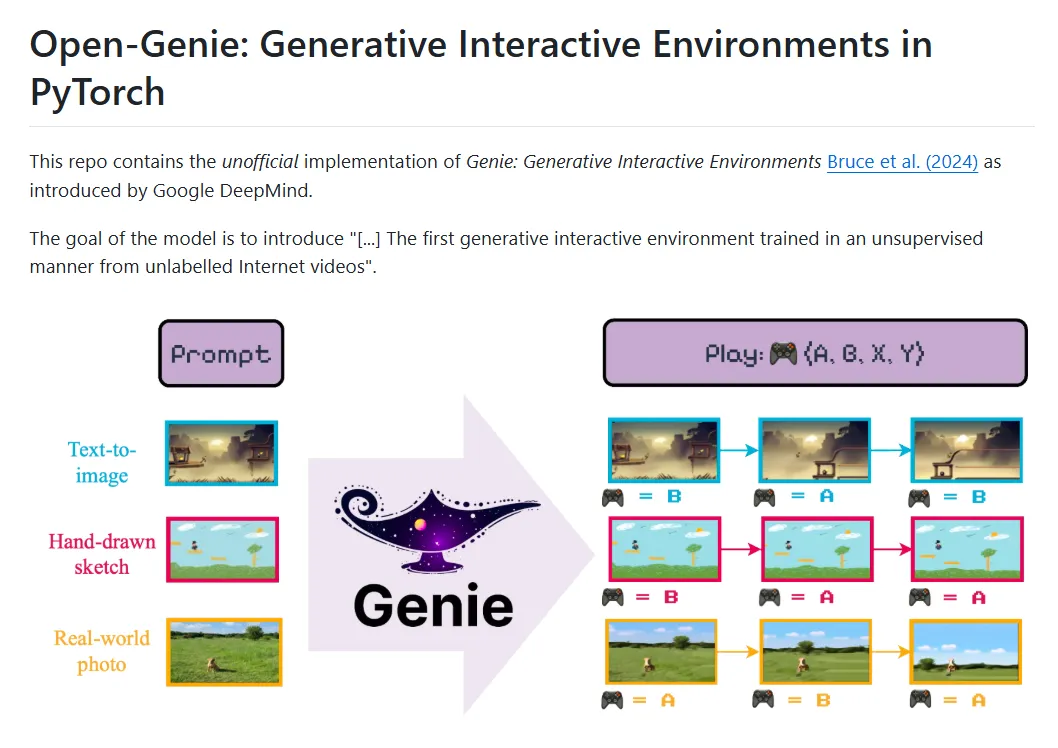

如果是视频、具身智能以及交互方向可以考虑Genie系列,但DeepMind貌似没完整代码,可以考虑在官方网站去熟悉建模,然后也有人按照24年的论文复现(Open-Genie),可以一边读论文,一边看官方和别人的复现开源,了解整体模型的架构和思路。

官方论文读的时候可以先去官网体验一下后,再进行学习,效果更好。

虽然是非官方的复现项目,但官方貌似没出全部代码,所以还是得花时间弄懂比较好。

官方体验网站有好几个,但这个链接可以体验实时的,适合卡源不富的小伙伴。

————

LLM智能超预期却笨得可爱?Andrej Karpathy大佬年度总结

北京VS旧金山?谁是Oral + Spotlight榜一大哥?基于NeurIPS 2024 & 2025 Accept Top50 数据分析研究

夜雨聆风

夜雨聆风