被装进AI的演员们——爱奇艺的数字分身野心,和那些被"入驻"的人

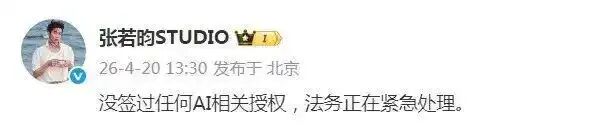

张若昀的工作室是在4月20日下午发的微博。声明很短,大意是:从未签署过任何AI相关授权。

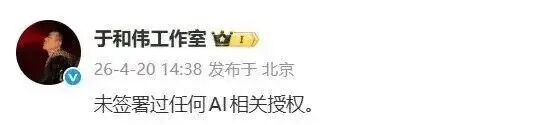

微博发出后不到一小时,于和伟的工作室也发了。然后是李一桐,王楚然。

微博发出后不到一小时,于和伟的工作室也发了。然后是李一桐,王楚然。

此时距离爱奇艺CEO龚宇在世界大会上宣布”超过100位艺人签约入驻AI艺人库”,仅仅过去了不到五个小时。

五个小时里发生的事情,大致是这样的:龚宇站在台上,身后的大屏幕展示着”纳逗Pro”AI艺人库的页面——那些艺人的照片、简介和表演片段整齐排列,像超市货架上的商品。他说,有了AI,演员一年可以从拍4部戏变成14部,不用再在横店一待就是大半年。他说,真人拍摄未来可能会成为”非物质文化遗产”。台下有人鼓掌,有人沉默。消息传到网上,热搜炸了。

然后艺人们开始一个接一个地否认。

4月21日凌晨一点,龚宇在社交平台连续发了两条长文。他解释说,那个名单上的艺人”只是表达了合作的意愿”,并非已经签约。”就跟实际拍摄时一样,具体项目、具体角色,都需要本人同意。”他还放出了自己在大会上的演讲原视频,试图证明自己被”断章取义”了。

但互联网并不在意凌晨一点的长文解释。”真人拍摄或成非遗”这七个字已经像弹幕一样飘满了各大平台的热搜榜单。有人在评论区写:龚宇把演员当成了训练数据。也有人写:演员的尽头,是成为一段代码。

这些评论或许有些情绪化,但它们背后的问题确实值得认真对待。当一家视频平台试图将艺人的面部特征、声音和表演风格转化为可复用的数字资产时,法律上的边界在哪里?艺人签下一纸授权后,到底交出了什么?而那些根本没有签字就被列进名单的人,又该如何维护自己的权利?

一、一张脸的归属权

肖像权这件事,在AI时代变得比以往任何时候都复杂。

在传统的影视合同中,演员授权剧组使用自己的肖像,通常意味着:剧组可以在成片中使用演员的脸。这个授权的范围是清晰的——某部戏、某个角色、某段时间、某个地域。合同到期,授权终止,双方两清。但AI艺人库的逻辑完全不同:平台要的不是”在某个作品中使用这张脸”,而是将这张脸训练成一个可以无限复用的数字模型。演员的脸不再只是出现在某一部电影里,而是可以被拆解、重组、嵌入任何场景。

《民法典》第1019条有一个耐人寻味的表述:”不得利用信息技术手段伪造”侵害他人肖像权。2020年民法典编纂时,AI换脸技术还没有今天这么泛滥,但立法者还是写进了这个条款。四年后回头看,这条规定几乎就是为AI数字分身量身定做的。

但”不得利用信息技术手段伪造”和”经同意后利用信息技术手段生成”,在法律上是两件事。如果艺人自愿签署了授权协议,授权平台使用其面部数据生成数字分身,这属于合法的肖像许可使用——前提是授权协议的条款本身是合法的。

而恰恰是这个”前提”,最容易出问题。河南泽槿律师事务所主任付建在接受媒体采访时指出,人脸信息属于法律上的”敏感个人信息”,依据《个人信息保护法》第29条,处理敏感个人信息必须取得”单独同意”——不能把它塞在一堆格式条款里让人”一键全选”。如果爱奇艺的授权协议把AI肖像授权和常规的经纪条款打包在一起,即便艺人签了字,这个授权在法律上也可能因为未满足”单独同意”的要求而被认定为无效。

更微妙的是授权范围的界定。广东大同律师事务所主任朱永平认为,肖像许可使用的合同必须精准到具体场景——哪个项目、哪个角色、使用多长时间、用于什么渠道,统统要写清楚。如果合同只授权了”在A剧中使用AI分身”,但平台把分身用到了B剧、C剧甚至广告和短剧里,这就是超范围使用,属于侵权行为。概括授权和永久授权,在法律上均属无效。

这些法律分析听起来有些抽象,但放在具体的场景里就很好理解了。一个演员授权爱奇艺在某部古装剧里使用他的数字分身饰演一个配角,这笔交易看起来合理。但如果有一天,平台把这个数字分身用在一部烂俗的短剧里,让”他”说出一些演员本人绝不会说的台词,做出一些演员本人绝不会做的动作——甚至更极端的情况,AI生成的表情出现歪曲和怪异,导致观众对演员本人的评价下降。这时候,演员该找谁说理?授权合同里有没有约定”不得用于可能损害艺人形象的项目”?如果没有约定,法律能不能兜底?

答案并不乐观。目前法律对AI生成内容的质量和”准确性”缺乏明确标准,肖像权保护主要防范的是”丑化和污损”,但AI生成的”不够像”或”风格不对”是否构成丑化,在司法实践中还没有先例可循。这意味着在相当长的一段时间内,艺人对自身数字分身的控制力,主要取决于合同条款的约定——而合同谈判的双方,一个是平台,一个是艺人,力量并不对等。

二、声音的困境

如果说脸的问题还可以通过合同条款来约束,那声音的问题就更棘手了。

《民法典》第1023条规定,声音的保护参照适用肖像权的规则。这意味着前面讨论的所有关于授权范围、单独同意、敏感个人信息的分析,对声音同样适用。但声音在AI场景下有一个肖像不太会遇到的技术难题:声音数据一旦进入AI模型的训练过程,就很难被”单独拿出来”。

举个具体的例子。一个演员授权平台使用自己的声音数据训练AI语音模型。训练完成后,模型学会了这个演员的音色、语调和说话习惯。此时演员想要终止授权,要求平台删除自己的声音数据。平台可以删除原始的声音文件,但模型中已经被”吸收”的声学特征——那些编码在神经网络权重中的数据——无法被精确移除。模型此后生成的声音里,可能仍然带有这位演员声音的某些特征,而演员对此既无法控制,也难以证明。

这在学术界被称为”训练数据的不可逆性”。它带来的法律困境是:当授权终止后,艺人如何确保AI不再产出带有自己声音特征的内容?目前没有技术手段能完美解决这个问题,法律也没有为此设定明确的退出机制。朱永平律师在接受采访时就把这个问题称为AI艺人库面临的”核心监管难题”。

2024年北京互联网法院审理的全国首例AI声音侵权案,已经初步触及了这个问题的边缘。该案中,被告未经原告同意,使用其已有的录音作品训练AI语音合成模型。法院认定,即便被告没有直接采集原告的声音数据,而是使用公开的录音来”复刻”声音特征,同样构成对声音权的侵害。判决书的核心逻辑是:声音权的保护范围不仅及于原始声音本身,还延伸到了对声音特征的AI模仿。

这个判例对爱奇艺AI艺人库的参考意义在于:如果平台在使用艺人声音数据训练AI模型后,模型生成的声音在客观上能够让一般公众联想到特定艺人,那么即便平台声称”已经删除了原始数据”,艺人仍然可以主张声音权受到侵害。但问题在于举证——怎么证明一段AI生成的声音”像”某个特定艺人?目前国内具备声纹比对鉴定能力的机构有限,鉴定费用也不低。配音演员吕艳婷在央视采访中总结的”取证难、鉴定难、追责难”,在声音权领域尤为突出。

三、表演者权:一个悬而未决的问题

肖像权和声音权涉及的是”这张脸是谁的””这个声音是谁的”,但表演还有一个更底层的维度:演员对角色的创造性演绎。

一个演员在镜头前完成的表演,不仅包含他的脸和声音,还包含他对剧本的理解、对情绪的把控、与对手演员的即兴互动——这些创造性劳动的积累,构成了演员独特的表演风格。在著作权法中,这被称为”表演者权”。《著作权法》第39条赋予了表演者多项权利:表明身份权、保护表演形象不受歪曲权、许可他人录音录像权等等。这些权利的基础,是表演者对表演付出了创造性贡献。

那AI生成的数字分身的”表演”算不算表演?AI有没有表演者权?

杭州互联网法院在2024年审结的国内首例虚拟数字人侵权案中给出了一份相当有分量的判决。案件涉及一家叫魔珐的公司开发的虚拟数字人”Ada”,由真人演员徐某某通过动作捕捉技术驱动完成表演。另一家公司未经许可使用了包含Ada表演的视频进行商业推广。法院认定了两点:第一,虚拟数字人本身不是自然人,不能成为表演者;第二,驱动数字人完成表演的真人演员(”中之人”)构成著作权法意义上的表演者。

这个判决的逻辑链条很清晰:数字人只是”壳”,真人才是”魂”。但爱奇艺的AI数字分身和这个案子有个关键区别。在杭州案中,虚拟数字人的每一步动作都是”中之人”实时操控的,因果关系直接。而爱奇艺的数字分身是基于训练数据自主生成内容的——艺人把表演数据交给平台之后,AI在没有真人参与的情况下就能独立产出”表演”。这时候,”魂”和”壳”的关系就变得模糊了。

如果将AI自主生成的表演视为原始艺人的表演延伸,那艺人有权主张表演者权并获得报酬。但如果将其视为独立的”AI创作”,那依据美国版权局和欧盟《人工智能法案》的立场——纯AI生成内容不受版权保护——爱奇艺用数字分身拍出来的戏,其表演部分可能根本不受著作权法保护。这意味着,一方面艺人的权益可能被架空,另一方面平台自己也面临著作权归属不明的法律风险。这是一个双输的局面。

四、那些没有签字的人

爱奇艺事件中最刺眼的部分,不是AI技术本身,而是那些被列进名单却从未签字的人。

张若昀是《庆余年》系列的男主角,这个IP是爱奇艺最重要的内容资产之一。于和伟是爱奇艺多部重磅剧集的核心演员。这些人和爱奇艺的关系不可谓不深。但当他们发现自己的名字出现在”AI艺人库”的入驻名单上时,第一反应是发微博否认。这个细节本身就说明了问题:平台和艺人之间的信任,在这一刻出现了裂痕。

从法律角度看,未经同意将艺人的姓名和肖像列入商业宣传名单,构成了对肖像权和姓名权的侵害。民法典第1019条和第1012条分别保护自然人的肖像权和姓名权,未经许可将他人的姓名和肖像用于商业目的,无论动机如何,都构成侵权。艺人有权要求停止侵害、消除影响并赔偿损失。

但侵权不只是”列个名字”这么简单。更深层的问题在于,爱奇艺在展示AI艺人库时,很可能使用了艺人在已有影视作品中的影像和声音片段——这些片段的著作权归属于制片方,但肖像权和声音权归属于艺人本人。两个权利主体不同,需要分别取得授权。如果平台只拿到了制片方的素材使用授权,就默认获得了艺人的个人授权,这在法律上是不成立的。此前已经有多起短剧AI角色”撞脸”明星的案件发生——2026年初,多部AI短剧被曝光未经授权使用知名演员的面部特征生成虚拟角色,引发演员集体维权。爱奇艺如果在使用艺人影视作品片段训练AI模型时没有另行取得艺人的个人授权,同样可能面临类似的法律风险。

值得注意的是,中国广播电视社会组织联合会演员委员会在2026年4月2日刚刚发布了一份声明,要求各网络平台建立健全AI演艺内容授权核验机制,全面排查下架存量侵权作品。这份声明的发布时间距爱奇艺世界大会不到三周。行业组织已经在密集发声,而爱奇艺选择在这个窗口期高调推出AI艺人库,其中的信息传递耐人寻味。

五、好莱坞用118天换来的东西

中国影视行业正在经历的焦虑,好莱坞在两年前就已经经历过了。

2023年7月,好莱坞演员工会SAG-AFTRA发动罢工。这是自1960年以来好莱坞最长的一次停摆,持续了118天。罢工的核心诉求之一,就是制片方不能滥用AI替代真人演员。演员们走上街头举着标语,上面写着”AI不会取代我,但使用AI的制片方会”。

最终达成的协议中,关于AI的条款被媒体称为”好莱坞历史上最重要的AI协议之一”。其核心可以归纳为三个要求。第一,制片方使用演员的数字形象必须取得明确、具体的书面授权,必须写清楚用于什么项目、什么场景、多长时间。一揽子授权不被允许。第二,制片方必须向演员支付合理报酬,包括一次性授权费和使用分成。数字分身每次”出场”,演员都能拿到钱。第三,演员有权限定使用范围,可以明确拒绝某些类型或内容的使用。

这份协议花了118天、数万演员的停工、数十亿美元的经济损失才谈下来。但它确立了一个清晰的行业共识:技术可以用,但演员的权利必须被尊重。

欧美在制度层面也走得更远。欧盟2024年8月生效的《人工智能法案》将深度伪造纳入”高风险AI”清单,强制要求标注AI生成内容,且使用他人肖像进行AI合成必须取得明示同意。美国版权局明确表示纯AI生成内容不受版权保护。两条路径,一个从行业博弈出发,一个从立法监管出发,但指向了同一个方向。

反观国内,《民法典》《个人信息保护法》《深度合成管理规定》已经搭建了基本的法律框架。但框架和细则之间还有很长的路要走。在影视行业的垂直领域,中国目前还缺乏类似好莱坞SAG-AFTRA协议那样的细粒度规则。爱奇艺这次的风波,某种程度上是这种规则缺位的缩影。

六、规则到来之前

4月21日晚上,热搜榜上关于”爱奇艺AI艺人库”的讨论还在继续。有人在争论AI会不会取代演员,有人在讨论龚宇的公关能力,也有人在问一个更朴素的问题:以后看剧,屏幕上的人到底是真的还是假的?

这些问题暂时都没有确定的答案。但有一件事是确定的:无论技术如何发展,规则必须走在技术前面。好莱坞用118天的罢工换来了三个”必须”,中国影视行业要花多久,取决于从业者的博弈能力和立法者的响应速度。

而对于每一个可能被邀请”入驻”AI艺人库的艺人来说,有一句话或许值得记在心里:**一张脸、一个声音、一段表演,是属于自己的资产,而不是平台的原料。**签任何字之前,先把授权范围、使用期限、报酬机制、退出条件和数据安全条款逐条看清楚。

舞台剧没有被电影取代,电影院没有被流媒体取代,真人表演大概率也不会被AI取代。但如果不在AI成为主流工具之前把规则定好,等这一天真正到来时再补课,代价恐怕会比118天的罢工大得多。

夜雨聆风

夜雨聆风