从招聘到种草:中美两案看AI工具提供商的责任边界

当一家企业因为使用了AI招聘软件而被告上法庭时,谁该为算法的”偏见”买单?是购买软件的雇主,还是开发软件的AI供应商?

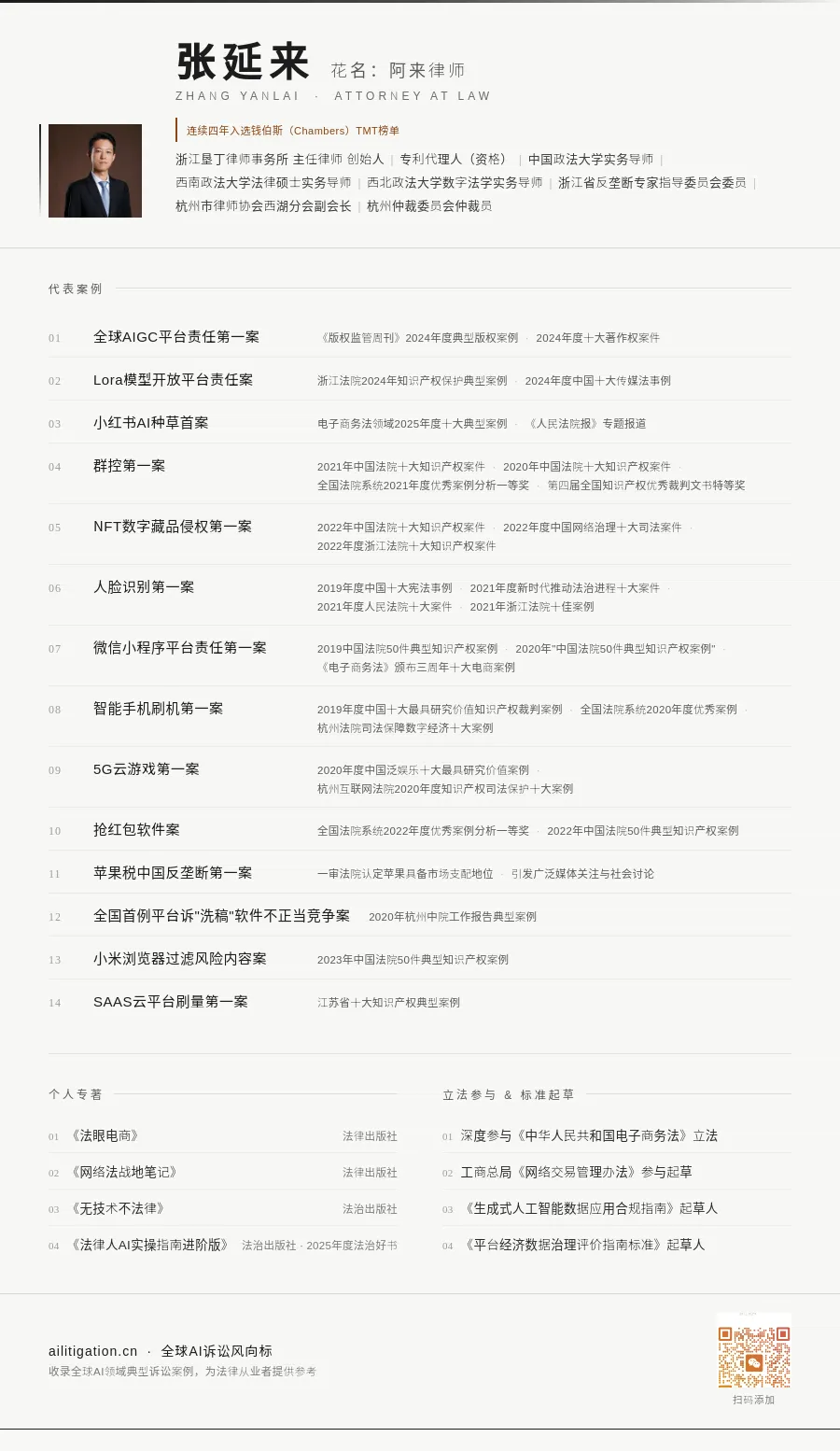

在过去,软件供应商通常可以躲在“技术中立”的盾牌后,将责任推给使用者。但随着AI技术的深度介入,这一防线正在被击穿。从美国加州的Mobley v. Workday案,到笔者代理的“小红书AI种草首案”,我们看到了一种清晰的司法趋势:AI工具提供商正在被拉入侵权责任的漩涡中心。

这个趋势有点反常识,因为我们常规理解的工具就是被人所控制的,谁使用谁负责,为什么AI工具就不一样了呢,核心原因还是在于AI经过了“预训练”之后具有更强的“自主性”。

一、算法即代理:Mobley v. Workday案

在Mobley v. Workday案中,原告指控Workday提供的AI招聘筛选工具存在年龄、种族和残疾歧视。2024年7月,美国加州北区联邦地区法院法官Rita Lin作出混合裁决(Mixed Ruling):一方面驳回了原告的故意歧视主张,另一方面拒绝撤销原告基于”代理人”理论提出的差别影响(Disparate Impact)主张,允许该主张进入实质审理阶段。2026年3月,法院再次驳回Workday的撤案动议,维持了年龄歧视相关主张。目前,案件仍处于诉讼进行中,尚无最终判决。

这一系列裁决的核心意义在于:法院认定,原告关于Workday构成雇主”代理人”的陈述在诉状层面已充分成立(plausibly alleged),足以进入发现程序接受检验。法院的具体理由是,原告的诉状”充分主张了Workday的客户将筛选候选人、决定是否推进面试这一传统职能委托给了Workday”,其软件并非简单执行雇主预设的机械标准,而是”通过人工智能和机器学习参与了决策过程”。

需要强调的是,上述裁定并不意味着Workday已被认定承担侵权责任——驳回撤案动议仅是程序门槛,但这一系列裁定的程序意义不容低估:它首次在联邦法院层面确认,AI供应商以”代理人”身份直接承担就业歧视责任的理论具有可诉性,为后续类似诉讼(如针对Eightfold的集体诉讼)打开了司法通道,也对整个AI人力资源工具市场发出了明确的合规预警信号。

(一)商业模式的冲击

对于AI供应商而言,这一判决意味着巨大的商业风险。在传统的B2B合同中,供应商通常会通过责任上限(Liability Caps)和免责条款(Indemnification Clauses)将风险转移给客户。但如果法院认定供应商是”代理人”,这些合同条款可能无法对抗第三方的侵权指控。

更可怕的是,AI算法的歧视往往是系统性的。一个有偏见的算法可能会在数百家企业中导致成千上万次歧视性决策,从而引发大规模的集体诉讼(Class Action)。

(二)责任的“挤压效应”

当前的AI市场正面临一种”责任挤压”(Liability Squeeze):一方面,法院在不断扩大AI供应商的直接责任;另一方面,供应商在合同中越来越强势地将风险推给客户。

一项针对AI供应商合同的研究显示,88%的供应商设置了责任上限,而只有17%提供了合规保证。这种不对等导致企业在部署AI时,往往要承担其无法完全理解和控制的算法风险。

二、场景化规制:小红书AI种草首案

如果说Workday案开启了AI在劳动领域的”代理人”责任导向,那么笔者代理的“小红书AI种草首案”则在中国司法实践中划定了AI工具在商业竞争中的责任边界。

在该案中,被告开发了一款AI写作工具,专门针对小红书平台生成虚假的”种草”文案。杭州互联网法院和杭州中院均认定,被告的行为构成了不正当竞争。

(一)突破“技术中立”的伪命题

在法庭上,被告试图以“技术中立”作为抗辩理由,主张其只是提供了一个通用的写作工具,用户如何使用与己无关。

然而,法院敏锐地指出:人工智能技术本身是中立的,但这并不意味着人工智能技术的应用也是中立的。

被告的AI工具并非通用的写作助手,而是明确设置了”小红书种草文案”等特定模块,其商业模式就是利用AI批量生成虚假内容,以迎合部分用户的营销需求。这种”场景化”、”定向化”的AI服务,已经超出了技术中立的范畴,直接冲击了小红书以”真实分享”为核心的内容生态。

(二)设定“合理注意义务”

法院在判决中为生成式AI服务提供者设定了”合理注意义务”(Reasonable Duty of Care)。这种义务的边界取决于两个因素:

1商业模式:被告的AI工具是收费的(如终身会员168元),相较于免费的通用大模型,其应当承担更高的注意义务。

2应用场景:被告明知其工具被用于生成特定平台的营销文案,却未采取任何防范措施(如显著的风险提示、限制生成频率等),反而放任甚至诱导用户生成虚假内容。

这一判决为中国AI产业的发展提供了清晰的指引:在应用层提供场景化的AI服务时,须尊重特定平台的规则,不能将AI作为实施侵权或不正当竞争的特定工具。

三、责任边界重塑:从“避风港”到”守门人”

综合中美两国的司法实践,我们可以看到,AI工具提供商的责任边界正在经历深刻的重塑。

(一)告别绝对的“避风港”

在Web 2.0时代,”避风港原则”(Safe Harbor)是互联网平台免责的护身符。只要平台对用户的侵权行为不知情,并在接到通知后及时删除,就可以免责。

但在AI时代,这一原则正在失效。AI工具不仅是内容的载体,更是内容的”生成者”或决策的”参与者”。无论是Workday案中的算法筛选,还是小红书案中的文案生成,AI供应商都深度介入了结果的产生过程。因此,他们不能再简单地以”不知情”来推脱责任。

(二)走向实质的“守门人”

未来的AI工具提供商,必须承担起”守门人”(Gatekeeper)的角色。这要求他们在产品设计、数据训练和商业运营中,将合规要求前置(Compliance by Design)。

3算法审计与透明度:供应商必须对其算法进行定期的偏见测试和合规审计,并向客户提供必要的透明度报告。

4场景化风险防范:针对特定的应用场景(如招聘、医疗、金融、特定平台营销),供应商必须设置相应的技术限制和风险提示。

5合同责任的重新平衡:在B2B合同中,供应商不能再一味地推卸责任,而应与客户建立合理的风险分担机制(如提供特定场景的合规保证)。

参考文献:[1] AI Vendor Liability Squeeze: Courts Expand Accountability While Contracts Shift Risk. Jones Walker. https://www.joneswalker.com/en/insights/blogs/ai-law-blog/ai-vendor-liability-squeeze-courts-expand-accountability-while-contracts-shift-r.html[2] AI生成“种草笔记”,是正常商业行为还是不正当竞争? 中国长安网. http://www.chinapeace.gov.cn/chinapeace/c100047/2025-09/12/content_12801409.shtml

夜雨聆风

夜雨聆风