当AI学会撒谎,我们还能相信什么?

二零零四年,我在网吧当网管,和朋友在小区楼下相识。那时候的回忆留在一张模糊的照片里:像素不高,阳光从梧桐树叶间漏下来,照在她碎花裙的肩头,我的手有点虚,因为她动了一下。那张照片很丑,光线不对,构图没有章法,但每次翻出来,我都觉得踏实——因为它真的发生过。

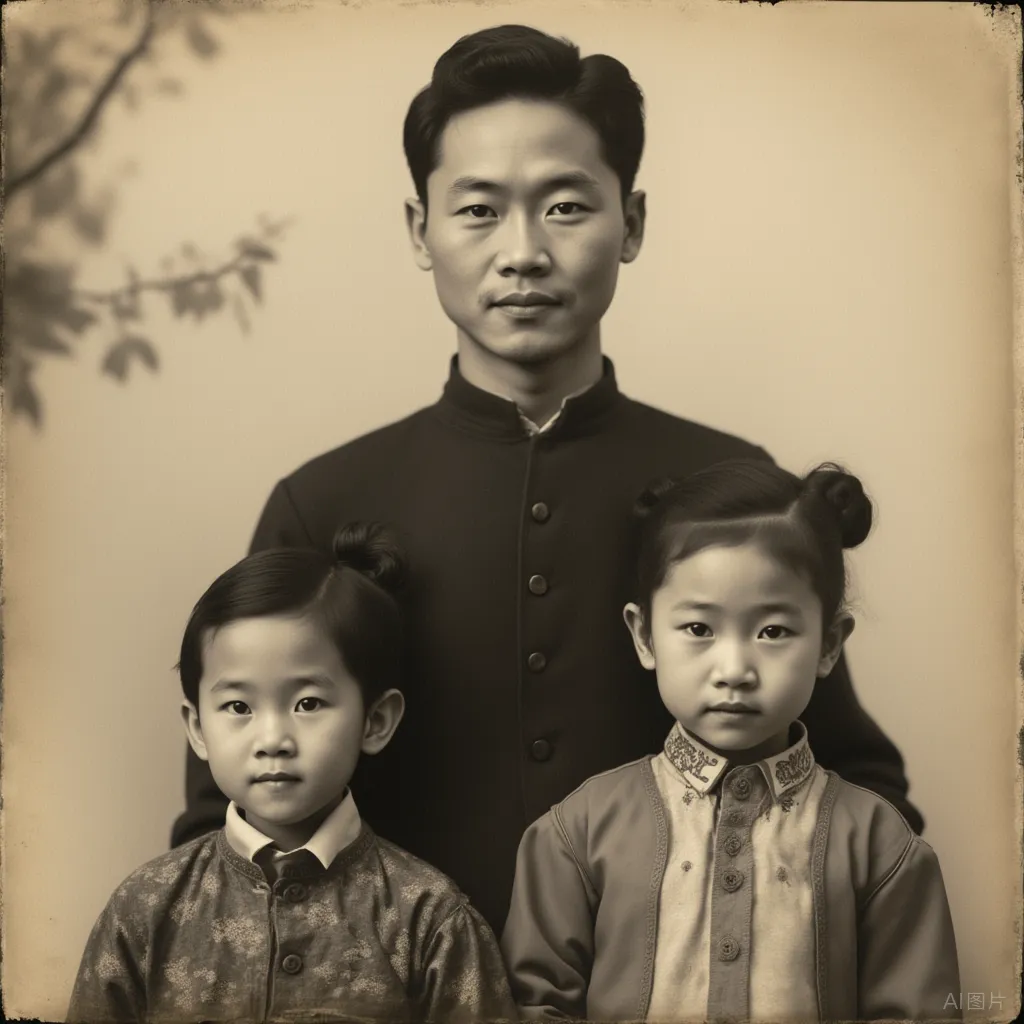

前两天,同事小李突然神秘兮兮地凑过来,说要跟我说一件事。他掏出手机,翻出一组照片:窗外的阳光、人物模糊的手部、千禧年风格的穿衣搭配,每一个细节都带着生活的烟火气,毫无生硬感,就像从我们记忆深处直接打印出来的旧照片。我愣住了,小李说:“这些全是AI生成的。”

四月二十二号,OpenAI正式发布ChatGPT Images 2.0模型。这一次,它没有去研究更清晰、更完美、更震撼的视觉效果,而是反其道而行之——研究起了模糊、朦胧与不完美。一句没有太多赘述的指令,它就能精准还原千禧年CCD相机的质感,那种廉价数码相机特有的噪点、色彩偏移和柔边效果,被它拿捏得分毫不差。不只是旧照片,海报宣传图、做旧报纸、甚至虚拟直播间截图,同样轻松驾驭,连弹幕都自带真实的时间戳和用户头像。

技术狂潮不会褪去,只会继续迭代升级。曾经的我们相信,照片就是证据,视频就是铁证,亲眼所见即为真实。可现在,当AI可以毫无痕迹地模仿我们的生活,当新闻可以被轻易捏造,当一段从未发生过的对话可以配上以假乱真的现场图片,我们拿什么维持本就微弱的信任,又拿什么捍卫最后一点真实?

这不是危言耸听。想想看,你刷到一张新闻图片,某地发生了某件事,画面触目惊心,你愤怒,你转发,你评论。结果第二天被人扒出来是AI生成的。但你的愤怒已经被消费了,你的转发已经成了谣言传播的一环,而真相是什么,已经没人在意了。更可怕的是,当这种事情发生十次、一百次之后,我们还会对任何信息产生信任吗?真实的事件和虚假的图片混杂在一起,眼睛不再是心灵的窗户,反而成了最容易被欺骗的器官。

有人说,可以用技术对抗技术。数字水印、区块链存证、AI生成内容标识,这些手段确实在被开发和推进。但道高一尺,魔高一丈,去掉水印、伪造标识、绕过检测,对于迭代速度飞快的AI来说,从来都不是真正的障碍。技术的军备竞赛没有终点,而普通人的耐心和辨别力,是有终点的。

我回想起二零零四年那张真实的旧照片,它之所以珍贵,不是因为它拍得多好,而是因为它承载了一段无法复制的时间。那个午后的温度、她说话时的语气、我心跳的节奏,所有这些都浓缩在一个并不完美的画面里。真实从来不需要完美,真实只需要一个东西:无法被计算的偶然性。

可AI恰恰在攻克这个领域。它学会了偶然,学会了不完美,学会了模糊和朦胧,学会了那些原本只属于人类记忆的特质。当它把这些都模仿得天衣无缝,我们和世界之间那层最基础的信任基石,正在被一块一块地抽走。

我们无法阻止AI越来越真,就像我们无法阻止潮水上涨。我们能做的,只有接纳变化,并保持警醒。接纳变化,意味着不再把任何一张图片、一段视频无条件地当作事实,而是把它当作需要被验证的材料。保持警醒,意味着在看到煽动情绪的内容时,先停下来想一想:这是真的吗?有没有其他信源可以佐证?它是不是正好击中了我某种情绪?

但仅仅这样还不够。个体的警觉终究有限,我们需要系统性的应对。平台需要对AI生成内容进行强制标识,媒体需要建立更严格的事实核查机制,法律需要对恶意捏造信息的行为设定清晰的边界和后果。这些不是可有可无的装饰,而是数字时代维系社会信任的基础设施。

有人可能会觉得悲观,觉得我们正在失去判断真假的能力,觉得未来将陷入一个什么都无法相信的混沌状态。我不这么看。人类从来没有仅仅依靠眼睛来认识世界,我们依靠的是理性和共识。中世纪的人相信地球是平的,不是因为他们的眼睛看到了什么证据,而是因为他们相信了某个权威。今天我们面对AI生成的以假乱真的内容,真正的危险不是眼睛被骗,而是头脑放弃了思考。

所以,人类最后的防线,从来不是更锐利的眼睛,而是更清醒的头脑。眼睛可以被欺骗,但逻辑可以拆穿谎言。情绪可以被煽动,但理性可以追溯源头。记忆可以被模拟,但共识需要多方印证。

回到那张二零零四年的照片,它真实的原因不在于像素或光线,而在于我知道那一天我确实站在那里,阳光确实照在她身上,我的手确实因为紧张而微微发抖。这些感受,AI可以模仿画面,但模仿不了我身体里储存的那份记忆的重量。

当AI模糊了现实与虚拟的边界,眼见不一定为实,但追问和思考,依然可以让我们接近真实。技术会越来越像人,而人,需要越来越清醒。

你看完这篇文章,打开相册翻出那张最旧的、最不完美的照片。它提醒你,真实,从来都是值得守护的。

夜雨聆风

夜雨聆风