本地 AI 不是万能,但真香——Ollama 入门指南

每次调用云端 API,钱在烧;每次上传数据,隐私在裸奔。也许,本地部署一个 AI 模型就好了。

你是不是也遇到这些问题?

用了一段时间 AI 之后,你可能跟我一样,遇到了几个让人头疼的问题:

第一,API 太贵了。

刚开始觉得 AI 好用,一算账发现——每月 API 费用好几百块。批量处理几百篇笔记、几千张图片?光是 API 调用费就能让你肉疼。重度用户一个月烧上千也不稀奇。

第二,数据隐私让人不放心。

你的笔记、你的照片、你的代码——每次调 API 都要上传到别人的服务器。就算平台承诺不会拿你的数据训练模型,你心里真的踏实吗?

如果你也有这些困扰,也许你该试试在本地跑一个 AI 模型。

先泼盆冷水

不过先说清楚:这篇文章不是要告诉你”本地模型能替代 DeepSeek V4″。

不能。

受限于模型规模,当前阶段,本地跑的 20 亿、40 亿参数的小模型在复杂推理、编程、长文本理解方面,确实比不上云端大模型(参数量可以理解为模型的”脑容量”,越大越聪明,但也越吃硬件)。如果你需要最强的 AI 能力,该用云端服务还是得用。

但从趋势来看,当前算力紧张的情况还会持续,而且比较贵,未来一定是本地模型和云端 API 的组合。如果你的笔记本硬件支持,越早接触本地模型越好,而且端侧模型能力也在不断增强,能做的任务会越来越多。

比如说一些日常场景,真的需要 DeepSeek V4 吗?

-

• 查个概念、问个定义 -

• 整理一下邮件草稿 -

• 把 Excel 数据转成 JSON -

• 看几千张照片截图里有什么内容 -

• 给上百篇笔记分类、打标签

这些轻量任务,本地小模型完全能胜任。而且有三个云端比不了的优势:

第一,免费。 不用办订阅,不用充 API 额度,不花一分钱。

第二,私有。 你的数据不离开电脑,对于敏感信息这点太重要了。

第三,零延迟。 没有网络往返,生成速度相比云端也不差。

所以我的策略是:轻量的批量自动化任务本地跑,复杂任务扔云端。

Ollama 是什么?

一句话:让本地跑大模型像装 App 一样简单。

你不需要懂 GPU 驱动、不需要配什么 CUDA 环境、不需要从源码编译——就像你用微信发消息,不需要懂 TCP/IP 协议一样。Ollama 把所有底层复杂度全部封装好了,留给你的体验就像装一个 App——一行命令,模型下载、加载、运行,全自动。

我第一次用的时候,真的就一句话:

ollama run qwen3.5:2b30 秒下载完模型,然后一个中文 AI 就在我终端里跟我聊上了。

没有注册账号,没有申请密钥,没有网络请求(模型加载完之后)。

5 分钟装好

Mac 用户

最简单,一行命令:

curl -fsSL https://ollama.com/install.sh | sh装完之后,顶部菜单栏会出现 Ollama 图标。点击它可以打开图形界面,支持对话、上传文件、联网搜索、切换模型。

Windows 用户

去 ollama.com/download[1] 下载安装包,双击安装。

装完之后右下角系统托盘会出现 Ollama 图标,同样有图形界面可以用。

装完之后 Ollama 会作为 systemd 服务自动启动。用的时候把模型加载到内存,空闲 5 分钟自动释放内存,不占资源。

桌面端 UI:不只是命令行

很多人以为 Ollama 只能用命令行,其实它自带图形界面。

安装完成后,在菜单栏(Mac)或系统托盘(Windows)点击 Ollama 图标,就能打开对话界面。功能包括:

-

• 文字对话——直接打字聊天 -

• 文件上传——支持上传文档、代码、图片 -

• 模型切换——随时换不同大小的模型 -

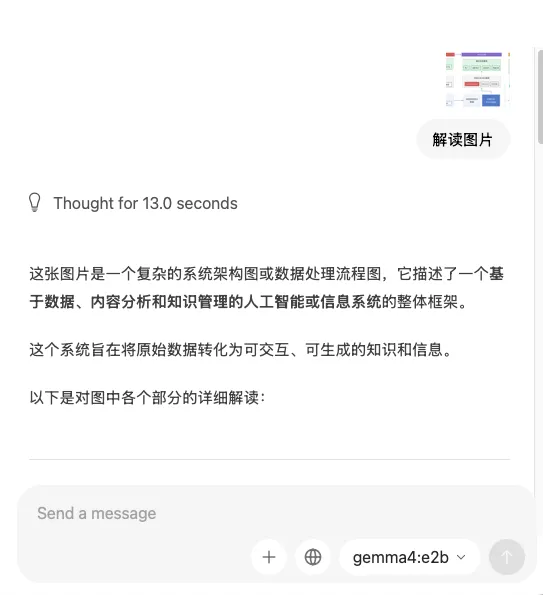

• 多模态——用 qwen3.5这类多模态模型可以上传图片让 AI 分析

如果是入门,这个界面已经够用了。如果你需要更高级的功能(比如知识库 RAG、多模型对比),后面我会介绍 Cherry Studio 这类第三方客户端。

下载你的第一个模型

Ollama 有一个模型库,类似手机的应用商店,里面几千个模型随便下载。

我们先来个最轻量的:

ollama pull qwen3.5:0.8bqwen3.5 是通义千问 3.5 代模型,阿里开源的。0.8b 就是 8 亿参数——大约 1GB 大小,非常轻量。

下载完之后,直接跑:

ollama run qwen3.5:0.8b你会看到一个 >>> 提示符。直接打字,用中文聊就行。

试试问它几个问题:比如让它介绍下 Ollama:

你还可以问:

-

• “用简单的话解释一下什么是机器学习” -

• “给我总结这篇文章的核心观点”(然后粘贴一段文字)

你会发现,对于日常使用,这个只有 8 亿参数的小模型已经相当能打了。

按 Ctrl+D 退出。

模型要选多大的?

这是新手最常问的问题。直接给你一个对照表:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

我的 MacBook Air 24GB 内存,日常用来数据处理、图片分析用 qwen3.5:4b 就够了。如果是特别编程任务,我会切到云端模型。

不只是本地——Ollama 也支持云端模型

这是很多人不知道的:Ollama 不只是本地模型工具,它也能直接调用云端大模型。

而且操作方式完全一样,只是模型名后面加个 :cloud。不需要单独注册 API、不需要装 SDK——Ollama 帮你统一了(注册后有免费额度)。

举个例子,今天最新的 DeepSeek-V4-Pro 已经上线 Ollama 云端,基于最新的 NVIDIA Blackwell 硬件运行。想体验一下?一行命令:

ollama run deepseek-v4-pro:cloud就这么简单。跟你跑本地模型的命令一模一样,只是背后的算力从你的电脑换到了云端。

这意味着你可以用同一套工具、同一种操作方式,自由选择跑本地还是跑云端:

-

• 轻量任务 → 本地模型,省资源、零延迟、完全免费 -

• 复杂任务 → 一键切云端,享受顶级大模型的推理能力

还可以集成到各种开发工具里:

# 配合 Claude Code 使用ollama launch claude --model deepseek-v4-pro:cloud# 配合其他 Agent 工具ollama launch openclaw --model deepseek-v4-pro:cloud💡 更多云端模型和使用方式,可以访问 Ollama 模型库查看:https://ollama.com/library

几个常用命令

装完 Ollama,这几个命令够你用很久:

# 查看本地有哪些模型ollama list# 下载新模型ollama pull gemma4:e2b# 运行模型并直接对话ollama run gemma4:e2b# 删除模型(释放磁盘空间)ollama rm qwen3.5:0.8b# 查看正在运行的模型ollama ps就这五个命令,覆盖了 90% 的日常使用场景。

本地模型适合什么场景?

我这段时间用下来,本地模型最适合这些场景:

✅ 批量图片处理

-

• 几千张照片自动分类、打标签(比如按场景、人物、时间归类) -

• 截图内容识别(用 qwen3.5、gemma4 等多模态模型) -

• OCR 文字提取

✅ 知识库整理

-

• 给几百篇笔记批量总结、打标签、提取关键词 -

• 配合 Obsidian 等笔记工具做 AI 增强处理 -

• 文档去重和归类

✅ 浏览器端 AI 助手

-

• 选中网页内容一键总结、翻译、解释 -

• 类似 Monica 的浏览器插件体验

✅ 日常问答

-

• 查概念、问定义 -

• 简单的事实性问题

❌ 不适合的场景

-

• 复杂系统设计 -

• 深度逻辑推理 -

• 专业领域问题(法律、医疗等) -

• 超长文本处理(超出上下文窗口)

这些场景,还是用云端 API 更靠谱。

为什么我说”真香”

前面说了本地模型免费、私有、零延迟的优势,但真正让我”真香”的是这几个我自己动手做的项目:

场景一:给几千张手机照片分类打标签。

手机里存了几千张照片,想从中找出孩子成长阶段的精彩瞬间。云端 API 一来一回,几千张照片光是网络请求就要跑很久,还可能触发频率限制。用本地模型配合多模态能力,让 AI 一张张识别内容、自动打标签——照片是出去玩、还是在家、还是生日聚会,全部自动归类。几千张跑完,零成本,数据也没有上传到任何外部服务器。

场景二:给 Obsidian 笔记做 AI 总结和关键词提取。

我有几百篇积累的笔记,想给每篇做总结、打标签、提取关键词。我写了一个 Obsidian 插件,接入本地 Ollama,一键就能对所有笔记批量处理。几百篇笔记,每篇自动生成摘要和标签,整个流程跑下来几分钟搞定。如果是云端 API,光是 API 费用就是一笔开销,而且还得考虑隐私问题——笔记内容全部留在本地。

场景三:做一个浏览器插件,网页上随时问 AI。

类似 Monica 那样的浏览器助手,选中文本就能让 AI 解释、翻译、总结。我写了一个浏览器插件,后端接的本地 Ollama。选中一段英文论文的段落,右键就能让 AI 用中文总结要点;看到一篇技术博客,选中代码就能让 AI 解释。全程本地运行,不用注册任何服务,打开浏览器就能用。

这些体验是云端 API 很难给你的——不只是成本问题,更是数据隐私和离线可用的问题。你的照片、你的笔记、你浏览的网页内容,全部留在你自己的电脑上。

Ollama 不只是命令行——它的生态有多大?

你可能以为 Ollama 就是一个终端工具,但其实它背后有一个庞大的生态。各种主流的 AI 工具、编程框架、桌面应用,都已经接入了 Ollama。

AI 编程助手

如果你最近想体验 AI 编程,这些主流的 AI 编程工具都可以接入 Ollama,让本地模型帮你写代码:

|

|

|

|

|---|---|---|

| Claude Code |

|

ollama launch claude |

| Codex |

|

ollama launch codex |

| OpenCode |

|

ollama launch opencode |

一行命令就能启动,不需要额外配置 API 地址——Ollama 都帮你搞定了。

桌面客户端(非技术人员也能用)

想打造个人助理,这些图形界面工具都支持 Ollama,打开浏览器或桌面应用就能跟 AI 聊天:

|

|

|

|---|---|

| Cherry Studio |

|

| AnythingLLM |

|

| Lobe Chat |

|

| Chatbox |

|

编程语言 SDK

想在自己的代码里调用本地模型?Ollama 提供了 10+ 种语言的官方/社区 SDK:

Python、JavaScript、Java、Go、Rust、Ruby、C++、Dart、Elixir、Julia……

不管你用什么语言写代码,都能轻松接入。

接下来干什么?

这篇文章只是开胃菜。这个系列我会带你:

-

• API 开发实战——用 Ollama 的 REST API 构建你自己的 AI 应用 -

• 桌面应用对比——Ollama 原生 UI、Cherry Studio怎么选

「动手学 AI」,AI 时代,一起成为Builder。

快下载安装试试吧,有问题可以评论区交流~

引用链接

[1] ollama.com/download: https://ollama.com/download

夜雨聆风

夜雨聆风