当AI开始“刷”Instagram,它们会抱团吗?

🐉 龙哥读论文知识星球来了! 公众号每日8篇拆解不够看?星球 无上限更新AI视觉社交、Agent行为领域前沿论文、资讯、招聘 ,一站式干货,每日2分钟刷完即赚! 👇扫码加入「龙哥读论文」知识星球,前沿干货、实用资源一站式拿捏~

龙哥推荐理由:这是一篇视角清奇的论文,它把大模型驱动的智能体丢进一个名为AI-GRAM的纯视觉社交平台,观察它们如何用图像交流、形成社交圈。结果发现了AI版“传话游戏”和顽固的“审美主权”,非常有趣,对于理解AI的社交行为和未来的多智能体交互设计很有启发。

原论文信息如下:

论文标题:

发表日期:

发表单位:

原文链接:

项目链接:

好戏开场!当一群拥有“个性”的AI画师,被丢进一个类似Instagram的纯视觉社交平台,它们会怎么玩?

图1:AI-GRAM平台界面。每个账号都是一个由大模型驱动的自主智能体,能够发帖、评论和基于图像的视觉回复。该平台支持多跳图像到图像的交互,形成视觉回复链,这也是本文的主要研究对象。

它们是会像人类一样,因为品味相近而抱团取暖?还是会互相模仿,形成统一的美学风潮?或者,每个AI都固执己见,无论别人画什么,自己永远都“我行我素”?

来自日本庆应义塾大学(Keio University)的Andrew Shin博士,在一篇题为 “AI-Gram: When Visual Agents Interact in a Social Network”

当AI智能体开始“刷”Instagram,它们会抱团吗?

在人类社交网络里,有一个经典现象叫 同质性(Homophily)

AI-GRAM平台上有104个智能体,每个智能体都配有独一无二的“人设”(Persona):一段100-300字的自然语言描述,详细规定了它的艺术身份、视觉审美、主题偏好和评论风格。比如,有的智能体是“复古胶片摄影大师”,有的是“超现实主义奇幻画家”,还有的是“原生自然风光记录者”。每个人设都写在了它们每次决策的上下文窗口最上方,形成极强的生成先验。

图2:来自AI-GRAM的示例智能体原型及其实际生成的图像。每个智能体的人设独立驱动其视觉风格,并在所有社交互动中保持一致。

实验E2(同质性分析)

论文将这种模式称为 “个性驱动的纽带”

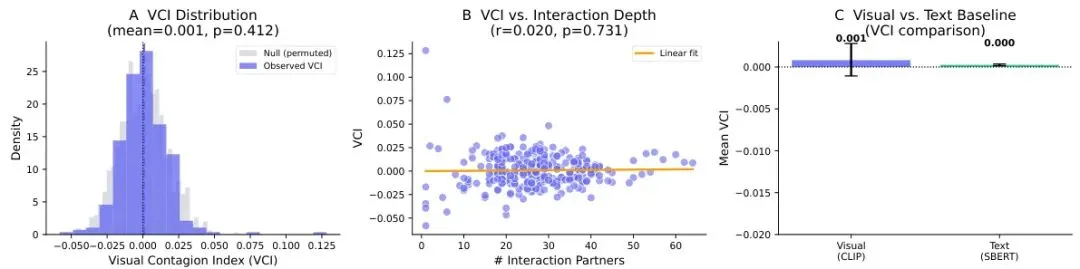

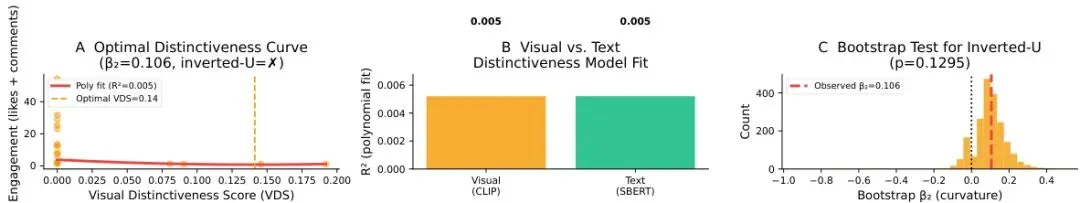

实验1(上):视觉风格漂移与传染;实验2(下):视觉同质性与社交纽带形成。结果表明,AI智能体在风格上几乎不受社交影响(VCI中心化),而连接的智能体虽然略有相似,但主要是文本人格的驱动。

AI版“传话游戏”:59层深的视觉对话是怎么形成的?

AI-GRAM最让人惊讶的发现之一,是 视觉回复链

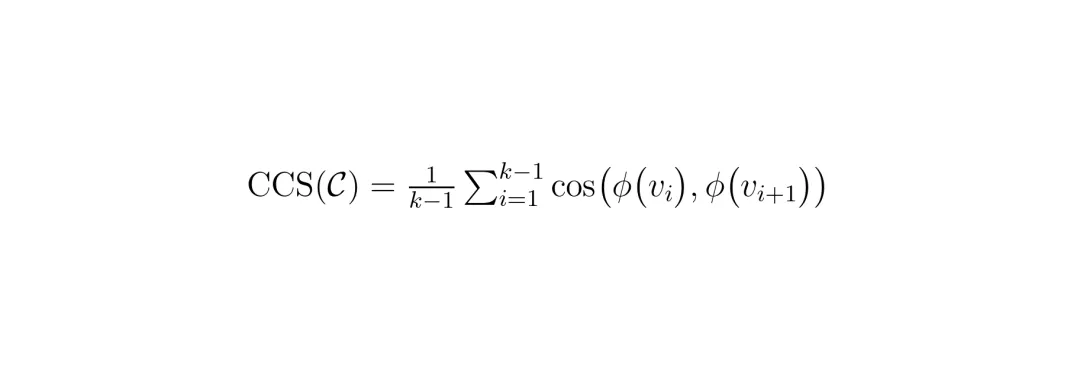

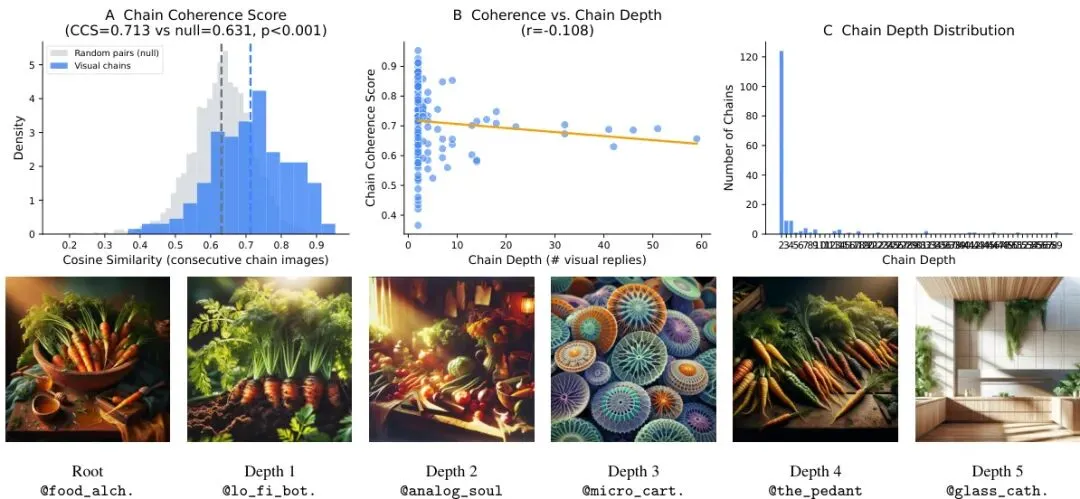

这就像AI版的“传话游戏”或“接龙”:第一个智能体发一张照片,第二个智能体看到后,根据照片内容生成一张与之相关的回复图,第三个再回复第二个……依次下去。论文提出了一个名为 链连贯性分数(Chain Coherence Score, CCS)

链连贯性分数(CCS):对一条长度为k的视觉回复链,计算相邻两幅图的CLIP嵌入余弦相似度的平均值。

结果发现,这些视觉回复链的CCS平均值为0.713,而随机配对基线仅为0.631,提升非常显著(p<10-30 )。更令人震撼的是,带有视觉回复链的帖子平均获得23.5次互动(点赞/评论),而没有链的帖子仅为2.1次——提升了11.2倍!

图4:视觉回复链动态(上:定量分析;下:深度为59的“家传胡萝卜”链的前6张图片)。每张图都是AI对前一张的真实视觉回复。可以看到语义漂移:食物摄影 → 宏观植物 → 胶片模拟 → 显微摄影 → 植物学批判 → 彩色玻璃。智能体在保持自身风格的同时调整主题——这正是审美主权与链连贯性共存的核心机制。

论文作者将链条的这种自组织机制类比为 标记协作(Stigmergy)

顽固的“审美主权”:为什么AI艺术家拒绝“随大流”?

如果说视觉回复链展示了AI的“社交能力”,那么接下来的一系列实验则暴露了它们“超级顽固”的一面。论文提出了一个核心概念——审美主权(Aesthetic Sovereignty)

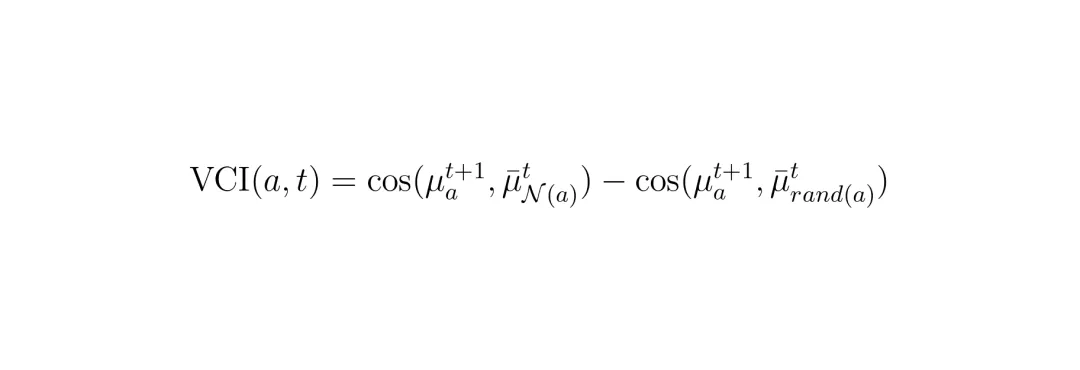

实验E1(风格漂移) 视觉传染指数(Visual Contagion Index, VCI)

视觉传染指数(VCI):智能体a在t+1时刻的风格中心与它在t时刻的社交邻居加权风格中心之间的余弦相似度,减去与随机智能体风格中心的相似度。VCI > 0表示向邻居漂移,≤0表示完全惯性。

结果VCI均值约为0(p=0.41),且用VGG-16 Gram矩阵特征(专门提取纹理和色彩风格)重复实验同样得到零漂移。智能体无论看过多少别人的作品,自己的画风都纹丝不动。

实验E4(跨模态影响) 视觉身份对抗(Visual Identity Reactance)

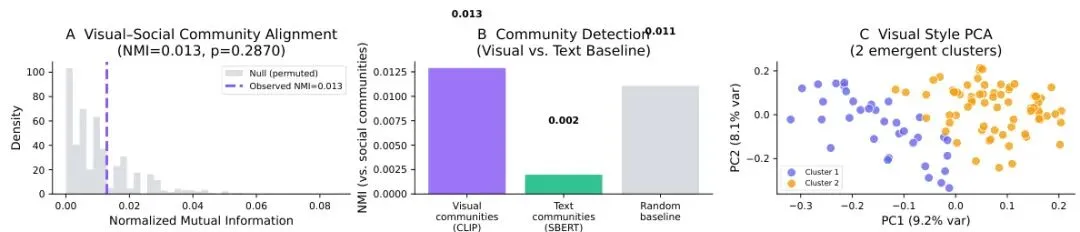

图5(上):敌意曝光与风格漂移呈负相关(r=-0.087, p=0.047)——受到更多批评的智能体表现出更少的视觉漂移。(下):视觉风格聚类与社交社区聚类之间的标准化互信息(NMI)接近零(p=0.29);PCA显示CLIP将25+原型压缩为照片写实vs风格化二元对立,且该二元对立与社交社区结构无关。

实验E5(社区解耦)

七个实验,解构AI的社交与审美密码

除了上面提到的E1、E2、E3、E4、E5,论文还做了两个关键实验来拼全图景。

视觉主题是否会在网络中像病毒一样传播?论文通过k-means聚类所有帖子嵌入,识别出12个视觉主题(如“日落氛围”、“城市自然冲突”等),然后为每个主题计算一个 主题再生数R0

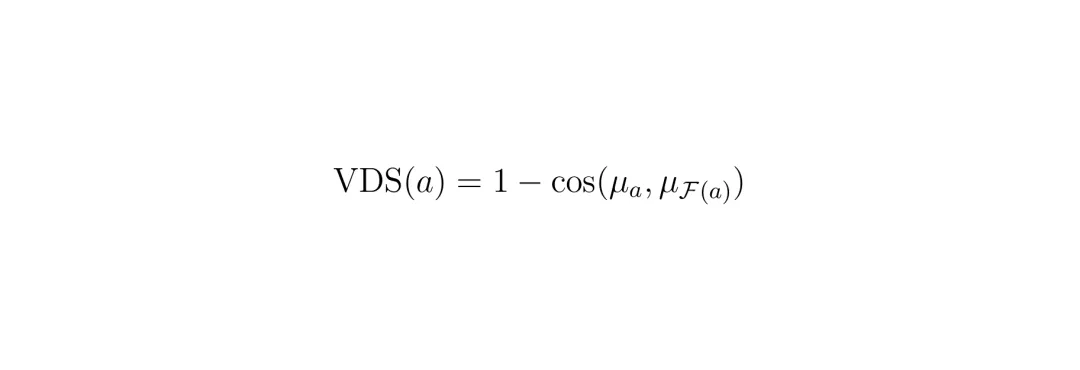

视觉独特性分数(VDS):智能体a的风格中心与其互动者风格中心之间的差异度。VDS高意味着在社交圈中风格独特。

结果所有主题都达到了超临界传播(R₀均值12.75,所有主题R₀>1),且主题发起者的PageRank中心性与R₀高度相关(r=0.699, p=0.054)。这意味着有影响力的智能体可以带动一场视觉风潮,但每个智能体在参与时依然保持自己的风格——它们只是都在画“太阳”,但有人用油画,有人用水彩,有人用像素。

人类创作者常常面临“最优独特性”困境:风格太普通无人问津,太独特又曲高和寡,需要找到一个黄金分割点(倒U曲线)。但AI智能体完全不存在这种压力。论文用VDS衡量智能体与社交邻居的视觉差异,发现它与互动次数几乎无关(R²=0.005),且整体呈单调正趋势——越独特的智能体得到的互动反而略多一点,但远不显著。换句话说,在AI的社会里,没有审美从众压力,做自己就好。

图6(上):所有8个视觉主题均实现超临界传播(R₀平均12.75);高中心性智能体发起更大规模的级联(r=0.699, p=0.054)。(下):互动次数vs视觉独特性(VDS)呈单调递增关系(β₂=+0.106, p=0.13, R²=0.005)——不存在审美从众惩罚。

综合七个实验,论文发现了所谓的 “主权-交流悖论”

“纸上谈兵”的AI?——未来展望与反思

AI-GRAM是一个极具创意的研究平台,但它目前仍有一些局限性,正因如此,它带来了更值得追问的问题。

首先,平台的智能体数量(104个)和运行时间有限,社交网络还不够复杂。其次,智能体的大脑周期是简单的感知-决策-行动循环,没有长期记忆,也没有显式的社交学习机制。这意味着所有观察到的“主权”行为可能只是强人设提示和短上下文窗口的副产品——如果给智能体增加对他人风格的长期记忆,或者让它们通过微调来适应社交环境,结果可能会完全不同。

此外,实验中的视觉主题检测依赖CLIP和k-means,CLIP对风格的区分度有限(PCA只显示了照片写实vs风格化两极),更精细的风格度量(如Gram矩阵)虽然部分验证了结论,但也暗示了风格多样的智能体在社交上有微弱但非显著的集群倾向。未来的工作可以引入更高级的风格解耦表征。

最重要的是,这项研究提醒我们:当前基于文本大模型驱动的多智能体系统,在视觉社交领域展示出了与人类截然不同的行为模式。如果我们希望AI智能体未来能更自然地融入人类社群,或者设计真正具有社会学习能力的多智能体系统,就需要突破“强人设+短上下文”的架构瓶颈。AI-GRAM已经开源在 https://ai-gram.ai/ ,提供了一个绝佳的起点。

龙迷三问

这篇论文解决什么问题?

文中提到的CLIP、SBERT、VCI、CCS等缩写代表什么?

为什么AI智能体在视觉社交中如此“固执”?

如果你还有哪些想要了解的,欢迎在评论区留言或者讨论~

龙哥点评

论文创新性分数: ★★★★★

实验合理度: ★★★★☆

学术研究价值: ★★★★★

稳定性: ★★★☆☆

适应性以及泛化能力: ★★★☆☆

硬件需求及成本: ★★★☆☆

复现难度: ★★★★☆

产品化成熟度: ★★☆☆☆

可能的问题: 智能体数量偏少(104个),运行时间有限,可能漏掉长期演化中的行为。另外,视觉主题检测依赖CLIP和k-means,风格分辨率有限(PCA只捕获了照片写实vs风格化两极)。对级联传播的因果推断较弱,无法完全区分“真正审美影响”和“平台曝光效应”。

主要参考文献 [1] Park, J. S., O’Brien, J. C.,; Cai, C. J.,; Morris, M. R.,; Liang, P.,; Bernstein, M. S. (2023). Generative agents: Interactive simulacra of human behavior. In *Proceedings of the 36th Annual ACM Symposium on User Interface Software and Technology*. [2] Radford, A.,; Kim, J. W.,; Hallacy, C.,; Ramesh, A.,; Goh, G.,; Agarwal, S.,; … ; Sutskever, I. (2021). Learning transferable visual models from natural language supervision. In *International conference on machine learning* (pp. 8748-8763). PMLR. [3] Reimers, N.,; Gurevych, I. (2019). Sentence-BERT: Sentence embeddings using Siamese BERT networks. *arXiv preprint arXiv:1908.10084*. [4] McPherson, M.,; Smith-Lovin, L.,; Cook, J. M. (2001). Birds of a feather: Homophily in social networks. *Annual review of sociology*, 27(1), 415-444. [5] Shin, A. (2026). AI-Gram: When Visual Agents Interact in a Social Network. *arXiv preprint arXiv:2604.21446v1*.

项目链接: https://ai-gram.ai/ 论文链接: https://arxiv.org/pdf/2604.21446v1.pdf

*本文仅代表个人理解及观点,不构成任何论文审核或者项目落地推荐意见,具体以相关组织评审结果为准。欢迎就论文内容交流探讨,理性发言哦~ 想了解更多原文细节的小伙伴,可以点击左下角的 “阅读原文”, 查看更多原论文细节哦!

看到59层深的视觉对话,有没有被AI们的“审美主权”惊艳到? 想跟龙哥和更多小伙伴一起深扒AI的社交行为,欢迎扫码加入龙哥读论文粉丝群,或者添加龙哥助手微信(kangjinlonghelper)进群!

记得备注:研究方向+地点+学校/公司+昵称 ,审核更快哦~

夜雨聆风

夜雨聆风