国产平替!最适合普通人的 OpenClaw(龙虾)平替方案

之前 OpenClaw (那时候还叫 Clawdbot) 刚出的时候,就想安装它的客户端体验下。

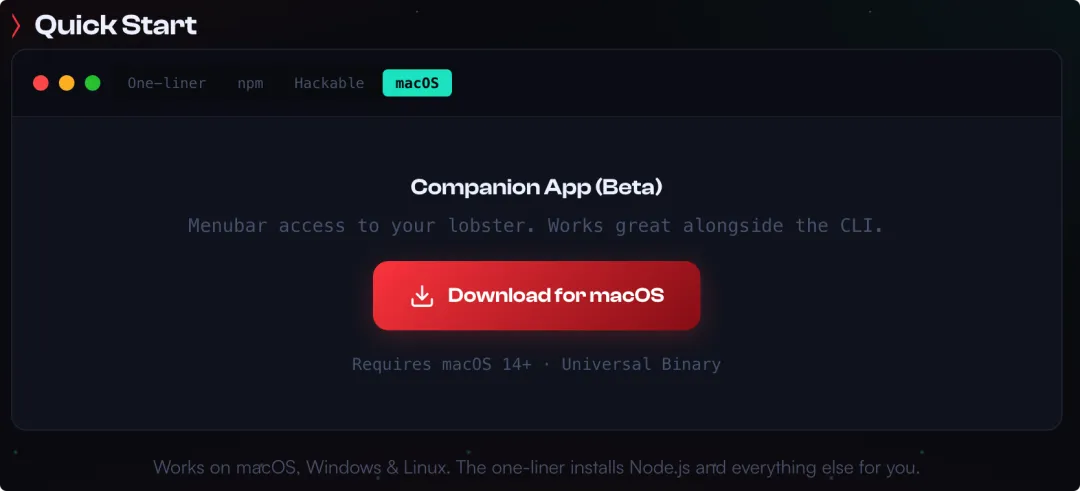

不过万恶的是,他这个客户端只支持 macos 14 以上的版本

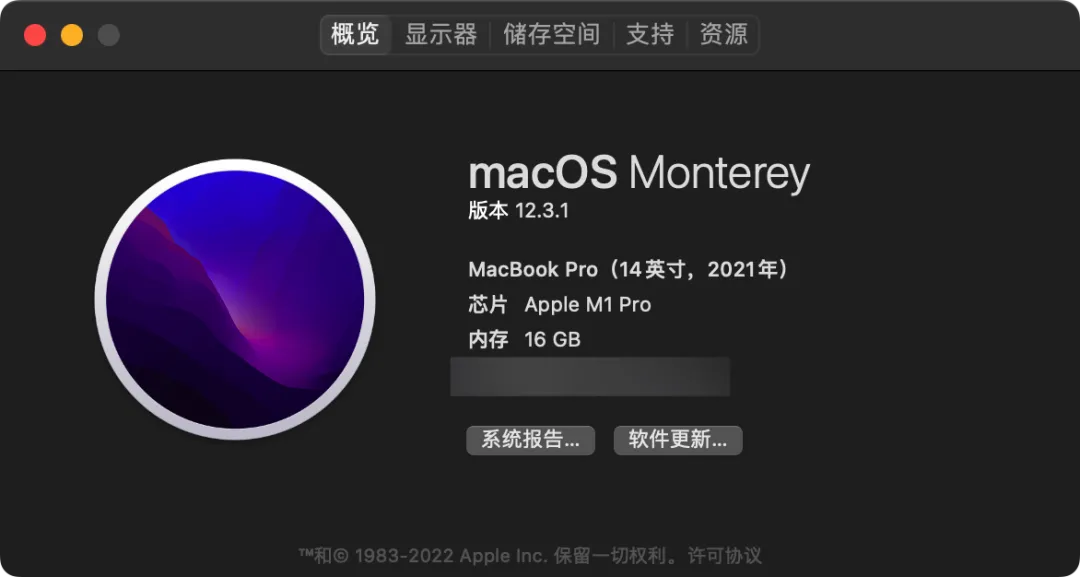

而我这台电脑,买回来之后就没升级过系统,到现在还用着 12 的系统呢

主要是因为我电脑里安装了太多的工程软件,一旦升级,那么大部分工程软件都得废掉了。

所以,安装客户端的想法就暂时搁置了,一直用着他的 npm 终端。

不过用过 npm 终端的都知道,这玩意不好用。每次使用都在挑战你的忍耐度。

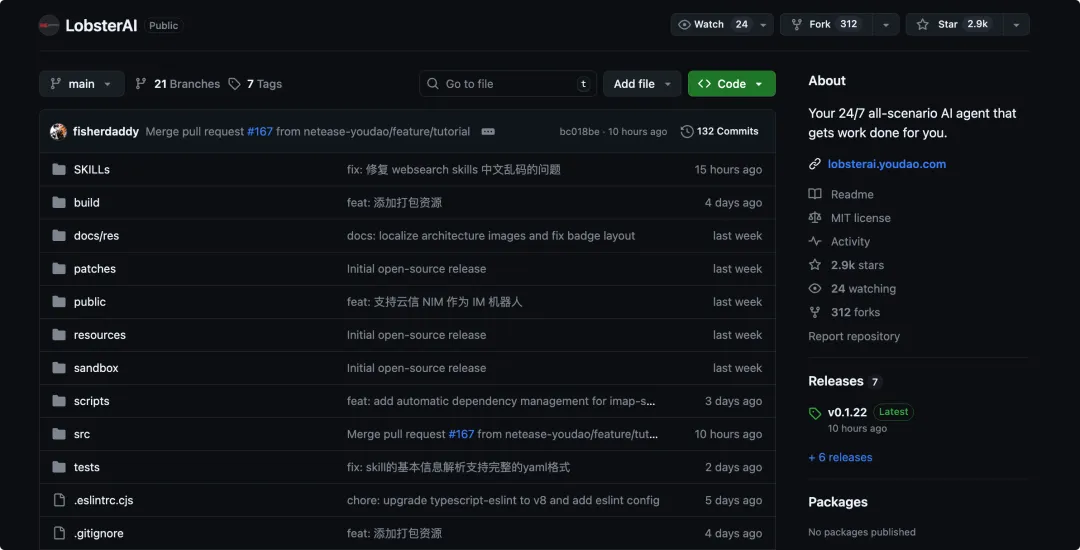

正当我快忍不了的时候,我无意中在 github 上看到了这个:

LobsterAI 网易有道开源的一个类似于 OpenClaw 的东西。并且这玩意最好的就是它能在我的系统上安装 😂

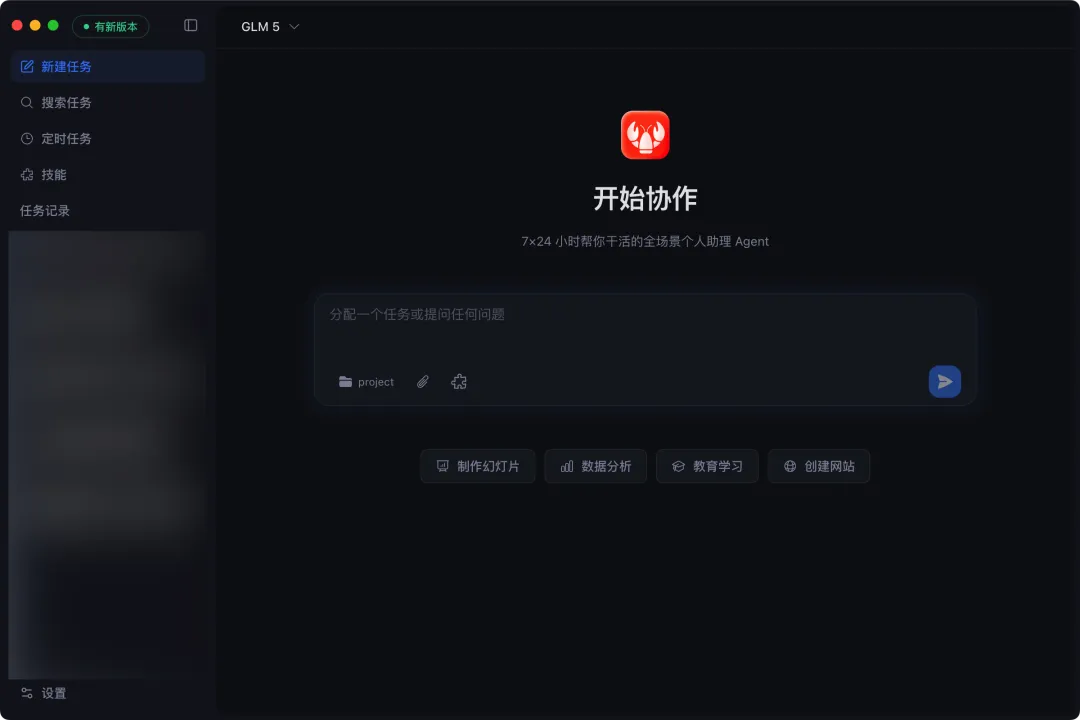

你看,这就用上了

说说使用体验

一句话 LobsterAI 就是 OpenClaw 的国产平替版。

比较友好的地方在于,你不需要任何魔法就可以访问,并且内容是全中文的。

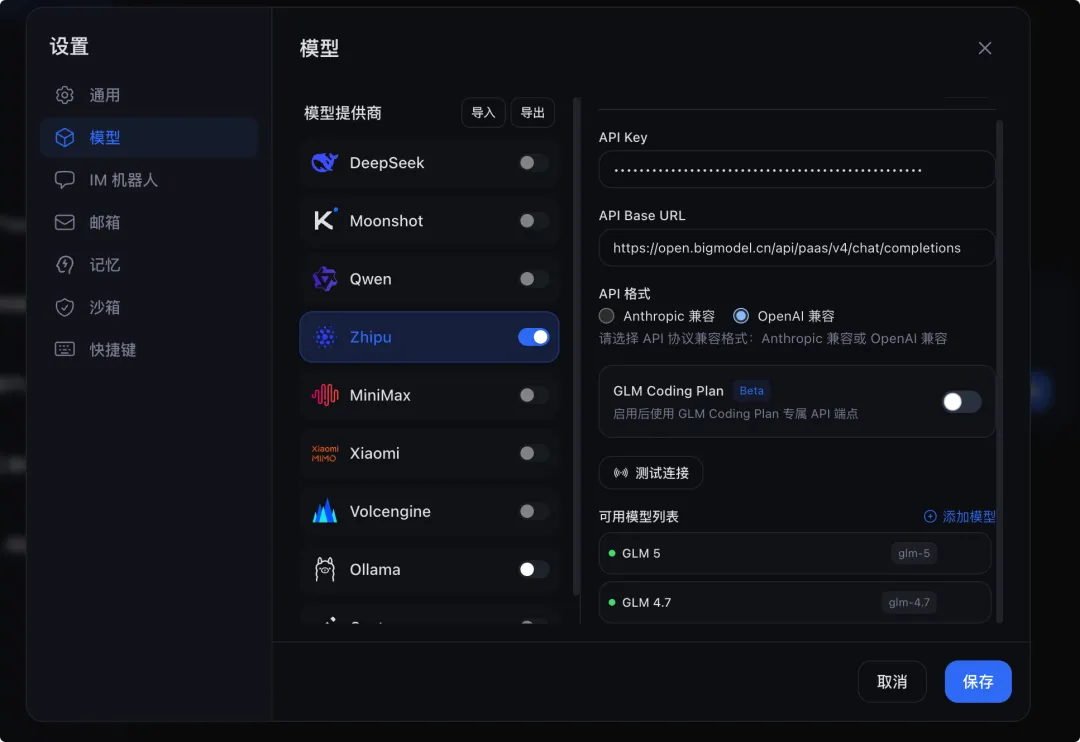

默认支持国内大部分的模型:GLM、MiniMax 都可以用,对接也很方便:

同样也有各种内置的 skills,在使用过程中它会自动调用现有的不同 skills 或者按照你的需求生成新的 skills

比如,我就用它构建了一个专门帮我搜索文章选题的 skill

随着和它沟通的越多,他给你反馈的结果就会越准确。

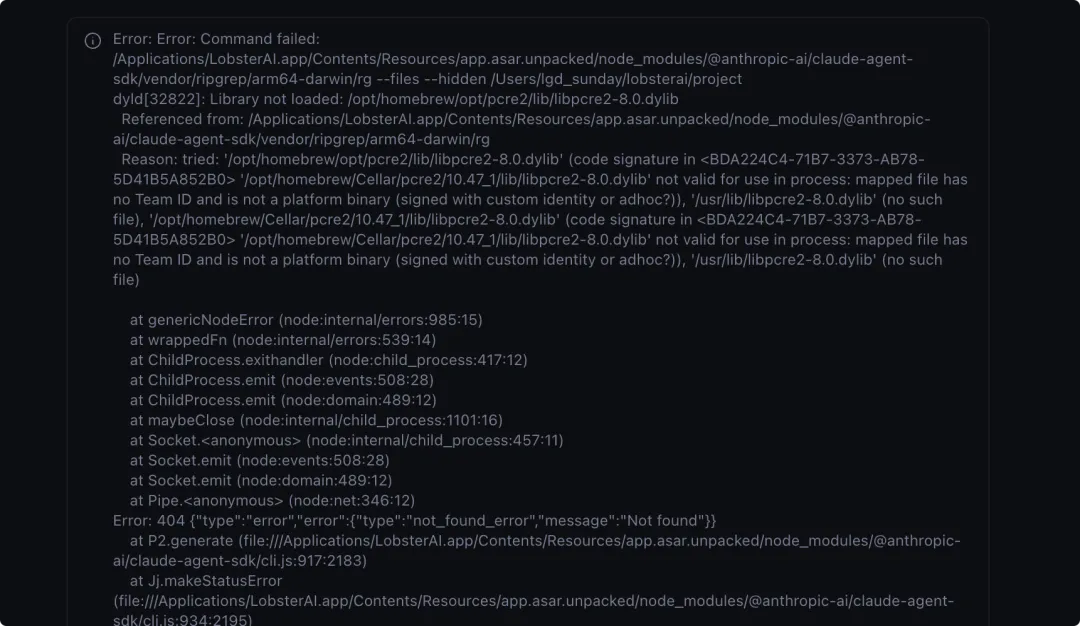

不过,在昨天使用的时候,也遇到了一些问题,比如这个:

错误指向到 安装包内的 claude-agent-sdk,但是我并没有使用到 Claude 的模型,用的是 GLM 5 的模型。

说实话,我不太确定这个错误代表了什么。有熟悉这块的同学可以分享下。

使用费用

这个工具是免费的,所有的费用主要来自大模型的 tokens 费用。

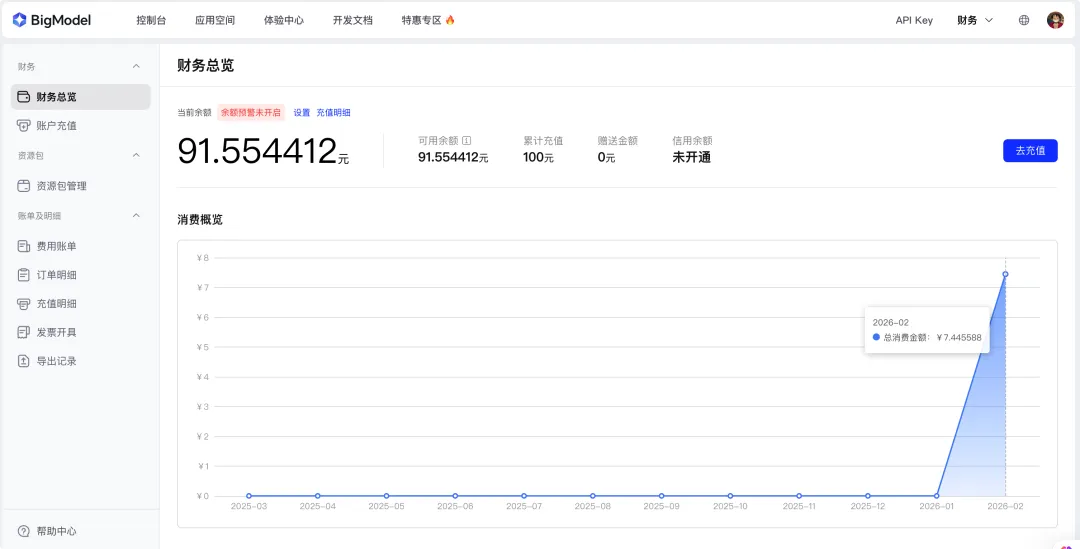

昨天,我使用 智谱的 GLM-5 的模型,构建了 3 个 skills,做了一些内容记忆。算是 轻度使用。

模型消费一共是花了 7.5 元。说实话 不便宜啊

大家可能对这个花费没太有概念,给大家举个更形象的例子。

这个费用消耗大致相当于:让他给你生成一个 500 ~ 800 行代码的组件,需要花费大约 1 ~ 2 元的费用

日常工作的时候重度使用,一天轻轻松松几百块。

很多同学可能会有疑惑:“在网页上对话使用不感觉贵呀?为什么使用 cursor 或者 龙虾这种 Agent 客户端感觉费用这么高呢?”

这个其实和 token 的计费有关。

先给大家普及一下 token 是啥。

简单来说,token 是一种对文本的编码方式,它把文本拆解成更小的单元,便于模型处理。对于大多数大模型来说,生成或理解的每个词语、标点符号、甚至是空格,都会被拆分成一个个的 token。

在大模型的计费模型中,token 就是费用的计算单位。

举个例子,OpenAI 和其他一些平台的计费标准基本上是:你发给模型的文本(包括历史记录、问题和指令)和模型给你回复的文本(包括生成的答案)都会按 token 来算费用。

比如说,你发送给模型的 100 字的对话可能会被拆解成 150 个 token,而模型返回的 200 字的答案可能会对应 250 个 token。那么,这 400 个 token 就是你这次对话的费用依据。

那么为什么使用 Agent 客户端的费用更高?

这是因为咱们在普通网页对话中,往往对话次数较少、上下文较短,消耗的 token 数量也较少。所以 看起来不贵。

但是,一旦你进入了像 Cursor 或 LobsterAI 这样的 Agent 客户端,这些工具通常会涉及到更复杂的交互,尤其是多轮对话或者是依赖外部工具(如搜索、编程等)的复杂任务时。

例如,你想让 AI 帮你编写一个爬虫,过程中可能会有 多次工具调用,每一次工具调用都可能会增加对话的上下文,而这些上下文会被一并带入到每次的请求中。

所以,在这些 Agent 客户端 中,每次调用和每次反馈 都可能会增加更多的 token 消耗。例如,你每次调用一个外部工具,或者模型修复代码、解析错误信息,都会带来更多的上下文信息,从而让 token 数量急剧增加。

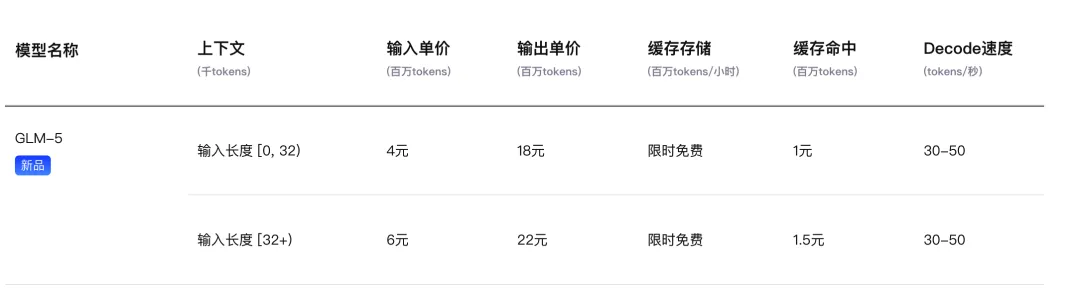

针对 GLM-5 这个模型来的,它的 token 收费是这样的:

这就不难理解为什么使用的过程中费用这么高了吧。😂

与之相比 DeepSeek 会便宜不少。

所以说,如果大家想要体现下 OpenClaw 但是又不想太过于折腾的话,那么这个平替工具也不错。

如果你没有编码需求,那么可以尽量选择一些便宜的模型。

刚刚好,才是性价比最高的选择嘛

如果你想第一时间收到我的文章推送,那么可以给我【设个星标⭐】 。感谢你的阅读🙏,咱们下次再见

其他推荐阅读

夜雨聆风

夜雨聆风