AI编程工具的2026十字路口

4月23号,Anthropic发了一篇工程博客,标题很克制,「关于近期Claude Code质量报告的更新」。

731条评论,941个赞。

我翻完了全文和评论区,说真的,看完心情挺复杂的。不是因为Claude Code出了问题,软件有bug太正常了,而是因为这篇postmortem里写的东西,暴露了一个更深层的问题,一个所有AI编程工具都在面对,但没人愿意直说的问题。

先说发生了什么。

三个bug,七周混乱

Anthropic承认了三个独立的问题,分别在不同时间影响了Claude Code的质量。

第一个,3月4号,他们把Claude Code的默认推理努力从「高」降到了「中」。原因是Opus在「高」模式下偶尔会思考太久,界面看起来像卡死了。内部测试显示,中等努力「智能略低但延迟显著降低」,看起来是个合理的权衡。

但问题在于,大多数用户根本不知道自己被降级了。他们只是觉得Claude Code变笨了,而且是一夜之间变笨的。

4月7号才回退。

第二个更离谱。3月26号引入了一个缓存优化的bug。本来设计是会话空闲超过一小时后清除旧的思考记录,减少恢复会话时的token成本。但实现上出了问题,它不是只清除一次,而是会话剩余的每一轮都持续清除推理历史。

你跟Claude聊得越久,它越健忘。它会忘记自己为什么做了之前的修改,忘记之前调用过什么工具。如果中间你还发了个消息,当前轮的推理也会被丢掉。

这个bug存活了15天。

第三个,4月16号,为了减少Opus的冗长输出,他们加了一条系统提示词,限制工具调用之间的文字不超过25个词,最终回复不超过100个词。

结果性能下降了3%。

三个问题叠加在一起,持续了大约七周。用户的感受是Claude Code的质量在「随机波动」,有时候还行有时候突然就不行了。因为三个bug影响的模型和时间段不完全重合,所以表现出来的症状不一致,调查起来非常困难。

4月20号全部修复。

社区炸了

HN评论区才是真正有意思的地方。

Anthropic的工程师Boris亲自下场回复,这个姿态本身很加分。他详细解释了KV cache的成本结构,团队尝试过的三种方案,承认「我们本应该预见到用户不会主动修改默认值」。

但社区的不满并没有因为坦诚而消散。

一条被大量点赞的评论说,「人们在你更改默认值后立刻就发现了问题。尽管有大量报告,你仍然保持了一个月。然后你发布了一个完全未测试的功能。」

另一条更尖锐,「A/B测试是目前最令人反感的行为。其实就是悄悄给一部分用户一个完全不同的产品。」

有人已经开始用脚投票,「Opus 4.7让我彻底失望,过去30天几乎没见GPT5.4犯错」。还有人直接取消了Max订阅。

最让我触动的一条评论是这样的,「你大可以收够实现最高质量的费用,我会付。但别他妈的在我身上做A/B测试。」

这句话背后的逻辑其实很清晰,用户不怕贵,怕的是不知道自己花了多少钱,拿到了什么质量。

Copilot也炸了

巧了。几乎同一时间,GitHub也干了件让开发者炸锅的事。

4月27号,GitHub宣布Copilot将在6月1号转向用量计费。

552条评论,759个赞,情绪比Claude Code那边还激烈。

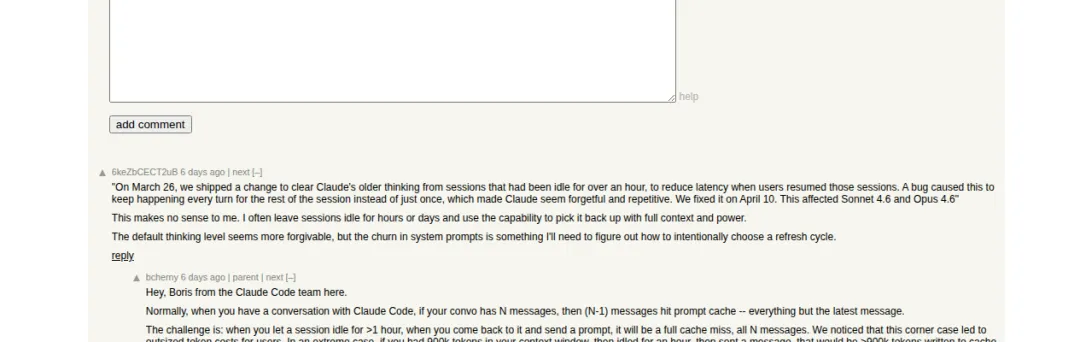

之前的计费模式是按请求数算,每个请求消耗一定数量的Premium Request Units。用完了还可以回退到低成本模型继续用。

新模式用AI Credits替代,按实际token消耗计费。听起来很合理对吧,谁用得多谁多付。

但社区算了一笔账。

模型倍率的变化是这样的,GPT和Sonnet从1倍跳到6倍,Opus从3倍跳到27倍。有人指出,在10美元的月费计划上,如果你让agent不停跑Opus,理论上可以用掉价值500美元的tokens。

所以之前的定价其实就是亏钱的。GitHub现在要把这个窟窿堵上。

问题在于,堵窟窿的方式让用户觉得自己被骗了。

一条评论说,「花10块还必须在月底前用完,而直接向API提供商买10块可以用多久都行。GitHub的API定价和提供商一模一样,那我为什么还要通过GitHub?」

另一条,「按使用付费的AI比手机按短信收费还疯狂1000倍,你连想要的结果都不一定能得到,但你已经为尝试付了钱。」

还有一条我觉得特别精准,「我喜欢Copilot是因为不用考虑tokens。按使用计费让我要像关注天然气账单一样关注token使用,很难同时专注于项目本身。」

十字路口的矛盾

这两件事几乎同时发生,我觉得不是巧合。

它们共同指向了一个根本性的矛盾。AI编程工具正处于一个十字路口,左手边是「让AI尽可能聪明」,右手边是「让成本可控」。

Anthropic选择了暗中降级智能来控制成本。三个独立变更的共同目标都是减少token消耗和延迟。推理努力从高降到中,是为了减少思考时间。缓存优化是为了减少GPU内存占用。限制输出字数是为了减少生成成本。每一个单独看都有合理的技术理由,但叠加在一起就是用户感知到的「变笨了」。

GitHub选择了把成本直接转嫁给用户。之前是补贴模式,10块钱随便用。现在变成10块钱的credits,用完就没有了。Opus的倍率从3倍涨到27倍,等于同一个操作成本翻了9倍。

两种策略,一种结果,用户的体验都在变差。

为什么会走到这一步

但我想聊的不是该骂Anthropic还是该骂GitHub。

我觉得真正值得想的是,为什么会走到这一步。

答案可能就藏在一条HN评论里,「事后看,如果一个agent在一次请求中可以消耗差异巨大的token量,按请求计费根本说不通。这些定价方案是在编码agent改变token使用动态之前设计的。」

这话说到点子上了。

一年前,AI编程工具还是「你打几个字,它补全一行」。现在,Claude Code可以跑一个多小时,自主完成跨文件的代码重构。Devin可以自己建项目、写代码、跑测试、修bug。这些agent一次任务的token消耗可能差100倍。

旧的定价模型是按「补全一行代码」设计的。新的使用方式是「帮我重构整个模块」。成本差了几个数量级,但价格没变。

这不是哪家公司的问题,这是整个行业在从「工具」走向「agent」的过程中,必然要面对的成本重构。

普通开发者怎么应对

那对我们普通开发者来说,怎么应对?

我自己有几点不成熟的想法。

第一,别把鸡蛋放在一个篮子里。这次事件里最明智的做法是那些同时用Claude Code和GPT的开发者,一个出了问题无缝切到另一个。AI编程工具的忠诚度不该太高,谁好用用谁。

第二,关注API直接调用。如果Copilot的credits定价和直接调API一样,那通过Copilot中间层的价值在哪里?代码补全确实还免费,但核心的agent功能,直接用API可能更灵活也更透明。

第三,成本意识必须建立起来了。之前AI编程工具便宜得不像话,那是补贴换市场。补贴总会结束的。学会估算一个任务大概消耗多少tokens,大概值多少钱,这是2026年开发者的基本素养。

第四,开源方案值得关注。HN评论区有人提到,如果Claude Code开源,这些问题可能早就被发现了。不是所有东西都要靠厂商的postmortem来知道出了什么问题。Cursor Camp的628个赞也说明,社区在用自己的方式推动AI编程工具的普及和透明。

AI编程工具到底在卖什么

最后说点我自己的感受。

我一直在想一个问题,AI编程工具到底在卖什么。

卖的是「帮你写代码」?那你直接调API就行了。卖的是「帮你写好代码」?那质量就不能降。卖的是「帮你省心」?那按用量计费就不省心。

Anthropic的postmortem写得很好,坦诚、技术细节到位、改进措施具体。但「坦诚」是事后补救,不是事前保障。用户信任你,把代码交给你写,你暗中降低了智能,哪怕理由再合理,这份信任也已经受损了。

GitHub的计费变更从商业逻辑上完全说得通。补贴不可持续,按量付费是必然。但「说得通」和「让人舒服」是两回事。一个程序员在写代码的时候还要分心算tokens,这个体验已经背离了Copilot最初「你的AI配对程序员」的承诺。

2026年的AI编程工具行业,正在经历一个从「野蛮生长」到「精打细算」的转折。野蛮生长阶段,用户享受了远超付费的价值。精打细算阶段,每一分钱都要算清楚。

这对用户来说未必是坏事。当价格回归合理,当厂商不能再靠补贴掩盖产品问题,真正的好产品才能脱颖而出。

只是这个转折期,会有点疼。

对了,Anthropic在postmortem最后做了一件事,重置了所有订阅用户的使用限额。这个动作本身比任何承诺都实在。

而GitHub给了6月1号这个时间点,还有一个多月。如果你是年付用户,该算算账了。

💬 互动话题:

你现在的AI编程工具月均花费大概是多少?Claude Code和Copilot这两件事之后,你会考虑换工具或者调整使用方式吗?

欢迎在评论区聊聊你的看法。如果觉得文章有价值,点赞+在看让更多开发者看到,关注「AI驾座」持续获取AI编程实战干货。

我是AI驾座,专注AI编程实战和工具拆解。下次见。

夜雨聆风

夜雨聆风