AI从业者学习周刊 #061 | 多云分发落地、云厂商开始交财报答案、B端 从“能对话”进入“能执行”的一周

导语

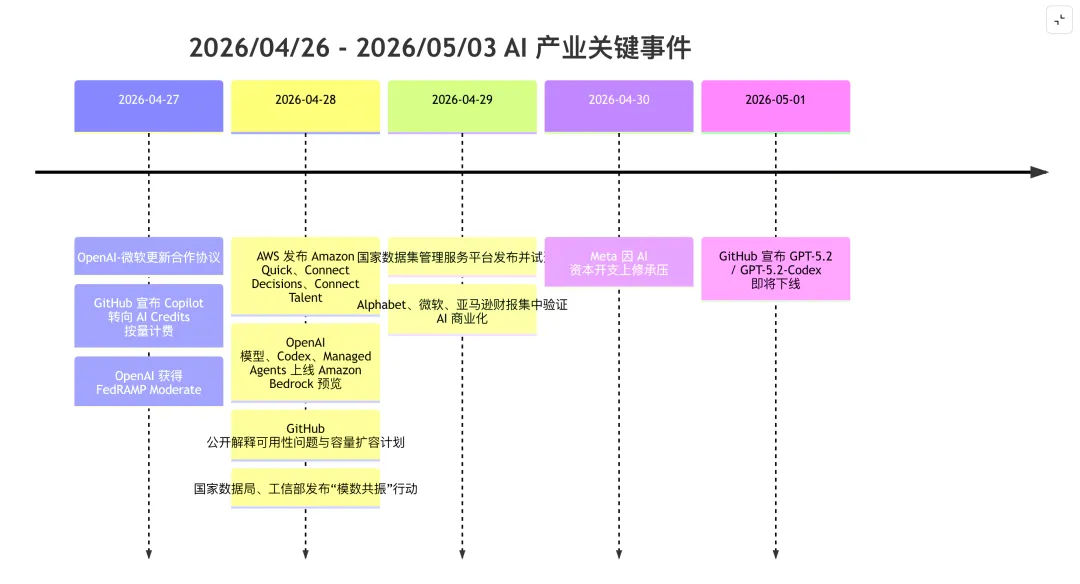

时间窗:2026 年 4 月 26 日—2026 年 5 月 3 日。

这周最重要的变化,不是又有哪家模型刷新了榜单,而是 OpenAI、微软 与 亚马逊云科技 共同把“模型—云—企业分发”这条链路重新改写了一遍:合作不再是单云独占,而是转向“主云优先 + 多云可分发”。

与此同时,财报给出了更清晰的回报结构:Alphabet 的云业务 63% 增长、GitHub 将 Copilot 改为按 token/AI Credits 计费、平台公开承认 AI 开发活动已把容量设计从 10 倍推到 30 倍,这些都说明 AI 已经从“概念溢价”走到“运行时成本、平台容量与计费方式同步重构”的阶段。

在中国侧,国家数据局 与 工业和信息化部 连续给出“模数共振”行动与国家数据集管理服务平台两条政策/基础设施信号,意味着 B 端 AI 的下半场不只是买模型,而是把数据集、评测、特色智能体、运行环境和行业场景一起做成可运营的执行栈。

上面的时间线对应的关键节点,分别来自微软与 OpenAI 官方说明、AWS 官方发布、GitHub 官方博客/Changelog、国家数据局官方公告,以及主流媒体对财报与市场反应的报道。

本周核心看点

- 多云分发正式坐实。 OpenAI 与微软把原本更强排他的合作关系改成“Azure 仍是主云,但 OpenAI 产品可分发到任何云”,随后 OpenAI 当天就把模型、Codex 和 Managed Agents 带到 AWS,这不是普通渠道扩展,而是企业 AI 分发权重构。

- B 端价值开始从“提效”升级成“执行”。 AWS 同天推出 Amazon Quick、Connect Decisions、Connect Talent,覆盖桌面助手、供应链计划、招聘执行等场景;微软则用多个客户案例证明,企业正在把 AI 嵌入客服、决策、IT、安全和经营管理链路。

- 成本与治理开始显性化。 GitHub 一边把 Copilot 计费改成基于 token 的 AI Credits,一边承认 AI 驱动的软件开发行为已把平台扩容目标从 10 倍推到 30 倍;中国这边则把高质量数据集、模型评测、特色智能体和统一平台纳入制度与基础设施建设。

三条主线

多云分发从“例外”变成“新默认”

发生了什么

4 月 27 日,微软与 OpenAI 同步发布修订后的合作协议:微软仍是 OpenAI 的主云合作伙伴,但 OpenAI 已可将全部产品向任何云客户分发;微软对 OpenAI IP 的授权延续到 2032 年,但改为非独占。4 月 28 日,OpenAI 又正式宣布把 GPT‑5.5、GPT‑5.4、Codex 以及 Amazon Bedrock Managed Agents(powered by OpenAI)带到 AWS;AWS 官方也给出对应发布,强调统一安全、治理、IAM、PrivateLink、CloudTrail 与 AWS 采购/结算体系。

为什么重要

这意味着企业采购 AI 的入口,正在从“买某一家模型 + 绑定某一家云”,转向“在现有云控制面里调用最强模型与代理运行时”。换句话说,模型能力仍然重要,但真正决定采购落地速度的,越来越是你能否进入现有 IT 权限体系、审计体系、预算体系与合规体系。AWS 在官方文案里几乎把答案写明了:企业要的是最强模型,同时也要生产级安全、治理与运营成熟度。

对 B 端的含义

对企业而言,这周一个非常清晰的结论是:“模型层”和“云控制层”正在解耦,但不会完全去锁定。 旧时代的基础设施锁定没有消失,只是从“必须用某云才能用某模型”,变成了“你可以在多云环境里选模型,但真正的权限、日志、预算、连接器、运行时、承诺消耗,仍由各家云控制面定义”。这会直接影响企业未来对业务执行链路的架构设计。 如果你的团队想做的是高频、强治理、跨系统的 AI 落地,问题已经不再是“用 GPT 还是 Claude”,而是“放在哪个执行层里跑,谁管身份权限,谁吃成本,谁做审计与故障兜底”。

还需观察

接下来要看三件事。第一,其他云平台是否会继续引入更多头部模型与代理产品。第二,企业会不会接受“模型多云可选,但运行时仍锚定各云专有控制面”的新形态。第三,OpenAI 与微软关系放松后,Azure 自身的 AI 平台价值会更多体现为基础设施与企业分发,而不是独占模型。后两点目前方向明确,但具体份额和节奏仍未确定。

财报开始区分谁在“烧钱”,谁在“把 AI 烧成收入”

发生了什么

4 月 29 日前后,几家超大云厂商集中交卷。Alphabet 的 Google Cloud 一季度收入同比增长 63% 至 200 亿美元,并首次把“企业 AI 解决方案”定义为云业务的主要增长引擎;公司还开始对部分客户直接销售 TPU,并将全年资本开支预期上调至 1800 亿—1900 亿美元。微软披露 Azure 和其他云服务收入增长 40%,同时其 AI 业务年化收入运行率已超过 370 亿美元。亚马逊则披露 AWS 收入同比增长 28% 至 376 亿美元,CEO 安迪·贾西维持全年 2000 亿美元 AI 投资目标。反过来,Meta 虽然收入增长仍然很强,但因 2026 年 AI 资本开支上修到 1250 亿—1450 亿美元、且缺少类似云业务的即时回报口径,市场反馈更谨慎。

为什么重要

这周财报给市场画出了一条更清晰的分界线:当 AI 资本开支进入数千亿美元级别后,资本市场只会更偏爱“有可验证收入回路”的投入。 Alphabet 可以用云增长和 TPU 商业化去解释 capex;微软可以用 Azure 与 AI run rate 去解释 capex;亚马逊则用 AWS、芯片业务和 Bedrock 活跃度去解释 capex。Meta 的问题不是它没有 AI 进展,而是它的回报路径更多体现在广告质量提升和未来消费级产品,离“当期、清晰、可审计”的 B 端收入更远。

对 B 端的含义

这对企业采购非常关键。因为它意味着接下来最稳的供给,会优先出现在那些已经把 AI 变成云收入、工具收入、平台收入的执行栈上。企业在选供应商时,要把“模型分数”降一档,把以下问题提到前面: 第一,是否能给出稳定 SLA 和可观测运行时。 第二,是否能把成本拆到 token、调用、任务、部门预算这一级。 第三,是否能在合同、日志、合规、预算池上与现有采购体系衔接。 这也是为什么 GitHub 本周会把 Copilot 改成按 AI Credits 计费——当代理从一次问答变成长时间、多步骤执行后,按 seat 或按 request 计费都会失真。

还需观察

接下来要持续看两组指标:一组是云收入增长能否继续显著高于整体收入;另一组是企业侧 AI 预算会不会从“创新试点预算”转为“生产系统预算”。如果后一组发生,年内 B 端市场会更快转向按计算、按任务、按部门成本中心来管理 AI 使用,而不是按单一 seat 购买。这个趋势很强,但组织层面的转化速度仍未确定。

执行层开始进入具体岗位,数据底座同步补课

发生了什么

AWS 在 4 月 28 日一口气把 Amazon Quick 与 Amazon Connect 拆成更明确的业务执行层产品:Quick 推出桌面应用,可直接读本地文件、做桌面通知、操控桌面与浏览器任务,并强调个人知识图谱、MCP 连接和跨端共享记忆;Connect Decisions 面向供应链计划与异常处理,Connect Talent 面向招聘,能够做结构化语音面试、测评和候选人筛选。微软同周用多个客户案例展示,AI 正在进入客服、经营分析、安全响应、教育、交通与银行服务的具体执行链路。中国侧,国家数据局与工信部发布“模数共振”行动,明确要围绕重点行业形成高质量数据集、行业模型、特色智能体、评测体系与“模数共振”空间;第二天,国家数据集管理服务平台正式发布并启动试运行,提供目录、凭证申领、质量测评、供需发布与全生命周期公共服务能力。

为什么重要

这说明本周最值得重视的,不是“智能体更多了”,而是执行层开始被产品化、场景化、制度化。 Quick 代表的是“个人与团队协作执行层”;Connect Decisions/Talent 代表的是“职能型执行层”;中国政策代表的是“行业型执行层”的供给建设。它们共同指向同一件事:企业不会长期为一个只会聊天的 AI 付钱,但会为一个能进入权限体系、连接真实系统、完成多步骤业务执行、且可以被治理和计量的 AI 付钱。

对 B 端的含义

如果把 B 端 AI 拆成执行栈,本周已经把几个关键层补齐了:

- 数据层:高质量数据集、目录、凭证、质量测评、平台联通。

- 模型层:头部 frontier 模型可在既有云环境中调用。

- Harness / 运行时层:Managed Agents、Codex on Bedrock、Quick 的桌面/MCP/知识图谱,都在把代理从“提示词工程”升级成“可运行、可观察、可约束”的执行层。

- 应用层:招聘、供应链、客服、分析、安全等具体岗位开始出现可直接采购的产品。

- 计费层:GitHub 的 AI Credits 是最直接的信号——未来企业不会只按 license 管 AI,而是会把 token、缓存 token、代码评审分钟数、预算池和成本中心一起纳入管理。

把这些信号交叉起来看,我的判断是:B 端竞争正在从“谁更像一个助手”,转向“谁更像一套可闭环的业务执行系统”。 一套真正能落地的方案,至少要把“数据—模型—运行时—工具权限—治理审计—计费”串起来。单点能力再强,如果接不上企业的执行链路,也只能停留在试点。这个判断属于基于本周多源信号的综合推断。

还需观察

接下来最大的变量有两个。其一,企业究竟更愿意买“通用执行层 + 自己接场景”,还是直接采购“招聘版、供应链版、客服版”的垂类产品。其二,国内围绕高质量数据集、特色智能体和统一平台的政策框架,能否尽快形成一批可复制的行业样板。这两件事都会直接影响 B 端 AI 从试点迈向预算常态化的速度,目前仍有相当不确定性。

技术部分

说明:以下榜单按 2026 年 5 月 3 日读取 GitHub Trending 的 “This week” 页面整理;因全站周榜包含非 AI 项目,本文只保留 AI / 智能体 / 开发者基础设施相关仓库。GitHub 周榜按滚动周期统计,与自然周 4/26–5/3 之间可能存在小时级偏差,但总体对应本周趋势。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

本周热榜深读:为什么几乎都是 Harness / 运行时相关项目?

因为 AI 编程生态正在从“模型中心”转向“执行层中心”。

本周热榜前列不是新的大模型仓库,而是四类基础部件:

- 技能层:skills、andrej-karpathy-skills。

- 适配层:free-claude-code 这类代理入口和后端模型解耦器。

- 上下文层:GitNexus 这种把代码资产转成知识图谱/MCP 的系统。

- 领域执行层:TradingAgents 这种把具体职能链路做深的项目。

它们和本周 AWS / OpenAI / GitHub 的官方动作几乎一一对应:云厂商在做 Managed Agents、桌面入口和企业控制面;开源社区在补技能包、代理外壳、上下文引擎和领域执行层。两边拼起来,才是企业真正会采购的执行栈。

本周信号总览表

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

下周观察点

多云分发会不会迅速复制到更多头部模型。 如果更多 frontier 模型出现在多家云平台,企业采购将更像“多云上的模型证券化”,而不是“绑定单家供应商”的重资产决策。

GitHub AI Credits 会不会带来更广泛的企业级 AI 成本管理范式。 如果开发、代码评审、长时代理执行都开始 token 化、分钟化、预算池化,其他企业 AI 平台很可能跟进。

国内“模数共振”行动会率先在哪些行业跑出样板。 从政策文本看,制造、汽车、医药、信息通信、网络安全等都被点名;谁先做出可复制的行业数据集与特色智能体,谁就会占据下一阶段 B 端入口。

B 端采购会更偏“通用执行层”还是“垂类执行层”。 AWS 本周同时押注 Quick 和多个职能型产品,这说明市场可能两条路并行:一条是统一执行平台,一条是直接买成品。真正决定胜负的,将是连接器、权限、日志、预算与合规,而不是单纯模型效果。

总结

这一周真正落地的,不是“更强的 AI”,而是“更像企业系统的 AI”:它开始进入云控制面、进入岗位、进入预算、进入数据治理,也开始进入真正的业务执行链路。

夜雨聆风

夜雨聆风