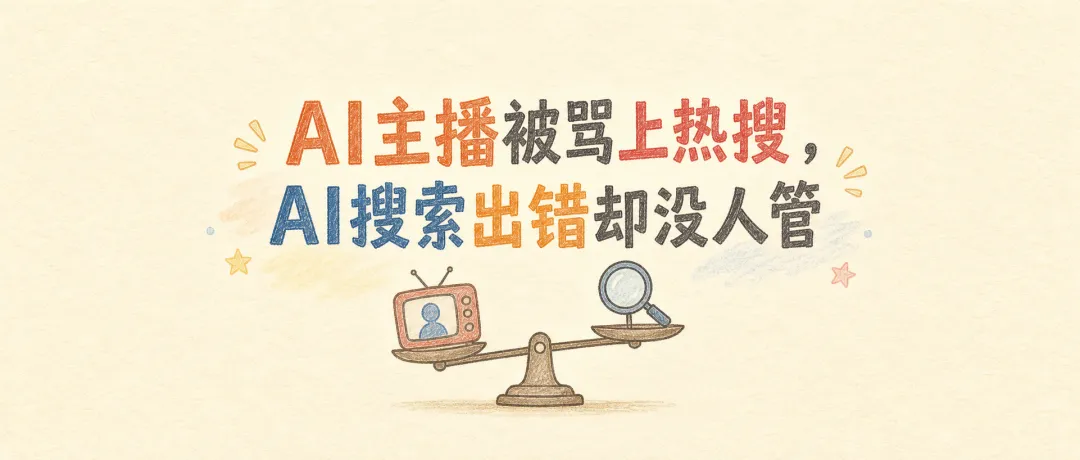

湖南台AI主播被骂上热搜,AI搜索每小时5700万条错误却没人管

有没有觉得,我们对AI的态度,正在变得越来越分裂?

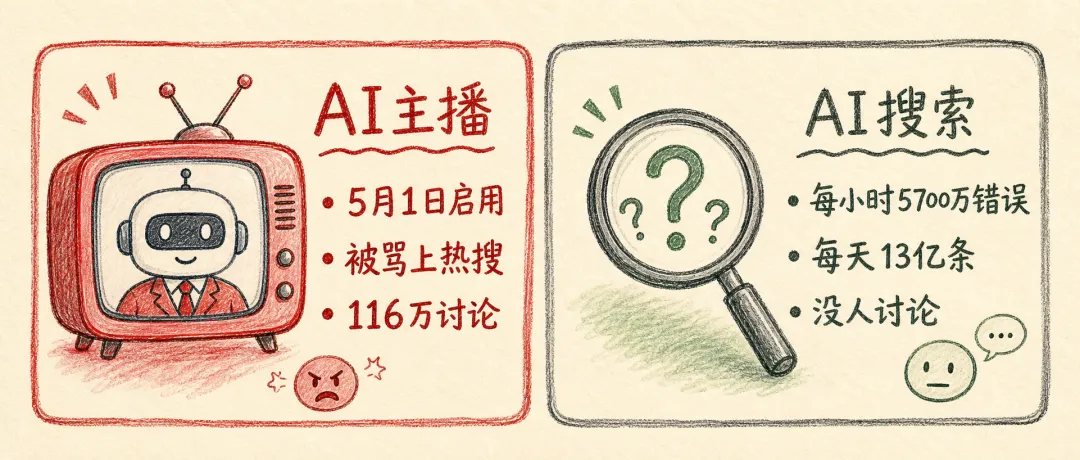

这个五一假期,发生了一件非常有意思的事。湖南经视在《经视新闻》里正式启用了AI主播”生生”和”双双”,24小时轮播新闻,画面右上角老老实实标注了”AI生成”的字样。按说做得还挺规范的,对吧?结果呢,直接被骂上了微博热搜,讨论量冲到了116万次。网友的评论我看了几页,核心就是说”冷冰冰的,没灵魂””看新闻就是看人的,谁要看一个假人播报””真人主播是不是要失业了”。

好的,这可以理解,大家担心AI抢饭碗嘛。

但同一天,另一件事也在发生。《纽约时报》联合Oumi公司做了一个测试,发现Google的AI搜索概述功能——就是你在Google搜东西时,第一个跳出来的那个AI生成的大段答案——虽然准确率号称有91%,但因为基数太大了,每小时仍然会产生超过5700万条错误信息,每天累计超过13亿条。更扎心的是,超过半数的”正确回答”,引用的链接根本支撑不了结论。换句话说,你看到的AI答案,有一半以上可能经不起推敲。

而这条新闻,除了少数科技媒体在报道之外,没有人骂,没有人吵,没有人上热搜。

一个AI主播念错一个字,全网暴怒。一个AI搜索每天喂给上亿人错误信息,无人问津。同一个五一,同一种技术,两种截然相反的待遇——这难道不是我们这个时代最荒唐的双标吗?

01|湖南台这个AI主播,到底惹了谁

先说说湖南台这事具体是怎么回事。

5月1日起,湖南经视正式在《经视新闻》里使用AI主播,名字起得还挺有特色——”生生”和”双双”,取自”生生不息、好事成双”的意思。这两个AI主播在五一假期期间进行常态化新闻播报,部分时段采用”AI+真人”衔接的方式,画面右上角全程标注了”AI生成”字样,还搭配了AI导播实现画面的自动切换。

说实话,从技术角度看,这已经算是一个非常”有良心”的部署了。标注了来源、没有完全替换真人、只用在节假日期间。湖南广电自研的”芒果大模型”也确实有两把刷子,AI主播能根据新闻内容实时调整情绪——严肃新闻沉稳庄重,民生新闻亲切自然。比起那些在直播间里尬聊的数字人,这个技术完成度是相当高的。

但观众不买账。

“为什么要看一个假人说话?””这新闻还能看吗?””以后是不是所有电视台都要这样了?”这些声音在微博上刷了屏,讨论热度超过116万次。很多人表达的是同一种焦虑:当连新闻播报这种”需要人的温度和表情”的工作都被AI替代了,那真人还能做什么?

这个焦虑本身没有错。但问题在于——我们似乎只会在AI看起来像人的时候感到焦虑。一个AI主播在电视上对着你念稿,你能一眼识别出它是AI,于是你愤怒了。愤怒是一种本能反应,我可以理解。但愤怒之前,你有没有想过,那些你根本识别不出来是AI的东西,正在怎样影响你?

02|AI搜索的5700万次错误,比AI主播可怕一万倍

2026年4月,《纽约时报》和Oumi公司联合发布了一份关于Google AI搜索的研究报告。我说几个数据让你感受一下。

Google的AI Overviews功能——就是你在搜索框打字之后,排在第一条的那个大大的AI生成的答案框——它在测试中的准确率大约是91%。也就是说,10条AI答案里,有9条左右是对的,1条是错的。这个准确率听起来还不错,对吧?但是,Google每天要处理数十亿次搜索请求,而AI概览功能已经覆盖了绝大多数搜索结果。1%的错误率,乘以几十亿的量级,得出的数字就是:每小时超过5700万条错误信息,每天超过13亿条。

你可能觉得,13亿条错误又怎样?我又不是每条都看。

但问题恰恰在这里。你还记得上次你用AI搜索查东西是什么时候吗?可能是查一个历史人物生卒年,可能是查一个产品的价格,可能是查一个新闻事件的时间线——你大概率没有去核实AI给你的答案,因为你默认它是权威的。Google在你心里一直是个靠谱的搜索引擎,它给的答案应该是准的。

研究还发现了一个更严重的问题:超过半数的”正确回答”,引用的链接根本支撑不了结论。也就是说,AI可能给出了一个看起来正确但实际上站不住脚的答案,而你根本无从分辨。

想象一下这个场景:你搜”某种药有没有副作用”,AI回答你说”没有”,但你不知道这个答案引用的是一个营销博客。你信了,照吃。或者你搜”某个政治人物的背景”,AI给你编了一段半真半假的生平,你信了,还在朋友圈转发。这些事情正在发生,每小时5700万次。

但没有人骂,没有人吵,没有人上热搜。

为什么呢?因为你根本不知道那是错的。AI主播一看就是假的,你愤怒。AI搜索看起来是真的,你信了。这就是问题的关键——我们恐惧看得见的假,却对看不见的假毫无防备。

03|为什么反差这么大?我琢磨了三个原因

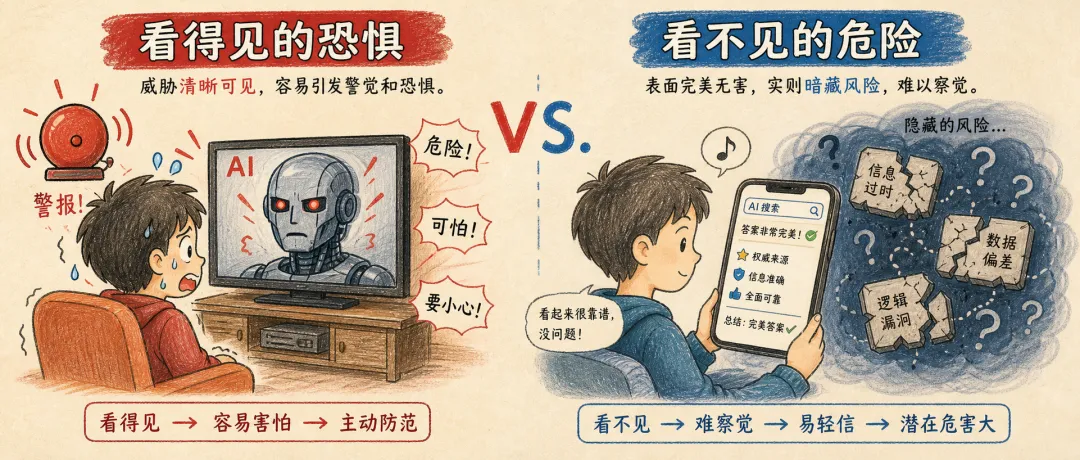

第一个原因,也是最简单直接的一个:看得见的vs看不见的。

你打开电视,看到AI主播那张脸——虽然技术已经能做到”几可乱真”,但你还是能感觉到不对。微表情的缺失、语气的机械感、眼神的空洞——这些细节在你大脑的恐怖谷区域疯狂报警:”这不是真人!”你的愤怒是直觉的、原始的、不需要思考的。就像你看到一碗看着像饭但其实不是饭的东西,直觉反应是反感。

而AI搜索的错误,藏在每一个看起来一本正经的答案后面。你看到的是一个结构严谨、语气自信的段落——它看起来就像一个正确答案应该有的样子。你没有理由怀疑它,因为你没有途径知道它错了。你在不知情的情况下被喂了错误信息,然后信以为真,然后继续使用——整个过程你毫无察觉。

一个让你不舒服但无害,一个让你舒服但有毒。 你选哪个?大多数人本能地选了前一个去骂,后一个去用。这就是人性,没什么好批判的,但值得我们停下来想一想。

第二个原因:新闻是情感产品,而搜索是工具。

我们看电视新闻,不是为了获取”信息”——信息我们可以看文字。我们看新闻是想获得理解、共鸣、判断。我们想知道”这件事应该怎么看””这个事件是什么性质”。这些是靠人来提供的,因为人有人格、有经历、有判断力。当AI主播面无表情地念一条灾难新闻的时候,你会觉得”太冷血了”——因为你需要的不是一个念稿工具,而是一个理解你感受的传递者。

而搜索是工具。你搜”附近有什么餐厅”,它给你一个列表,你拿了就走。你不是去搜索页面寻求情感共鸣的。所以即使AI搜索给你一个错的答案,你也只是觉得”不好用”,而不会觉得”被冒犯”——但AI主播让你觉得被冒犯了。

这就是本质区别:AI做工具,我们接受。AI做人;,我们抗拒。 问题在于,AI搜索虽然是个”工具”,但它干的却是”影响你认知”的事。一个错的餐厅推荐最多让你吃一顿难吃的饭,但一段错的新闻摘要、一个错的历史结论、一条错的健康建议——这些是会改变你认知的东西。而这些东西,正在以每小时5700万次的速度发生着。

第三个原因,也是我最想说的:我们恐惧的方向可能错了。

我们恐惧AI”取代人类”,看到AI主播就大喊”不要抢饭碗”。但对AI”扭曲信息”这件事——也就是AI更隐蔽、更危险的破坏力——却毫无戒心。一个AI主播念错一个字你暴怒,AI搜索给你一篇假文章你收藏转发。我们花大量精力讨论”AI会不会取代我们”,却几乎不讨论”AI给我们看的东西是不是对的”。

这就像你花了几百万装了一扇防盗门,却在窗户上贴了一层纸。你防错了方向。

04|真正的危险,是AI看起来”不像AI”

我越来越觉得,AI最可怕的能力,不是它”像人”,而是它”看起来不像AI”。

你看到一个AI主播在播新闻,你一眼就知道那是AI,于是你警惕了、质疑了、反感了。这是你的保护机制在工作。但当你用AI搜索查东西的时候,那个答案看起来就是一个正常的、权威的、可信的答案——它没有告诉你”我是AI生成的”,没有右上角的”AI生成”标签,没有让你产生任何警惕心。你接收了它,毫无防备。

这就是为什么我说:AI越不像AI,就越危险。 一个假到让你一眼识破的AI,其实是最安全的AI。因为它骗不了你。真正危险的是那种你不觉得是AI的AI——它混进了你的信息来源,混进了你的认知框架,它悄悄改变了你的判断,而你还以为是自己的想法。

你刷到一个AI写的营销软文,以为是一个博主真诚的分享,下单了。你搜到一个AI编的历史段子以为是真的,下次跟朋友聊天时当谈资说了出去。你看到一条AI生成的新闻摘要,以为是权威媒体的判断,形成了自己的观点——而你从来没有怀疑过,因为你根本没有任何线索告诉你这是AI干的。

AI主播被骂,是因为它被识别了。AI搜索没人骂,是因为它没被识别。 被识别了就不危险了——你的警惕心就是最好的防火墙。没被识别的才是真正的雷。

05|我不是反对AI

说了这么多,我得把立场说明白:我不是在反对AI,我是在反对我们对待AI的态度。

湖南台用AI主播这事儿,我真的觉得没那么严重。它标注了”AI生成”,只在假日时段使用,人机协作的方式本身就是一个比较负责任的尝试。网友的担忧可以理解,但把它骂上热搜,说实话有点过了。

相比之下,AI搜索的错误问题——这个每天每小时每分每秒都在发生的事情——才真的应该让我们坐不住。但恰恰是这件事没有人讨论,没有人焦虑,没有人上热搜。

我们花了太多精力讨论AI像不像人,却忽略了它喂给我们的是不是对的。

所以我的建议很简单:下次你用AI搜索查东西的时候,多留个心眼。别因为答案看起来”专业”就100%相信。多查一个来源,多问一句”这个引用靠谱吗”。你不需要成为AI专家才能保护自己——你只需要知道一件事:AI和人一样,会犯错。区别在于,人犯错你骂他,AI犯错你什么都不知道。

这个区别,才是真正值得焦虑的事情。

你在用AI搜索的时候,有没有遇到过明显不对的答案?欢迎在评论区分享一下,让更多人知道AI也靠不住~

夜雨聆风

夜雨聆风