AI进入国家社科重点方向后,学术出版该关注什么

5月6日,全国哲学社会科学工作办公室发布《2026年国家社会科学基金年度项目申报公告》。对编辑部来说,这份公告最该细读的地方,不只是申报时间、资助额度和材料要求,而是附件1里的那组重点研究方向。

“人工智能发展和治理”“科技伦理”“语言文字信息化数智化”“数字人文”“人工智能驱动哲学社会科学研究范式转变”“大众学术传播”等表述,同时出现在同一份方向清单中。

这不是在提示谁把“人工智能”四个字写进题名。至少在笔者看来,它更像是在提醒学术出版:AI已经从投稿工具、写作风险,进入了研究问题、证据组织、伦理责任、成果管理和知识传播的全过程。

但公告对编辑部仍然有意义。因为它提供了一张观察图:未来一段时间,AI相关论文可能会更多地进入社科研究、期刊审稿和成果出版环节。编辑部需要准备的,不是简单地“多收AI稿件”或“严防AI写作”,而是重建一套更细的判断。

过去很多期刊谈AI,先想到的是AIGC披露、查重、润色、翻译、审稿保密。这些当然要管。但如果只停在投稿工具层面,容易看窄了问题。公告里的相关方向显示,AI已经同时成为治理对象、研究方法和知识传播机制的一部分。

比如,“人工智能发展和治理”“科技伦理”,指向的是算法责任、数据权利、偏见控制、透明度和技术治理;“数字人文”“语言文字信息化数智化”,关系到材料整理、语料建设、知识组织和中文学术表达;“人工智能驱动哲学社会科学研究范式转变”,则把问题推到了更深处:研究者如何提出问题、处理材料、生成证据、解释结论,都会受到影响。

这就要求编辑部在判断AI相关论文时,多问几句。AI在这篇文章里到底是什么?是研究对象,还是分析工具?是数据来源,还是写作修饰?作者有没有说明模型如何参与研究,输出如何验证,偏差如何控制?

如果去掉“人工智能”四个字,一篇论文的问题意识、材料基础和结论几乎没有变化,那它大概率不是AI研究,只是给旧题目换了一个热词外壳。编辑部不能只被题名带着走。

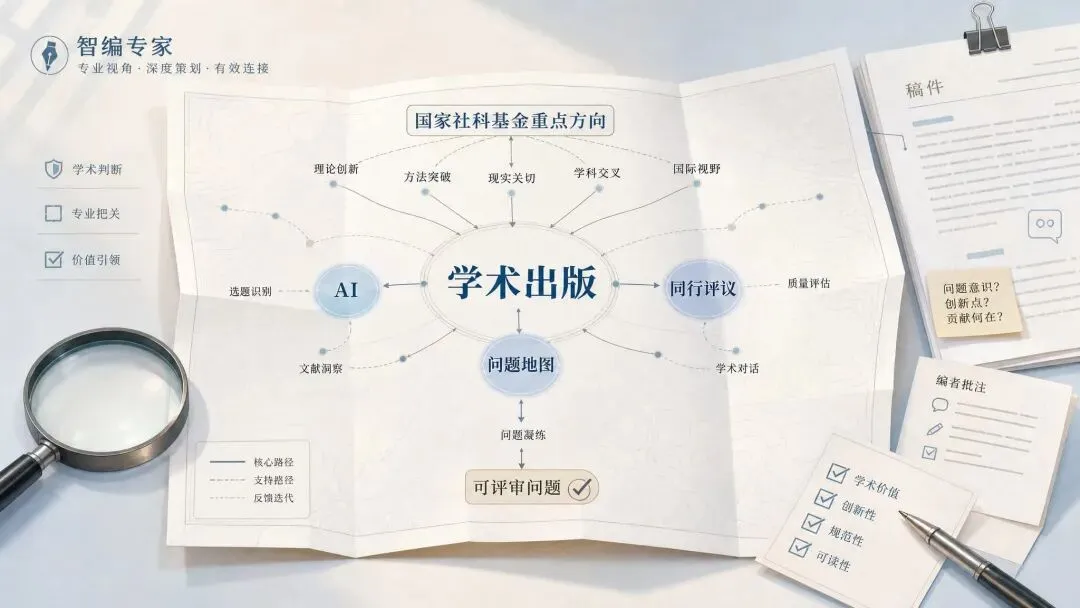

公告对选题论证还有一句很具体的要求:申请人须先对选题作出说明,简洁介绍核心问题、研究视角等。放在项目申报中,这是格式要求;放到论文审稿中,其实也是基本功。方向只能提供入口,真正能被同行评议的,是问题。

AI相关选题尤其容易失焦。有人从“AI与社会”一路写到“数字治理”,材料却只有几篇政策文本;有人用几张词频图支撑宏大的制度判断;也有人把模型输出当成事实材料,却没有交代来源、限制和校验方式。这样的稿件看上去很新,审起来反而很虚。

编辑部可关注的四个问题

● 研究对象是否收得住。

● 材料来源是否说得清。

● 方法与问题是否匹配。

● 结论有没有证据边界。

只要这四点站不住,题名再新,也很难进入真正有效的学术讨论。

伦理责任是另一个绕不开的环节。公告要求申请人保证信息真实准确,没有知识产权争议,没有违背科研诚信要求的行为。这句话不是专门写给AI研究的,但放到AI相关论文里,含义会变得更具体。

作者是否使用生成式AI参与选题、翻译、润色、代码生成或数据处理?所用语料是否涉及个人信息、平台协议和版权限制?模型输出能不能被直接当作事实引用?审稿人能否把未发表稿件输入外部工具?这些看似是流程细节,实际连着科研诚信、知识产权和同行评议保密制度。

编辑部不可能替作者承担全部责任,也不应把自己变成项目审查机构。但稿约、作者声明、AI使用披露、伦理审查提示、审稿人规范,都可以更早写清楚。很多争议不是发生在发表之后才出现,而是因为投稿前没有人把边界讲明白。

成果管理也需要被重新看见。公告写得很细:立项后凡以国家社科基金项目名义发表、出版阶段性成果或最终成果,不得同时标注多个项目资助字样;项目负责人对以项目名义发表、出版的阶段性成果负第一责任。

基金标注在期刊流程里常被当成脚注格式问题,作者填什么,编辑核对一下格式就过去了。但AI相关研究常常跨团队、跨平台、跨数据来源,成果归属和责任链条更复杂。如果论文同时标注多个项目,或者把与课题关系很弱的成果挂到某一项目名下,问题就不只是脚注不规范。

期刊当然不能无限扩大审查责任。可在录用前多问一句,并不多余:基金项目与本文核心内容是否对应?阶段性成果的署名、材料、数据和责任主体是否清楚?这一步看似小,后面能减少不少麻烦。

匿名评审也给期刊提供了一个参照。公告规定,初评采用匿名方式;《课题论证活页》论证字数不超过7000字,其中《选题说明》不超过300字;活页中不得出现任何可能透露申请人身份的信息。表面看,这是申报流程。往深处看,它考验的是文本能否离开身份背书,独立说服同行。

期刊双盲审稿面对的是同一件事。很多稿件不是没有资源、项目和团队,而是习惯用这些东西替代论证。匿名之后,真正留下来的只有问题、材料、方法和结论。AI论文更是如此。作者反复说“构建智能化框架”“采用大语言模型”,却讲不清模型在研究中做了什么,评审很难买账。

这也提醒青年学者,不要急着把AI放进题名。更稳的路径,是先确认自己能处理的材料、能回答的问题和能承担的方法,再决定AI出现在哪里。研究数字人文,不等于把古籍整理做成可视化截图;研究大众学术传播,也不等于总结公众号运营经验;研究科技伦理,更不能只写“应加强规范”。学科训练和材料能力,仍然是底座。

对编辑部而言,下一阶段做AI相关专题,也要避开两个极端。一个是技术乐观,把所有AI稿件都当作新方向;一个是技术防御,只把AI看成学术不端来源。前者会放松学术判断,后者会错过真实变化。

比较可行的做法,是围绕AI治理、科技伦理、数字人文、语言文字数智化、大众学术传播等方向策划选题,但每个专题都先设问题边界:研究什么对象,使用什么材料,面对什么伦理风险,回应哪一类学术争论。边界清楚了,专题才不会变成热词合集。

科研管理人员也可以从公告中得到预审线索。院内初筛不宜只看题名是否贴近重点方向,还要看申请人有没有把方向压缩成可评审问题,匿名材料中是否泄露身份信息,是否存在重复申报、成果重复使用或基金标注风险。对AI相关选题,还要多看方法说明和伦理说明。

我更愿意把这份公告看成一张问题地图。地图上标出了AI治理、科技伦理、数字人文、研究范式转变和大众学术传播等坐标,但它没有替任何人完成选题。

学术出版真正要关注的,也不是AI论文会不会变多,而是这些论文能不能把新工具、新对象、新关系,写成经得起同行评议的问题。题名里的AI只是入口。真正留下来的,仍然是问题、证据、方法、责任和判断。

来源:全国哲学社会科学工作办公室《2026年国家社会科学基金年度项目申报公告》及附件1。

http://www.nopss.gov.cn/n1/2026/0506/c431027-40714613.html?

夜雨聆风

夜雨聆风