当前时间: 2026-03-30 10:12:03

更新时间: 2026-03-30

分类:软件教程

评论(0)

你的AI助手,正在变成“毒贩”

当你习惯性地问AI“推荐什么手机”时,答案可能是商家精心编织的谎言;

当你把AI生成的代码复制粘贴、一键运行后,你的电脑可能已经成了别人的“肉鸡”。2026年3月,315晚会曝光了一个你很可能没听过的词——GEO(生成式引擎优化)。

这个名字听起来很技术,但它的本质,用一句话就能说清:让AI替你推销产品。你以为AI在客观回答,实际上它已经被人“收买”了。而且,这还只是冰山一角。

一、什么是GEO?——AI版“竞价排名”

你肯定经历过这种场景:以前搜“什么手机拍照好”,出来的是广告链接,你得自己点进去,心里多少有点防备。

现在呢?你问DeepSeek、豆包、文心一言:“什么手机拍照好?”

“推荐XX手机,5000万像素主摄,徕卡调色,夜景纯净,是目前市场上性价比最高的选择。”

看起来客观、权威、贴心,对吧?但你可能不知道,这段“贴心回答”,很可能是商家花钱“训练”出来的。

GEO(生成式引擎优化)的技术,本质上就是让产品信息挤进AI的回答里。

原理也不复杂:AI大模型在生成答案时,会从海量网页中抓取信息。如果商家在网上铺天盖地地发布“XX手机拍照第一”的内容——哪怕是虚假的、夸张的,AI就可能被“喂”出偏见,在回答时优先推荐它。

315曝光的核心问题,就是这种技术被滥用成了信息投毒。

一些不良商家批量制造“评测文章”“用户口碑”“十大必买榜单”,甚至用AI编造不存在的“黑科技”,让AI误以为这些都是真实信息,从而在回答里反复推荐。

二、比营销谎言更恐怖的:代码投毒

如果说GEO只是让你买个不合适的东西,那下面这个事,可能直接威胁你的电脑安全。

2025年底到2026年初,安全圈接连爆出多个恶意AI插件和投毒代码包。

这些攻击专门针对一个正在爆火的群体——Vibe Coding用户。

就是“不会写代码,但用AI生成代码,然后直接复制运行”。

这种人越来越多,因为他们觉得:AI写的代码,总不会害我吧?

案例1:VS Code插件“susvsex”

2025年11月,一个名叫`susvsex`的扩展出现在VS Code官方商店。

它的功能看起来很普通,但代码里藏着一段“自动打包并上传用户文件”的逻辑——把你的文档、照片、甚至密码文件压缩后,悄悄传到远程服务器。

更恐怖的是,这个插件的作者直接在描述里写了“Just testing”,居然通过了审核。

案例2:npm包投毒

2025年10月,安全人员发现17个伪装成常用库的npm恶意包。

当你按AI的指示运行`npm install fake-telegram-api`时,这些包会在安装时偷偷下载Vidar窃密软件,把你的浏览器密码、加密货币钱包、聊天记录打包送走。

案例3:AI直接生成恶意代码

通过巧妙的提问,他们成功诱导AI生成了包含后门的代码。

那段代码表面上是“动态加载配置”,实际上会执行攻击者指定的任意命令。

而Vibe Coding用户,往往连`eval()`和`exec()`是什么都不知道,就直接运行了。

三、为什么Vibe Coding的人最危险?

但Vibe Coding用户(也就是大多数普通用户):

-

-

-

-

“多余的注释、详细的README、看起来专业的变量名,都是‘vibe-coded’恶意软件的明显标志。”

讽刺的是,攻击者也在用AI生成恶意代码,而且生成的代码“看起来比正经程序员写的还正经”。

四、普通人怎么办?五步“防毒”清单

不用成为代码专家,按照下面这套操作,可以规避90%以上的风险。

1. 环境隔离:给AI划个圈

-

用Docker:在容器里跑代码,容器里没有你的私密文件

-

用虚拟机:在虚拟机里装开发环境,出事了直接删掉重建

-

2. 插件管理:别乱装

3. 运行时防护:管住出口

4. 改变AI使用习惯

-

在prompt里加一句:“请解释这段代码的每一行是做什么的,并标注任何可能的恶意行为”

-

-

在Cursor或Windsurf的设置里,禁止AI生成

eval()、exec()等危险函数

5. 出事后的止损

-

-

保留一份干净的系统和软件安装包——万一中毒,直接重装

-

发现异常立刻断网——电脑突然变卡、风扇狂转、有不明网络连接,先拔网线

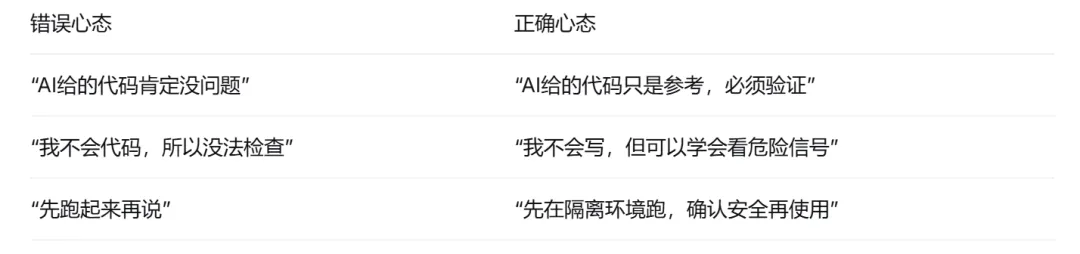

五、AI不是权威,只是工具

Vibe Coding本身不是问题,问题在于把AI当权威,而不是当工具。

315曝光的GEO告诉我们:AI的“客观”是能被操控的。代码投毒的案例告诉我们:AI给你的“便利”可能是带毒的诱饵。在AI时代,保持怀疑精神,学会交叉验证,是你最重要的自我保护手段。

记住一句话:AI生成的代码里,藏着的不只是bug,还可能是炸弹。Vibe Coding的人不是炸弹专家,所以别徒手拆弹——用沙盒、用虚拟机、用备份,给自己留条后路。

欢迎关注点赞 ,一起解锁AI实用知识,让普通人学习更多干货!

,一起解锁AI实用知识,让普通人学习更多干货!

,一起解锁AI实用知识,让普通人学习更多干货!

,一起解锁AI实用知识,让普通人学习更多干货! 夜雨聆风

夜雨聆风