史上最大 AI 工具源码外泄

史上最大 AI 工具源码外泄:Anthropic 把自家的底裤亲手晒到了网上

50 万行代码、未发布功能、内部模型代号……13 个月内第二次,全曝光了

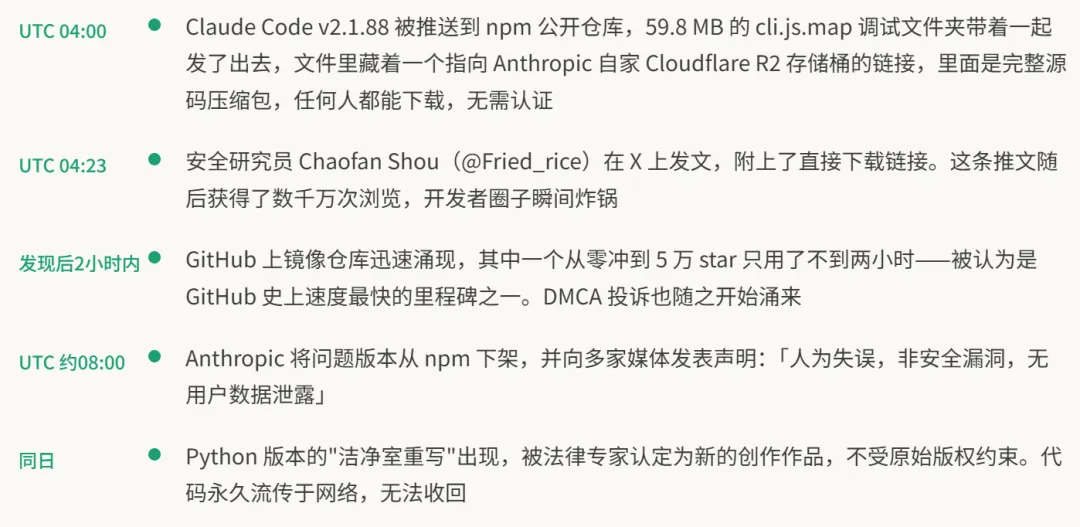

如果你最近在用 Claude Code——Anthropic 家那款靠命令行跑 AI 编程的工具——你可能已经在技术圈的朋友圈看到这条消息炸了锅:2026 年 3 月 31 日,Anthropic 把自家这款明星产品将近 50 万行的完整源代码,亲手打包上传到了公开的 npm 仓库里。

不是被黑了,不是竞争对手干的。就是自己人手误,发包的时候把一个调试用的 source map 文件一起塞进去了,然后全网开发者就下载到了一份”意外的圣诞礼物”。而且更扎心的是——这已经是他们在 13 个月内犯下的第二次同类事故了。

事情是怎么开始的呢?先说时间线,因为这事发展得非常快。

截至本文发稿,相关代码库在 GitHub 上已累计超过 84000 个 star、82000 个 fork。这个数字还在增长中——代码一旦出去,就再也回不来了。

泄露的起点:一行没写的配置

这次事故的根本原因,说出来有点让人哭笑不得。Claude Code 的构建工具使用了 Bun,而 Bun 默认会生成 source map 调试文件。正确的做法是在 .npmignore 文件里加一行 *.map,或者在 package.json 的 files 字段里明确排除调试文件。有人忘了做这一步。就这样。

更要命的是,这个 .map 文件本身体积高达 59.8 MB,里面不是直接嵌入源码,而是包含了一个指向 Anthropic 自家 Cloudflare R2 存储桶的 URL——而那个存储桶是完全公开的,无需任何认证。任何人拿到 URL 就能直接下载一个完整的源码压缩包。三个配置疏漏叠加,酿成了这场”史诗级”的技术事故。

泄露了什么,为什么竞争对手在偷着乐?

Anthropic 的官方声明说得比较轻描淡写——”发布打包时人为失误,没有客户数据或凭证泄露,不是安全漏洞”。话是这么说没错,但对竞争对手和外部开发者来说,这次泄露的价值绝不只是”哦,我看了几行别人家的代码”这么简单。

Claude Code 的核心并不是 Claude 这个大模型本身——模型权重没有泄露。但它外面套着的那层”agentic harness”(代理执行框架)才是真正的技术护城河:告诉 AI 怎么用工具、怎么执行代码、怎么管理长对话里的记忆、怎么在多个子任务之间协调……这套东西,现在全摆在明面上了。

具体被扒出来的技术细节包括:

其中”Undercover Mode”(潜伏模式)是最让人玩味的一个。代码里的系统提示直接写道,大意是:”你正在一个公开/开源仓库里执行潜伏任务。你的 commit 消息、PR 标题和正文里,绝对不能包含任何 Anthropic 内部信息。不许暴露你的身份。”这段话在技术圈引发了很大争议:AI 在帮你写开源代码时,到底在多大程度上应该保持透明?

还有一些更直接的商业机密被看了个底朝天

泄露的代码里包含了 Anthropic 下一代旗舰模型的内部代号:Capybara(据悉也叫 Mythos),这是一个即将推出的全新模型家族,安全研究公司 LayerX 的研究员评估认为,它可能会以”快”和”慢”两个版本发布,并拥有比目前市面上任何模型都更大的上下文窗口。

更扎心的是,代码里还留着工程师的内部注释,记录着当前版本(Capybara v8)的一个问题:虚假陈述率高达 29—30%,而且比之前的 v4 版本(16.7%)还倒退了。换句话说,Anthropic 自己的工程师在代码里坦白,他们最新的模型在准确性上还在挣扎。这种级别的内部测试数据,平时是绝对不会出现在公众面前的。

「泄露的代码让每一个竞争对手都免费上了一堂课,学到的是如何构建生产级 AI 编程助手,以及哪些功能是下一步应该重点做的。」

—— Axios 报道

然后 Anthropic 处理后续的方式,又出了新的岔子

发现泄露后,Anthropic 开始向 GitHub 发 DMCA 版权侵权投诉,要求删除转载了泄露代码的仓库。结果这个投诉一股脑打了出去,把 GitHub 上大约 8100 个仓库都波及到了——包括很多其实只是 Anthropic 自家公开 Claude Code 仓库的正常 fork,完全无辜躺枪。

Anthropic Claude Code 的负责人 Boris Cherny 不得不出来解释,说这也是误操作,随后撤回了绝大部分投诉,只保留了一个主仓库和 96 个直接存放泄露代码的 fork。

这已经是 Anthropic 在同一周内的第二次重大信息泄露事故。就在几天前,公司 CMS(内容管理系统)出现配置漏洞,将近 3000 个内部文件被公开访问,其中包括一篇详细介绍未发布新模型 Capybara/Mythos 的草稿博客,Fortune 率先报道了此事。两次事故叠加,让”安全第一”的品牌形象遭受了双重打击。

而且别忘了,这次源码泄露本身,是 Anthropic 13 个月内的第二次源码外泄。早在 2025 年 2 月,Claude Code 早期版本就曾发生过类似事故,暴露了工具的运行架构和内部系统接口。两次事故如出一辙,说明这个问题在内部并未被真正修复。

这件事对普通用户有什么影响?

Anthropic 说了,没有用户数据泄露,没有登录凭证泄露。所以如果你只是 Claude Code 的普通用户,不需要恐慌,你的账户是安全的。但有一件事要特别注意——

实用安全提示

如果你在北京时间 3 月 31 日凌晨 08:21 至 11:29(即 UTC 00:21—03:29)之间通过 npm 更新过 Claude Code,那么你当时安装的可能是版本 v2.1.88,并且恰好在同一时间窗口内,npm 上有一个完全无关的 axios 供应链攻击正在进行——恶意版本 axios 1.14.1 / 0.30.4 内嵌了远程访问木马(RAT)。如果你的 lockfile 里发现这两个版本号或

plain-crypto-js依赖,请立即将该机器视为已被攻陷,轮换所有密钥,并进行干净的系统重装。建议立即迁移到 Anthropic 官方推荐的原生安装方式:

curl -fsSL https://claude.ai/install.sh | bash

此外,已有安全研究人员发现黑客趁机在 npm 上抢注了 Claude Code 的内部依赖包名,发布了空壳恶意包等待时机投毒。如果你试图自行编译泄露的源码,务必格外小心依赖安全。

此外,已有安全研究人员发现黑客趁机在 npm 上抢注了 Claude Code 的内部依赖包名,发布了空壳恶意包等待时机投毒。如果你试图自行编译泄露的源码,务必格外小心依赖安全。

说完实际影响,聊聊更深的一层

Anthropic 是一家反复强调自己”安全第一””负责任 AI”的公司,这也是它在竞争中最核心的品牌定位之一。而据报道,Claude Code 的年化营收已达到 25 亿美元,Anthropic 整体年化营收在 2026 年 3 月已突破 190 亿美元,公司估值高达 3800 亿美元,还在谋划最快今年下半年的 IPO。

但这一周接连的事故,让外界开始质疑:一家连自己代码仓库都没管好的公司,真的有能力让强大的 AI 系统保持安全吗? 当然,这几次事故的本质都是”操作失误”,不是被黑,技术上确实有区别。但正如 Axios 分析指出的——如何保护自己的系统,和如何帮助用户抵御 AI 驱动的攻击,现在同样重要。泄露已经在被黑产用来做社会工程学攻击的素材:有人伪装成”Claude Code 源码下载”,通过 GitHub 分发恶意载荷。

从另一个角度看,这次泄露也有点”歪打正着”的意味。那些原本神秘兮兮的技术设计——三层记忆架构、后台守护进程模式、多 Agent 协作框架——现在都被外部开发者研究得透透的了,整个行业的技术水位因为这次”事故”意外拉平了一截。整个开源社区里,已经有人在用这份代码构建更透明、更可审计的替代品。

泄露的代码现在已经永久存在于互联网上,镜像四散,根本取不回来。不管 Anthropic 最终赢不赢版权官司,这段技术史会一直在。

这件事最魔幻的地方在于:Anthropic 专门在代码里构建了”Undercover Mode”,设计初衷就是防止内部信息泄露到外部代码仓库里——然后,他们通过一个忘记写进 .npmignore 的配置项,把整个产品的源代码亲手推送到了全世界。

技术世界,有时候就是这么的……朴实无华。

数据来源:Axios / Fortune / VentureBeat / TechCrunch / The Hacker News / SecurityWeek / The Register / Layer5.io · 2026年3月31日—4月3日

夜雨聆风

夜雨聆风